Clear Sky Science · tr

Verimli Metropolis-Hastings algoritmalarıyla derin öğrenmede güvenilir belirsizlik tahminleri

Neden daha akıllı belirsizlik önemlidir

Tıbbi taramalardan otonom araçlara kadar modern yapay zeka, güvenle yanlış yapmanın tehlikeli olabileceği kararlar alıyor. Klasik derin öğrenme sistemleri desenleri tanımada olağanüstü olsa da, ne kadar emin olmadıklarını söyleme konusunda berbat bir üne sahiptir. Bu makale o boşluğu ele alıyor: derin sinir ağlarına güvenilir belirsizlik ölçüleri kazandırmanın yeni yollarını sunuyor ve bunun için geleneksel Bayesçi yöntemlerin ağır hesap yükünü kontrol altında tutuyor.

Tahminlerden ölçülmüş güvene

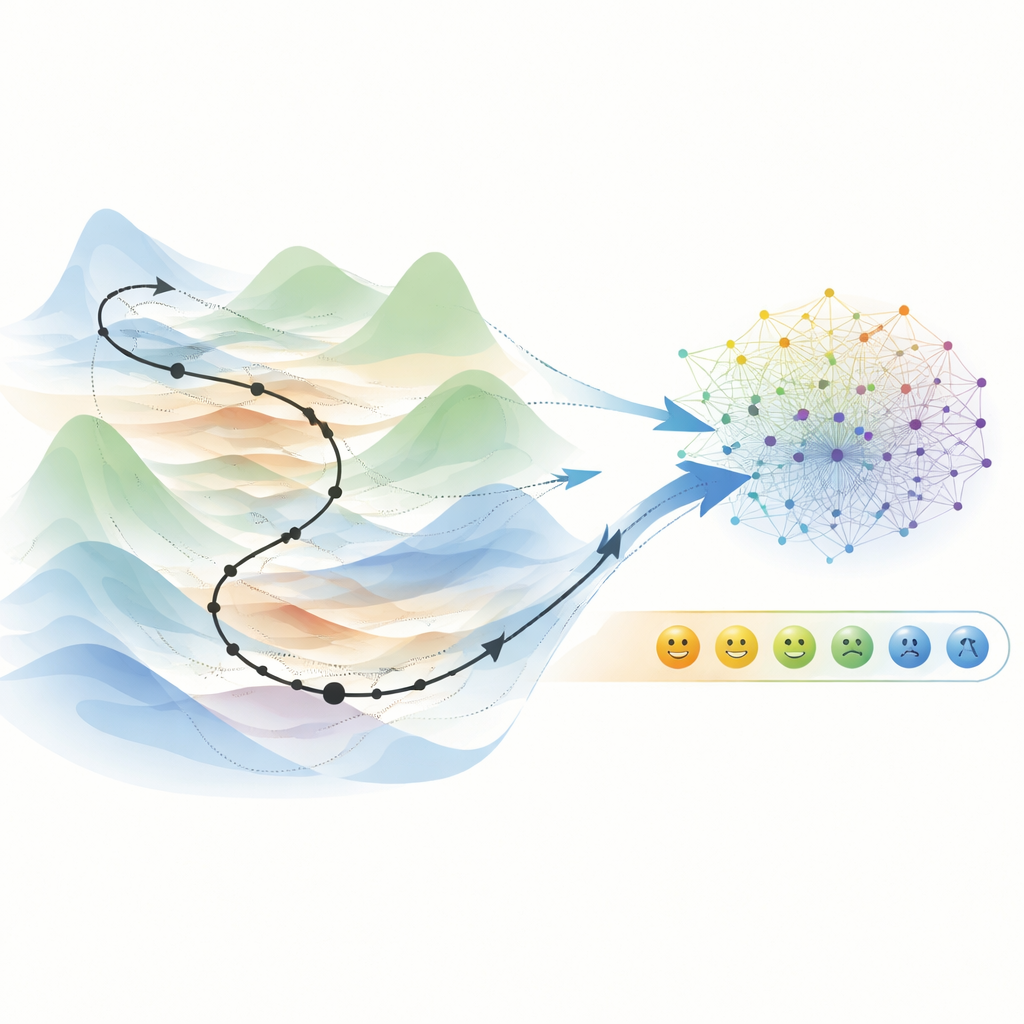

Günlük derin öğrenmede bir model bir kez eğitilir ve olduğu gibi kullanılır. Tek bir en iyi tahmin verir, ama bu tahminin ne kadar güvenilir olduğu konusunda çok az bilgi sunar. Bayesçi sinir ağları farklı bir yol izler: model parametrelerini sabitlemek yerine, bunları rastgele değişkenler olarak ele alır ve olası modellerin tümü hakkında bir dağılım yakalamaya çalışır. Tahminleri bu koleksiyon üzerinde ortalamak hem en olası cevabı hem de modelin kendine ne kadar güvenmesi gerektiğini ortaya koyabilir. Zorluk, Hamiltonyen Monte Carlo gibi altın standart yöntemlerle bu dağılımdan doğru örnek almak; günümüzün büyük ağları ve veri kümeleri için bunun maliyeti son derece yüksektir.

Büyük resimden ödün vermeden daha hızlı örnekleme

Yazarlar, örneklemeyi hızlandırmak için zaten klasik eğitimin fikirlerini—mini-batch’ler ve gürültülü gradyanlar—yeniden kullanan stokastik gradyan Hamiltonyen Monte Carlo ailesine odaklanıyor. Eksik olan bileşen, hangi geçici parametre güncellemelerinin saklanacağına karar veren güvenilir bir “filtre”dir. Klasik Hamiltonyen Monte Carlo’da bu rol, sayısal hataları düzelten ve örnekleyicinin yanlış bölgelere sürüklenmesini engelleyen Metropolis-Hastings kabul adımı tarafından üstlenilir. Bu kabul adımını derin öğrenmenin gürültülü, mini-batch dünyasına taşımak zordur; çünkü genellikle tüm veri kümesi değerlendirmeleri gerektirir ve kabul oranları çok düşükse ilerlemeyi tıkayabilir.

Arazide yürümek için iki yeni yol

Makale iki tamamlayıcı strateji tanıtıyor. Birincisi, genelleştirilmiş stokastik gradyan Hamiltonyen Monte Carlo (GSGHMC) adını taşıyor; mini-batch’ler üzerinde çalışan ancak tam problemin gerçek optimumlarını hâlâ doğru şekilde tanıma özelliğini koruyan bir kabul testi tasarlıyor. Adım adım kabulün stabil kalması için dikkatle seçilmiş bir sayısal integratör kullanıyor; böylece her seferinde sadece veri dilimini görse bile stabilite sağlanıyor. Bu, gerçek Bayesçi manzaraya yakın kalan ve özellikle iyi kalibre edilmiş güven skorları üreten modeller topluluğu (ensemble) veren verimli bir örnekleyici sağlıyor.

Daha iyi tahminler için uzun yörüngelere binmek

İkinci yöntem, Hamiltonian Trajectory Ensemble (HTE), kasıtlı bir ödünleşme yapıyor: tam Bayesçi davranışta ısrar etmek yerine, parametre uzayında momentum odaklı, uzun yürüyüşleri tercih ediyor; bunlar agresif eğitim koşularını andırıyor. Her böyle yörüngenin sonunda, elde edilen model anlık görüntüsünü saklayıp saklamamaya karar veren Metropolis tarzı bir test uygulanıyor. Bu yollar genellikle kayıp manzarasının geniş, genelleyici vadilerinde yerleştiği için toplanan modeller çeşitli ama odaklı bir topluluk oluşturuyor. EMNIST ve CIFAR-10 gibi görüntü sınıflandırma kıyaslarında, HTE güçlü Bayesçi taban çizgilerine kıyasla doğruluğu yaklaşık altı yüzdelik puana kadar iyileştiriyor ve sıradan deterministik eğitime göre de birkaç puan daha iyi sonuç verirken hâlâ kullanışlı belirsizlik bilgisi ve dağıtımdışı girdilerin güçlü tespiti gibi avantajlar sunuyor.

Daha küçük topluluklar, daha akıllı kullanım

Yüzlerce veya binlerce model örneklemek test sırasında pahalı görünebilir; bu yüzden yazarlar kaç ensemble üyesine gerçekten ihtiyaç duyulduğunu da inceliyor. Performans üzerinde az etkisi olan modelleri açgözlü bir şekilde elden çıkararak, genellikle topluluğun yaklaşık üçte birinin doğruluğu bozmayacak şekilde korunabileceğini buluyorlar; ancak çok keskin kalibrasyonu sürdürmek tipik olarak daha fazla üye gerektiriyor. Görüntü görevleri ve kaotik bir zaman serisi tahmin problemi boyunca, yöntemleri pratikte değişkenlik çıkarımı, Monte Carlo dropout ve daha basit derin ensemble’lar gibi popüler alternatifleri daha yüksek eğitim maliyeti karşılığında tutarlı şekilde geride bırakıyor veya onlara eşdeğer performans gösteriyor.

Gerçek dünya yapay zekâsı için bunun anlamı

Uzman olmayan biri için temel mesaj şudur: Derin öğrenmeyi sadece doğru yapmak değil, aynı zamanda neyi bilmediği konusunda da dürüst kılmak mümkün; bunun için süper bilgisayar ölçeğinde kaynaklara ihtiyaç yok. Klasik örnekleme fikirlerini modern, mini-batch tabanlı eğitimle dikkatle harmanlayarak, önerilen iki yaklaşım birçok mevcut teknikten daha iyi tahminler ve daha güvenilir güven skorları sunuyor. Verimlilik, dayanıklılık ve kalibre belirsizliğin bu bileşimi, aşırı güvenin maliyetinin sadece yüzde puanlarla değil, hayatlarla ölçülebileceği hassas alanlarda derin öğrenmeyi güvenle dağıtma yolunda önemli bir adımdır.

Atıf: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Anahtar kelimeler: Bayesçi sinir ağları, belirsizlik tahmini, Hamiltonyen Monte Carlo, derin öğrenme toplulukları, stokastik gradyan MCMC