Clear Sky Science · tr

Büyük dil modellerinin mozaik hafızası

Neden yakın‑kaçırma kopyalar önemli

ChatGPT gibi büyük dil modelleri metin okyanuslarından öğrenir ve bazen bu metinlerin parçalarını ezberler. Bu durum gizlilik, telif hakkı ve bu sistemlerin gerçekten ne bildiğini adil şekilde değerlendirme konularında endişe yaratır. Bu makale, ezberlemenin sadece birebir kopya‑yapıştır ile sınırlı olmadığını gösteriyor. Bunun yerine modeller, birçok hafifçe farklı versiyondan parçaları bir araya getirerek pasajları yeniden oluşturabilir; tıpkı bir mozaik toplamak gibi. Bu gizli hafıza türünü anlamak, güvenli ve güvenilir yapay zekâyla ilgilenen herkes için kritik öneme sahiptir.

Makine hafızası hakkında yeni bir bakış

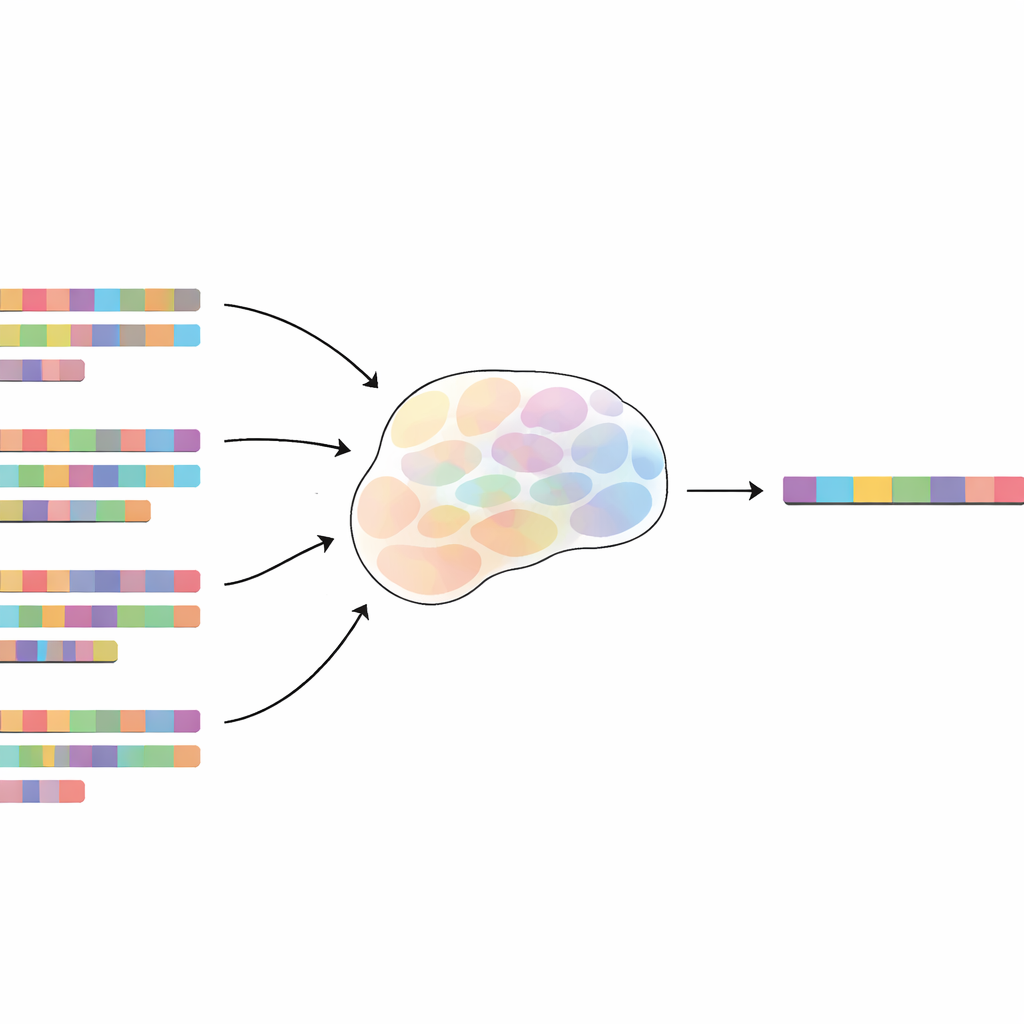

Çoğu kişi bir dil modelinin ancak aynı cümleyi defalarca görürse bir şeyi ezberleyeceğini varsayar. Yazarlar bu görüşe “mozaik hafıza”yı tanıtarak meydan okuyor. Bu bakışa göre model, yalnızca birebir tekrarlarla değil, eksik, değiştirilmiş ya da karıştırılmış sözcükler içeren birçok bulanık çoğaltmadan da 100 kelimelik bir pasajı ezberleyebilir. Bunu dikkatle incelemek için araştırmacılar, eğitim verisine yapay test ifadeleri—kanarya (canary) denilen—ekleyip bunların birçok değiştirilmiş versiyonunu yerleştirir. Eğitimden sonra, belirli bir kanaryanın eğitim setinde olup olmadığını söylemenin ne kadar kolay olduğunu, üyelik çıkarımı saldırısı olarak adlandırılan bir gizlilik testiyle ölçerler.

Bulanık kopyalar nasıl hâlâ belirgin bir iz bırakır

Bulanık çoğaltmaları birebir tekrarlarla karşılaştırarak araştırmacılar “birebir kopyaya eşdeğer”i tanımlar: bir bulanık kopyanın ezberlemeye birebir kopyayla karşılaştırıldığında ne kadar katkıda bulunduğu. Çok hafif değişikliklerin bile ezberlemeyi neredeyse zayıflatmadığını bulurlar. Her çoğaltmadaki kelimelerin yalnızca yaklaşık %10’u rastgele değiştirilse bile tek bir bulanık kopya hâlâ birebir kopyanın yaklaşık %60–65’i kadar katkıda bulunur. Kelimelerin yarısı değiştirildiğinde bile her değiştirilmiş versiyon tam bir kopyanın yaklaşık %15–20’si kadar sayılır. Etki sağlamdır: önemli ifadelerin arasına rastgele dolgu kelimeleri eklemek ya da cümlenin parçalarını karıştırmak ezberlemeyi azaltır, ama ortadan kaldırmaz. Model gürültüyü göz ardı edip örtüşen parçacıklara odaklanabiliyor ve bunları tekrar birleştirebiliyor gibi görünür.

Modellerin depoladığında biçim, anlamdan önde

Modern dil modellerinin matematik problemlerini çözebildiği, talimatları izleyebildiği ve diller arasında çeviri yapabildiği göz önüne alındığında, hafızalarının anlam üzerine olduğu beklenebilir. Şaşırtıcı bir şekilde çalışma bunun tersini buluyor. Yazarlar kelimeleri cümlenin anlamını koruyan alternatiflerle değiştirdiklerinde, ezberleme rastgele kelimelerle değiştirmeye kıyasla sadece hafifçe artıyor. Başka yapay zekâ sistemleri tarafından üretilen aynı fikri koruyan ama yüzey detayları değiştiren paraprazlar, orijinal pasajla hâlâ birçok kısa kelime dizisini paylaşmadıkça ezberlemeye nispeten az katkıda bulunuyor. Bir dizi testte gerçekten hafızayı sürükleyen etken, paylaşılan fikirler değil, tam token (modelin temel kelime parçacıkları) örtüşmesidir. Başka bir deyişle, modelin mozaik hafızası ağırlıklı olarak biçimle, anlamla değil ilgilidir.

Gerçek dünya eğitim verilerinde gizli kopyalar

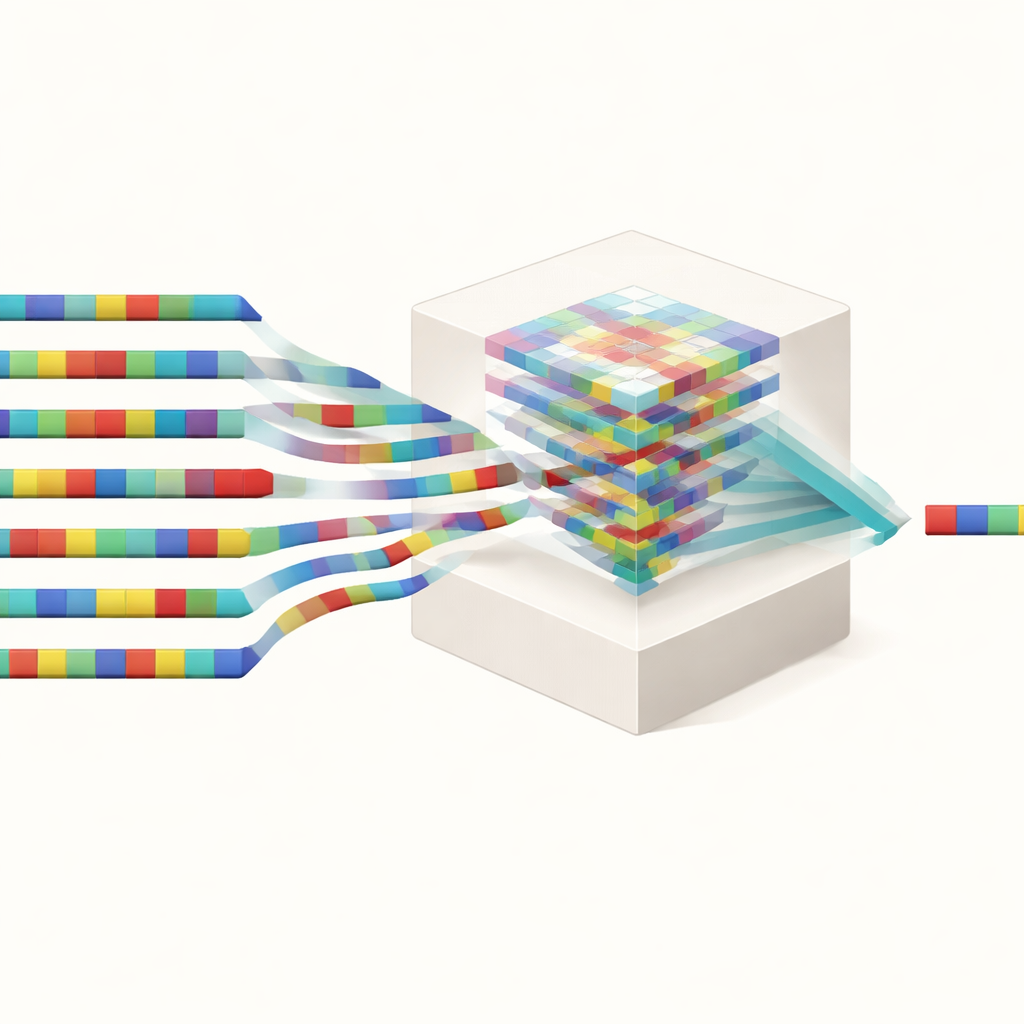

Yazarlar ardından, dil modellerini eğitmek için kullanılan, yoğun temizlenmiş popüler bir web veri seti olan SlimPajama’da bulanık kopyaların ne kadar yaygın olduğunu sorar. Bu veri setinden neredeyse aynı belgeler zaten çıkarılmış olmasına rağmen ekip, tam olarak 1.000 kez görünen birçok 100 token’lık dizinin ayrıca binlerce yakın‑kaçırma versiyonuna sahip olduğunu buluyor. Küçük düzenleme mesafeleri—yaklaşık %10 karakter değişikliği—için ortalamada tam kopyalar kadar yaklaşık 4 kat bulanık çoğaltma vardır ve daha büyük ama hâlâ etkili mesafelerde on binlerce daha fazladır. Önemli olarak, genellikle yalnızca uzun birebir örtüşmeleri çıkaran endüstrideki standart “çoğaltma temizleme” teknikleri bu bulanık kopyaların çoğunu dokunulmamış bırakır. Bu, modellerin hassas veya telif hakkıyla korunan materyali birçok hafifçe değiştirilmiş kaynaktan birleştirerek hâlâ ezberleyebileceği anlamına gelir.

Gizlilik, adalet ve denetim açısından neden önemli

Bu bulgular geniş kapsamlı sonuçlara sahiptir. Gizlilik açısından, eğitim verilerinden yalnızca birebir tekrarları temizlemenin yeterli olmadığını gösterir: kişisel veya gizli bilgiler benzer pasaj aileleri aracılığıyla ezberlenebilir. Telif hakkı ve değerlendirme testleri açısından, bulanık kopyalar modellerin korunan metinleri yeniden üretmesine veya etkili bir şekilde kamufle edilmiş hallerini görerek test puanlarını yapay olarak yükseltmesine neden olabilir. Belirli verileri “unutma” çabaları için, tek bir suç teşkil eden örneği silmek yeterli değildir; birçok varyant kalmaya devam edebilir. Genel olarak bu çalışma, dil modeli hafızasının birçok küçük örtüşmeden oluşan karmaşık bir mozaik olduğunu ortaya koyar; bu durum bugünün güvenlik araçlarını zorlar ve eğitim verilerini temizlemek ve denetlemek için daha akıllı, daha ince taneli yaklaşımlar gerektirir.

Atıf: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Anahtar kelimeler: dil modeli ezberleme, yakın kaçırılmış kopyalar, veri gizliliği, eğitim verisi çoğaltma temizliği, karşılaştırma testi kontaminasyonu