Clear Sky Science · sv

Kirurgisk RARP-copilot: en visuell språkmodell för robotassisterad radikal prostatektomi

Smartare hjälp i operationssalen

Modern prostatacanceroperation utförs med sofistikerade robotar och kameror, men kirurger måste fortfarande hantera komplexa beslut, snabbt skiftande vyer och ständiga frågor från utbildningsdeltagare och personal. Denna artikel presenterar en artificiell intelligens — en ”copilot” — som kan bevaka livevideon från operationen och svara på talade frågor på plats, ungefär som en mycket kunnig assistent. För patienter innebär det en väg mot säkrare och mer konsekventa operationer; för kirurger antyder det en framtid där expertvägledning och undervisning finns tillgänglig i varje operationssal.

En digital assistent som kan se och tala

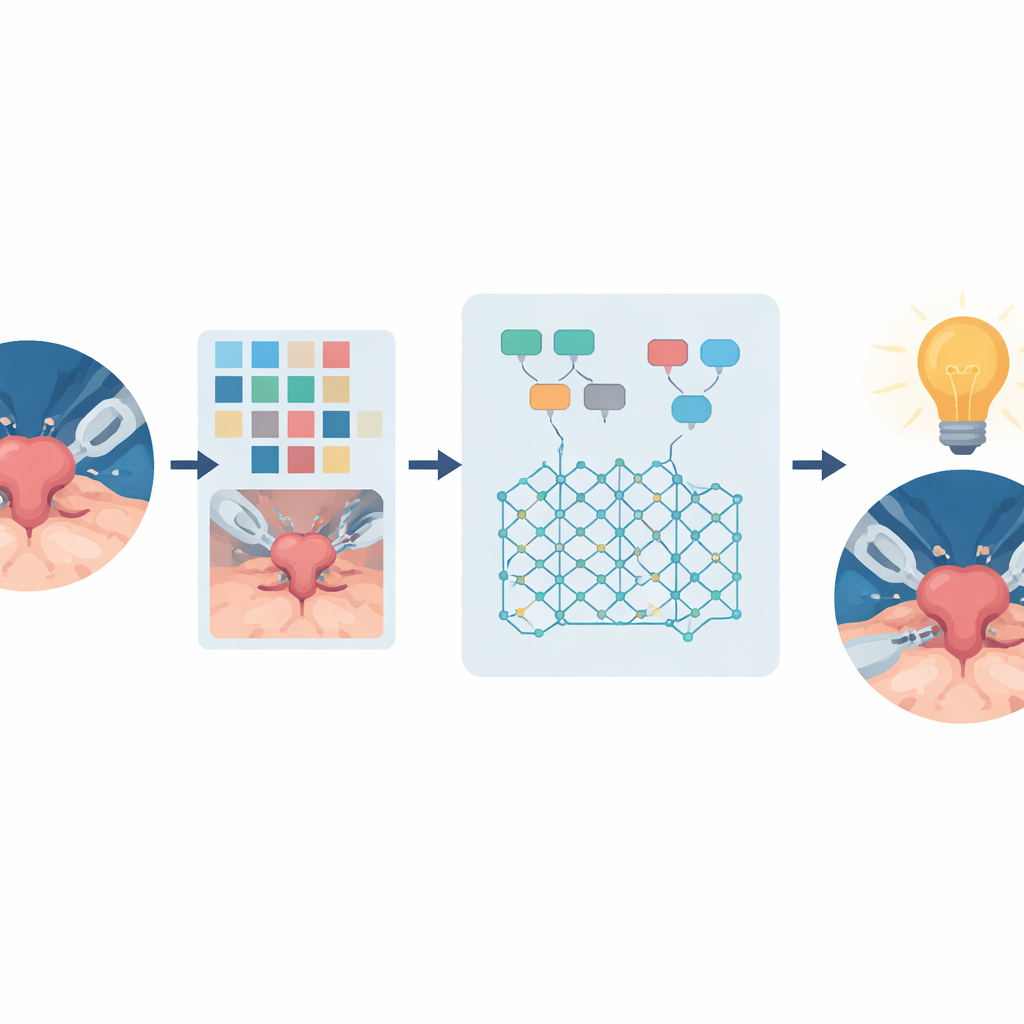

Forskarna byggde Surgical RARP Copilot för en specifik operation: robotassisterad radikal prostatektomi, standardbehandlingen för många män med lokaliserad prostatacancer. Vid detta ingrepp avlägsnar ett robotsystem som styrs av kirurgen prostatan genom små titthålssnitt, med vägledning från en högupplöst kamera inne i kroppen. Traditionella chattbaserade AI-system bearbetar bara text och kan därför inte tolka vad kirurgkameran visar. Copilot kombinerar istället datorseende med en stor språkmodell, vilket gör att den kan ”se” operationsfältet och generera naturligt formulerade svar om vad som händer, vilka instrument som syns eller vilka nästa steg i operationen bör vara.

Att lära Copiloten kirurgiskt kunnande

För att ge Copiloten meningsfull kirurgisk expertis samlade teamet en specialiserad träningsdataset i stället för att förlita sig på allmänna internetbilder. De samlade nästan 20 000 märkta bildrutor från inspelade prostataoperationer och markerade instrumentens och organens positioner samt vilket steg i proceduren som pågick. De lade också till ungefärlig djupinformation, så att systemet kunde avgöra vilka objekt som befann sig framför eller vidrörde varandra. Med expertutformade regler converterades dessa etiketter till detaljerade skrivna bildtexter som beskrev vad varje ruta visade och var i ingreppet den ingick. Stora språkmodeller promptades därefter, i röster från olika ”personas” — allt från erfarna kirurger till nyfikna barn — för att generera över en miljon fråge–svar-par baserade på dessa bildtexter. En separat modell kontrollerade dessa par för logisk konsekvens, och felaktiga exempel filtrerades bort innan träning.

Hur väl Copiloten presterar

När modellen väl tränats testades Copiloten på flera sätt. På ett fristående set av syntetiska fråge–svar-par ökade finjustering modellens förmåga att ge åtminstone delvis korrekta svar från omkring 61 % till 83 %, och helt korrekta svar från 0 % till 59 %. Mänskliga granskare ställde sedan 650 frågor om förinspelade kirurgiska bilder; nästan sju av tio svar bedömdes som helt korrekta. Systemet hanterade också klassiska datorseendeuppgifter utan extra reträning: det identifierade vilket steg i prostatektomin som var igång från en enskild videoruta med 82 % noggrannhet och igenkände kirurgiska instrument med en F1-poäng på 94 %, samtidigt som det uppskattade hur mycket tid som återstod i operationen. Dessa resultat tyder på att en enda, enhetlig modell kan matcha specialiserade verktyg för flera uppgifter samtidigt som den deltar i öppna konversationer.

Att använda AI i en liveoperation

Den mest slående demonstrationen ägde rum i en verklig operationssal. Copiloten driftsattes på en kraftfull edge-dator kopplad direkt till robotkirurgins videoflöde. Under en liveprostatektomi som utfördes på en annan robotplattform än den som användes för träning skickade en publik av kirurger och ingenjörer in 276 frågor via sina smartphones. Efter att irrelevanta och dubblettfrågor filtrerats bort bedömde experter att Copiloten svarade korrekt på ungefär 77 % av de återstående frågorna — jämförbart med dess offlineprestanda. Systemet började generellt svara på cirka en halv sekund innan det inledde sitt svar och producerade text tillräckligt snabbt för att kännas interaktivt, samtidigt som det tillämpade säkerhetsfilter och antog en konservativ hållning vid osäkerhet.

Vad detta betyder för framtidens kirurgi

För en allmän publik är huvudbudskapet att ett AI-system nu kan bevaka en känslig canceroperation i realtid och ge användbara, kontextmedvetna svar om vad som händer och vad som bör hända härnäst. Även om nuvarande Copilot är begränsad till en typ av operation, förlitar sig på ögonblicksbilder snarare än full videominne och ännu inte har tillgång till fullständiga medicinska journaler, visar den att multimodal AI kan införas i operationssalar på ett säkert sätt. När liknande system utvidgas till fler procedurer, kopplas till rikare patientdata och genomgår rigorösa kliniska prövningar, kan de stödja utbildning, förbättra teamkommunikation och i slutändan bidra till att göra komplex kirurgi säkrare och mer transparent.

Citering: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Nyckelord: robotkirurgi, prostatacancer, kirurgisk AI, visionsspråkmodell, hjälp i operationssalen