Clear Sky Science · sv

Systematisk utvärdering och riktlinjer för Segment Anything-modellen i analys av kirurgiska videor

Varför smarta videoverktyg spelar roll i operationssalen

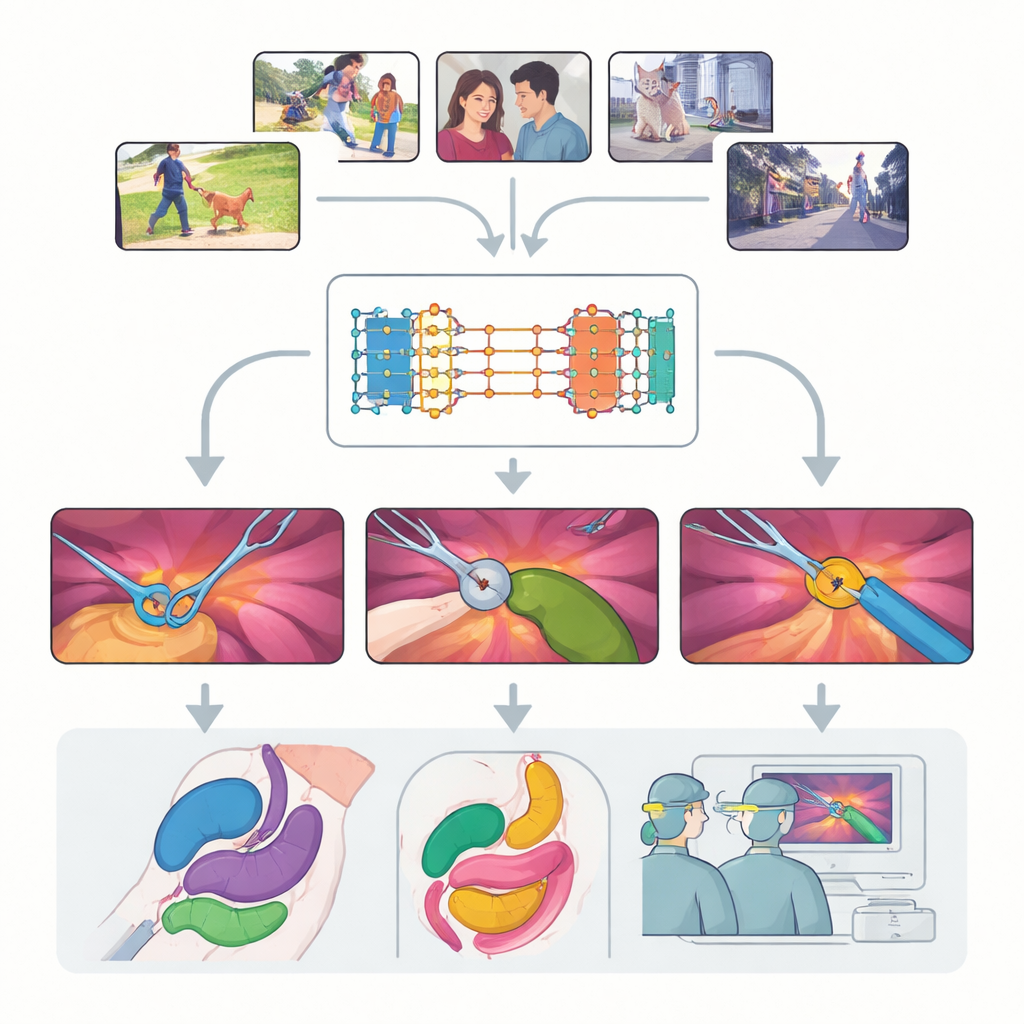

Modern kirurgi styrs i allt större utsträckning av video: små kameror tittar in i kroppen medan kirurgerna navigerar känsliga instrument på en skärm. Att förvandla dessa rika men röriga videor till tydliga, etiketterade kartor över instrument och vävnader kan göra operationer säkrare, utbildning mer effektiv och framtida robotstöd mer tillförlitligt. Denna studie tar ett kraftfullt nytt allmänt synsystem, ursprungligen tränat på vardagliga bilder och videor, och ställer en enkel men viktig fråga: kan det "se" tillräckligt bra inuti människokroppen för att vara användbart i verklig kirurgi — utan att tränas om från grunden på kostsamma medicinska data?

Ett flexibelt synverktyg byggt för vilken scen som helst

Arbetet fokuserar på Segment Anything Model 2 (SAM2), ett stort AI-system utformat för att plocka ut objekt i bilder och videor när det får en ledtråd, eller "prompt", om vad det ska leta efter. Till skillnad från traditionella modeller som lär sig fasta kategorier är SAM2 klass-agnostisk: den bryr sig inte om ett objekt är en hund, en bil eller ett kirurgiskt instrument, så länge användaren pekar ut det med en punkt, en ruta eller en exempelmask. En viktig nyhet i SAM2 är dess minnesbank, som kommer ihåg hur ett objekt såg ut i tidigare bildrutor och använder det minnet för att följa det över tid. Detta gör SAM2 särskilt lovande för kirurgiska videor, där instrument kommer in och ut ur bild och vävnader ständigt deformeras.

Sätter modellen på prov över många operationer

Författarna genomför en storskalig, systematisk utvärdering av SAM2 på nio olika dataset som täcker sjutton typer av ingrepp, från laparoskopisk gallblåseoperation till robotassisterad prostataoperation och endoskopi. De undersöker tre stora utmaningar: spårning av instrument, segmentering av flera organ och tolkning av scener som blandar verktyg och vävnad. För varje uppgift testar de olika sätt att prompta modellen — enkla punkter, flera punkter, ramar (bounding boxes) och fulla masker — och utforskar hur ofta promptarna behöver uppdateras medan videon spelas. De jämför också modellen direkt ur lådan med flera sätt att lätt finjustera den på kirurgiska bilder för att se hur långt prestandan kan pressas utan att kräva enorma nya dataset.

Vad som fungerar bäst inuti kroppen

Sammanfattningsvis visar sig SAM2 vara förvånansvärt stark i denna ovanliga miljö. Utan kirurgisk omträning segmenterar den redan instrument och många organ konkurrenskraftigt jämfört med specialiserade medicinska modeller, särskilt när den får rika prompts som rutor eller masker. Periodisk "re-initialisering" av promptarna ungefär var 30:e bildruta — i praktiken att påminna systemet om vad som är var — förbättrar spårningen avsevärt över långa, komplexa klipp. När forskarna finjusterar endast specifika delar av SAM2, till exempel modulen som omvandlar prompts till masker, ökar noggrannheten i scenarier med flera organ kraftigt samtidigt som träningsbehovet hålls modest. Däremot kan försök att justera hela bildkodaren med begränsade kirurgiska data faktiskt försämra prestandan, vilket tyder på att större delen av SAM2:s allmänna visuella kunskap bör lämnas intakt.

Begränsningar i röriga, snabbt föränderliga scener

Studien blottlägger också tydliga svagheter. SAM2 har svårt när kameravyn är snäv, bilden är bullrig eller dåligt belyst, eller när vävnader saknar skarpa gränser, som i vissa endoskopiska ingrepp. Finförgrenade strukturer som blodkärl och gångar är svåra att separera när de överlappar eller delar samma ungefärliga kontur. Att använda videominne hjälper inte alltid: i mycket dynamiska scener med snabb kamerarörelse kan de temporala signalerna vilseleda modellen istället för att stabilisera den. Dessa fynd betonar att även om en generell foundation-modell kan ta en lång bit på vägen, kräver vissa kirurgiska realiteter fortfarande domänspecifik finjustering och bättre hantering av rörelse och förändringar i utseende.

Riktlinjer för framtida smarta kirurgisystem

Ur denna omfattande testning destillerar författarna praktiska rekommendationer för forskare och kliniker som vill använda SAM2 i kirurgiska projekt. De rekommenderar att börja med mask- eller box-prompts och enkel, bildbaserad finjustering med fokus på mask-dekodern, att lägga till periodiska promptuppdateringar för långa videor, och att bara utforska mer komplex video-baserad träning när scenerna är relativt stabila. De visar att även glest annoterade klipp — där bara vissa bildrutor är märkta — kan räcka för att effektivt anpassa modellen. Enkelt uttryckt är slutsatsen uppmuntrande: en enda, brett tränad synmodell kan hantera många olika kirurgiska segmenteringsuppgifter och kraftigt minska behovet av att bygga ett nytt verktyg för varje ingrepp. Med genomtänkt prompting och lätt anpassning kan system som SAM2 bli kraftfulla byggstenar för nästa generations kirurgiska navigations-, automatiserings- och utbildningsverktyg.

Citering: Yuan, C., Jiang, J., Yang, K. et al. Systematic evaluation and guidelines for segment anything model in surgical video analysis. npj Digit. Surg. 1, 2 (2026). https://doi.org/10.1038/s44484-025-00002-2

Nyckelord: analys av kirurgiska videor, bildsegmentering, foundation-modeller, datorstödd kirurgi, medicinsk AI