Clear Sky Science · sv

Förklaringsbar ram för flergrads-attributionsresonemang för upptäckt av falska nyheter

Varför det blir svårare att upptäcka falska nyheter

Varje dag färdas miljontals inlägg som kombinerar ord och bilder genom sociala medier. En del är ofarliga, en del är sanna och en del är omsorgsfullt konstruerade för att få uppmärksamhet, väcka känslor eller påverka åsikter. När bildredigeringsverktyg och AI-generatorer blir billigare och lättare att använda blir falska nyheter både mer polerade och farligare. Denna artikel introducerar ett nytt sätt att se in i system för upptäckt av falska nyheter så att vi inte bara kan avgöra om ett inlägg sannolikt är falskt, utan också varför.

Hur falska nyheter lurar våra ögon och sinnen

Skapare av falska nyheter utnyttjar hur människor snabbt skummar rubriker och bilder. De kan förfalska eller justera foton, väva in delvis sanna detaljer i en omöjlig berättelse, sätta samman bitar från olika händelser eller blanda platser och tidslinjer som inte hör ihop. Ett enda inlägg om en aktuell händelse kan visa en dramatisk bild från en annan incident år tidigare, eller en övertygande bild kan ha genererats helt av AI. Traditionella detektionssystem behandlar oftast alla falska inlägg lika och pressar ihop text och bild till en enda blandad ”feature‑soppa.” Den metoden kan fungera någorlunda, men uppträder som en svart låda: det är svårt för journalister, plattformar eller vanliga användare att förstå vilka specifika ledtrådar som utlöste varningen.

Ett nytt sätt att fråga: ”Varför är detta falskt?”

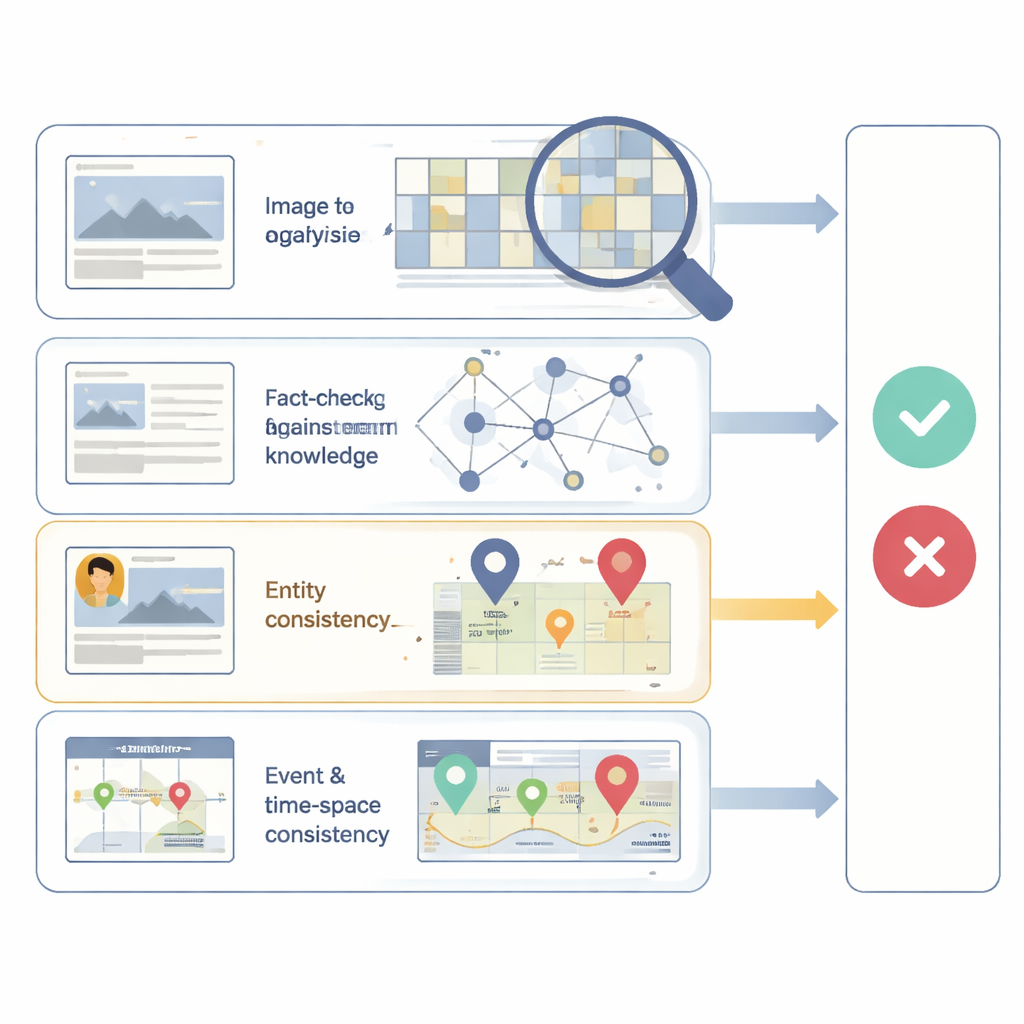

Författarna föreslår en förklaringsbar ram kallad EMAR‑FND som granskar nyhetsinlägg ur fyra distinkta vinklar, var och en kopplad till ett vanligt sätt att tillverka förfalskningar. För det första undersöker den om bilden i sig visar tecken på manipulation eller syntetisk generering, genom att fokusera på subtila kameranivå‑brusmönster som förändras när en bild ändras. För det andra kontrollerar den om berättelsens fakta stämmer överens med betrodd extern kunskap, såsom kända relationer mellan människor, platser och händelser. För det tredje granskar den om de centrala entiteterna som nämns i texten — som en offentlig person eller en stad — faktiskt matchar vad som syns i den medföljande bilden. För det fjärde bedömer den om den beskrivna händelsen går ihop i tid och rum, till exempel genom att upptäcka en avvikelse mellan en uppgiven plats och visuella ledtrådar i bilden, eller mellan en rapporterad tidslinje och annan bevisning.

Sätta ihop ledtrådar från många håll

Var och en av dessa fyra kontroller hanteras av sin egen resonemangsmodul, som gör en partiell bedömning om den specifika aspekten verkar trovärdig. En modul fokuserar på visuell manipulation; en annan resonerar över externa kunskapsgrafer; en tredje bygger ett rikt nätverk som kopplar ord, objekt i bilden och extraherade händelser; och en fjärde jämför inlägget med relaterad evidens över tid och rum. Istället för att dölja dessa signaler i en enda fusionerad representation behåller EMAR‑FND deras bidrag separat och kombinerar dem sedan genom ett slutligt beslutssteg som kan väga hur viktig varje vy är i ett visst fall. Resultatet är inte bara en slutlig sann‑eller‑falsk‑poäng, utan också en attribution som visar, till exempel, att ett inlägg flaggas främst för att bilden verkar förfalskad, eller för att den beskrivna händelsen aldrig stämmer med kända fakta.

Testning av systemet i verkliga förhållanden

För att se hur väl detta angreppssätt fungerar tillämpade forskarna EMAR‑FND på två offentliga samlingar av verkliga och falska nyhetsinlägg som innehåller både text och bilder. Över dessa datamängder överträffade deras metod flera starka befintliga system och uppnådde högre noggrannhet och bättre balans mellan att fånga falska inlägg och undvika falsklarm. När de granskade hur inlägg klustrades i modellen tenderade riktiga nyheter att bilda täta, konsekventa grupper, medan falska nyheter var mer spridda — vilket återspeglar de många olika trick som förfalskare använder. Attributionsutgångarna visade sig också vara användbara i svåra, verkliga exempel: inlägg där text och bild vid första anblick verkade överens ställdes som falska antingen för att bilden visade gömda manipulationsspår eller för att extern kunskap motsade de påstådda fakta.

Vad detta betyder för vardagliga läsare

Enkelt uttryckt visar studien att det är möjligt att bygga detektorer för falska nyheter som beter sig mindre som orakel och mer som noggranna utredare. Istället för att ge ett naket ja‑eller‑nej‑svar framhäver EMAR‑FND vilken del av ett inlägg som är misstänkt: bilden, fakta, de nämnda personerna eller själva händelsen. Denna typ av förklaring kan hjälpa faktagranskare, plattformar och läsare att lita på systemets beslut och lära sig känna igen vanliga mönster av bedrägeri. När falska nyheter fortsätter att utvecklas kommer verktyg som både kan upptäcka och förklara manipulation vara avgörande för att hålla onlinets informations‑ekosystem friskare och mer transparenta.

Citering: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Nyckelord: upptäckt av falska nyheter, multimodal desinformation, förklaringsbar AI, sociala mediers integritet, analys av bildförfalskning