Clear Sky Science · sv

DeepKoopFormer: en Koopman-förstärkt transformer-baserad arkitektur för tidsserieprognoser

Varför smartare prognoser spelar roll

Från väder- och energiplanering till finansmarknader beror många av våra största beslut på att förutsäga hur saker förändras över tid. Dessa "tidsserier" — strömmar av mätvärden som vindhastighet, elproduktion eller valutakurs — blir längre, bullrigare och mer komplexa. Moderna AI-verktyg kallade Transformers kan bearbeta dessa data, men de uppträder ofta som svarta lådor och kan bli instabila när de pressas att förutsäga långt in i framtiden. Denna artikel presenterar DeepKoopFormer, en prognosmetod som behåller Transformers prediktiva kraft samtidigt som den lägger till matematisk struktur för att göra deras beteende mer stabilt, tolkbart och tillförlitligt över långa tidshorisonter.

En ny väg för att stabilisera kraftfulla modeller

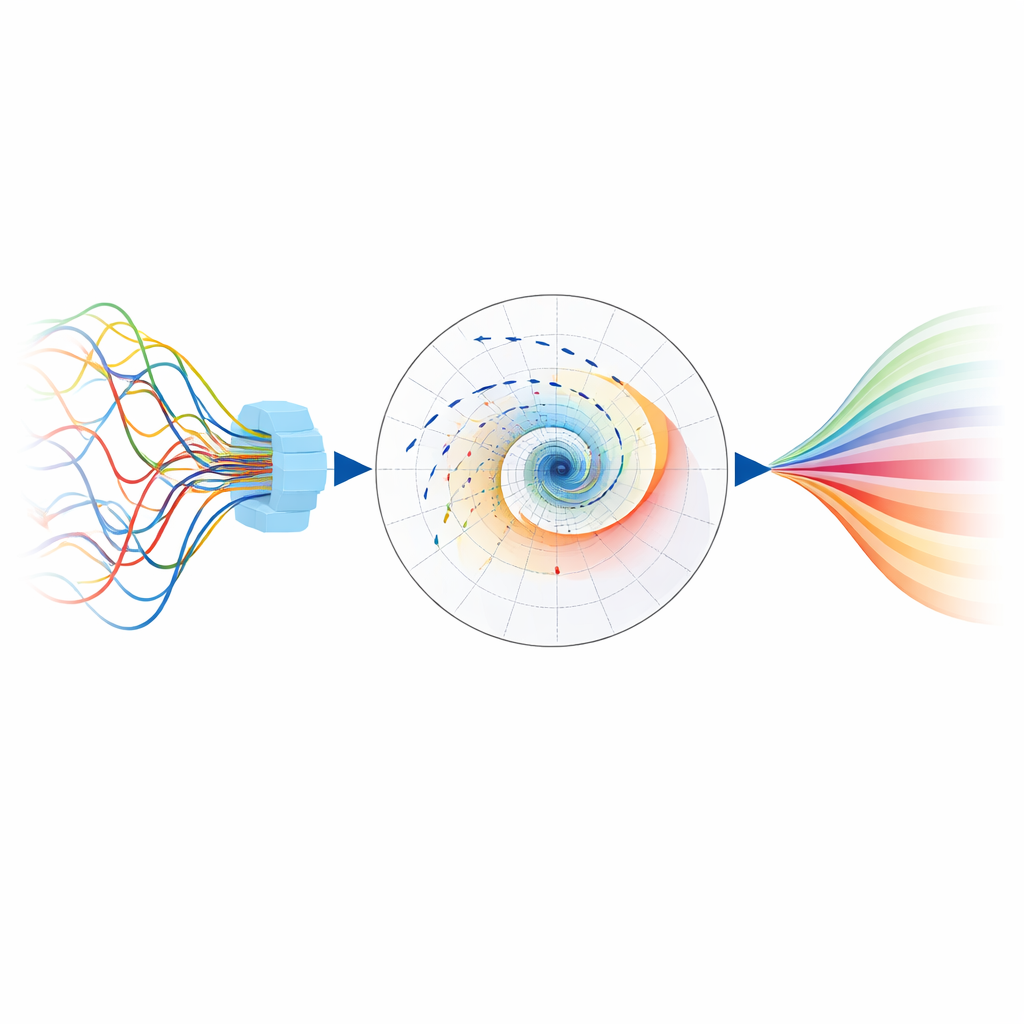

Författarna utgår från en bekant idé i dagens AI: använd en Transformer för att smälta råa tidsserier till en rik intern representation. DeepKoopFormer infogar sedan ett noggrant utformat mellanskikt inspirerat av ett begrepp från dynamiska system som kallas Koopman-operatorn. Istället för att låta modellen utvecklas på ett komplicerat, helt icke-linjärt sätt avancerar detta mellanskikt det interna tillståndet med en enkel linjär transformation i ett dolt rum. Avgörande är att denna transformation byggs så att dess påverkan gradvis krymper över tiden snarare än växer okontrollerat, vilket matematiskt garanterar att långsiktiga prognoser inte exploderar eller oscillerar ohämmat.

Hur modellen håller balansen

För att upprätthålla denna stabilitet begränsar DeepKoopFormer det linjära steget på flera sätt. Transformeringen faktoriseras i tre delar: två ortogonala matriser (som bevarar längder och vinklar) runt en diagonal matris av skalningsfaktorer som alla tvingas vara mindre än ett. Det betyder att det dolda tillståndet varsamt kontraheras snarare än förstärks vid varje uppdatering. En andra ingrediens, kallad Lyapunov-regularisering, lägger till en träningsstraff när energin i det dolda tillståndet växer från ett steg till nästa. Tillsammans säkerställer dessa mekanismer att de interna dynamikerna är lugna och väluppförda, medan Transformern innan och den linjära avkodaren efter detta steg förblir fria att vara uttrycksfulla. Modellens kapacitet att lära sig rika mönster och dess stabilitet styrs av separata inställningar, så användare kan finjustera den ena utan att förstöra den andra.

Sätta metoden på prov

Forskarna utvärderar DeepKoopFormer på både kontrollerade och verkliga problem. De testar först på klassiska kaotiska system såsom Lorenz-attractorn, där små förändringar kan leda till mycket olika framtider, och lägger till slumpmässigt brus för att efterlikna verkliga mätningar. Över olika Transformer-arkitekturer följer de Koopman-förstärkta versionerna nära de sanna banorna samtidigt som de bibehåller stabilt internt beteende över många korttidsprognoser. Författarna går sedan vidare till krävande verkliga datamängder: klimatprognoser och reanalys över Tyskland (vindhastighet och yttryck), kryptovalutapriser och elproduktion från flera källor i Spanien. I dessa fall jämförs DeepKoopFormer-varianter med en standard long short-term memory (LSTM)-nätverk och enklare linjära baslinjer, över många val av ingångsfönstrets längd, prognoshorisont och modellstorlek.

Vad experimenten visar

Över klimat-, finans- och energiuppgifter uppnår de Koopman-augmenterade Transformermodellerna generellt sett lägre förutsägelsefel och stabilare beteende än LSTM-baslinjen, särskilt vid prognoser många steg framåt eller vid arbete med högdimensionell data. För vind och tryck över Tyskland, och för elproduktion, tenderar PatchTST- och Informer-versionerna av DeepKoopFormer att prestera bäst och fånga både mjuka trender och snabba fluktuationer pålitligt. I vissa speciella fall där underliggande mönster är nästan helt linjära vinner fortfarande en mycket enkel linjär metod på testnoggrannhet, vilket understryker att ingen enskild modell är universellt optimal. Dock visar Koopman-baserade konstruktioner konsekvent mjukare felmönster när prognoshorizonterna växer, vilket indikerar bättre kontroll över långsiktig osäkerhet och mindre benägenhet att överanpassa märkliga detaljer i träningsdata.

Varför detta tillvägagångssätt är lovande

Sammanfattningsvis visar DeepKoopFormer att det är möjligt att förena djupinlärningens flexibilitet med garantierna från klassisk dynamikteori. Genom att infoga ett strukturerat, stabilt linjärt steg i en i övrigt standardiserad Transformer-pipeline får författarna prognoser som är noggranna, robusta mot brus och matematisk enklare att resonera kring. För praktiker som förlitar sig på långsiktiga prognoser inom klimatforskning, energisystem eller finans — där stabilitet och tolkbarhet är lika viktiga som rå noggrannhet — erbjuder detta ramverk ett sätt att lita mer på kraftfulla neurala modeller och att förstå hur och varför deras förutsägelser beter sig över tid.

Citering: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Nyckelord: tidsserieprognoser, transformermodeller, Koopman-operatorn, stabila dynamiker, klimat- och energidata