Clear Sky Science · sv

En variational ram för residualbaserad adaptivitet i neurala PDE-lösare och operatorinlärning

Mindre klipsk AI för svåra ekvationer

Många av dagens vetenskapliga genombrott – från klimatmodellering till design av nya material – är beroende av att lösa komplexa ekvationer som beskriver hur vätskor rör sig, hur vågor fortplantas eller hur kemiska fronter utvecklas. Neurala nätverk har nyligen blivit kraftfulla verktyg för att ta sig an dessa ekvationer, men de har ofta svårt när fysiken blir krävande: skarpa chocker, småskaliga strukturer och långtidsprediktioner kan få dem att misslyckas. Denna artikel introducerar ett systematiskt sätt att få dessa AI-lösare att rikta sina ansträngningar exakt där de har störst svårigheter, så att de både blir snabbare och mer precisa.

Varför neurala nät behöver vägledning

I vetenskaplig maskininlärning tränas neurala nätverk antingen för att återge lösningen av en enskild ekvation (som i fysikinformerade neurala nätverk, PINNs) eller för att lära en hel avbildning från indata till lösningar (kallat operatorinlärning). I båda fallen bedöms nätverket av ett "residual", ett mått på hur mycket det bryter mot den underliggande ekvationen i varje punkt i rum och tid. Standardträning behandlar alla punkter lika och minimerar medelfelet. Det fungerar för enkla problem, men för ekvationer med branta gradienter, rörliga fronter eller lokaliserade strukturer kan ett lågt genomsnitt dölja allvarliga misstag i kritiska regioner. Forskare har svarat med ad hoc-regler som placerar fler träningspunkter där residualen är stor, men hittills har dessa regler varit heuristiska och svagt motiverade.

En enhetlig metod för adaptivt fokus

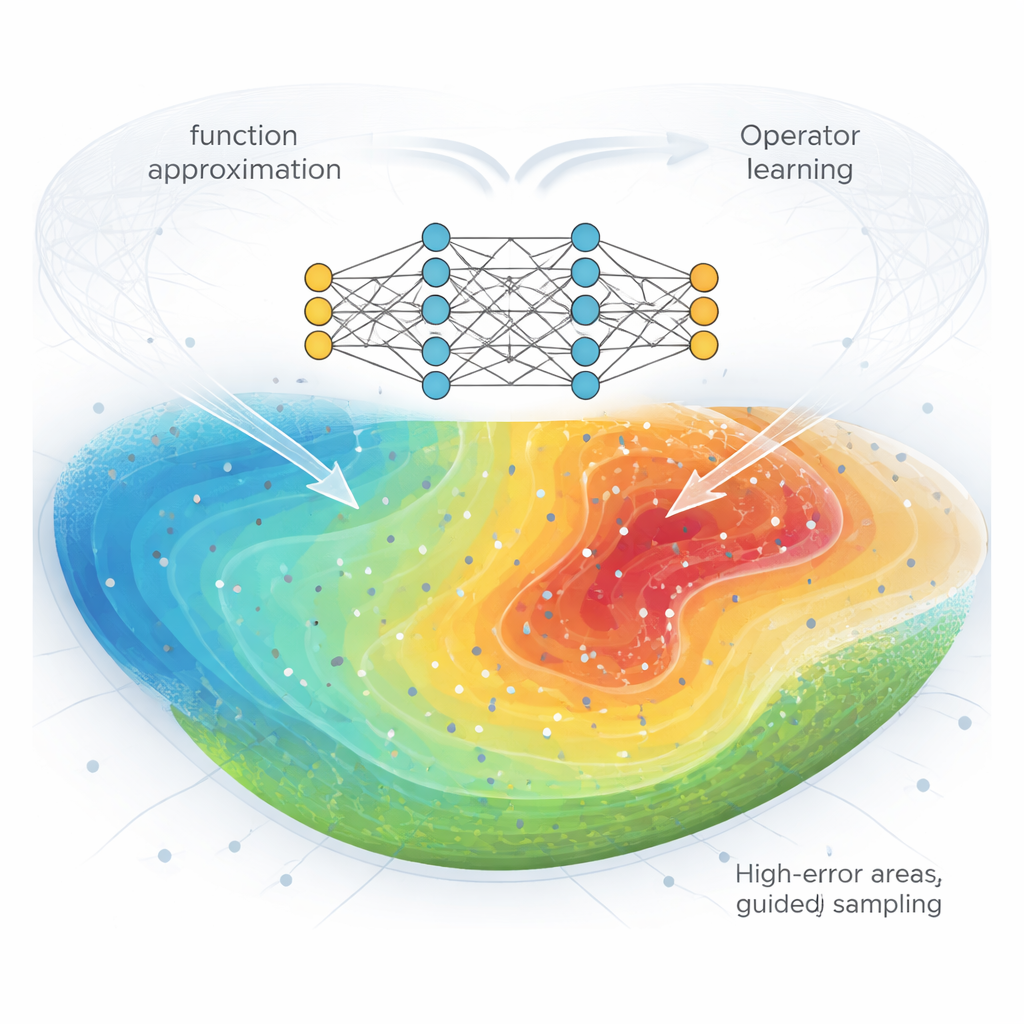

Författarna utvecklar en variational ram som förvandlar dessa heuristiker till ett principfast recept. Nyckelidén är att se provtagning och viktning som val av vilken sannolikhetsfördelning över rummet (och över träningsexemplen) nätverket bör bry sig mest om. De introducerar en familj av "potential"-funktioner som transformerar residualen till ett nytt mål. Olika val av potential motsvarar olika prioriteringar: en exponentiell potential driver nätverket att minska sitt enskilt största fel, medan en kvadratisk potential betonar att minska spridningen, eller variansen, av felet över domänen. Matematiskt leder optimering av dessa transformerade mål naturligt till att man provtar oftare i regioner där den nuvarande residualen är stor. Den resulterande metoden, kallad variational residual-based attention (vRBA), omfattar många befintliga adaptiva scheman och ger en tydlig väg för att uppfinna nya.

Utvidgning till att lära hela fysikkartor

Moderna AI-lösare siktar alltmer på att lära inte bara en lösning utan en hel operator: en avbildning från indata såsom begynnelsevillkor eller yttre påverkan till fullständiga rums‑tidsfält. Detta är målet för neurala operatorarkitekturer som DeepONet, Fourier Neural Operators (FNO) och tids‑konditionerade U‑Nets. Här fördubblas utmaningen: det finns variation mellan olika indatavektorer och variation i rum och tid inom varje exempel. Författarna anpassar sin ram till denna produktinställning genom att kombinera två nivåer av adaptivitet. För det första omviktar de rumsliga punkter inom varje exempel så att områden med höga residualer väger tyngre. För det andra använder de ackumulerade residualer för att föredra omprovtagning av hela träningsexempel som är svårast att lära. Detta hybrida schema kan kopplas direkt in i populära modeller för operatorinlärning utan att omdesigna deras arkitektur.

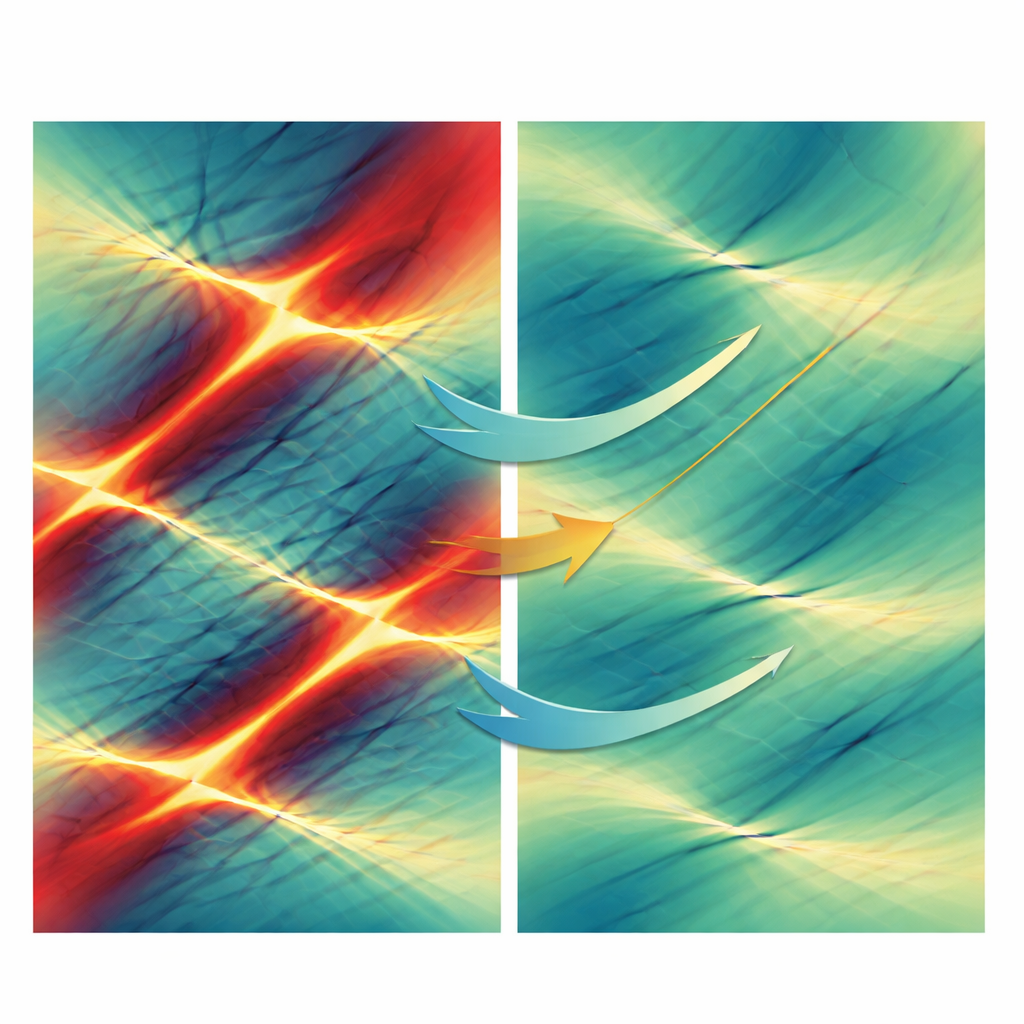

Skarpare detaljer, långsammare feluppbyggnad

I en omfattande uppsättning benchmarktester presterar vRBA konsekvent bättre än traditionell träning. För PINNs testar teamet klassiska icke‑linjära ekvationer såsom Allen–Cahn, Burgers’ och Korteweg–De Vries-ekvationerna. Vissa av dessa problem är kända för att slå ut standard‑PINNs, antingen på grund av skarpa interna lager eller interagerande vågpulser. Med vRBA konvergerar samma nätverk snabbare och når avsevärt lägre fel, och i svåra fall där basmetoden i praktiken misslyckas återställer de adaptiva metoderna korrekta lösningar. För operatorinlärning tillämpar de vRBA på bubblors tillväxt i vätskor, högtrycks‑shockrörsflöden, tvådimensionell turbulens och vågutbredning. Här är den huvudsakliga fördelen inte bara ett bättre slutligt fel, utan en mycket långsammare ackumulering av misstag över tid, vilket är avgörande när modellens output upprepade gånger matas tillbaka som dess egen input.

Rensar upp brus i inlärningssignalen

Författarna härleder dessa vinster till två huvudmekanismer. För det första minskar vRBA genom att förändra hur träningspunkter provtas eller viktas den statistiska brusnivån i det skattade förlustmåttet: slumpmässiga minibatcher ger en mer pålitlig bild av hur väl nätverket presterar överlag. Detta minskar direkt diskretiseringsfelet, gapet mellan det kontinuerliga ideala målet och den ändliga mängd punkter som används i praktiken. För det andra förbättrar metoden signal‑till‑brus‑förhållandet i gradienterna som driver inlärningen, så att olika regioner av domänen i högre grad "är överens" om vilken riktning parametrarna bör röra sig. Som ett resultat lämnar nätverken långsamma, obeslutsamma träningsfaser mycket tidigare och går in i ett regime där felet faller snabbt. Ramen klargör också när aggressiva strategier – de som kraftigt bestraffar de största residualerna – kan hjälpa och när de riskerar att destabilisera träningen.

Vad detta betyder för framtidens vetenskapliga AI

För icke‑experter är budskapet att smartare uppmärksamhet på var en AI‑lösare har fel kan göra den till ett betydligt mer trovärdigt verktyg för vetenskap och teknik. Istället för att förlita sig på trial‑and‑error‑regler erbjuder detta arbete en matematisk ritning för att styra neurala nätverk mot de mest informativa delarna av ett problem, oavsett om det rör sig om chockfronter, fina svängningar eller långtidbeteenden. När vetenskapliga modeller blir större och används i säkerhetskritiska sammanhang kommer sådana principfasta strategier för att minska fel och stabilisera inlärning att vara nödvändiga för att förvandla kraftfulla neurala nätverk till tillförlitliga vetenskapliga instrument.

Citering: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Nyckelord: fysikinformerade neurala nätverk, operatorinlärning, adaptiv provtagning, vetenskaplig maskininlärning, partiella differentialekvationer