Clear Sky Science · sv

Rättviseanalys av maskininlärningsprediktioner av aggressivitet inom akutpsykiatrisk vård

Varför detta spelar roll för verkliga människor

Sjukhus vänder sig till artificiell intelligens för att upptäcka vilka patienter som kan bli aggressiva, i hopp om att förebygga skada utan att använda traumatiska tvångsåtgärder. Men om dessa prediktionsverktyg är orättvisa kan de förvärra de ojämlikheter som redan påverkar vem som uppfattas som "farlig". Denna studie ställer en angelägen fråga: när en maskin hjälper till att avgöra vem som är högrisk på en psykiatrisk avdelning, behandlar den då alla patienter lika?

Att använda sjukhusdata för att varna för kortsiktig risk

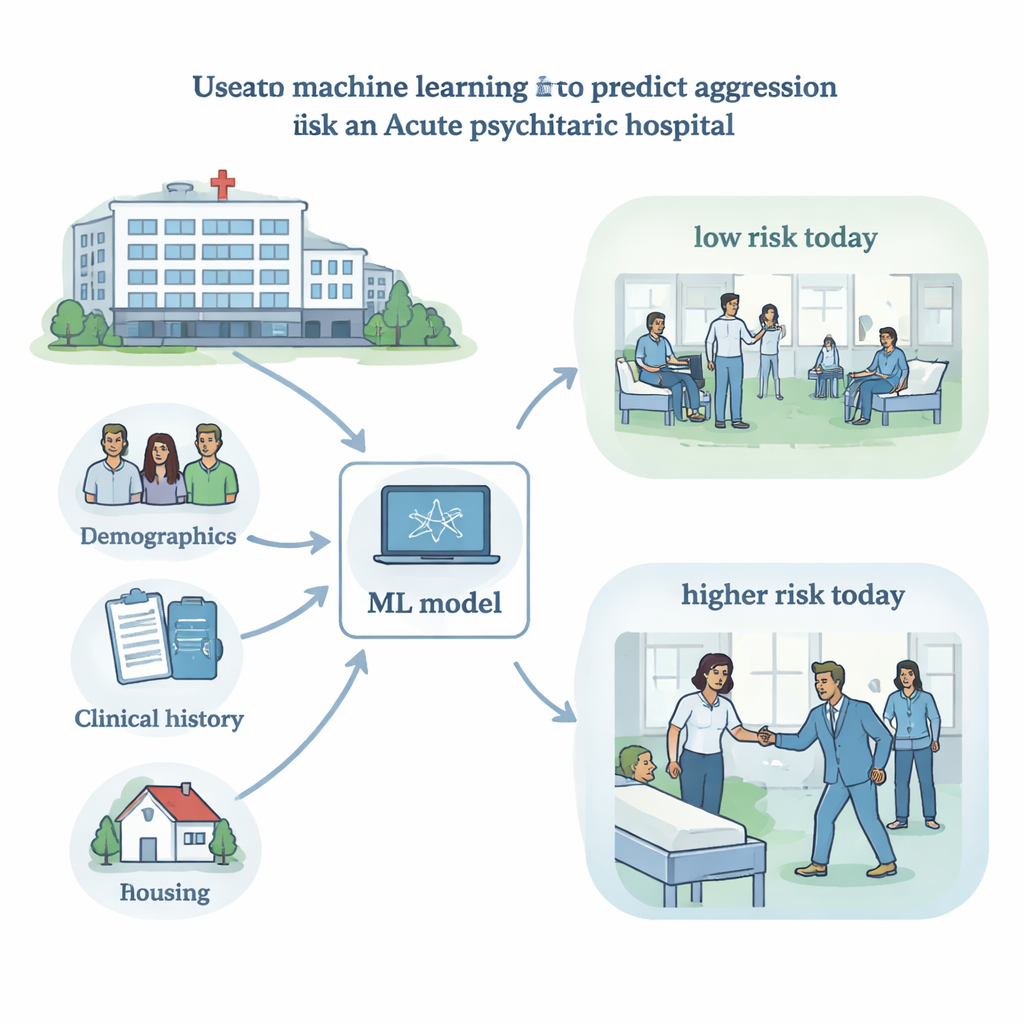

Forskare analyserade journaler från mer än 17 000 patienter som vårdats på akuta psykiatriska avdelningar vid ett stort kanadensiskt mentalsjukhus mellan 2016 och 2022. För upp till tre dagar under en sjukhusvistelse registrerade personalen en standardiserad sängkantssammanställning kallad Dynamic Appraisal of Situational Aggression (DASA), som skattar beteenden som irritation eller verbala hot som kan signalera överhängande aggression. Teamet kombinerade dessa poäng med information som samlats vid inläggning, såsom diagnos, ålder, kön, ras eller etnicitet, boendesituation och hur personen kom till sjukhuset, för att träna en maskininlärningsmodell som förutsade om patienten skulle vara inblandad i en aggressiv incident (inklusive användning av tvång eller isolering) inom de närmaste 24 timmarna.

Hur prediktionsverktyget presterade överlag

Det bäst presterande systemet använde en populär maskininlärningsmetod kallad random forest. På separata testdata rangordnade det ofta dagar efter högre risk korrekt och uppnådde en "area under the curve" på omkring 0,81, jämförbart med liknande verktyg inom psykiatrin. Aggression var dock sällsynt—det fanns ungefär 33 dagar utan incidenter för varje dag med en—så modellen missade fortfarande många verkliga händelser och genererade en del falsklarm. Viktighetsmått visade att momentlösa kliniska faktorer, särskilt DASA-poster som irritation och tidigare nyliga incidenter, bidrog starkast till förutsägelserna snarare än enbart demografi. Det betyder att modellen fångade kliniskt meningsfulla varningssignaler, men enbart prestandamått avslöjade inte om den var lika pålitlig för alla.

Ojämlika fel mellan olika grupper

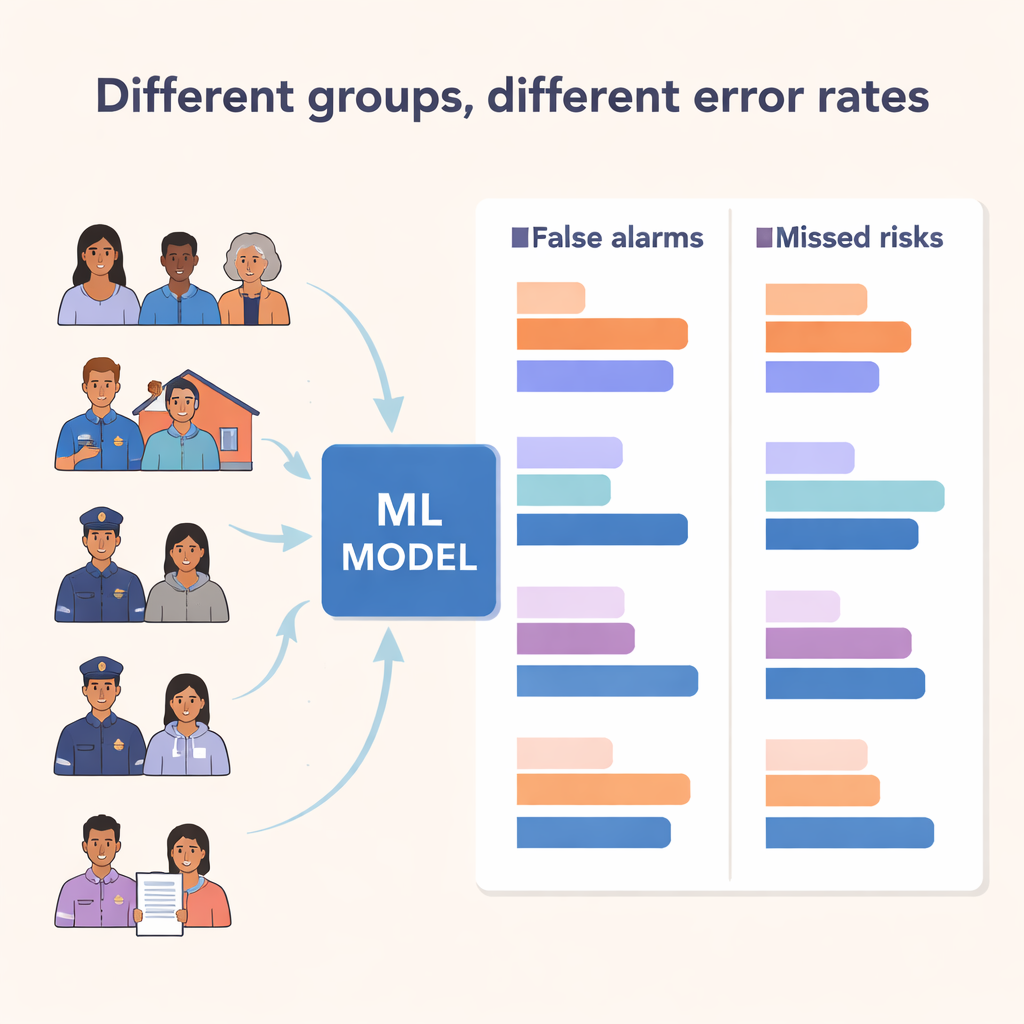

Studiens kärna var en rättvisegranskning. Teamet fokuserade på två typer av fel: falska positiva, där modellen signalerar risk men inget händer, och sanna positiva, där den korrekt förutser en incident. En rättvis modell, enligt en ofta använd standard kallad "equalized odds", bör ha liknande nivåer av falska positiva och sanna positiva över grupper. Istället fann forskarna stora skillnader. Falska positiva var högre för patienter från Mellanöstern och svarta patienter, män, personer som förts till sjukhuset av polisen samt de som saknade bostad eller bodde i stödboende. Vissa grupper—såsom patienter inlagda av polisen eller de med osäker boendesituation—hade både högre upptäcktsgrader och fler falsklarm, vilket tyder på att modellen var inställd att vara extra känslig för dem. Andra, som svarta patienter, upplevde en oroande kombination: fler falsklarm och sämre förmåga att korrekt identifiera verklig risk.

När identiteter korsas vidgas klyftorna

Eftersom människors erfarenheter formas av mer än en egenskap i taget undersökte forskarna även överlappande identiteter, särskilt kombinationen av ras eller etnicitet och kön. Här framträdde den största varningsflaggningen för mellanöstliga män, som hade den högsta andelen falska positiva av alla grupper, medan mellanöstliga kvinnor inte gjorde det. Svarta och ursprungsbefolkningens män mötte också förhöjda falska positiva jämfört med kvinnor från samma bakgrund. Dessa mönster speglar väl dokumenterade ojämlikheter inom psykiatrisk vård, som högre grad av polisinsatser, tvångsvård och felaktig diagnostik bland vissa rasifierade grupper och män. Maskininlärningssystemet skapade inte dessa ojämlikheter, men det lärde sig från data genomsyrade av dem—och riskerade att förstärka dem i kliniska beslut.

Vad detta betyder för framtida AI inom psykiatrin

Författarna menar att rättviseanalys måste behandlas som en grundläggande säkerhetskontroll, inte som ett frivilligt tillägg, innan något prediktivt verktyg tas i bruk. De noterar att tekniska "de-biasing"-metoder—såsom att justera träningsdata eller sätta olika larmtrösklar för olika grupper—kan hjälpa, men att de är begränsade om de underliggande journalerna redan speglar ojämlik behandling och tvångsmetoder. I slutändan är frågan om vad som räknas som en "rättvis" modell inte bara ett matematiskt problem; det är en social och etisk fråga som kräver insyn och medverkan från patienter, kliniker och samhällen. Denna studie visar att även om maskininlärning kan hjälpa till att identifiera kortsiktig aggressionsrisk, kan den också tyst reproducera strukturell rasism, sexism och bostadsrelaterade ojämlikheter om inte rättvisa noggrant mäts, diskuteras och åtgärdas.

Citering: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Nyckelord: algoritmisk rättvisa, psykiatrisk aggression, maskininlärning inom sjukvården, hälsoojämlikheter, riskprediktionsmodeller