Clear Sky Science · sv

Alla ögon, ingen IMU: lära sig flyghållning enbart från syn

Se som ett insekt

Små flygande robotar förlitar sig vanligtvis på pyttesmå rörelsesensorer för att hålla sig upprätta, ungefär som ett inre öra för maskiner. Men insekter klarar smidiga flygningar med långt enklare hårdvara och förlitar sig i hög grad på vad de ser. Denna studie visar att en drönare kan göra något liknande: flyga stabilt med bara en speciell typ av kamera och en kompakt artificiell hjärna, utan de vanliga rörelsesensorerna. Denna förändring kan göra framtida handflatsstora och insektsskala drönare lättare, billigare och mer robusta.

Varför ta bort de vanliga sensorerna?

Attitydkontroll—att hålla en drönare rätt lutad i förhållande till gravitationen—hanteras normalt av en ombordenhet som mäter acceleration och rotation. Dessa tröghetssensorer fungerar väl, men de lägger till vikt, förbrukar energi och kan utgöra en enda felpunkt. I kontrast har många flygande insekter ingen särskild gravitationssensor utan tolkar istället lutningen från hur världen rör sig över deras ögon. Om robotar kunde kopiera detta trick skulle mycket små flygfarkoster kanske bara behöva syn för både seende och balansering, vilket förenklar designen och gör det lättare att krympa dem till insektstorlek.

En kamera som bara ser förändring

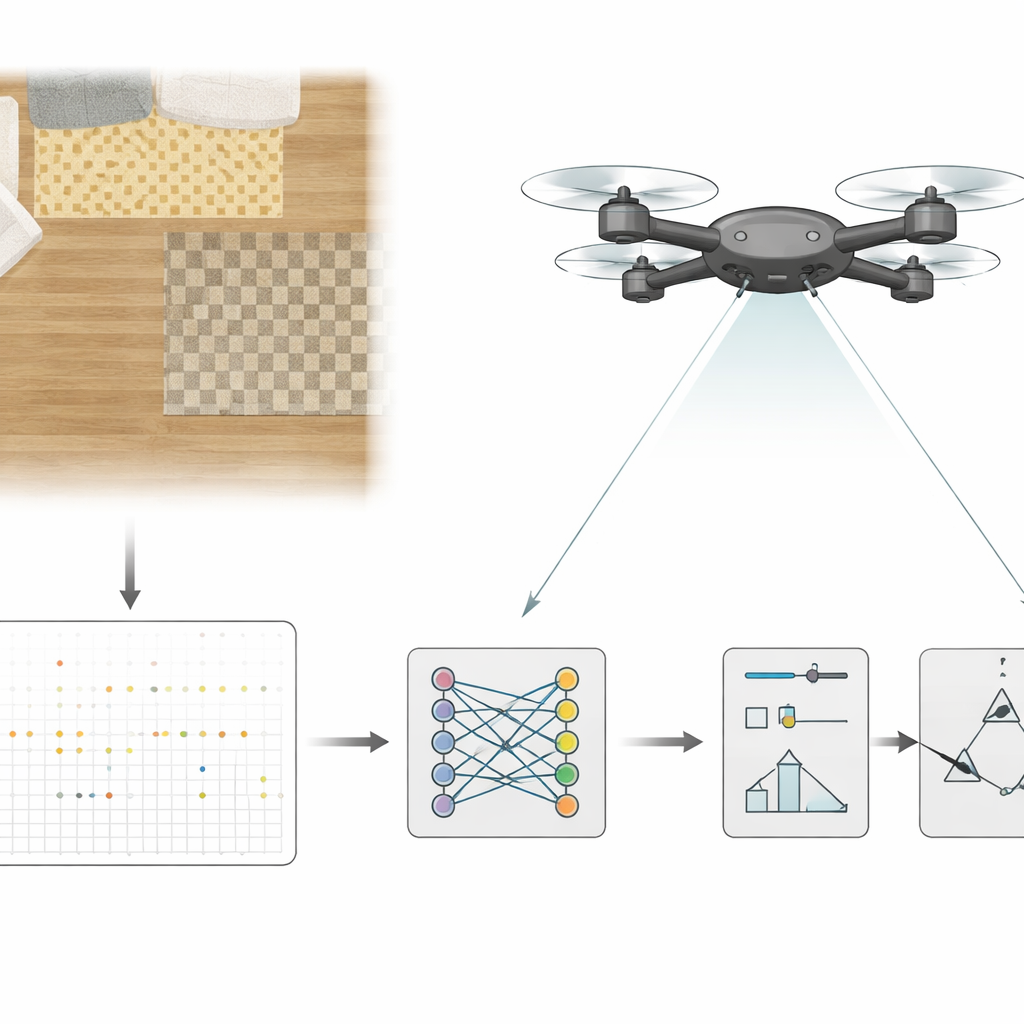

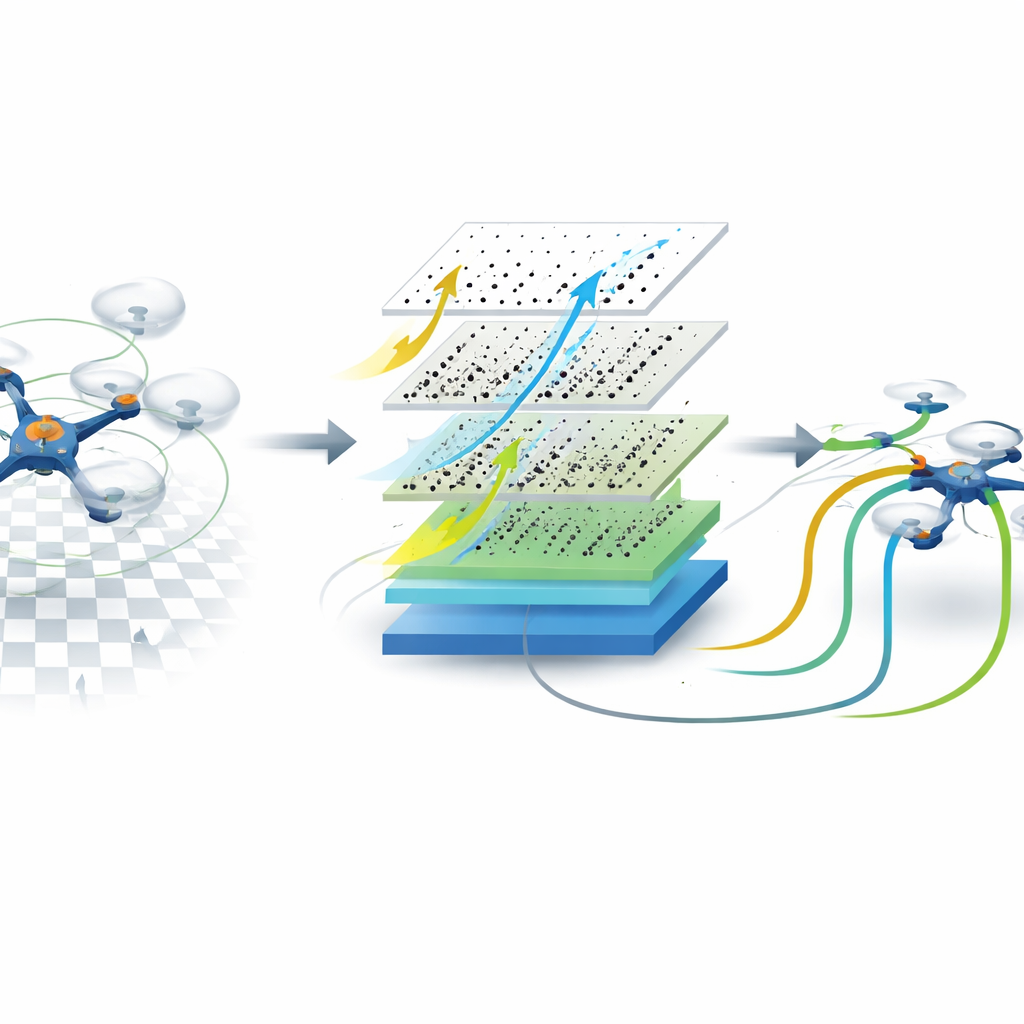

I stället för en vanlig videokamera använder forskarna en händelsebaserad kamera riktad nedåt från drönaren. Istället för att sända fullständiga bilder med fasta intervall rapporterar denna sensor endast små ljusstyrkeförändringar per pixel, och den gör det mycket snabbt. Händelseströmmen grupperas i korta skivor, var och en täckande bara fem tusendelar av en sekund, och dessa skivor matas in i ett litet återkommande konvolutionellt neuralt nätverk som körs på en ombordgrafikprocessor. Med tiden lär sig nätverket att omvandla mönster av visuell förändring till uppskattningar av drönarens lutning och hur snabbt den roterar, vilket i praktiken ersätter den traditionella rörelseenheten i styrloopen.

Lära en drönare att balansera enbart med syn

För att träna denna artificiella hjärna flög teamet först sin quadrotor i en inomhusarena medan de fortfarande använde en konventionell sensorsats. Under dessa flygningar spelade de in händelseströmmen från kameran tillsammans med lutnings- och rotationsvärden uppskattade av den standardmässiga kontrollern. De tränade sedan nätverket, under övervakning, för att reproducera dessa värden enbart från den visuella datan. I senare tester vändes rollerna: drönaren flög med nätverkets uppskattningar i styrloopen, medan oberoende rörelsefångst eller ombordmätningar endast användes för att mäta hur väl det gick. Systemet höll drönaren hovrande och följde pilotkommanderade banor i flera minuter åt gången, med de flesta lutningsfel inom några graders marginal och rotationsfel inom måttliga gränser, tillräckligt för stabil flygning.

Inblick i den inlärda visuella förmågan

Forskarna undersökte vad som gör denna syn‑endast‑kontroll mest effektiv. De jämförde olika nätverksarkitekturer, lade till eller tog bort extra insignaler såsom motorhastigheter eller gyrodata, och varierade hur mycket av kamerans synfält som användes. Nätverk med minne—som kan integrera visuell information över tid—var avgörande för att noggrant följa snabba rotationer, medan minneslösa versioner hade svårt. Ett brett synfält, som exponerar avlägsna horisontliknande ledtrådar vid bildens kanter, gav de lägsta rena felen i välbekanta scener. Överraskande nog gjorde det dock att tvinga nätverket att bara titta på den centrala delen av bilden, där sådana statiska ledtrådar saknas, att det i större utsträckning förlitade sig på rörelsemönster istället för scenens utseende. Även om detta minskade den absoluta noggrannheten förbättrade det hur smidigt systemet anpassade sig när det flyttades till mycket olika miljöer, vilket tyder på att ett internt rörelsesinne hade lärts in.

Mot små, syn‑först flygande robotar

Sammanfattningsvis visar arbetet att en drönare kan hålla sig upprätt och kontrollerbar med bara det den ser, utan någon tröghetssensor i loopen. Genom att para en händelsekamera med ett kompakt neuralt nätverk når systemet den hastighet och reaktivitet som krävs för realtidskontroll samtidigt som hårdvaruvikt och komplexitet reduceras. För vanliga läsare är huvudbudskapet att framtida svärmar av små, insektliknande flygande robotar kan balansera och navigera med ett enda smart öga, precis som insekter gör, vilket öppnar dörren för lättare, mer energieffektiva maskiner som säkert kan utforska trånga, oförutsägbara utrymmen.

Citering: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Nyckelord: visionsbaserad flygkontroll, evenemangskamera-dronor, bioinspirerad robotik, neuronätverkskontroller, insektsskala UAV:er