Clear Sky Science · sv

Språkton kodas hierarkiskt i den högra ventrala banan

Hur din hjärna hör frågor och påståenden

När någon säger ”Du går?” jämfört med ”Du går.” hör du omedelbart det ena som en fråga och det andra som ett påstående—även om orden är identiska. Det som förändras är röstens melodi, särskilt tonhöjdens stigning och fall. Denna artikel avslöjar hur hjärnan omvandlar dessa tonmönster till tydliga, meningsbärande kategorier som ”fråga” eller ”påstående” och visar att den processen utvecklas i en bestämd sekvens över höger hjärnhalva.

Röstmelodin som bär betydelse

Talat språk är mer än konsonanter och vokaler. En viktig komponent är röstens fundamentalfrekvens, ofta kallad f0, som vi upplever som tonhöjd. f0:s nivå hjälper oss att skilja talare åt (till exempel manliga kontra kvinnliga röster), medan hur f0 stiger eller faller i en sats signalerar satsens typ. En slutlig uppåtgående ton tenderar att markera en ja–nej-fråga; ett slutligt fall markerar ett påstående. I den här studien lyssnade försökspersoner på korta franska ord vars tonmönster noggrant morphats längs ett kontinuum från tydligt ”påstående-likt” till tydligt ”fråga-likt”, samtidigt som deras hjärnaktivitet mättes med magnetoencefalografi (MEG), en teknik som spårar snabbt föränderliga hjärnsignaler.

Från rått ljud till stabila kategorier

Forskarna undrade om hjärnan behandlar dessa tonkännetecken som råa akustiska detaljer eller som stabila, högre nivåns kategorier. Beteendemässigt agerade människor som om de hörde två skarpa sats-typer: de märkte konsekvent ljuden som frågor eller påståenden och bortsåg till stor del från skillnader i exakt tonform och i talarens röst. I hjärnan innehöll tidiga aktivitetsmönster fortfarande rik information om både vem som talade och hur tonen förändrades. Men med tiden blev senare aktivitetsmönster mindre känsliga för dessa ytdetaljer och speglade istället bara sats-typen—vilket återspeglar det ”allt-eller-inget”-sätt på vilket människor slutligen bedömde ljuden.

En högersidig bana för språklig ton

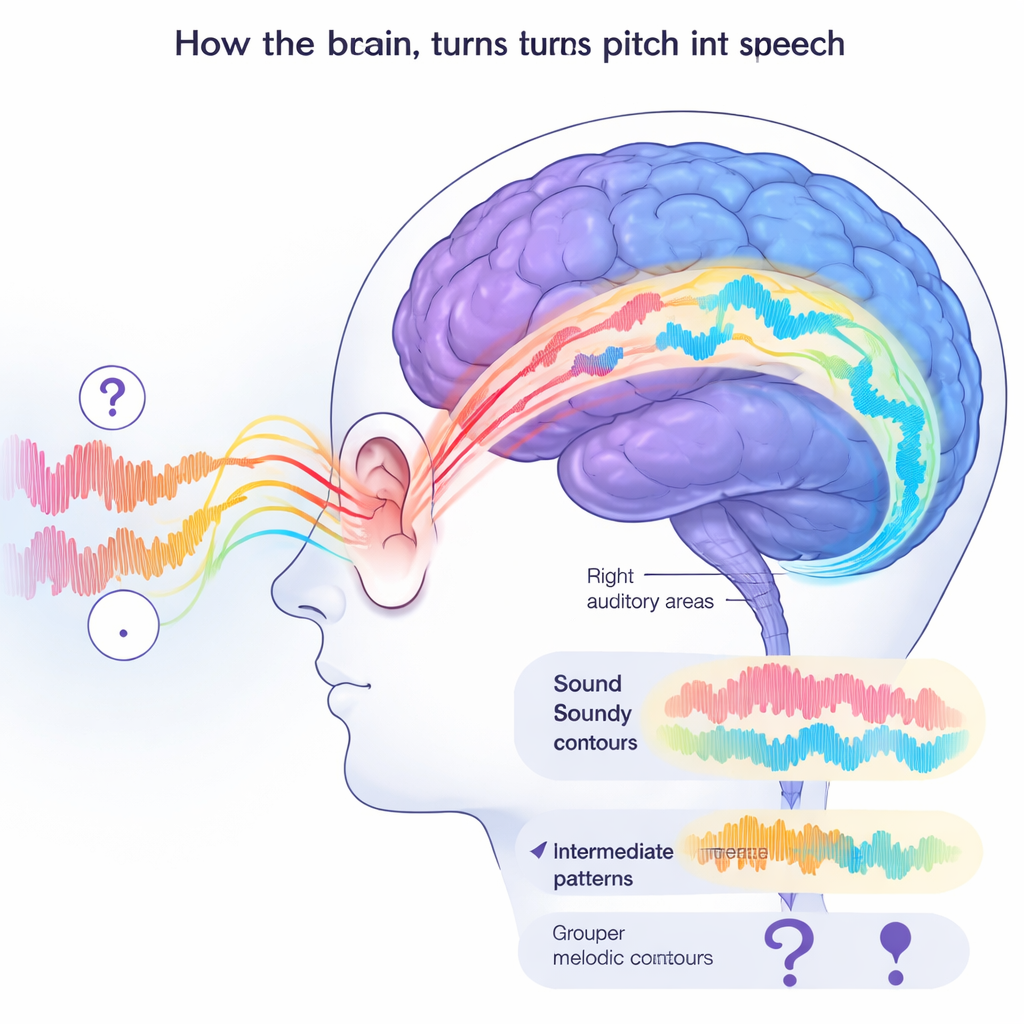

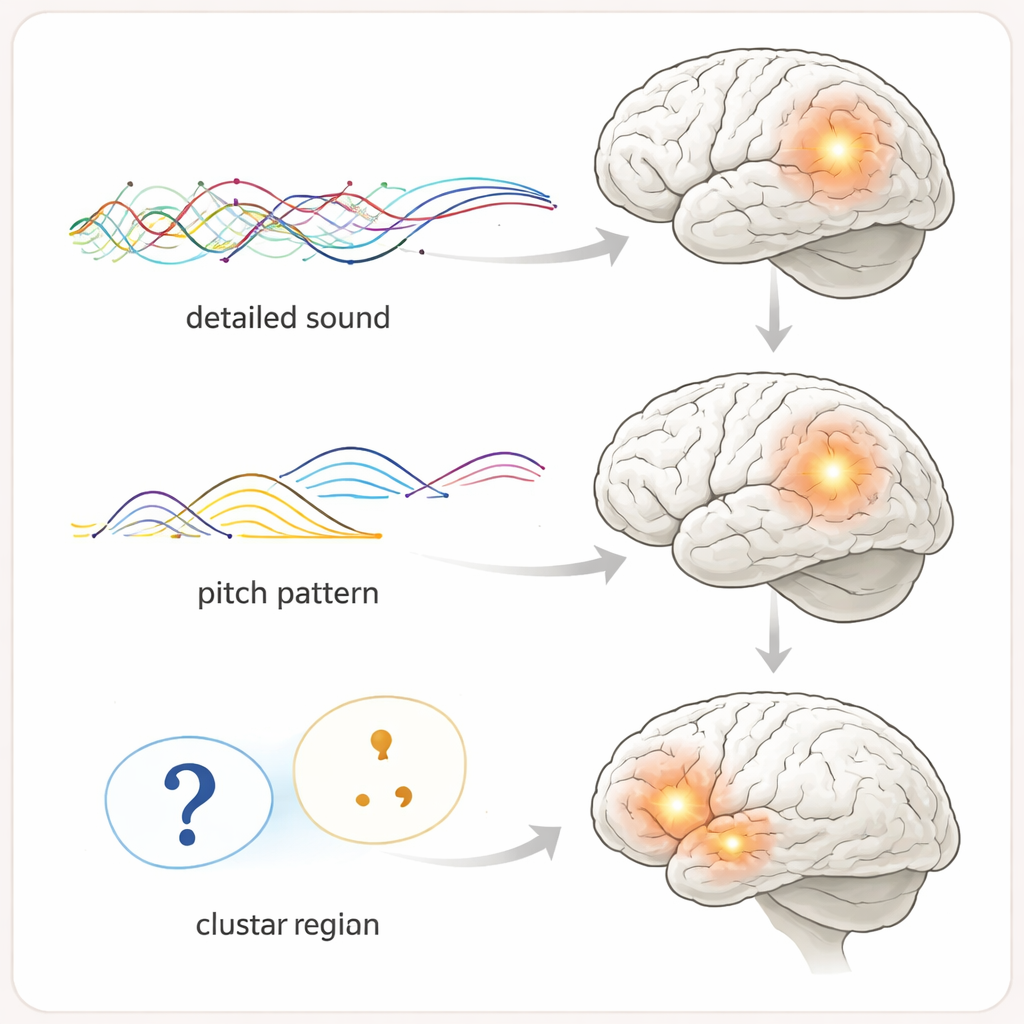

För att kartlägga var dessa olika stadier uppstår följde teamet aktiviteten bakåt in i hjärnan. De fann att tidiga representationer av ton finns i högra auditiva områden nära örat, som troget spårar både tonhöjdens nivå och dess detaljerade kontur. Något senare och längre fram längs högra superiora temporala gyrus bär hjärnan en mer strömlinjeformad representation där information om talarens typiska ton har avlägsnats, medan det övergripande stigande eller fallande mönstret bevaras. Längst fram längs denna bana, i ännu mer anteriora högra temporala regioner, reflekterar hjärnans aktivitet enbart den abstrakta kategorin—”detta låter som en fråga” kontra ”detta låter som ett påstående”—oavsett vilken talare som producerade det. En motsvarande region på vänster sida, djupt inne i frontala och insulära områden, bär också dessa abstrakta kategorier, nära knutet till själva beslutsfattandet.

Samband mellan hjärnmönster och val

Studien gick längre och frågade hur ”formen” av dessa hjärnrepresentationer relaterar till vad människor faktiskt gör. Med matematiska verktyg som jämför mönster av hjärnsvar över olika ljud visade författarna att endast den anteriora högra temporala regionen tydligt grupperade ihop alla fråga-liknande ljud och skiljde dem från påstående-liknande ljud, oberoende av talaren. Personer vars hjärnor gjorde denna åtskillnad tydligt presterade bättre i uppgiften: de kategoriserade mer korrekt och visade skarpare övergångar mellan ”fråga” och ”påstående” i sina svar. I vänster frontala–insulära områden spårade styrkan i dessa abstrakta tonkategorier hur snabbt hjärnan kunde ackumulera tillräcklig evidens för att bestämma sig, enligt en beslutsmodell som förenar både snabbhet och noggrannhet.

Lagarbete över hemisfärerna

Forskarna undersökte också hur dessa hjärnområden kommunicerar med varandra över tid. De fann snabb, högfrekvent kommunikation från den anteriora högra temporala regionen till den vänstra frontala–insulära regionen sent i varje försök, som om en färdig ”sats-typ”-signal vidarebefordrades till en beslutshubb. Långsammare rytmisk samordning från vänster frontala–insulära område till en region involverad i planering av rörelser på högra sidan antydde att beslutsrelaterad information skickades till system som förbereder knapptryckningar som används för att rapportera svar. Tillsammans visar dessa interaktioner att förståelsen av talets melodi inte är begränsad till en bit cortex, utan uppstår ur en dynamisk konversation mellan högersidiga tonprocessorer och vänstersidiga beslutskretsar.

Varför detta betyder något för vardagligt lyssnande

För icke-specialister är huvudbudskapet enkelt: din hjärna använder en högersidig bana för att skala bort talets röriga ton-detaljer—vem som talar, exakt hur deras röst svajar—för att nå fram till rena, pålitliga kategorier som ”fråga” och ”påstående.” Dessa abstrakta tonrepresentationer är inte bara teoretiska konstruktioner; deras tydlighet förutsäger hur väl och hur snabbt du kan skilja sats-typer åt. Arbetet antyder att subtila svårigheter i denna bana kan påverka hur människor tolkar röstens ton, och det ger en karta för att studera hur ton behandlas i mer naturliga samtal, i andra språk och i kliniska tillstånd som förändrar taluppfattningen.

Citering: Oderbolz, C., Orpella, J. & Meyer, M. Linguistic pitch is hierarchically encoded in the right ventral stream. Commun Biol 9, 267 (2026). https://doi.org/10.1038/s42003-026-09545-7

Nyckelord: taluppfattning, tonhöjd, prosodi, auditiv cortex, hjärnnätverk