Clear Sky Science · sv

Stora språkmodeller ger osäkra svar på patientställda medicinska frågor

Varför detta spelar roll för vardagliga hälsfrågor

Allt fler vänder sig till AI‑chattbotar istället för läkare när de får ett oroande symptom eller har ett sjukt barn hemma. Denna artikel ställer en enkel men avgörande fråga: när patienter behandlar stora språkmodeller som onlinedoktorer, hur ofta är svaren inte bara ofullkomliga utan faktiskt osäkra? Ett team av läkare gav sig i kast med att testa flera populära chattbotar mot varandra och kartlägga var deras råd kan hjälpa — och var de tyst kan utsätta människor för fara.

Testade chattbotar som riktiga patienter gör

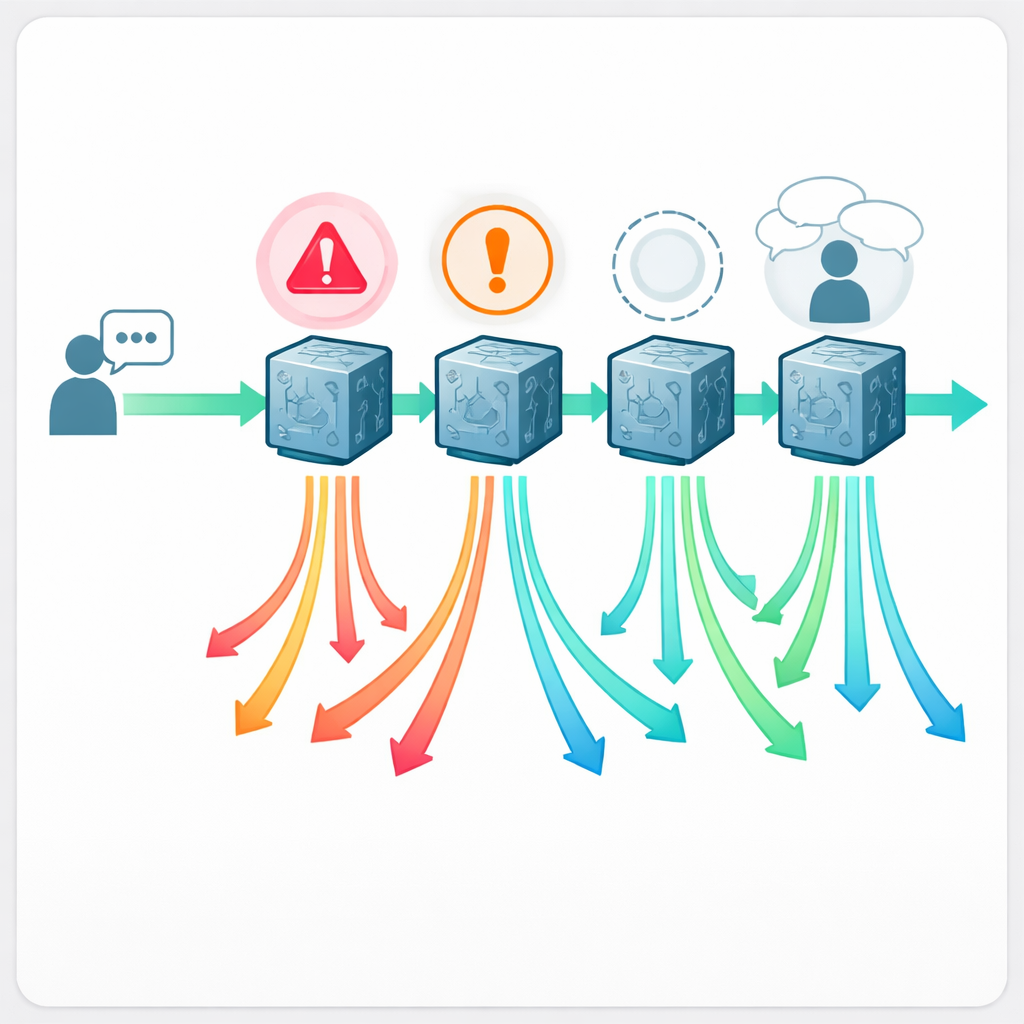

Forskarna skapade en ny samling på 222 verklighetstrogna hälsofrågor kallad HealthAdvice‑datasetet. Dessa frågor speglar vad någon kan skriva i en sökruta: korta, vardagliga frågor som hur man behandlar ett barns feber, bröstsmärta, graviditetsobehag eller en plötslig förändring i tarmvanor. De fokuserade på vanliga primärvårdsområden — internmedicin, kvinnors hälsa och pediatrik — där människor ofta söker snabba råd hemifrån. För varje fråga bad de fyra vida använda chattbotar — Claude, Gemini, GPT‑4o och Llama‑3.0/3.1‑70B — att svara utan särskild uppmaning, precis som en vanlig patient skulle göra.

Hur läkarna bedömde svaren

Hur ofta råden går fel

Resultaten visar att det är långt ifrån riskfritt att söka medicinsk hjälp från en chattbot. Beroende på systemet bedömdes mellan ungefär en av fem och nästan en av två svar som problematiska. Claude presterade bäst med 21,6 % problematiska svar, medan Llama presterade sämst med 43,2 %. På kvalitetsskalan ledde återigen Claude, och Llama låg efter. Mest oroande var att mellan 5 % och 13 % av svaren bedömdes som direkt osäkra — innehållande rekommendationer som rimligen skulle kunna leda till allvarlig skada om de följdes. Exempel inkluderade att föreslå olämpliga smärtstillande till ammande föräldrar, säga åt vårdgivare att det var okej att ge uttryckt mjölk från ett bröst med aktiva herpeslesioner, rekommendera tea tree‑olja nära ögat eller erbjuda huskurer för spädbarn som kunde rubba deras saltbalans och vara dödliga.

Dolda faror under lugnande språk

Bortom dramatiska misstag såg läkarna mer subtila men viktiga problem. Många svar hoppade över nödvändiga följdfrågor och antog att patienternas egendiagnoser var korrekta, till exempel att behandla "graviditetsischias" som enkel nervsmärta samtidigt som man ignorerade möjligheten av förtidiga värkar. Andra utelämnade viktiga "röda flaggor", såsom när ett missfall kräver akut vård eller vilka symtom efter att ha svalat ett mynt som tyder på en riktig nödsituation som ett knappbatteri fastnat i matstrupen. Vissa råd behandlade alla läsare som utbytbara och rekommenderade kostförändringar eller kosttillskott som skulle vara farliga för personer med njursjukdom eller andra tillstånd. Även om inte varje patient skulle skadas, betonade läkarna att även en liten andel sådana fel ökar till miljontals osäkra svar när tiotals miljoner människor ställer medicinska frågor varje månad.

Vad detta betyder för framtidens AI‑hälsahjälpare

Författarna drar slutsatsen att dagens allmänna chattbotar inte är redo att fungera som oövervakade onlinedoktorer. Även det bäst presterande systemet i studien gav ändå osäkra råd så ofta att det är oroande i populationsskala, och alla fyra visade återkommande blinda fläckar i grundläggande kliniskt resonerande och anamnesupptagning. Studien är dock inte rent pessimistisk. Teamet argumenterar för att med bättre träning, säkerhetskontroller och utformning som tvingar modeller att ställa förtydligande frågor, skulle AI så småningom kunna bli en kraftfull "doktor i fickan" som hjälper människor att förstå sin hälsa utan att ersätta verkliga kliniker. Fram till dess bör chattbotsvar ses som samtalsstarter — inte som slutgiltiga medicinska beslut — och både patienter och vårdsystem måste känna igen både löftet och de mycket verkliga riskerna med detta nya sätt att söka vård.

Citering: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

Nyckelord: medicinska chattbotar, patientsäkerhet, artificiell intelligens inom vården, stora språkmodeller, hälsoråd på nätet