Clear Sky Science · sv

Anatomi-styrd visuell promptjustering för tvärmodal förståelse av bröstcancer

Smartare screening för en vanlig cancer

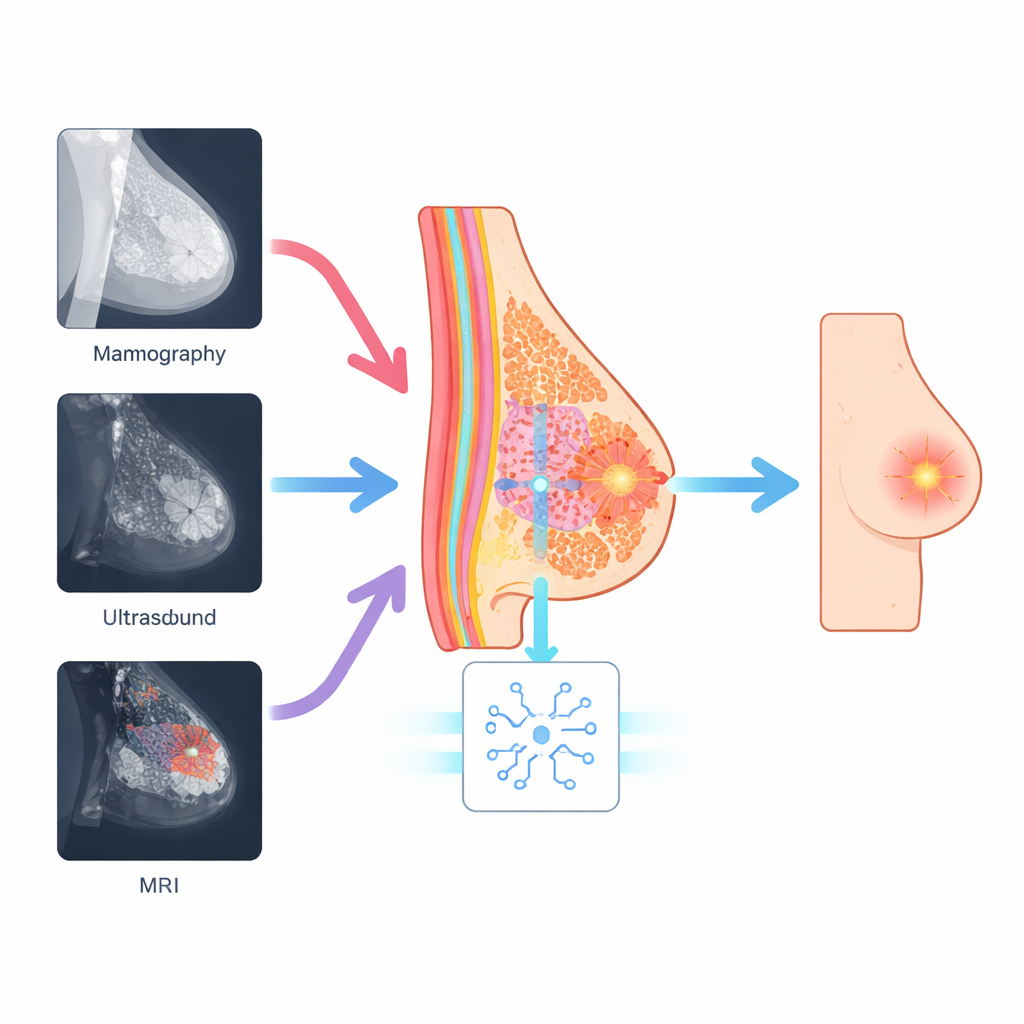

Bröstcancer är en av de ledande orsakerna till cancerrelaterad dödlighet hos kvinnor, och läkare förlitar sig i allt större utsträckning på datorprogram för att hjälpa till att tolka komplexa medicinska bilder. Men mammografier, ultraljud och MRI visar bröstet på mycket olika sätt, vilket gör det svårt för nuvarande artificiella intelligenssystem att förbli tillförlitliga över olika maskiner och sjukhus. Denna studie presenterar ett nytt AI‑anslag som "tänker" kring den underliggande bröstanatomien i stället för att bara använda ljushetsmönster i varje bild, vilket leder till mer precisa och mer konsekventa upptäckter av misstänkta områden.

Varför olika skannrar förvirrar datorer

Mammografi, ultraljud och MRI använder var och en olika fysikaliska principer för att avbilda bröstet. En cancer som syns som ett ljust korn på en ultraljudsbild kan framträda som en svag skugga på en mammografi eller som ett lysande område på MRI. Många moderna AI‑system, inklusive kraftfulla vision‑transformers och vision–språkmodeller, lär sig i hög grad av det övergripande bildutseendet. De missar ofta små men viktiga detaljer som mikrokalcifikationer eller oregelbundna kanter, och deras prestanda kan falla kraftigt när de flyttas från en typ av skanner eller sjukhus till en annan. Detta gap mellan träningsvillkor och verkliga kliniska miljöer har begränsat vilken tillit läkare kan ha till sådana verktyg.

Använda bröstet självt som vägledning

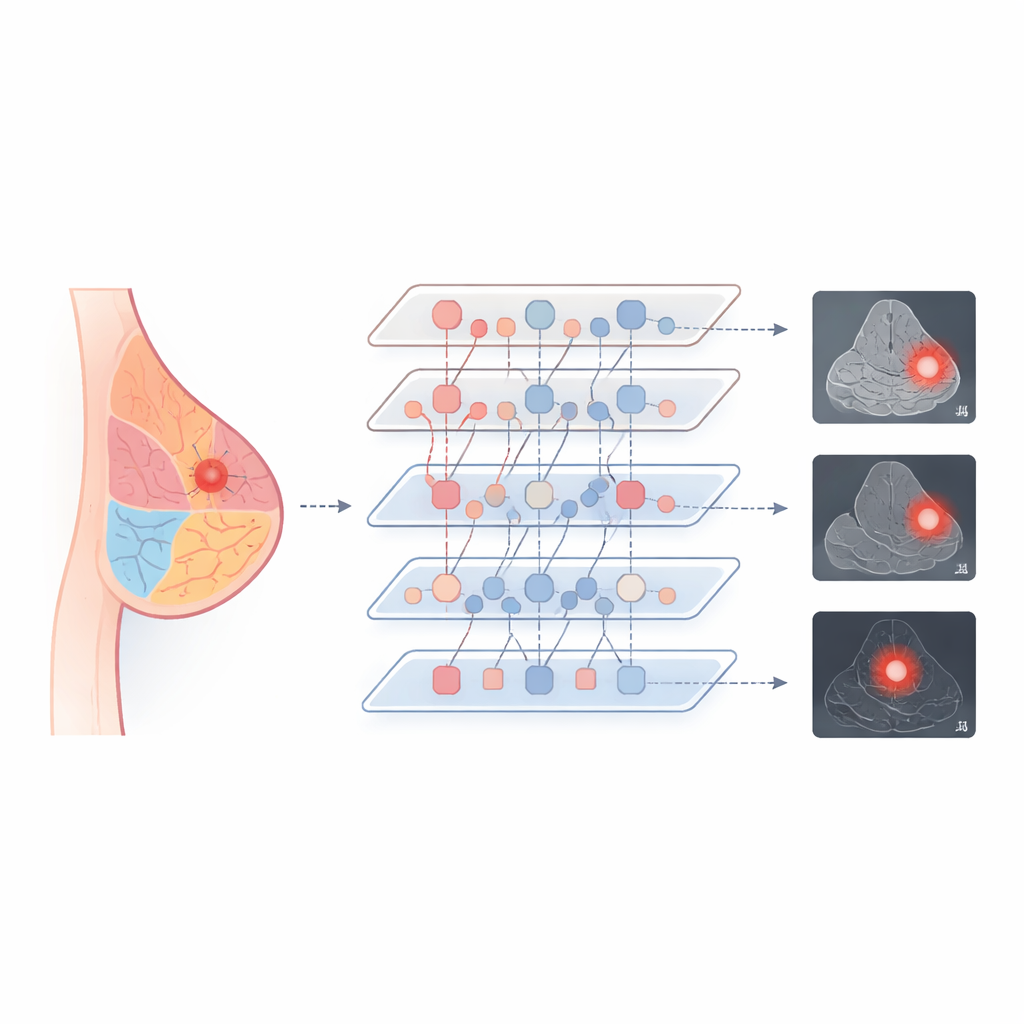

Forskarna menar att även om bilderna ser olika ut så förändras inte bröstets biologiska uppbyggnad mellan skanningar. Varje bild innehåller fortfarande körtelvävnad, fett och duktala strukturer ordnade i ett igenkännbart mönster. Deras metod, kallad Anatomy‑Guided Visual Prompt Tuning (A‑VPT), bygger in denna grundläggande karta över bröstet direkt i AI‑modellen. I stället för att justera miljontals interna vikter lägger systemet till en liten uppsättning extra "prompt"‑signaler som talar om för nätverket vilka vävnadsregioner det betraktar. Dessa prompts genereras från grova anatomiska kartor eller inlärda vävnadssignaler och injiceras sedan lager för lager i en fryst, förtränad transformer. I praktiken påminns modellen ständigt om var gångar, körtlar och fett finns, så att den kan bedöma misstänkta områden i rätt kontext.

Lära ett system att tala många avbildningsspråk

För att få modellen att fungera över avbildningstyper utformade teamet ett träningsschema som tvingar AI att behandla liknande vävnader lika, oavsett hur de avbildas. De alignerar de interna fingeravtrycken för feta, körtel- och duktala regioner tagna från mammografi, ultraljud och MRI och för dem närmare varandra i ett delat rum. Där textliga rapporter finns kopplar systemet också dessa vävnadsmönster till korta beskrivande fraser, vilket knyter visuella egenskaper till medicinskt språk. Under bearbetning tillåter specialiserade interaktionsmoduler att anatomiprompts och bildfunktioner utbyter information i båda riktningarna, med ett grindsteg som styr hur starkt anatomin påverkar varje lager. Denna kombination hjälper modellen att fokusera på rätt strukturer samtidigt som den förblir stabil och effektiv.

Bättre noggrannhet med en lättare beröring

Författarna testade A‑VPT på tre välkända bröstavbildningsdatabaser som täcker alla tre modaliteter. Jämfört med traditionella djupa nätverk och flera populära sätt att finjustera stora modeller uppnådde deras metod de högsta poängen för både klassificering av lesioner som godartade eller elakartade och för att avgränsa deras gränser. Den presterade särskilt väl när den ombads använda kunskap från en skannertyp för att tolka en annan—till exempel träning på mammografier och sedan utvärdering på ultraljud—där äldre metoder ofta fick problem. Slående nog nådde A‑VPT dessa resultat samtidigt som den uppdaterade mindre än 2 % av modellens parametrar, vilket minskar beräkningsbehovet och gör det lättare att distribuera i riktiga sjukhus. Visualiseringar av var modellen "tittade" visade att den koncentrerade sig på realistiska körtelområden och peritumorala regioner, vilket tyder på att dess beslut överensstämmer med radiologers resonemang.

Vad detta betyder för patienter och kliniker

Kort sagt visar detta arbete att det kan göra AI‑system både smartare och mer begripliga att lära dem grundläggande anatomi. Genom att förankra sitt resonemang i bröstets verkliga struktur är A‑VPT bättre på att upptäcka och avgränsa tumörer över olika avbildningsmetoder, med färre justeringar och mer genomskinligt beteende. Om metoden valideras vidare kan denna strategi stödja mer konsekvent screening och diagnos i skiftande miljöer, från stora medicinska centra till mindre kliniker, och kan utvidgas till andra organ såsom lunga eller lever. I slutändan kan anatomi‑medveten AI bli en viktig partner för tidigare och mer pålitlig cancerupptäckt.

Citering: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Nyckelord: bröstcanceravbildning, medicinsk AI, vision-transformers, tvärmodal inlärning, anatomi-styrda prompts