Clear Sky Science · sv

Oberoende och samarbetsinriktad prestanda hos stora språkmodeller och vårdpersonal vid diagnos och triage

Varför detta spelar roll inför ditt nästa läkarbesök

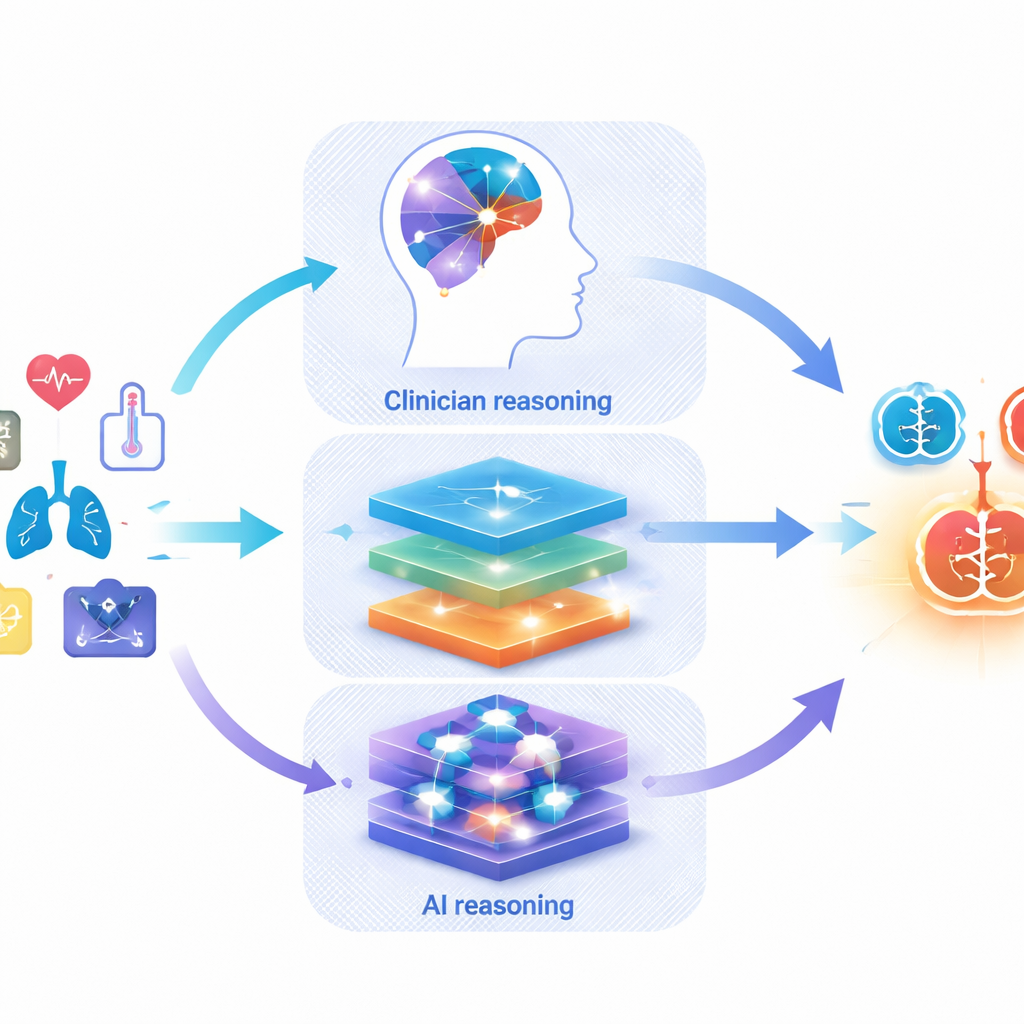

När du skriver in dina symptom i en nätchattbot eller frågar en AI-app vad som kan vara fel använder du samma typ av teknik som läkare nu testar på sjukhus: stora språkmodeller, eller LLM:er. Denna studie ställer en enkel men avgörande fråga: hur väl diagnostiserar dessa verktyg faktiskt sjukdom och avgör hur brådskande ett fall är, jämfört med verkliga vårdprofessionella — och vad händer när de två arbetar tillsammans?

Hur forskarna tog ett helhetsperspektiv

Författarna testade inte en enda chattbot i en klinik. Istället kombinerade de bevis från 50 separata studier genomförda runt om i världen mellan 2020 och 2025. Dessa studier täckte många specialiteter, från ögonsjukdomar och hjärnavbildning till akutsjukvård. I varje studie gavs läkare och en eller flera LLM:er samma beskrivningar av verkliga eller noggrant utformade patientfall. LLM:erna fick föreslå möjliga diagnoser eller avgöra hur snabbt en patient behövde vård, medan läkarna gjorde samma sak. I vissa studier visades även AI:ns förslag för läkarna för att se om detta förbättrade deras prestation.

Hur bra är AI-systemen på egen hand?

I de sammanlagda studierna kunde AI-verktygen ofta placera rätt diagnos någonstans på sin lista, men de låg ändå vanligtvis efter läkare när de tvingades välja endast ett svar. När bara toppgissningen räknades var LLM:erna i genomsnitt omkring 11 % mindre träffsäkra än vårdpersonal. När listan över tillåtna gissningar blev längre krympte skillnaden och försvann så småningom — när upp till tio möjliga diagnoser tilläts var AI-systemen åtminstone lika benägna som läkare att inkludera den korrekta. För triagebeslut — att bedöma hur brådskande ett fall var och vilken vårdnivå som behövdes — presterade AI och människor likartat i stort. Resultaten varierade dock kraftigt mellan enskilda modeller och testupplägg, vilket antyder att vissa verktyg är mycket mer pålitliga än andra.

Vad händer när läkare använder AI som lagkamrat?

Nio studier undersökte direkt samarbete: läkare arbetade först ensamma och upprepade sedan uppgiften med hjälp av en LLM. Här var nyheterna uppmuntrande. När de stödde sig på AI blev läkarna i genomsnitt mer träffsäkra, särskilt när de fick ange flera möjliga diagnoser. Till exempel förbättrades deras träffsäkerhet för korta kandidatlistor med omkring 10–40 %, beroende på hur många alternativ som beaktades. Det tyder på att AI är särskilt användbart som en idégivare som breddar uppsättningen möjliga förklaringar och får kliniker att överväga mindre uppenbara tillstånd, medan den mänskliga experten fortfarande fattar det slutgiltiga beslutet.

Varför dagens resultat kan se bättre ut än verkligheten

Trots att siffrorna låter lovande varnar författarna för att de flesta befintliga studier är långt ifrån perfekta. Många använde prydliga, läroboksaktiga fallbeskrivningar eller sällsynta fall valda för undervisning, inte de röriga, ofullständiga berättelser som patienter presenterar i verkliga kliniker. Endast ett fåtal studier använde patienter i realtid. Uppgifter om hur fallen valdes ut, hur AI-verktygen konfigurerades och hur svaren bedömdes saknades ofta. Visuell information såsom skanningar eller hudfoton användes mer sällan, och när enbart bilder testades presterade erfarna kliniker tydligt bättre än AI. Forskarna betonar också att juniora kliniker och experter kan reagera olika på AI-råd, samt att frågor som datasekretess, dold partiskhet och övertillit till maskinförslag till stor del är otritade i vardaglig praktik.

Vad detta betyder för patienter och vårdens framtid

Sammanfattningsvis tyder studien på att dagens chattbotar och LLM:er inte är redo att ersätta din läkare, men de kan snart bli värdefulla assistenter. Använda klokt kan de hjälpa till att generera bredare listor av möjliga diagnoser och stödja mer träffsäkra beslut, särskilt när läkare behåller kontrollen och ser AI som en second opinion snarare än en slutgiltig dom. Innan dessa verktyg vävs in i rutinvård menar författarna att vi behöver bättre utformade, verklighetsnära prövningar, tydligare rapporteringsstandarder och starka skydd kring säkerhet, rättvisa och integritet. För patienter innebär detta att AI så småningom kan hjälpa ditt vårdteam att tänka bredare och agera snabbare, men att ett förtroendefullt system måste testas lika rigoröst som ett nytt läkemedel eller medicintekniskt hjälpmedel.

Citering: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Nyckelord: medicinsk diagnostik AI, klinisk triage, stora språkmodeller, läkare AI-samarbete, digital hälsosäkerhet