Clear Sky Science · sv

Människa–stora språkmodeller i klinisk medicin: en systematisk översikt och metaanalys

Varför detta är viktigt för vardaglig vård

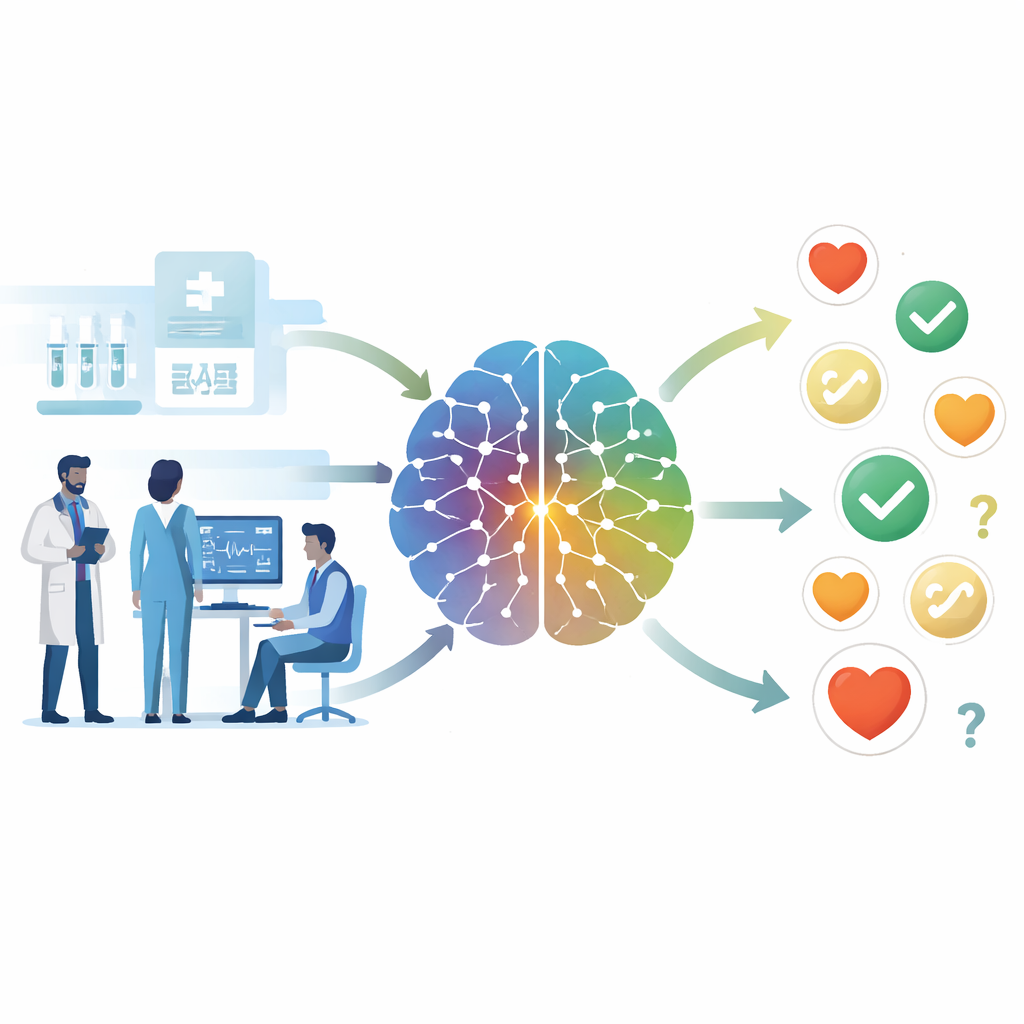

Läkare vänder sig allt oftare till kraftfulla AI-chattrobotar, så kallade stora språkmodeller, för att hjälpa dem att analysera komplicerade fall, skriva journalanteckningar och tolka medicinska tester. Denna studie ställer en enkel men avgörande fråga: när läkare samarbetar med dessa verktyg, får patienterna verkligen nytta av det? Genom att sammanföra resultat från de bästa tillgängliga prövningarna visar författarna att svaret är mer nyanserat än vad hypen antyder – ibland hjälper samarbetet, ibland gör det liten skillnad och i några situationer kan det till och med vara ett hinder.

Vad forskarna undersökte

Teamet sökte systematiskt i stora medicinska databaser efter studier där kliniker arbetade antingen med eller utan hjälp av ett AI-system baserat på stora språkmodeller som GPT-4. För att inkluderas måste en studie jämföra en ”läkare plus AI”-arbetsflöde direkt mot sedvanlig vård av enbart läkare, och ibland även mot AI:n som arbetade ensam. De kliniska uppgifterna spände över en rad verkliga problem: att bedöma vad som kan vara fel med en kritiskt sjuk patient, tolka hjärnavbildningar, skriva och läsa mottagningsanteckningar samt avgöra hur bröstsmärta och andra vanliga symtom ska hanteras. Totalt utgjorde 10 peer‑reviewade prövningar ryggraden i analysen, med några extra preprints som användes endast för att kontrollera hur robusta slutsatserna var.

Hur väl presterade läkare–AI‑teamet

I dessa studier visade parningen av läkare med AI små men märkbara förbättringar i vissa mått på diagnostik och vårdhantering. I två randomiserade prövningar som använde detaljerade poängsystem för beslutsfattande fick läkare–AI‑teamet ungefär fem procentenheter högre poäng än enbart läkare. Enkelt uttryckt: om läkare som arbetade ensamma gjorde cirka 100 viktiga beslut, kan tillsats av AI potentiellt förhindra att ungefär fem av dessa beslut blir felaktiga. Författarna betonar dock att underliggande data är tunna: endast ett par prövningar bidrog till dessa skattningar, och spannet av rimliga resultat i verkliga världen är så brett att det kan inkludera ingen nytta – eller till och med skada – i andra sammanhang.

Hastighet, dokumentation och dolda fel

Många hoppas att AI ska frigöra läkarnas tid. Här var bevisen otillfredsställande. När forskarna kombinerade tre prövningar som mätte hur lång tid uppgifterna tog fann de i princip ingen total tidsbesparing. I vissa simulerade övningar var läkare något snabbare med AI; i en studie i en verklig klinik var nettot på besökstid nära noll, även om vissa undergrupper såg måttliga fördelar. Dokumentationen berättade en liknande ”blandad” historia. AI-assistans gjorde ofta anteckningar tydligare och mer strukturerade, och hjälpte icke‑specialister att bättre förstå tekniska ögonvårdsrapporter. Men när forskarna kontrollerade fakta fann de att ungefär en av tre AI‑stödda anteckningar fortfarande innehöll misstag. Denna spricka – mer lättlästa poster som ändå kan vara felaktiga – väcker klart säkerhetsoro.

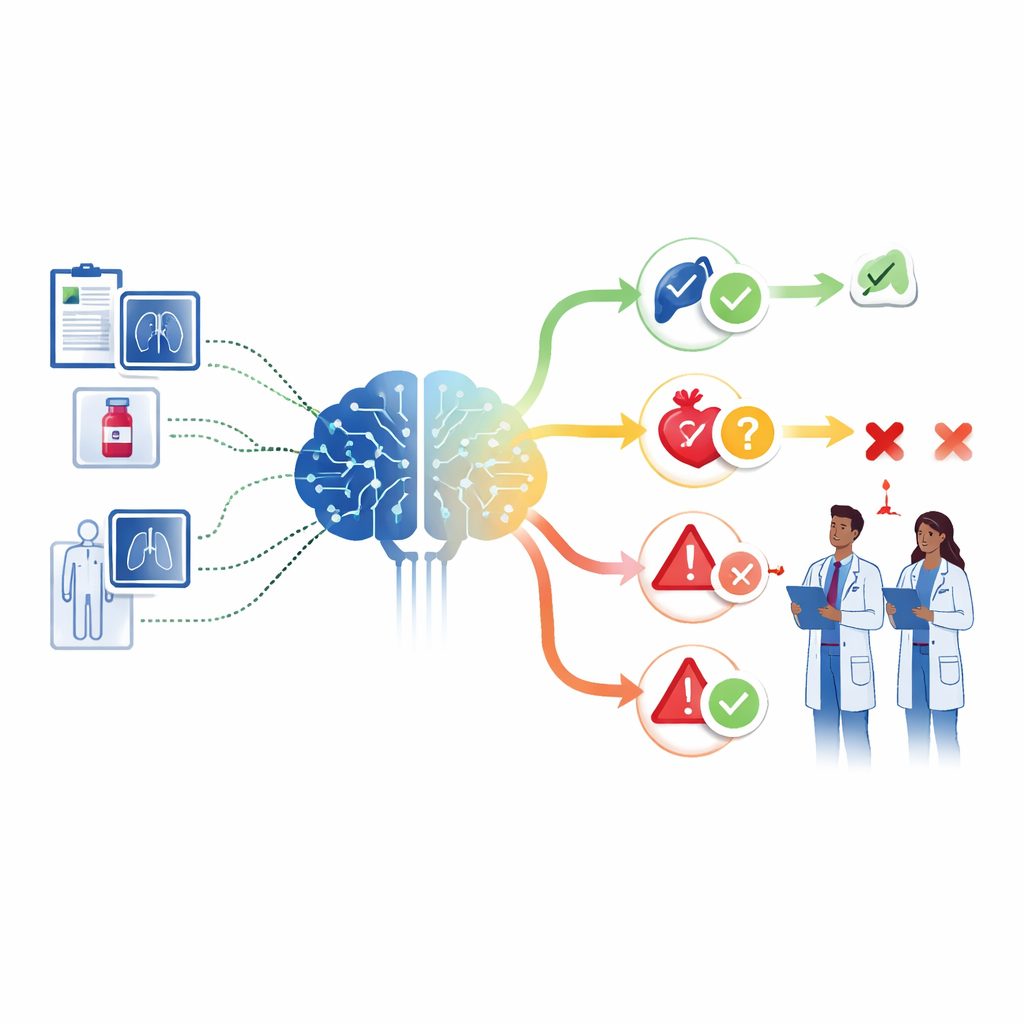

När samarbete inte överträffar maskinen

Ett slående fynd kom från prövningar som också testade AI ensam. I en studie av kritiskt sjuka patienter gjorde AI:n på egen hand ungefär lika bra resultat som läkare–AI‑teamet, och bättre än många läkare som arbetade ensamma. I en annan var AI‑genererade testutlåtanden tydligt sämre än de som producerades av mänskliga experter, oavsett om AI användes som assistent eller inte. Tillsammans blottlägger dessa resultat vad författarna kallar ett ”samarbetspardox”: att en människa i loopen inte automatiskt garanterar förbättring jämfört med en stark AI, och i vissa situationer kan partnerskapet utspäda styrkorna hos båda. Faktorer som hur rådet presenteras, hur mycket läkare litar på eller misstror det och hur verktyget är inbäddat i det dagliga arbetsflödet påverkar alla om samarbetet hjälper eller stjälper.

Vad detta innebär för framtidens läkare–AI‑team

Sammanfattningsvis målar översikten en bild av försiktig potential snarare än en redan uppnådd revolution. Läkare–AI‑team kan måttligt förbättra vissa beslutsmått och göra medicinska texter lättare att läsa, men de sparar inte pålitligt tid och genererar fortfarande ett oroande antal faktiska fel. Författarna hävdar att vårdsystem bör rulla ut dessa verktyg gradvis, med starka skyddsåtgärder som fokuserar på att fånga fel snarare än enbart att öka effektiviteten. De efterlyser också större, verklighetsnära kliniska prövningar som testar AI‑assistans i upptagna sjukhus och kliniker, inte bara i kontrollerade casesimuleringar. Tills sådan evidens finns är den säkraste vägen att behandla stora språkmodeller som kraftfulla men bristfälliga assistenter – och att utforma arbetsflöden där kliniker agerar som kritiska granskare och grindvakter, inte passiva mottagare, av AI‑råd.

Citering: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Nyckelord: människa–AI-samarbete, kliniskt beslutsstöd, stora språkmodeller, diagnostisk noggrannhet, medicinsk dokumentation