Clear Sky Science · sv

Skalning av regleringsvetenskap för medicinteknik med stora språkmodeller

Varför detta spelar roll för patienter och läkare

Modern medicin fylls snabbt av ”smarta” enheter som använder artificiell intelligens för att läsa bilder, övervaka vitala tecken och hjälpa läkare fatta beslut. Endast i USA har mer än tusen sådana verktyg redan godkänts eller klarats av Food and Drug Administration (FDA). Varje enhet lämnar ett pappersspår av komplexa beslutssammanfattningar och säkerhetsdokument. Idag granskas större delen av den informationen fortfarande för hand, vilket är långsamt, kostsamt och snabbt kommer på efterkälken. Denna artikel undersöker om stora språkmodeller — samma typ av AI som driver avancerade chattbottar — på ett tillförlitligt sätt kan läsa dessa dokument i stor skala och omvandla dem till användbar data för att hjälpa tillsynsmyndigheter, forskare och allmänheten att förstå hur väl dessa enheter är byggda och hur säkert de fungerar.

Problemet med för många komplexa dokument

Varje AI-drivet medicintekniskt verktyg levereras med omfattande besluts-sammanfattningar, säkerhetsrapporter och återkallelsemeddelanden. Dessa dokument är långa, skrivna i tung fackterminologi och innehåller ofta tabeller, bilder och inkonsekvent format. Tidigare forskning har visat att svar på grundläggande frågor — som hur en enhet testades innan godkännande eller vad som exakt gick fel vid ett fel — har krävt team av experter som läst hundratals PDF:er rad för rad. Enkla sökverktyg och mönstermatchning kan hitta uppenbara detaljer som ID‑nummer, men de har svårt med djupare frågor som kräver bedömning, exempelvis om en studie genomfördes över flera sjukhus eller om en enhet verkligen bidrog till en patients skada eller dödsfall. I takt med att antalet AI‑aktiverade enheter exploderat har detta manuella arbetssätt blivit omöjligt att hinna med.

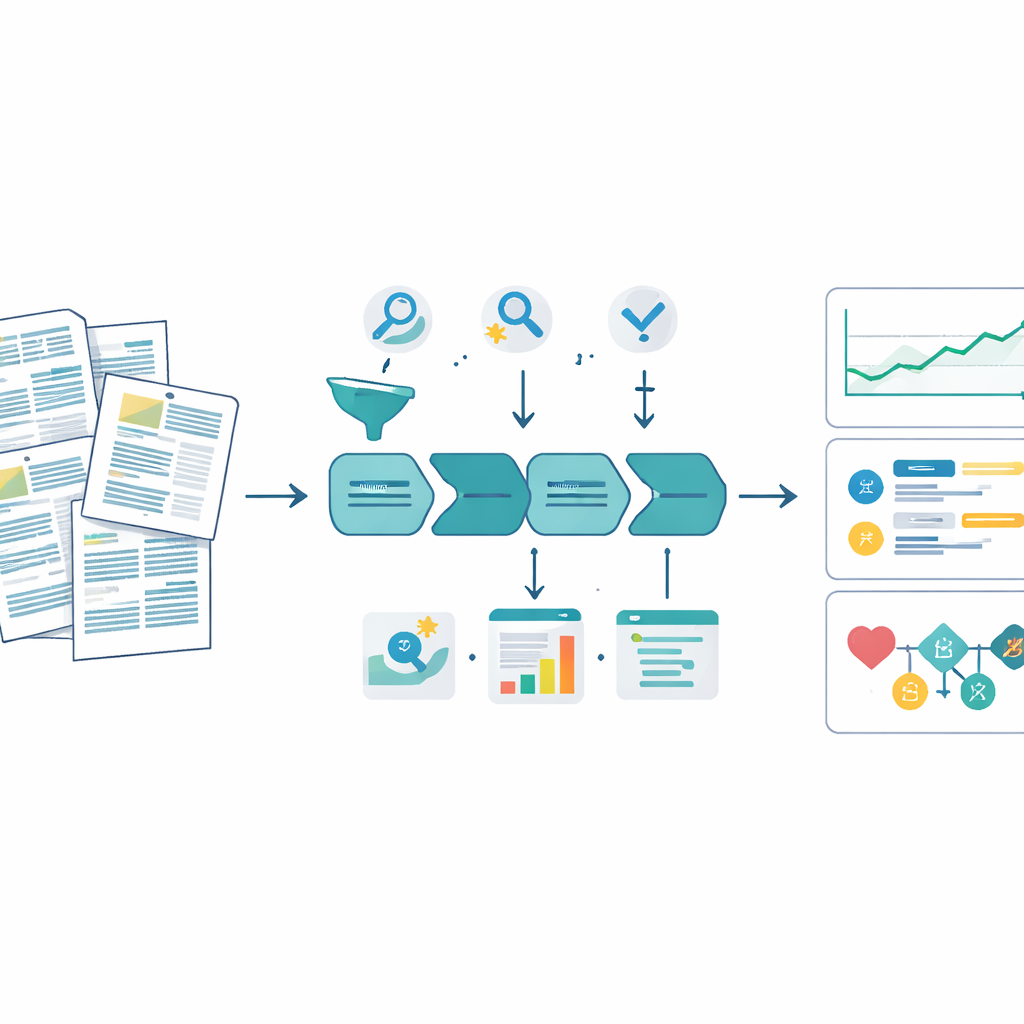

En AI‑pipeline som läser som en expert

Författarna byggde en generell pipeline baserad på en toppmodern stor språkmodell för att ta sig an denna utmaning. Först samlade de ihop alla offentligt tillgängliga FDA‑beslutssammanfattningar och säkerhetsrapporter för 1 247 AI‑ eller maskininlärningsenheter samt 1 852 relaterade rapporter om biverkningar fram till mitten av 2025, rengjorde PDF:erna och använde optisk teckenigenkänning när det behövdes. Istället för att be modellen svara på breda frågor på en gång bröt de ner arbetet i mindre, väl avgränsade deluppgifter. För varje dokumenttyp gavs modellen detaljerade instruktioner förankrade i officiell FDA‑vägledning samt exempel på hur människor skulle märka information. Modellen ombads att resonera steg för steg och att leverera sina svar i ett strikt, strukturerat format, vilket förvandlade fri text till tydliga fält såsom ”antal studiedeltagande platser”, ”typ av säkerhetshändelse” eller ”åtgärdstyp för enheten”.

Kontroll av noggrannhet i verkliga tillsynsfrågor

För att se om systemet kunde litas på genomförde teamet tre fallstudier där tidigare forskare redan ägnat månader åt manuell granskning. Först återbesökte de hur enheter testas före godkännande genom att fråga om prövningar var prospektiva (insamling av data framåt i tiden) och om de involverade flera sjukhus. Vid jämförelse mellan modellens output och experternas etiketter såg de överensstämmelsegrader ofta över 80 till 90 procent, jämförbara med överensstämmelsen mellan mänskliga annotatörer. För det andra använde de modellen för att omkoda säkerhetsrapporter som beskrev funktionsfel, skador eller dödsfall och för att klassificera vad som gick fel med enheten. När mänskliga granskare jämförde tillverkarens ursprungliga koder med de som föreslogs av modellen — utan att veta vilken som var vilken — föredrog de modellens val i en stor majoritet av fallen, särskilt i känsliga kategorier som dödsfall kontra funktionsfel. För det tredje kopplade forskarna detaljer från för‑godkännandedokument till senare säkerhetsrapporter för att undersöka vilka tidiga val — såsom att välja en föregångarenhet med tidigare återkallelser eller att göra stora hårdvaruändringar — statistiskt var kopplade till högre risk för framtida problem.

Vad fynden säger om säkerhet och tillsyn

När pipelinen validerats kunde teamet skala upp dessa analyser från dussintals enheter till hela den kända populationen av AI‑aktiverade medicinska verktyg. De fann till exempel att prospektiva kliniska utvärderingar förblivit relativt sällsynta över tre decennier, omkring en av tio enheter, medan omnämnanden av multisite‑testning ökat markant. I säkerhetsrapporterna upptäckte modellen mönster där typen av problem som beskrevs i texten inte överensstämde med den kod som lämnats till FDA — till exempel situationer där hårdvarufel kodades som bildkvalitetsproblem. När de kopplade för‑godkännandefunktioner till senare säkerhetshändelser visade enheter vars föregångare redan haft återkallelser eller historik av biverkningar mycket högre risk för nya rapporter, medan enheter som backats av klinisk testning tenderade att ha lägre risk. Resultaten är explorativa men illustrerar vilka frågor som nu kan ställas rutinmässigt istället för som engångsprojekt.

Begränsningar, skyddsåtgärder och vägen framåt

Författarna betonar att deras tillvägagångssätt inte är felfritt och inte bör ersätta expertbedömning. Noggrannhet kring 80 procent kan vara mer än tillräckligt för att analysera övergripande trender men inte för att fatta beslut om enskilda enheter eller patienter. Prestandan kan variera mellan enhetstyper och år, och kvaliteten på de underliggande FDA‑dokumenten och säkerhetsdatabaserna förblir en stor flaskhals. Ändå visar studien att omsorgsfullt utformade system baserade på språkmodeller kan förvandla berg av ostrukturerad tillsynstext till strukturerad, granskningsbar data på dagar i stället för år. För allmänheten är slutsatsen att samma AI‑teknologier som driver konsumentchattbottar också kan hjälpa tillsynsmyndigheter och forskare att spåra hur AI‑medicinteknik byggs, testas och övervakas — vilket potentiellt leder till snabbare upptäckt av problem och bättre evidens för att forma säkrare regler och produkter.

Citering: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Nyckelord: AI-medicinteknik, regleringsvetenskap, stora språkmodeller, FDA säkerhetsrapporter, översyn av hälsoteknik