Clear Sky Science · sv

Multimodal fusion av patologiska och radiologiska basmodeller för WHO 2021 gliom-subtypering

Att förena två perspektiv på hjärntumörer

När en person får diagnosen hjärntumör behöver läkare veta inte bara att en tumör finns utan vilken exakt typ det rör sig om. Olika tumörtyper svarar mycket olika på kirurgi, strålning och läkemedel. Idag kräver denna detaljerade ”subtypning” ofta genetiska tester som kan vara långsamma, kostsamma och inte tillgängliga överallt. Denna studie undersöker om ett smart datorsystem som betraktar både hjärnavbildningar och mikroskopiska bilder av tumörvävnad kan härleda dessa subtyper på ett tillförlitligt sätt, vilket potentiellt kan snabba på och bredda tillgången till precisionsbehandling.

Varför tumörtyp spelar roll

Diffusa gliom hos vuxna är bland de dödligaste hjärntumörerna, ändå ser de ofta likartade ut i standardavbildningar och under mikroskopet. Moderna riktlinjer grupperar dem i tre genetiska subtyper som skiljer sig avsevärt i aggressivitet och i den förväntade överlevnaden. Dagens referensmetod för att särskilja dessa subtyper bygger på molekylära tester av tumör-DNA. Dessa tester kräver extra vävnad, specialiserade laboratorier och dagar till veckors väntetid för svar. Författarna ställer frågan om rutinmässigt insamlade magnetresonanstomografi (MRI) och digitala patologibilder kan kombineras för att utvinna tillräckligt med information för att ersätta delar av denna genetiska utredning.

Lära maskiner att läsa skanningar och preparat

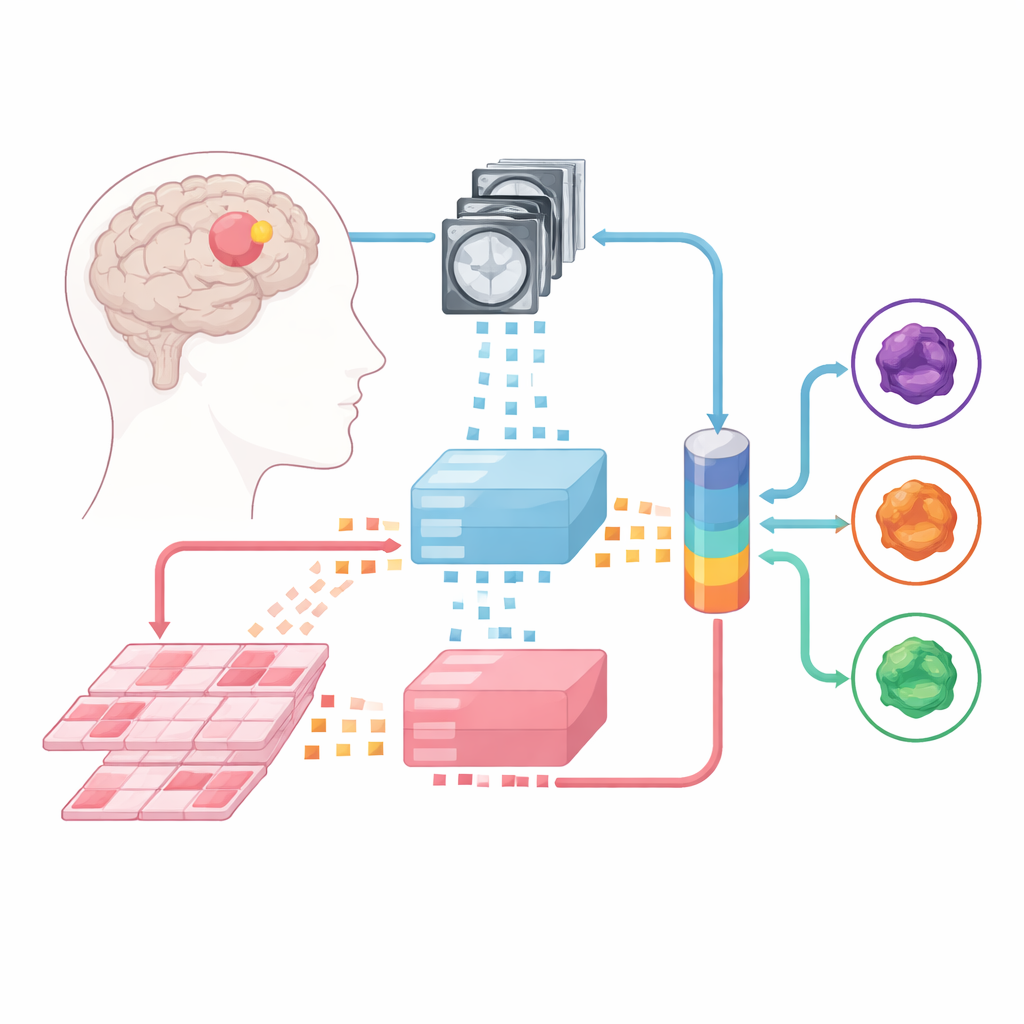

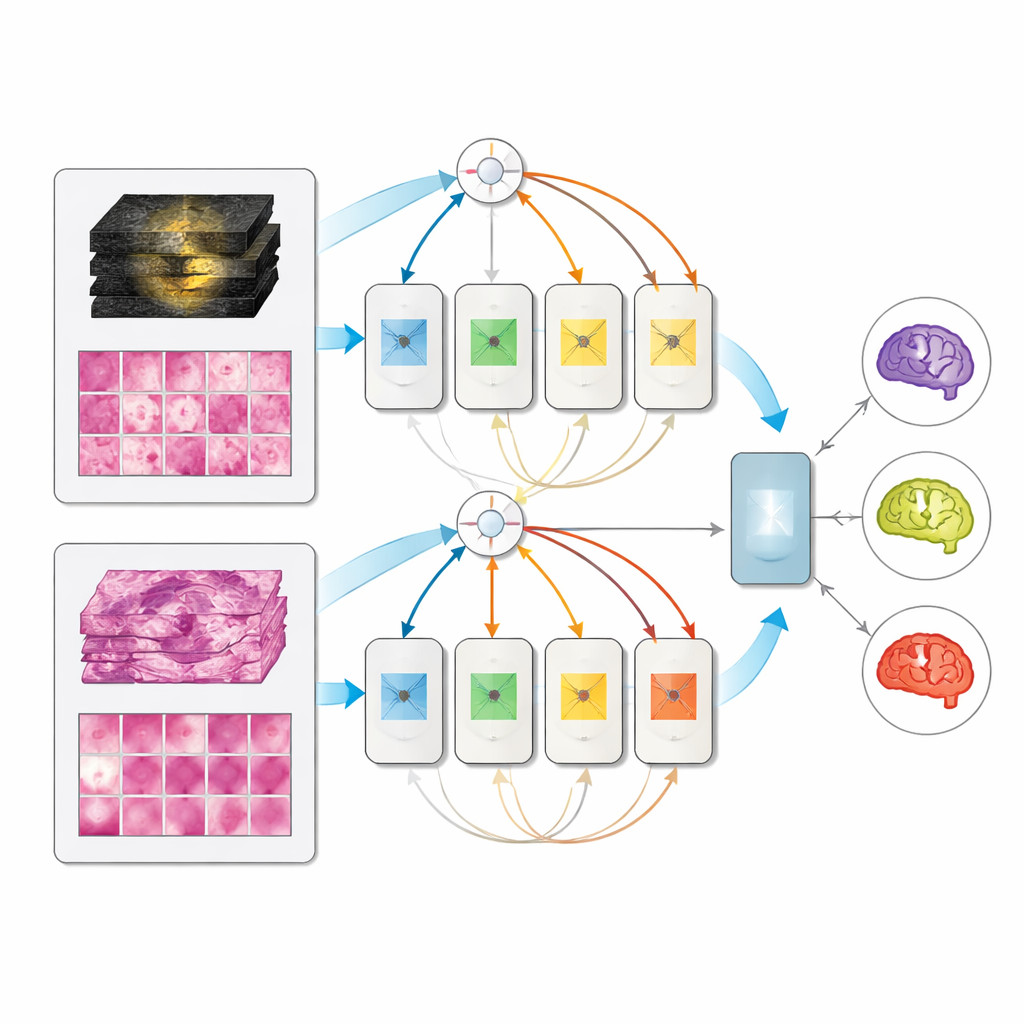

Forskarteamet byggde vidare på stora ”foundation models” – kraftfulla bildanalysatorer förtränade på enorma samlingar medicinska bilder. En sådan modell tolkar multiparametriska MRI-bilder och en annan hanterar högupplösta patologipreparat av tumörvävnad. Varje fall delas upp i små bildpatchar som foundation-modellerna omvandlar till numeriska fingeravtryck. Ovanpå dessa fasta ”experter” tränade forskarna tre typer av fusionsmodeller som lär sig att kombinera information från både MRI och patologi: en late-fusion-design, en early-fusion-design och en mer flexibel mixture-of-experts-arkitektur som dynamiskt kan avgöra hur mycket den ska förlita sig på varje informationskälla.

Blanda modaliteter utan patientmatchning

Ett praktiskt hinder för sådana multimodala metoder är att sjukhus sällan har stora dataset där varje patient har både MRI och patologibilder prydligt parade. Istället för att förlita sig på perfekt matchade data satte författarna ihop separata samlingar: hundratals MRI-fall från flera centra och hundratals patologifall från en annan resurs, plus en mindre uppsättning om 171 patienter från ett offentligt cancerprojekt som hade båda. Under träningen parade de ofta en MRI från en person med ett patologipreparat från en annan, så länge tumörerna tillhörde samma subtyp. Förvånande nog presterade modeller tränade på sådana ”oparade” data lika bra som de som tränats på verkliga patientpar, och klart bättre än att bara medelvärdesbilda två separata enmodalitetsmodeller.

En enda modell som anpassar sig efter vad som finns tillgängligt

På den avhållna uppsättningen med 171 fullständigt karaktäriserade patienter slog alla multimodala modeller sina motsvarigheter med en ingång, och mixture-of-experts-designen presterade bäst och nådde mycket höga poäng i att särskilja de tre subtyperna. Anmärkningsvärt är att när endast MRI eller endast patologi gavs vid testning kollapsade inte den multimodala modellen; den presterade ungefär lika bra som dedikerade enmodalitetsmodeller. Det betyder att en klinik skulle kunna använda ett enhetligt system som utnyttjar vilken information som än finns — endera preoperativa skanningar, postoperativ vävnad eller båda tillsammans — istället för att upprätthålla separata verktyg för varje scenario.

Se vad modellen ser

För att skapa förtroende för systemets beslutsfattande undersökte forskarna var modellen ”tittar” och vilka bilddrag som spelar störst roll. Uppmärksamhetskartor visade att den gemensamma modellen sprider sitt fokus mer brett över tumören och dess omgivning, både i MRI och i vävnadspreparat, och att ett mer diffus uppmärksamhetsmönster ofta sammanföll med korrekta prediktioner. En fördjupad analys av inlärda funktioner uppvisade mönster som stämmer med kända medicinska ledtrådar: till exempel hjälpte MRI-egenskaper som framhäver kontrast-ögande tumörkärnor och förvrängda vätskefyllda utrymmen att särskilja mer aggressiva tumörer, medan vävnadsdrag som fångar klassiska cellformer och texturer hjälpte igenkänning av specifika gliomsubtyper. Intressanta luckor framkom också: modellen kodade inte starkt vissa lärobokstecken för de mest aggressiva tumörerna, vilket stöder idén att den ofta behandlar den gruppen som ett ”standardfall” om det inte finns starka bevis för en mer gynnsam subtyp.

Vad detta kan innebära för patienter

Enkelt uttryckt visar detta arbete att ett AI-system som kombinerar hjärnavbildningar och mikroskopiska bilder kan klassificera hjärntumörer mer träffsäkert än system som bara ser en bildtyp, och att det kan tränas även när de två bildtyperna inte kommer från samma patienter. Om metoden valideras vidare i större och mer mångsidiga grupper kan sådana verktyg hjälpa läkare att uppskatta tumörsubtyp tidigare och mer utbrett, särskilt i miljöer där genetisk testning är begränsad. Även om de inte ersätter molekylära tester kan de fungera som snabba, kostnadseffektiva vägledare som pekar kirurger och onkologer mot den mest sannolika diagnosen och lämpligaste behandlingsvägen.

Citering: Saueressig, C., Scholz, D., Raffler, P. et al. Multimodal fusion of pathology and radiology foundation models for WHO 2021 glioma subtyping. npj Precis. Onc. 10, 118 (2026). https://doi.org/10.1038/s41698-026-01366-5

Nyckelord: gliom-subtypning, multimodal avbildning, artificiell intelligens, MRI och patologi, diagnostik av hjärncancer