Clear Sky Science · sv

Användningen av förtränade stora visuella-språkmodeller för preliminär diagnos av vita plack i matstrupen vid storskalig screening av esofaguscancer

Varför dessa fläckar i halsen spelar roll

Under rutinundersökningar av mage och svalg ser läkare ofta små vita fläckar inne i matstrupen. De flesta är ofarliga, men vissa kan vara tidiga cancerförändringar som är botbara om de upptäcks i tid. Att skilja dessa liknande utseende fläckar åt i intensiva screeningsprogram är svårt, även för experter. Denna studie undersöker om ett avancerat artificiellt intelligenssystem kan hjälpa läkare att snabbt sortera farliga fläckar från ofarliga och till och med beskriva vad det ser med vanlig text.

Vanliga vita fläckar med mycket olika risk

Vita plack i matstrupen är förvånansvärt vanliga: i detta stora screeningsprogram hade mer än en av fem patienter dem. Dessa plack kan dock bero på mycket olika tillstånd. Några är tidiga esofaguscancer, som visar sig som något upphöjda, grova vita områden som inte går att torka bort. Andra orsakas av svampinfektion, vilket ger mjuka vita beläggningar som kan lossna och blotta ömtålig vävnad under. Ytterligare andra är små godartade knutor kallade papillom, eller platta korniga områden kända som glykogenisk akantos, båda vanligtvis ofarliga och lämpliga för enkel uppföljning. Eftersom behandlingsalternativen sträcker sig från brådskande biopsi till enkel observation är det avgörande att få denna första visuella bedömning rätt.

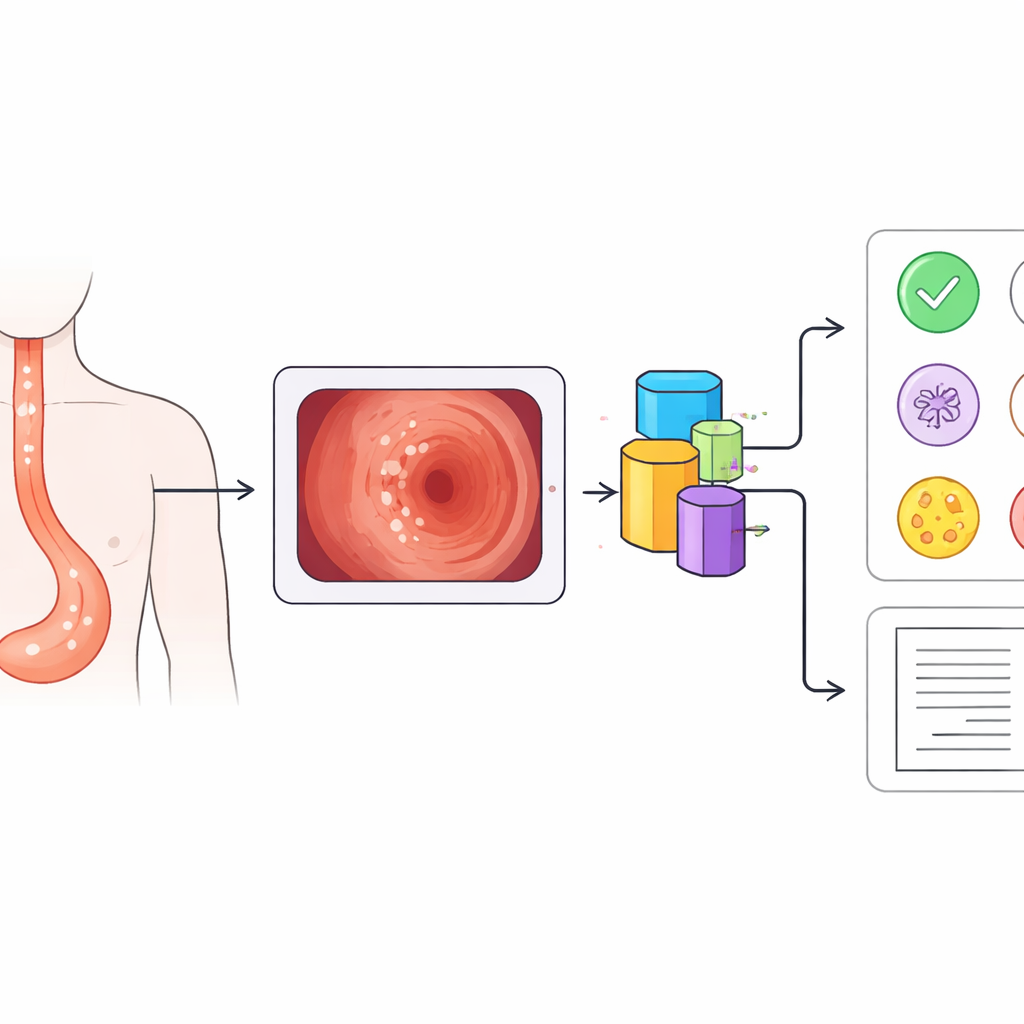

Att omvandla endoskopbilder till smart vägledning

Forskarna byggde ett datorstödd diagnostiksystem ovanpå en kraftfull vision-språkmodell känd som BLIP, ursprungligen tränad på stora samlingar av bilder och text. De matade systemet med 13 922 endoskopbilder från mer än 2 000 patienter, som täcker de fyra huvudsakliga orsakerna till vita plack och inkluderar både standard vita-ljus-vyer och ett specialläge med kontrast kallat narrow-band imaging. Till skillnad från tidigare verktyg som enbart tilldelar en sjukdomsetikett gör detta system två saker samtidigt: det förutsäger vilken av de fyra tillstånden som föreligger och genererar en kort skriftlig beskrivning av vad det ”ser” i bilden, såsom plackens läge och utseende.

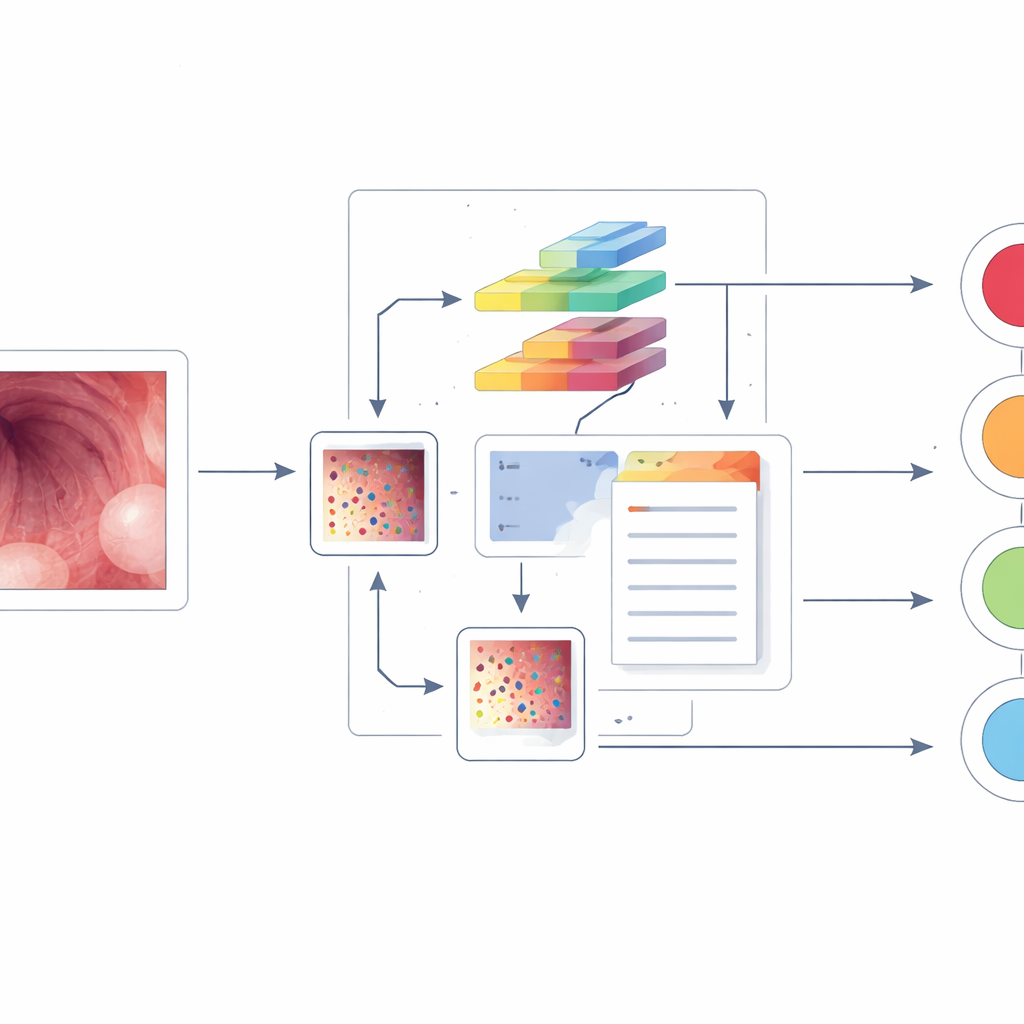

Att lära AI mer med begränsade medicinska data

Medicinbilder är små i jämförelse med vanliga fotodatabaser, vilket kan begränsa AI-prestanda. För att hantera detta lade teamet till särskilda moduler för ”positiv-incitamentsbrus” i BLIP-modellen. Enkelt uttryckt skapar dessa moduler milda, datadrivna variationer av varje bild och av modellens interna featurekartor, vilket uppmuntrar systemet att lära sig mer robusta mönster utan att överväldiga det med slumpmässiga förändringar. Modellen finjusterades sedan så att dess bildförståelse stämde väl överens med de expertdiagnoser och textbeskrivningar som tillhandahölls av erfarna endoskopister.

Slår både rivaliserande modeller och mänskliga experter

När den testades överträffade det nya systemet flera ledande bildbaserade AI-modeller på alla viktiga mått för samtliga fyra sjukdomar, med båda endoskoplägena. Det överglänste också en specialiserad medicinsk vision-språkmodell kallad LLaVA-Med i uppgiften att generera korrekta diagnostiska nyckelord i sina textbeskrivningar. I en direkt ”läsningstävling” mot fyra endoskopister — två seniora och två juniora — uppnådde AI:n högre total noggrannhet i att klassificera bilder. Mest anmärkningsvärt var att den var bättre än alla läkare på att upptäcka tidig esofaguscancer, särskilt vad gäller recall, det vill säga att den missade färre cancerfall samtidigt som den bibehöll god precision.

Vad detta kan innebära för framtida kontroller

Studien antyder att noggrant anpassade vision-språk-AI kan bli en värdefull medhjälpare i storskaliga screeningsprogram. Ett sådant system skulle kunna markera misstänkta vita plack i realtid, minska antalet missade tidiga cancerfall och spara många patienter från onödiga biopsier genom att ge läkare trygghet när en förändring ser säkert godartad ut. Arbetet behöver fortfarande testas på endoskopivideor, på mer sällsynta typer av vita plack och över flera sjukhus, men det pekar mot en framtid där AI inte bara upptäcker problem i medicinska bilder, utan också förklarar sitt resonemang i ett språk som stödjer snabbare och mer konsekventa kliniska beslut.

Citering: Li, Y., Li, X., Zhang, D. et al. The application of pre-trained large visual-language models for preliminary diagnosis of esophageal whitish plaques in large-scale esophageal cancer screening. npj Precis. Onc. 10, 94 (2026). https://doi.org/10.1038/s41698-026-01301-8

Nyckelord: screening för esofaguscancer, endoskopi-AI, vision-språkmodeller, datorstödd diagnostik, vita plack i matstrupen