Clear Sky Science · sv

En ensemble av vision- och Swin-transformers med LLM-baserade förklaringar för diagnos av sockerrörsbladsjukdomar

Varför det är viktigt att upptäcka sjuka sockerrörsblad

Sockerrör är en grundläggande gröda för socker, biobränslen och många landsbygdsförsörjningar, men bladen är känsliga för flera sjukdomar som tyst urholkar avkastningen. Jordbrukare förlitar sig oftast på visuell inspektion, vilket kan vara långsamt, inkonsekvent och svårt att skala upp över stora fält. Denna artikel undersöker hur modern artificiell intelligens automatiskt kan läsa bladfoton för att upptäcka flera sockerrörssjukdomar med hög noggrannhet, och sedan använda en språkmodell för att omvandla dessa förutsägelser till lättförståelig rådgivning för bönder.

Hur bladbilderna omvandlas till data

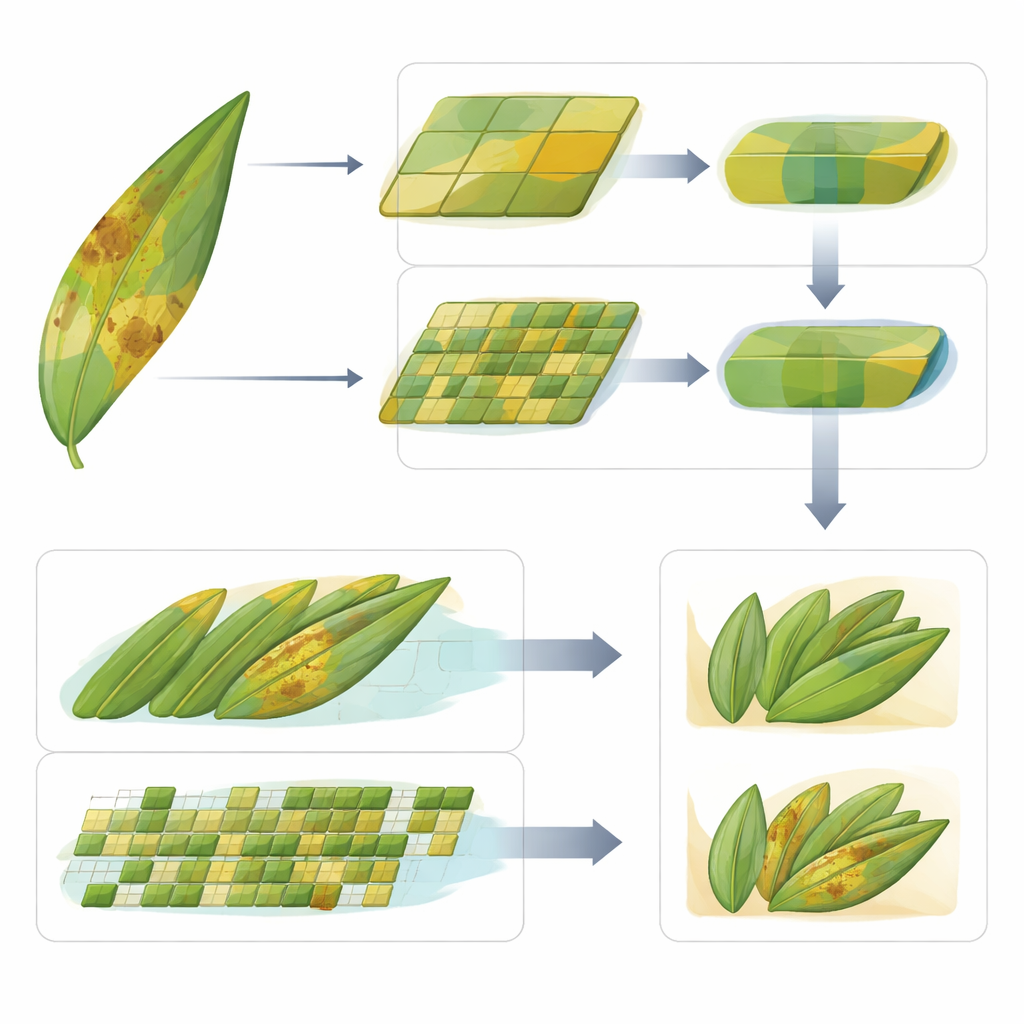

Forskarna byggde sitt system med en öppen bildsamling av sockerrörsblad från Kaggle, innehållande nästan tjugo tusen färgbilder. Varje bild tillhör en av sex kategorier: frisk eller en av fem vanliga sjukdomar, inklusive Bacterial Blight, Mosaic, Red Rot, Rust och Yellow Leaf Disease. Bilderna togs under verkliga gårdsförhållanden och innehåller därför varierande ljus, skuggor och röriga bakgrunder. För att förbereda data tog teamet bort dubbletter och korrupta bilder, och delade sedan upp datasetet i tränings-, validerings- och testuppsättningar samtidigt som de behöll samma balans mellan sjukdomstyper i varje del. Under träningen augmenterade de endast träningsbilderna med rotationer, speglingar och zoomning för att efterlikna olika kameravinklar och avstånd, vilket gjorde systemet mer robust utan att blåsa upp dess testprestanda.

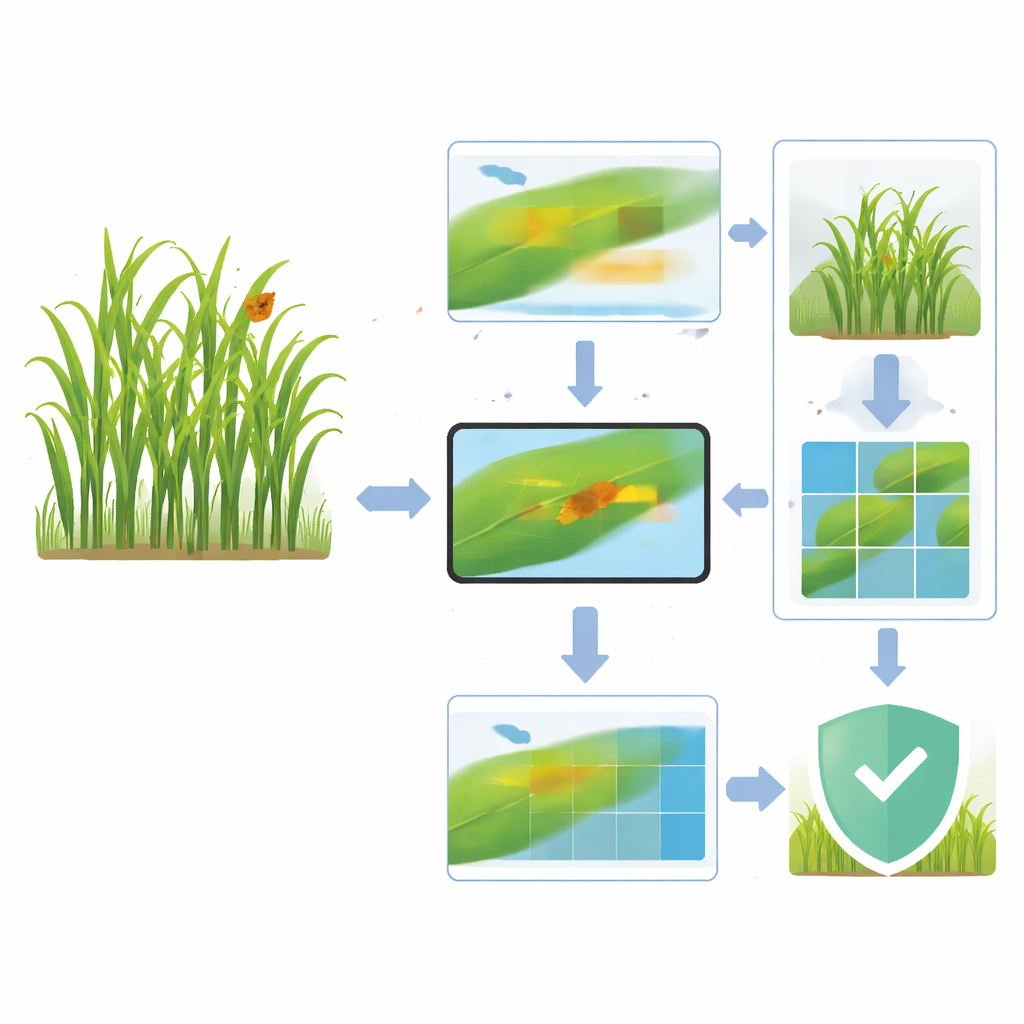

Två kompletterande sätt att betrakta ett blad

I hjärtat av studien finns en ”ensemble” som kombinerar två avancerade visionmodeller kända som transformers. Den ena, Vision Transformer (ViT), ser varje bild som en uppsättning patchar och lär sig mönster över hela bladet samtidigt. Denna globala vy passar väl för sjukdomar som sprider sig som stora, diffusa områden av missfärgning. Den andra, kallad Swin Transformer, arbetar med mindre överlappande fönster som rör sig över bilden och bygger upp en lager-på-lager-förståelse av fina texturer och små fläckar. Detta lokala fokus hjälper till vid sjukdomar som visar sig som små lesioner, strimmor eller prickar. Av design är ViT känslig för breda färgförändringar medan Swin uppmärksammar små, klustrade detaljer—två sidor av hur verkliga bladsjukdomar visar sig i fältet.

Hur de två modellerna går samman

I stället för att bygga ett komplicerat nytt nätverk kombinerar författarna ViT och Swin på ett enkelt och transparent sätt. Varje modell undersöker först samma bladsbild och producerar sina egna sannolikhetspoäng för de sex klasserna. Dessa poäng medelvärdesbildas sedan, utan extra träningsbara vikter, och den högsta kombinerade sannolikheten avgör den slutliga diagnosen. Denna medelvärdesstrategi balanserar styrkorna hos varje modell och undviker överanpassning på ett dataset som, även om det är hyggligt stort, fortfarande återspeglar ett specifikt urval av regioner och förhållanden. Experimen visar att ersättning av Swin med ett traditionellt konvolutionsnätverk tar bort avgörande lokala detaljer, och att enbart ViT missar subtila ledtrådar—bevis på att vinsten kommer från den verkliga synergin mellan global och lokal uppmärksamhet, inte bara från att stapla fler modeller.

Hur väl systemet fungerar i praktiken

På den hållna testuppsättningen på nästan tre tusen bilder når ensemblen en noggrannhet på cirka 97 procent, med liknande höga värden för precision, recall och F1-mått över alla sex klasser. Det överträffar starka konvolutionella baslinjer som ResNet, EfficientNet, MobileNet och DenseNet, liksom de individuella ViT- och Swin-modellerna. Förväxlingsmatrisen visar att de flesta fel uppstår mellan visuellt liknande sjukdomar, såsom Yellow Leaf och Mosaic, men totalt sett förblir felsklassificeringsnivåerna låga. ROC-kurvorna för varje klass är nästan perfekta, vilket indikerar att ensemblen är mycket säker och konsekvent i att skilja friska från sjuka blad och mellan olika sjukdomstyper.

Att omvandla förutsägelser till böndervänlig vägledning

För att gå bortom råa etiketter kopplar författarna sin bildeensemble till en stor språkmodell (LLM) som hostas online. När ett bladfoto klassificerats skickas det förutspådda sjukdomsnamnet till LLM:en, som returnerar en kort förklaring av sannolika symptom och allmänna hanteringsförslag, avsedda för bönder och rådgivare. Ett webbgränssnitt byggt på Hugging Face-plattformen tillåter användare att ladda upp en bladbild, se den förutsagda sjukdomen och läsa den AI-genererade vägledningen inom några sekunder. Författarna betonar att dessa rekommendationer är rådgivande och bör kontrolleras med agronomiexperter, eftersom LLM:er ibland kan generera överdrivet självsäkra eller ofullständiga råd. Ändå gör detta språklager systemet mer tillgängligt för icke-specialister.

Vad detta betyder för framtida smarta jordbruksverktyg

Enkelt uttryckt visar studien att kombinationen av två ”sätt att se” samma blad—det ena som ser skogen, det andra som ser träden—kan ge en mycket pålitlig digital spejare för sockerrörssjukdomar. Ensemblen av ViT- och Swin-transformers fångar både breda och finfördelade symptom, medan den kopplade språkmodellen hjälper till att översätta tekniska förutsägelser till människovänliga förslag. Även om modellerna fortfarande behöver testas i fler regioner, ljusförhållanden och på fler enheter, och språkoutputen kräver expertgranskning, pekar detta arbete mot praktiska verktyg för telefon eller surfplatta som kan hjälpa bönder att upptäcka problem tidigt, minska gissningsarbete och stödja mer precis användning av åtgärder i sockerrör och så småningom många andra grödor.

Citering: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Nyckelord: upptäckt av sockerrörssjukdomar, transformermodeller för vision, precision jordbruk, växtbladsavbildning, AI-beslutsstöd