Clear Sky Science · sv

Domänoberoende svagt övervakad segmentering av kirurgiska instrument

Varför bättre bildförståelse av kirurgiska verktyg spelar roll

Moderna kirurger arbetar i allt högre grad med hjälp av kameror, mikroskop och avancerade skannrar. För att styra robotar, anpassa 3D-vyer eller dölja verktyg i vissa bilder måste datorer pålitligt hitta varje kirurgiskt instrument i varje bildruta — en uppgift som kallas segmentering. Idag krävs ofta tusentals tidskrävande, pixelexakta annoteringar från medicinska experter — och även då fallerar systemen ofta när bildinställningen eller proceduren förändras. Denna studie presenterar ett sätt att låta kraftfulla visionsmodeller hitta instrument i mycket olika typer av medicinska bilder, utan att behöva detaljerade ritningar av varje verktyg i förväg.

Utmaningen att hitta verktyg i många bildtyper

Kirurger använder en mängd olika bildsystem: färgvideor från laparoskopiska kameror i buken, mikroskopvyer av ögat under kataraktkirurgi och tvärsnittsavbildningar som optisk koherenstomografi (OCT) eller ultraljud. I varje fall ser kirurgiska instrument mycket olika ut — blanka metallstänger i färgbilder, tunna ljusa linjer eller bågar i OCT, eller korniga fläckar i ultraljud. Befintliga djupinlärningsmetoder kan fungera mycket väl, men endast efter att ha tränats på stora, noggrant märkta dataset från en specifik miljö. När bildgivare, anatomi eller instrumenttyp ändras sjunker prestandan ofta kraftigt, och att samla in nya annoteringar är långsamt, kostsamt och begränsat av sekretess och specialisttillgång.

En ny idé: betrakta instrument som oplacerade objekt

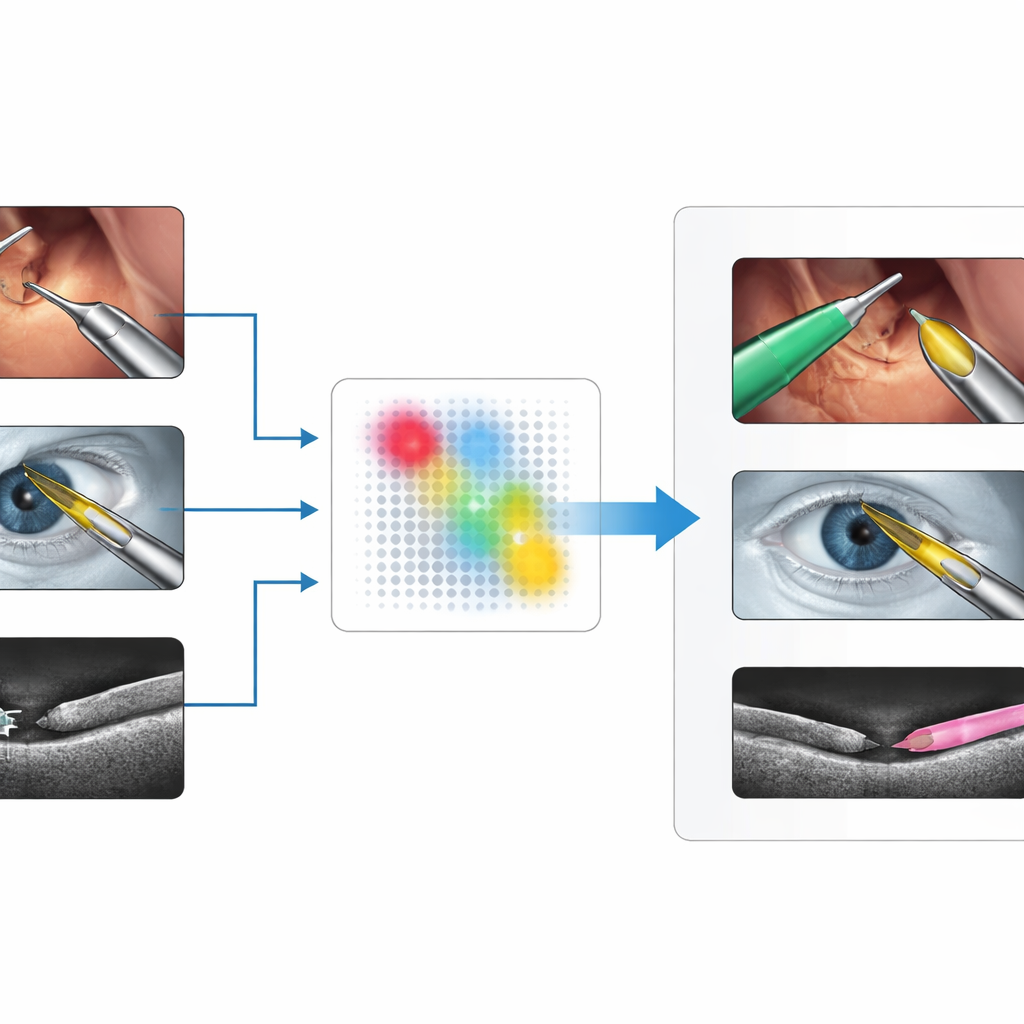

Författarna föreslår en metod de kallar SAM4SIS som vänder problemet till något annat. Istället för att lära systemet exakt hur varje instrument ser ut visar de det först bilder utan några verktyg, så att modellen kan lära sig hur ”normal” vävnad ser ut. De använder en anomalidetektor kallad PatchCore för att bygga ett minne av dessa normala mönster. När en ny bild kommer framhäver PatchCore områden vars utseende inte passar detta minne — områden som sannolikt innehåller kirurgiska instrument. Detta steg kräver endast enkel information på bildnivå om huruvida ett verktyg finns närvarande, inte pixelvisa konturer, vilket gör uppsättningen avsevärt enklare.

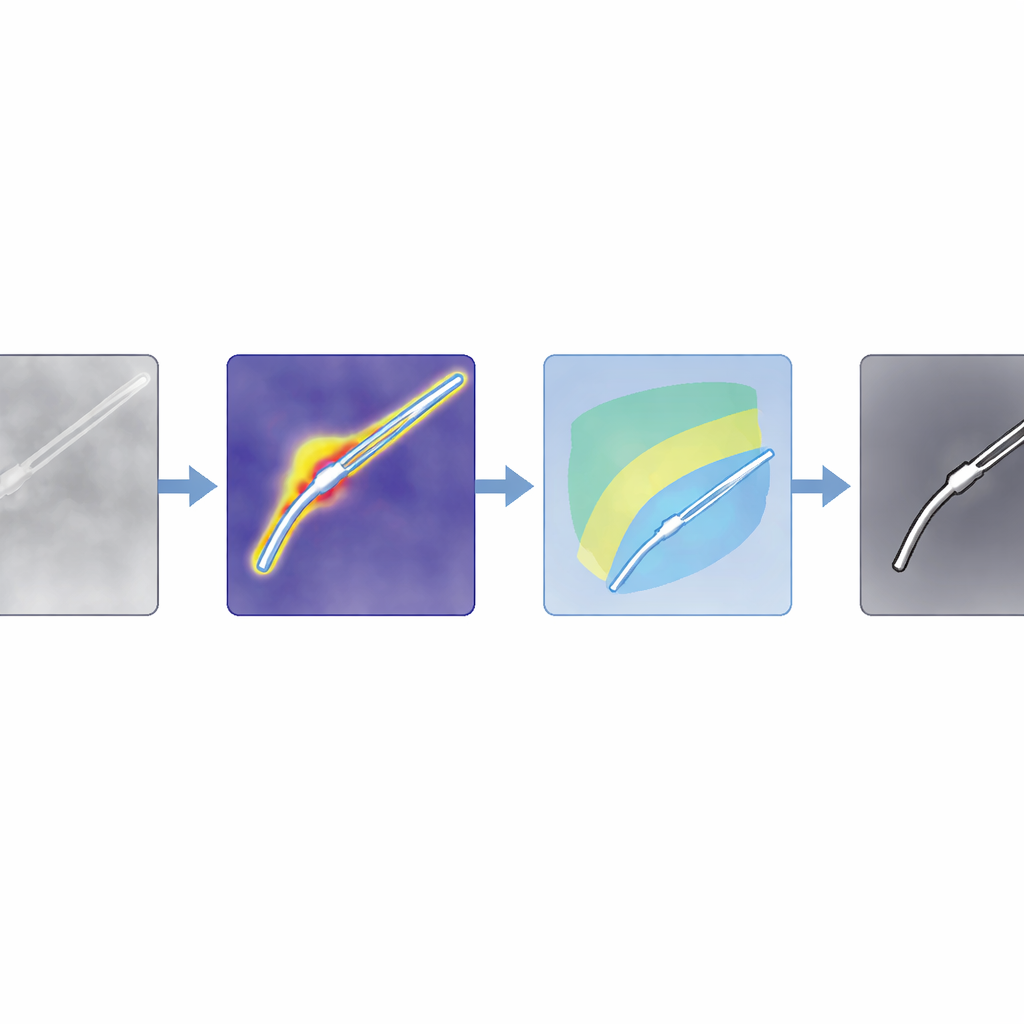

Från grova ledtrådar till precisa konturer

Anomalikartor är grova, så teamet kombinerar dem med en kraftfull grundmodell, Segment Anything Model 2 (SAM2), som kan rita skarpa konturer om den får en punkt inuti objektet av intresse. Den viktiga idén är att automatiskt välja dessa punkter från anomalikartan istället för att be en människa klicka. Författarna utformar filter anpassade för vanliga färgbilder och för intensitetsbaserade skanningar som OCT, som förstärker regioner som sannolikt innehåller instrument samtidigt som skuggor och ljusa artefakter dämpas. De rankar sedan potentiella verktygsregioner och väljer de starkaste punkterna som promptar för SAM2. Eftersom SAM2 returnerar flera kandidatmasker introducerar författarna en ny poängregel, SAM4SIS, som mäter hur väl varje kandidat stämmer överens med anomalikartan och väljer den bäst passande masken.

Fungerar över många operationer och skannrar

Forskarna testar sitt tillvägagångssätt på tre krävande dataset: abdominala robotkirurgivideor (EndoVis2017), mikroskopbilder från kataraktoperationer (CaDIS) och tvärsnittsskanningar med OCT av spädgrisaröga med små instrument (PASO-SIS). Dessa täcker mycket olika vyer, färger och brusmönster. Utan att någonsin omskolas den stora segmenteringsmodellen eller rita nya masker når SAM4SIS gränsnoggrannhet mellan cirka 53 % och 73 %, vilket konkurrerar med eller överträffar textbaserade promptingmetoder och närmar sig vissa övervakade system. Metoden presterar särskilt väl där traditionella metoder har svårt, såsom i OCT- och ultraljudsdata, och kräver mindre än en minuts uppsättningstid. Teamet visar också att samma idé kan framhäva andra främmande objekt, som bomullsbollar i hjärn-ultraljud, vilket tyder på att konceptet inte är begränsat till instrument.

Vad detta innebär för framtidens smarta kirurgi

Huvudbudskapet för läsaren är att datorer nu kan lära sig att ”segmentera vad som helst nytt” i kirurgiska scener genom att först förstå hur normal vävnad ser ut och sedan flagga ovanliga former som sannolika verktyg, vilka sedan förfinas av en allmän visionsmodell. Detta tillvägagångssätt undviker tung annoteringsbörda, anpassar sig till olika bildteknologier och kan integreras i kirurgiska arbetsflöden med minimal förberedelse. Medan noggrant tränade, specialiserade modeller fortfarande vinner när rikligt med märkta data finns, erbjuder SAM4SIS ett praktiskt alternativ för nya procedurer, sällsynta bildinställningar eller tidig forskning, och för den automatiserade, robusta instrumentdetektionen närmare klinisk vardag.

Citering: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Nyckelord: segmentering av kirurgiska instrument, AI för medicinsk bildbehandling, anomalidetektion, grundläggande visionsmodeller, robotkirurgi