Clear Sky Science · sv

Utveckling och utvärdering av ett flerstegs ramverk för transferinlärning för robust medicinsk bildanalys

Varför smartare bildläsning spelar roll

Modern medicin är starkt beroende av bilder—från mammografier till lungröntgen—för att upptäcka sjukdomar tidigt och vägleda behandling. Men att lära datorer att läsa dessa bilder lika exakt som mänskliga experter kräver oftast stora, noggrant märkta dataset som många sjukhus helt enkelt inte har. Denna studie introducerar ett nytt sätt att träna artificiell intelligens som utnyttjar befintliga bilder bättre, inklusive billiga laboratoriebilder av cancerceller, för att förbättra prestandan på verkliga skanningar samtidigt som krav på sekretess och data minskar.

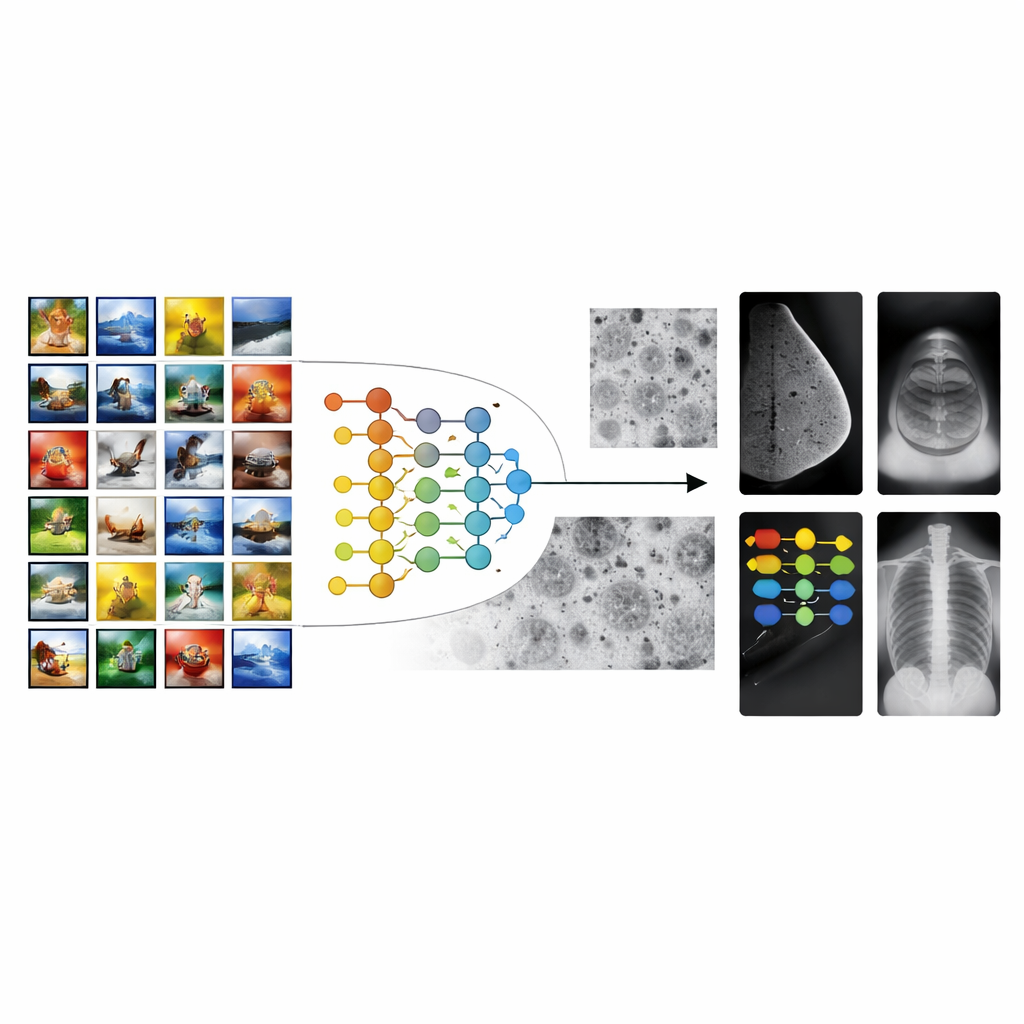

Från vardagsfoton till sjukhusskanningar

De flesta AI-system för medicinsk bildbehandling utgår från modeller som tränats på miljontals vardagsbilder, som djur, föremål och landskap. Denna strategi, känd som transferinlärning, ger algoritmer en ”försprång” i att känna igen former och texturer. Det finns dock ett stort gap mellan semestefoton och medicinska skanningar. Mönstren som är viktiga i en mammografi eller en röntgen—små prickar, svaga skuggor eller subtila vävnadstyper—liknar inte alls objekten i vanliga foton. Som en följd kan konventionell transferinlärning stanna av, vilket leder till verktyg som fungerar bra i labbet men har svårt att generalisera mellan olika sjukhus, maskiner eller patientgrupper.

Bygga en bro med cellbilder

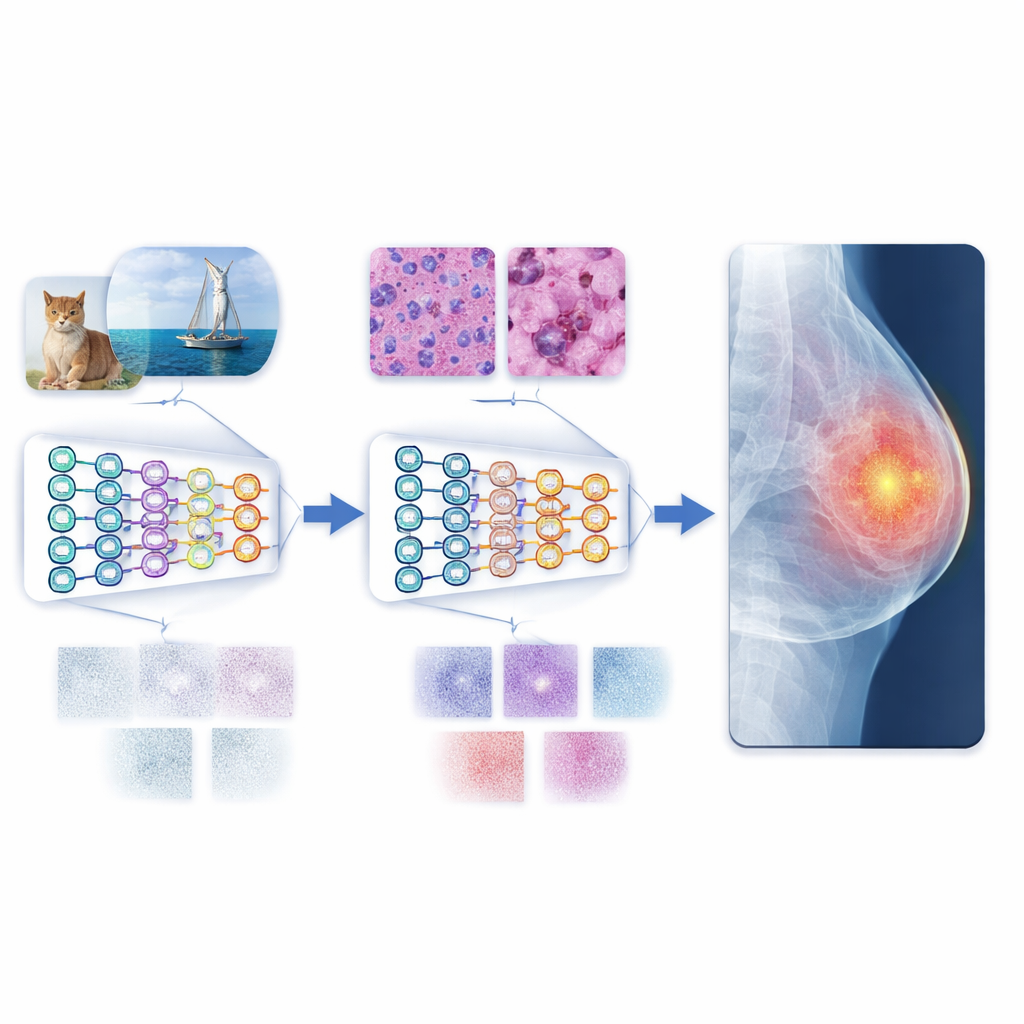

Författarna föreslår ett flerstegsramverk för transferinlärning (MSTL) som lägger till ett viktigt mellansteg mellan generella bilder och kliniska skanningar. Efter att först ha tränats på en stor samling naturbilder finjusteras modellen på mikroskopiska bilder av cancercellinjer odlade i laboratoriet. Dessa cellbilder delar många visuella egenskaper med medicinska skanningar: täta, trånga strukturer; fint detaljerade texturer; och subtila ljusvariationer. De är också relativt billiga att framställa, kan genereras i stort antal och undviker de sekretessproblem som är kopplade till patientdata. Genom att först anpassa sig till denna cellbildsvärld lär sig modellen funktioner som är mer relevanta för sjukdomsmönster innan den någonsin ser en mammografi, ultraljud eller röntgen.

Testning över olika skanningstyper

För att utvärdera denna strategi tränade forskarna både traditionella konvolutionella neurala nätverk och nyare vision-transformers på tre vanliga bilduppgifter: bröstcancerdetektion i mammografier, analys av bröstlesioner i ultraljud och pneumonidetektion i lungröntgen. De jämförde tre träningsstilar: att börja från början, att använda konventionell transferinlärning från naturbilder och att använda den nya flerstegsmetoden med cancercellbilder som brygga. Flerstegstillvägagångssättet levererade konsekvent de bästa resultaten och pressade ofta noggrannheten nära perfekt på de testade datasetten. Vision-transformers, som kan fånga långräckande mönster över hela bilden, överträffade standard konvolutionella nätverk i nästan alla inställningar, särskilt i kombination med flerstegsträningen.

Mäta hur väl kunskap överförs

Utöver enkla noggrannhetssiffror undersökte teamet hur lätt de funktioner som lärts i ett steg fördes över till nästa. De använde tre mått på överförbarhet som återspeglar hur kompatibla de inlärda bildmönstren är med nya uppgifter. För mammografier och lungröntgen särskilt följde dessa mått den faktiska prestandan tätt, särskilt för den starkaste modellen, en bas vision-transformer (ViTB-16). Denna starka relation antyder att det mellanliggande cellbildsstadiet gör mer än att bara förbättra siffror; det frambringar representationer som verkligen passar medicinska bilder bättre. Ytterligare experiment visade att en halvering av antalet cellbilder försämrade prestandan, och att ersätta dem med andra medicinska modaliteter (såsom endoskopi- eller ögonbilder) var mindre effektivt, vilket understryker cancercellinjerna som en särskilt värdefull brygga.

Mot mer pålitlig automatiserad diagnostik

I vardagliga termer visar studien att genom att lära ett AI-system att läsa laboratorieodlade cellbilder innan sjukhusskanningar görs det till en mer skicklig och pålitlig ”läsare” av medicinska bilder. Denna flerstegsväg minskar mismatchen mellan färgstarka vardagsfoton och de dämpade, komplexa mönstren i kliniska bilder, vilket gör att modellen generaliserar bättre även när endast måttliga mängder märkta medicinska data finns tillgängliga. Tillsammans med moderna vision-transformers levererar metoden toppresultat på flera referensdataset. Även om mer mångfald i data och bredare tester fortfarande behövs, pekar ramverket mot skalbara, sekretessvänliga verktyg som skulle kunna stödja läkare att diagnostisera sjukdom mer exakt och konsekvent globalt.

Citering: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Nyckelord: medicinsk bildanalys, transferinlärning, djupinlärning, vision-transformers, avbildning av cancerceller