Clear Sky Science · sv

GWKNN: en förbättrad k-närmaste grannar-algoritm med G-metrikrekonstruktion och Grey Wolf Optimizer

Smartare mönsterigenkänning för dagens dataöverflöd

Från medicinska skanningar till banktransaktioner genererar det moderna livet hav av data. Mycket av denna information måste automatiskt sorteras i kategorier: frisk eller sjuk, bedräglig eller normal, skräppost eller äkta. En klassisk arbetshäst för sådana uppgifter är k-närmaste grannar (KNN)-algoritmen, som etiketterar ett nytt fall genom att titta på de mest liknande tidigare exemplen. Men när datasätt blir större, mer komplexa och mer obalanserade börjar denna enkla idé krackelera. Artikeln presenterar GWKNN, en omarbetad version av KNN utformad för att använda avstånden mellan punkter på ett smartare sätt och för att behandla sällsynta men viktiga fall mer rättvist.

Varför enkel likhet inte räcker

Konventionell KNN antar att alla egenskaper (features) hos en datapunkt bidrar lika mycket och mäter likhet med ett standard rätlinjigt avstånd. Det kan fungera väl när data är lågdimensionella och snyggt separerade, men verkliga data är ofta högdimensionella, brusiga och en blandning av olika informationstyper. I sådana fall kan vanliga avstånd vara vilseledande och få algoritmen att välja ohelpfulla grannar. Samtidigt är många datasätt obalanserade: vanliga klasser dominerar, medan sällsynta men avgörande klasser, såsom en tidig sjukdom, är underrepresenterade. När KNN röstar bland närliggande exempel tenderar majoritetsklassen att dränka dessa minoritetsfall, vilket leder till snedvridna och ibland farliga beslut.

Lära algoritmen en bättre känsla för avstånd

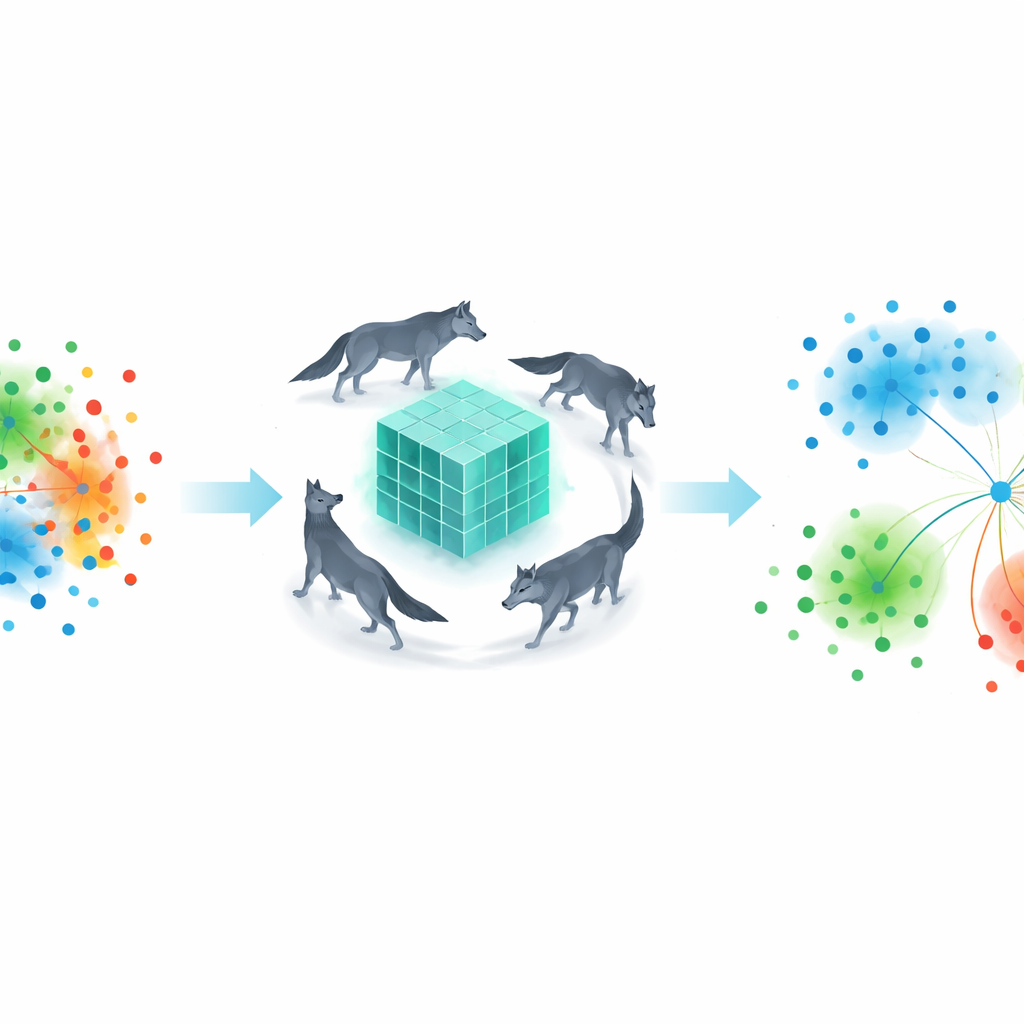

Den första stora innovationen i GWKNN är en inlärd distansmetrik. Istället för att låsa fast det vanliga rätlinjiga måttet låter författarna algoritmen upptäcka hur långt ifrån varandra datapunkter bör vara på ett sätt som bäst separerar klasserna. De kodar detta som en flexibel "G-metrik" som omformar rummet så att informativa egenskaper får större betydelse och redundanta får mindre. För att finjustera denna metrik lånar metoden inspiration från gråvargars jaktbeteende. En svärmintelligensprocedur, kallad Grey Wolf Optimizer, utforskar många möjliga sätt att dra ut och pressa datarummet och behåller de varianter som minskar klassificeringsfel samtidigt som matematisk stabilitet bibehålls. Över många iterationer konvergerar de virtuella "vargarna" mot en avståndsregel som får liknande punkter att klustra sig mer tillförlitligt, även i högdimensionella och intrasslade datasätt.

Ge sällsynta fall en starkare röst

Den andra förbättringen riktar sig mot röstningsbias. Standard-KNN räknar helt enkelt hur många av de k närmaste som tillhör varje klass och väljer majoriteten. GWKNN väger istället varje röst efter hur vanlig den klassen är i hela träningsdatan. Klasser som förekommer mindre ofta tilldelas starkare vikter; mycket frekventa klasser får svagare sådana. En liten utjämningsterm förhindrar att extremt sällsynta kategorier överväldigar beslutet. På så sätt, om en ny datapunkt ligger nära ett fåtal minoritetsklass-exempel och många majoritetsklass-exempel, blir inte minoritetssignalerna automatiskt översköljda. Schemat är enkelt att beräkna men har en kraftfull effekt: det pressar klassificeraren att lägga större vikt vid sällsynta men betydelsefulla mönster, vilket förbättrar rättvisa och återkallelse för minoritetsklasser.

Sätta den nya metoden på prov

För att se om GWKNN verkligen hjälper i praktiken utvärderade författarna metoden på 12 referensdatasätt från den välkända UCI-repositoriet. Dessa samlingar spänner över finansiella data, medicinska mätningar, handskrift, plantfrön samt flera högdimensionella cancer- och genuttrycks-datasätt, med både tvåklass- och flerkakskproblem. De jämförde fyra varianter av KNN: baslinjen, en version med endast den nya distansmetriken, en version med endast de nya röstningsvikterna och den fulla GWKNN som kombinerar båda idéerna. De ställde också GWKNN mot sju vida använda klassificerare, inklusive supportvektormaskiner, beslutsträd, slumpmässiga skogar, logistisk regression, naive Bayes och ett neuralt nätverk. Över upprepade tränings–test-split följde de inte bara genomsnittlig noggrannhet utan också hur mycket resultaten varierade.

Resultat: Mer exakt och mer konsekvent

Den kombinerade GWKNN-metoden hamnade överst eller delade första platsen vad gäller prestanda på de flesta datasätt, särskilt på dem med många egenskaper och ojämna klassstorlekar. På relativt enkla uppgifter presterade alla metoder väl och vinsterna var måttliga, men GWKNN tenderade ändå att något förbättra noggrannheten och minska variabiliteten. På svårare genuttrycks-datasätt med tusentals egenskaper var fördelarna tydligare: den inlärda distansmetriken hjälpte algoritmen att bilda mer meningsfulla grannskap, och den viktade omröstningen förbättrade igenkänningen av underrepresenterade klasser. Statistiska tester över alla datasätt bekräftade att GWKNN:s rankningar var signifikant bättre än standard-KNN och vissa klassiska modeller, vilket indikerar att förbättringarna inte bara beror på slumpmässiga svängningar utan är robusta över olika datavillkor.

Vad detta betyder för vardagliga databeslut

För icke-specialister är slutsatsen att GWKNN förfinar en mycket intuitiv idé—"titta på liknande tidigare fall"—för att bättre matcha den röriga verkligheten i modern data. Genom att lära sig hur man mäter likhet på ett datadrivet sätt och genom att förstärka inflytandet från sällsynta kategorier vid omröstning syftar metoden till att vara både mer exakt och mer rättvis. Även om denna extra finess medför ökade beräkningskostnader, särskilt för mycket stora och högdimensionella datasätt, visar GWKNN stark potential för uppgifter där korrekt klassificering av minoritetsfall verkligen spelar roll, såsom tidig sjukdomsupptäckt eller bedrägeribekämpning. Arbetet visar hur klassiska algoritmer kan uppgraderas med insikter från optimering och rättvisa för att hänga med i omfattningen och komplexiteten hos dagens information.

Citering: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Nyckelord: k-närmaste grannar, inlärning av distansmetrik, klassobalans, svärmintelligens, dataklassificering