Clear Sky Science · sv

Stokastiskt Poisson-inbäddat sekretessramverk för federerat lärande med säker homomorfisk kryptering inom medicinsk AI

Att hålla medicinska hemligheter säkra samtidigt som man lär maskiner

Sjukhus samlar in enorma mängder röntgenbilder som kan hjälpa läkare att upptäcka sjukdomar som COVID‑19 tidigare och mer träffsäkert. Men dessa bilder är också djupt personliga, och strikta sekretessregler gör det svårt att samla data på ett ställe för att träna kraftfulla AI‑verktyg. Denna studie visar ett sätt för sjukhus att samarbeta kring ett gemensamt system för röntgendiagnostik utan att någonsin överlämna sina råa bilder, med målet att hålla patientuppgifter låsta samtidigt som man uppnår topprestanda.

Varför det är så svårt att dela medicinska data

Modern AI frodas på stora, varierade datamängder, men sjukhus lagrar vanligtvis bilder lokalt och är ovilliga — eller juridiskt förhindrade — att skicka dem till en central server. Traditionella metoder som kopierar all data till en enda stor databas riskerar läckor och cyberattacker, undergräver förtroendet och kan bryta mot regelverk. Även nyare metoder där sjukhus tränar en gemensam modell i ett upplägg kallat "federerat lärande" är inte helt säkra: skickliga angripare kan ibland återskapa patientbilder från uppdateringar av modellen. Samtidigt är medicinska data ofta ojämna och röriga, med vissa sjukhus som har många fler fall av en viss sjukdom än andra, vilket kan destabilisera träningen och minska tillförlitligheten.

Ett samarbetsnätverk som aldrig delar råa röntgenbilder

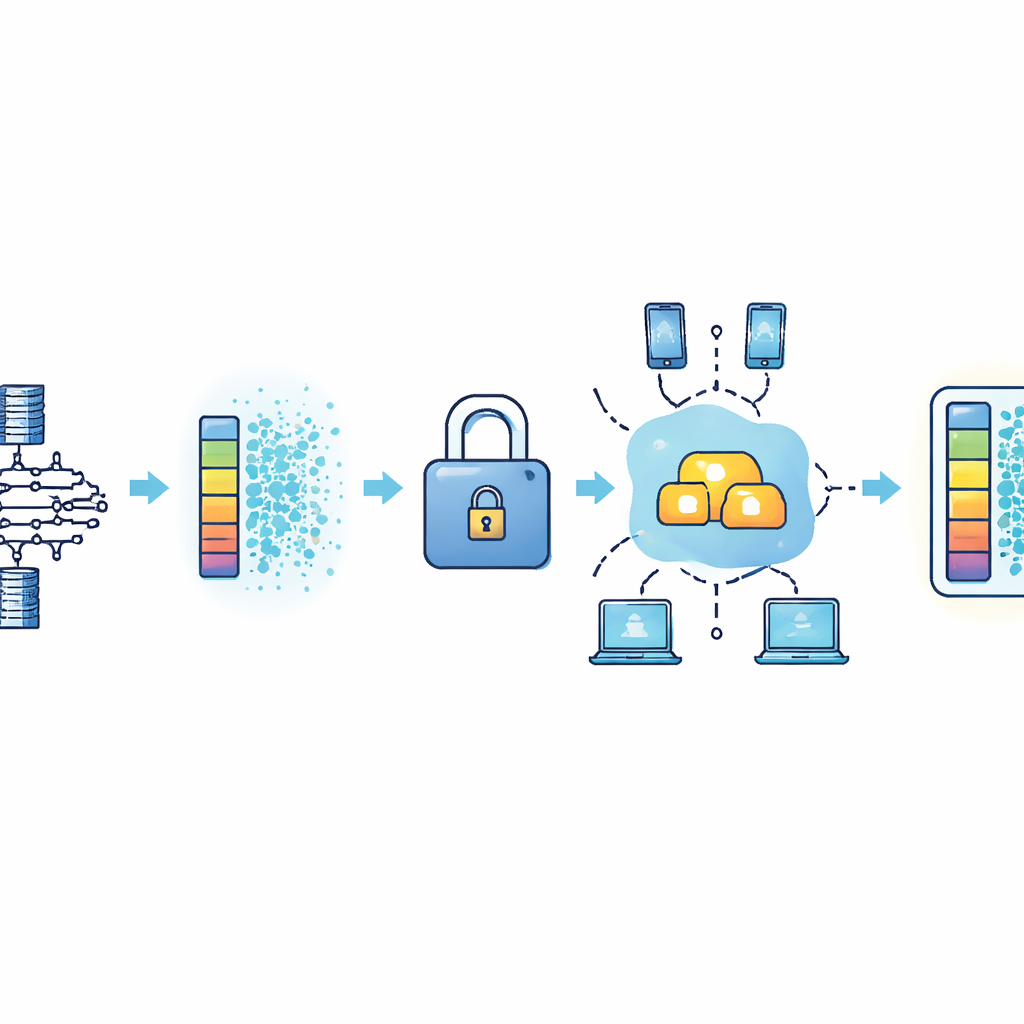

Författarna utformar ett ramverk för federerat lärande centrerat kring en stark bildigenkänningsmodell känd som ResNet‑50 för att skilja COVID‑19 från normala lung‑röntgenbilder. Varje sjukhus tränar en egen kopia av denna modell på sina lokala bilder och behåller alla röntgenbilder på plats. Istället för att skicka bilder sänder sjukhusen endast numeriska uppdateringar som beskriver hur deras lokala modell bör ändras. En central server medelvärdesbildar dessa uppdateringar för att bilda en förbättrad global modell och skickar sedan den förfinade modellen tillbaka till varje sjukhus. Genom att upprepa denna cykel kan den delade modellen dra nytta av det kombinerade erfarenhetsmaterialet från alla deltagare utan att exponera enskilda bilder.

Lägga till digitalt "brus" och skyddslådor för extra sekretess

För att förhindra att angripare återskapar patientbilder från modelluppdateringar lägger ramverket två sekretesslager ovanpå federerat lärande. Först lägger varje sjukhus till noggrant kalibrerat slumpmässigt brus i sina modelluppdateringar, lite som att lägga statiska störningar på en radiosignal så att individuella röster blir svårare att urskilja medan det övergripande budskapet fortfarande går fram. För det andra krypteras uppdateringarna innan de färdas över nätverket med en metod som tillåter servern att summera dem medan de förblir låsta — liknande att addera värden i förseglade kuvert. Endast en betrodd nyckelinnehavare kan låsa upp det kombinerade resultatet, och den centrala servern får aldrig se någon enskild sjukhus uppdatering i klartext. Tillsammans är dessa åtgärder utformade för att försvåra försök att bakåtkonstruktera patientdata samtidigt som den delade modellens användbarhet bevaras.

Att testa systemet

Teamet utvärderar sitt ramverk på en balanserad uppsättning COVID‑19 och normala lung‑röntgenbilder och simulerar flera sjukhus som separata träningsplatser. De jämför tre upplägg: klassisk centraliserad träning med alla data samlade, standard federerat lärande utan extra skydd och deras sekretessförstärkta metod. Trots det tillagda bruset och krypteringen når det skyddade systemet slående höga poäng — cirka 99,6 % noggrannhet, med liknande stark precision, recall och F1‑värden — och matchar eller överträffar både den poolade och den oskyddade federerade versionen. Mätningar av kommunikationsrundor, träningsförlust och beräkningstid visar att noggrannheten förbättras stadigt när platser samarbetar, medan den extra tidskostnaden från kryptering förblir måttlig. Ablationsstudier, där delar av systemet slås av och på, bekräftar att de valda brusnivåerna och strategin med kryptering plus kompression ger stark sekretess med endast små prestandaavvägningar.

Vad detta betyder för framtida vård

För icke‑experter är huvudbudskapet att detta arbete visar ett praktiskt recept för att lära AI från många sjukhus röntgenbilder utan att någonsin exponera råa bilder eller försvaga sekretesslagar. Genom att kombinera en högpresterande bildmodell med digitalt "brus" och krypterad aggregering visar ramverket att sjukhus gemensamt kan bygga exakta diagnostiska verktyg samtidigt som patientjournaler stannar på plats och hålls utom räckhåll för nyfikna ögon. Även om metoden testats på ett relativt litet dataset och fokuserat på COVID‑19‑röntgenbilder kan samma idéer utvidgas till andra sjukdomar, bildtyper och till och med andra känsliga områden som finans. Kort sagt pekar studien mot en framtid där kraftfull AI och stark medicinsk sekretess kan stärka snarare än motsätta sig varandra.

Citering: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Nyckelord: federerat lärande, medicinsk bildbehandling, datasekretess, homomorfisk kryptering, röntgendiagnostik