Clear Sky Science · sv

Utvärdering av AI-språkmodeller i att besvara graviditetsrelaterade frågor bedömda av obstetrikspecialister

Varför detta är viktigt för blivande föräldrar

Graviditet är en period fylld av frågor, och många vänder sig numera till nätbaserade verktyg och chattbotar för snabba svar. Denna studie ställde en enkel men viktig fråga: när det gäller vanliga graviditetsbekymmer, hur bra är dagens populära artificiella intelligens (AI)-chattbotar på att ge tydlig, korrekt och lugnande information som läkare skulle lita på?

Jämförelse av tre digitala ”svars‑motorer”

Forskare i Turkiet gav sig i kast med att jämföra tre välkända AI-språkmodeller—en tidigare version av ChatGPT (3.5), en nyare version (4.0) och Googles Gemini. De fokuserade på tio vardagliga frågor som gravida ofta ställer, till exempel vilka livsmedel man bör undvika, om träning och sex är säkra, vad tidig blödning kan innebära, hur man ska tänka kring fosterrörelser och vilka varningstecken som kräver akut vård. Varje fråga matades in i samtliga tre system med samma enkla instruktioner och inställningar justerade för att minska slumpmässighet, så att svaren skulle vara konsekventa snarare än pratsamma eller kreativa.

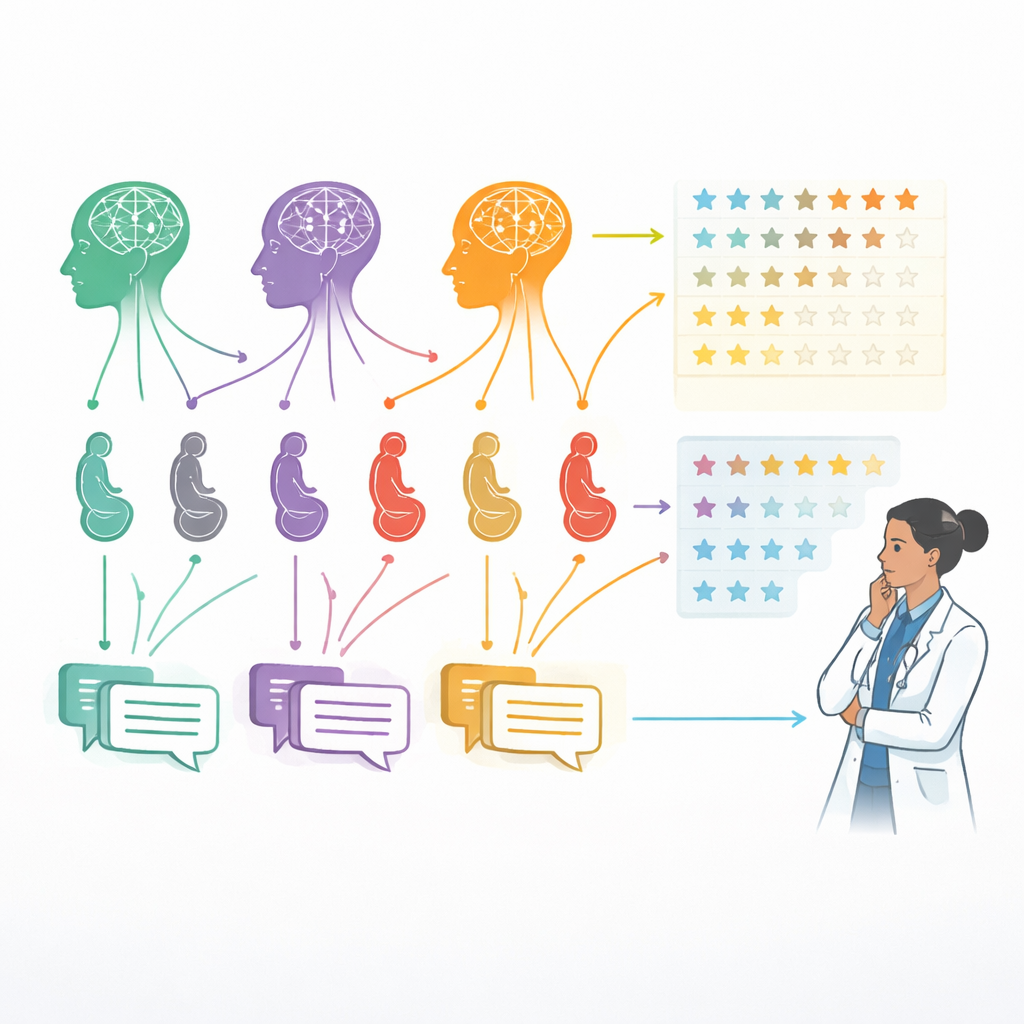

Varje modell gav ett svar per fråga, på turkiska, utan följdfrågor eller redigering. Svaren anonymiserades sedan så att inga ledtrådar avslöjade vilken modell som skrivit dem och blandades i slumpmässig ordning. På så sätt bedömde de mänskliga granskarnas—obstetrik- och gynekologspecialister—enda vad som stod på sidan, inte ett varumärke eller en stil de trodde sig känna igen.

Hur läkarna bedömde svaren

Sjuttifem obstetrikspecialister, från tidigt karriärstadium till mycket erfarna kliniker, poängsatte samtliga 30 anonymiserade svar. För varje svar använde de en femgradig skala för att värdera fyra egenskaper: korrekthet (stämmer det överens med aktuell medicinsk kunskap och riktlinjer?), tillförlitlighet (är budskapet internt konsekvent och fritt från osäker eller farlig rådgivning?), patientvänlighet (är tonen lämplig och lugnande för icke-experter?) och begriplighet (är språket klart, välstrukturerat och lätt att följa?). Totalt gav experterna 9 000 individuella bedömningar—en stor datamängd som gjorde det möjligt för forskarna att upptäcka meningsfulla skillnader mellan de tre AI-verktygen.

Teamet använde sedan statistiska metoder avsedda för skattningsskalor för att jämföra modellerna. De kontrollerade också hur konsekvent olika läkare bedömde samma svar och undersökte om mer erfarna kliniker gav annorlunda poäng än sina yngre kollegor. Målet var inte att bygga en fungerande chattbot, utan att ta ett noggrant ögonblicksfoto av hur dessa system beter sig under kontrollerade förhållanden när de besvarar realistiska graviditetsfrågor.

Vilken chattbot var bäst?

Överlag kom den nyare ChatGPT-4.0 ut i topp. Läkare bedömde dess svar som mest korrekta och mest patientvänliga, och den presterade också bäst vad gäller tillförlitlighet. Gemini hamnade oftast i mitten: dess svar var ofta tydliga och lätta att läsa, och när det gäller ren begriplighet var den lik ChatGPT-4.0, men den tenderade att vara något mindre detaljerad och precis. ChatGPT-3.5, den äldre modellen, fick konsekvent de lägsta poängen och gav ofta kortare eller mindre fullständiga förklaringar. Intressant nog var alla tre modellerna mer lika när det gällde grundläggande klarhet och struktur, vilket antyder att det kan vara enklare att göra text läsbar än att säkerställa att varje medicinsk detalj är korrekt och välavvägd.

Läkarnas bedömningar var mycket konsekventa sinsemellan, vilket indikerar att resultaten inte drevs av några få avvikande åsikter. Det fanns en måttlig tendens att mer erfarna kliniker gav något högre poäng för tillförlitlighet i stort, men deras uppfattningar skilde sig inte mycket vad gäller hur vänliga eller lätta att förstå svaren var.

Vad detta betyder i verklig användning

För en lekmannaläsare är slutsatsen att moderna AI-verktyg—särskilt ChatGPT-4.0—redan kan ge graviditetsinformation som många obstetrikspecialister bedömer som relativt korrekt, säker och lättläst. Samtidigt understryker studien en viktig gräns: även det bäst presterande systemet är inte en läkare. Forskarna jämförde inte chattbotsvaren med officiella riktlinjer som ”gylstandard”, och de testade inte hur patienter faktiskt tolkar eller agerar på råden. Eftersom arbetet utfördes helt på turkiska kan prestanda i andra språk och kulturer skilja sig åt.

Enkelt uttryckt kan dessa AI-chattbotar vara hjälpsamma följeslagare för att lära sig om graviditet, särskilt när ett vårdbesök ligger långt bort eller tiden med vårdgivaren är knapp. De kan stödja, men bör inte ersätta, samtal med vårdpersonal. Författarna betonar att expertgranskning fortfarande är nödvändig för att fånga fel, undvika falsk trygghet och försäkra att nyanserade eller högrisk‑situationer får den personliga, fysiska vård de kräver.

Citering: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Nyckelord: graviditetsutbildning, AI-chattbotar, hälsoråd på nätet, obstetrik, kvalitet på patientinformation