Clear Sky Science · sv

Att behandla balansen mellan rättvisa och prestanda vid förutsägelse av gliomgrad med tekniker för att mildra bias

Varför det spelar roll att behandla tumörer rättvist

När läkare använder artificiell intelligens för att hjälpa till vid diagnostik av hjärntumörer kan vi lätt anta att datorn är neutral. Men om de data som används för att träna dessa verktyg speglar befintliga hälsoskillnader kan programvaran i praktiken behandla vissa patienter mindre rättvist än andra. Denna studie undersöker hur maskininlärningssystem som förutser svårighetsgraden hos gliom — en vanlig typ av vuxenhjärntumör — oavsiktligt kan favorisera vissa rasmässiga eller könsgrupper, och testar praktiska sätt att göra dessa förutsägelser rättvisare utan att offra för mycket noggrannhet.

Hjärntumörer och datorstöd

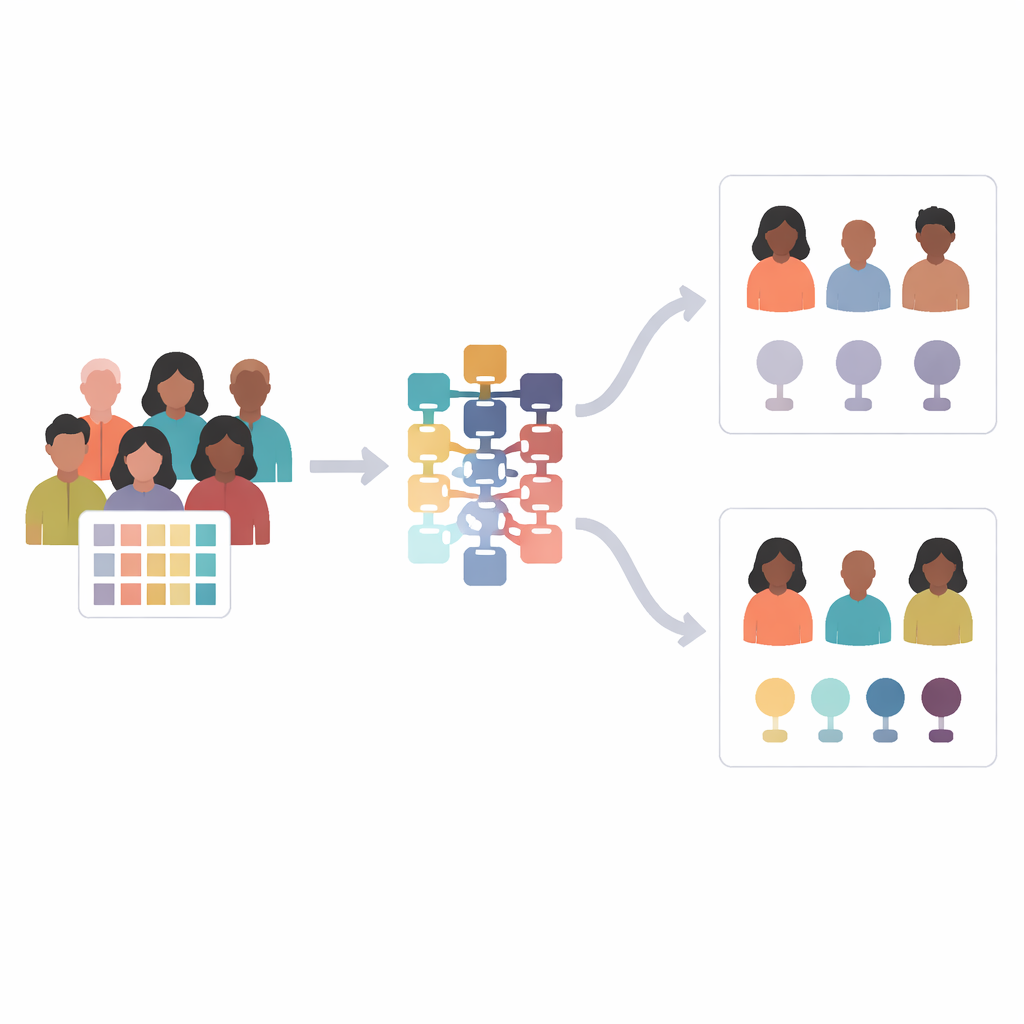

Gliom är hjärntumörer som sträcker sig från långsamt växande, mer behandlingsbara former till mycket aggressiva cancerformer med dålig överlevnad. Korrekt gradbestämning av dessa tumörer är avgörande, eftersom den styr kirurgi, strålbehandling och läkemedelsbehandling. Forskarna arbetade med en publik datamängd bestående av 839 vuxna med antingen låggradigt gliom eller aggressivt glioblastom. För varje patient hade de ålder, kön, ras och 20 vanliga genetiska markörer i tumören. De tränade tre standardprediktionsmodeller — logistisk regression, random forests och gradient boosting — för att skilja de två tumorgraderna åt med hjälp av dessa egenskaper, och utvärderade både hur precisa modellerna var totalt sett och hur väl de behandlade olika patientgrupper.

Letande efter dold obalans

För att undersöka rättvisa fokuserade teamet på två ”skyddade” egenskaper: ras (vit vs. icke-vit) och kön (man vs. kvinna). Datamängden i sig var snedvriden — mer än 90 procent av patienterna var vita, och det fanns märkbart fler män än kvinnor. Författarna använde gruppnivåmått för rättvisa som jämför hur ofta olika grupper får en korrekt förutsägelse om höggradig tumör, och hur ofta modellen gör fel för respektive grupp. Alla tre modellerna var ganska exakta totalt sett, där logistisk regression presterade bäst. Men under den framgången avslöjade rättvisekontroller att icke-vita patienter generellt hade sämre resultat än vita patienter, särskilt när det gällde att korrekt identifiera de mindre aggressiva tumörerna. I kontrast var prestandan för män och kvinnor mycket mer balanserad, med bara små skillnader mellan könen.

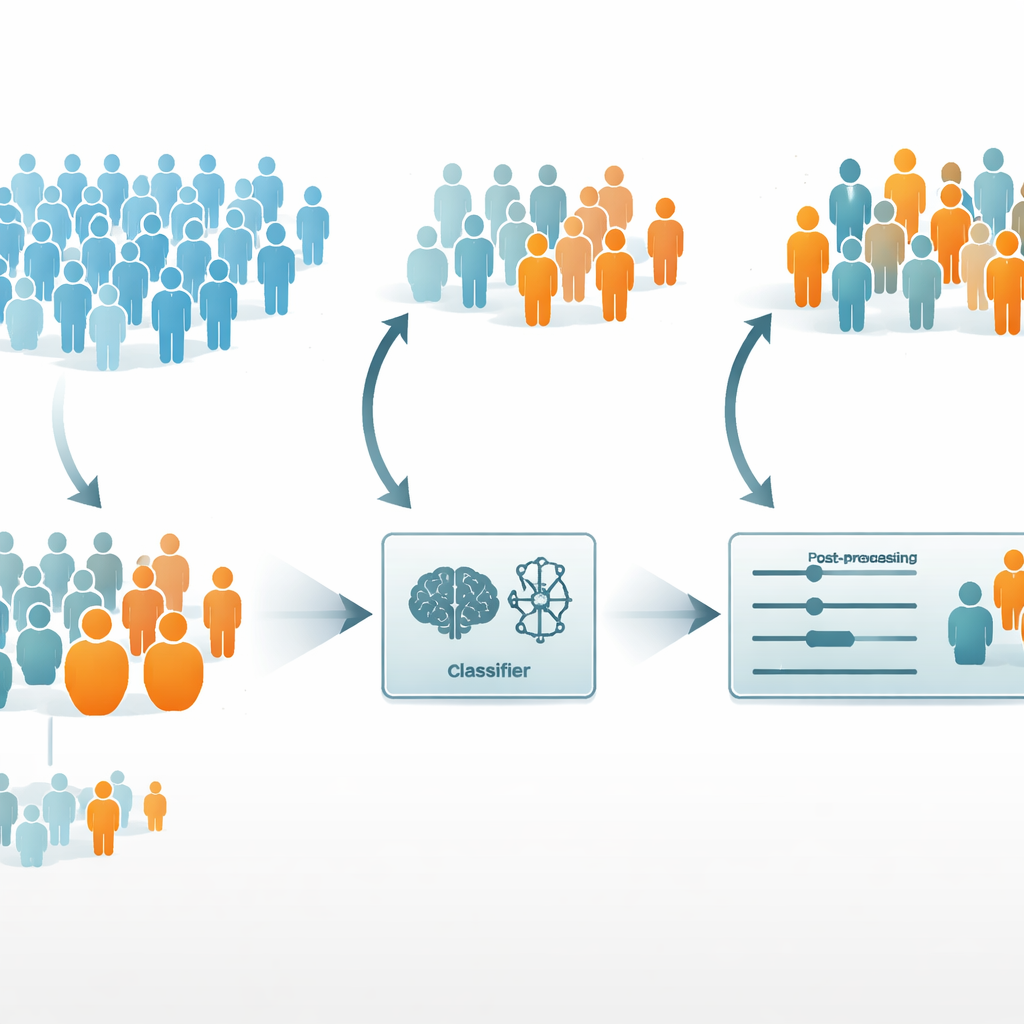

Försök att åtgärda bias

Forskarna frågade sedan om de kunde förbättra rättvisan utan att allvarligt försvaga modellens medicinska användbarhet. De valde logistisk regression som basmodell, eftersom den var både mest exakt och mest rättvis av de tre. De provade två vanliga metoder för att minska bias. Ett ”förbehandlings”angreppssätt kallat reweighting gav extra vikt åt underrepresenterade patienter under träningen, så att modellen skulle fästa större vikt vid dem. Ett ”efterbehandlings”angreppssätt kallat equalized odds behöll den tränade modellen men justerade dess utdata så att felaktighetsgrader blev mer lika över grupperna.

Vad som förändrades när modellen justerades

För kön hjälpte båda strategierna i allmänhet: förutsägelsekvaliteten för kvinnor förbättrades och skillnaderna mellan män och kvinnor krympte till stor del. För ras, där obalansen i data var mycket större, var bilden mer komplicerad. Reweighting slog ibland fel och förvärrade något prestandan för icke-vita patienter och ökade till och med orättvisor enligt vissa mått. Däremot minskade efterbehandlingsmetoden avsevärt de rasrelaterade skillnaderna i felgrader samtidigt som modellens totala noggrannhet förblev hög, även om den något försämrade prestandan för majoritetsgruppen. Författarna visade också att rättvisesiffror för den mycket mindre icke-vita gruppen är statistiskt instabila — att ändra bara en persons förutsägelse kan märkbart skifta rättvisemåtten — så dessa resultat måste tolkas med försiktighet.

Vad detta betyder för patienter och läkare

Studien slutar i att det inte finns någon gratislunch: att förbättra rättvisa i medicinsk AI innebär ofta avvägningar i prestanda, och den bästa åtgärden beror på hur snedvridna data är och vilken rättvisemålsättning som prioriteras. I detta exempel med hjärntumör var det mest praktiskt att justera modellens utdata efter träning för att göra behandlingsrekommendationerna mer jämlika över ras och kön, samtidigt som stark prediktiv kraft bevarades. Arbetet betonar att rättvisekontroller bör vara rutin när AI införs i vården, särskilt för allvarliga tillstånd som gliom, och att metoder finns för att göra dessa verktyg rättvisare — men att de måste väljas och tolkas med omsorg.

Citering: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Nyckelord: gliomgradering, AI-rättvisa inom medicin, algoritmisk bias, hjärntumörer, åtgärder mot bias