Clear Sky Science · sv

Detektion av neonatal gulsot med en djupinlärningsmodell baserad på vision transformer

Varför detta är viktigt för nyblivna föräldrar

De flesta nyfödda utvecklar någon grad av gulfärgning i huden, kallad gulsot. Vanligtvis bleknar den av sig själv, men hos vissa spädbarn kan höga nivåer av pigmentet bilirubin skada hjärnan om det inte upptäcks i tid. I dag kräver kontroll av bilirubin ofta ett stick i fingret eller en dyr sängkantsenhet. Denna studie undersöker om en vanlig smartphone, i kombination med en ny typ av artificiell intelligens, kan erbjuda ett lågkostnads- och icke-invasivt sätt att tidigt upptäcka riskfylld gulsot—särskilt på sjukhus och kliniker som saknar avancerad utrustning.

Den dolda risken bakom en vanlig gul ton

Gulsot drabbar långt över hälften av fullgångna nyfödda och ännu fler prematura barn. Den visar sig som en gulaktig färg i huden och ögonvitorna när bilirubin ansamlas i blodet. Lindriga fall är ofarliga, men svåra eller oupptäckta fall kan leda till en form av hjärnskada som kallas kernicterus, bestående funktionsnedsättning eller till och med död. Standardvård bygger på visuell inspektion följt av blodprov eller specialmätare som hålls mot huden. Dessa metoder fungerar, men de är subjektiva, invasiva, långsamma eller kostsamma—hinder som är särskilt allvarliga i trånga eller resurssvaga vårdmiljöer där många spädbarn måste screenas snabbt.

Att förvandla en telefonkamera till ett vårdverktyg

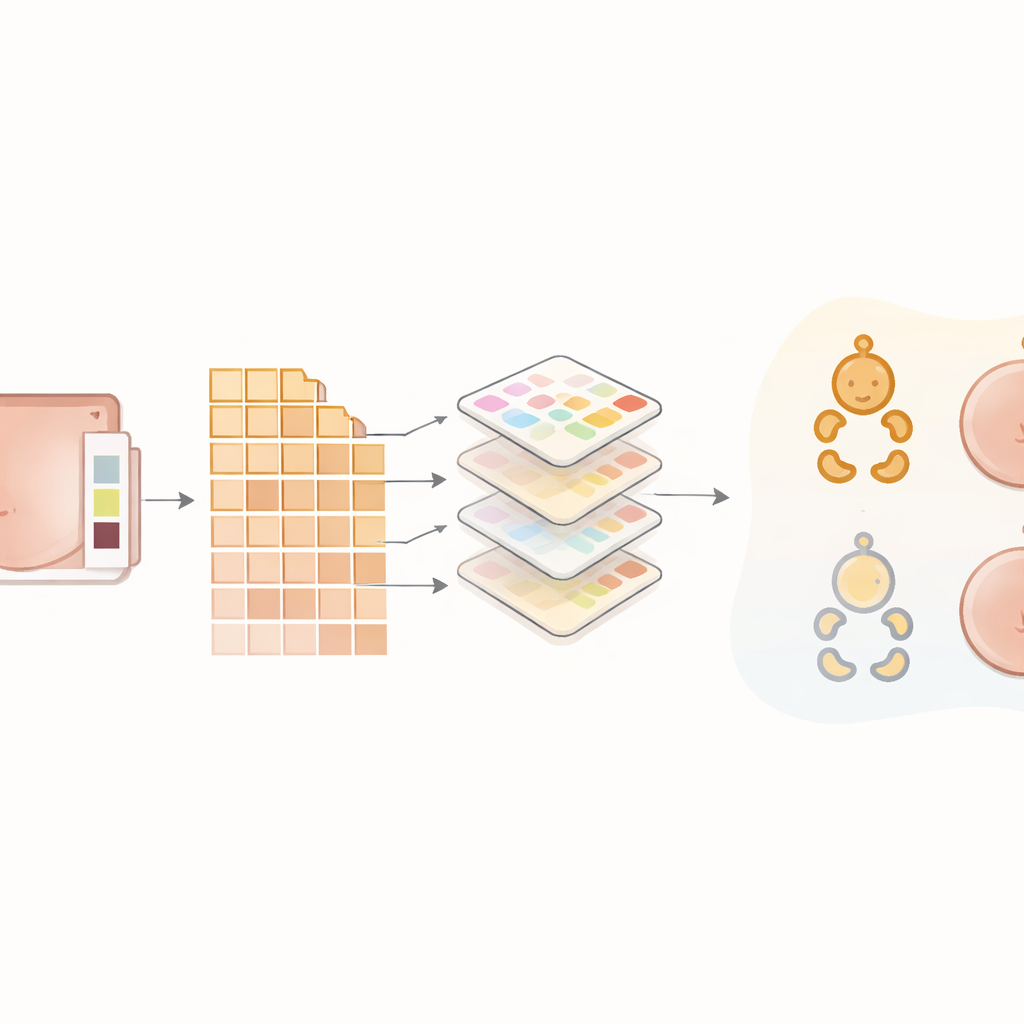

Forskarna ville bygga en praktisk screeningskedja som enbart använder en smartphonekamera och en modern AI-modell. De rekryterade 500 nyfödda vid ett barnsjukhus i Teheran, Iran, och fotograferade tre kroppsregioner—ansikte, buk och innerarm—med en iPhone monterad på ett stativ i ett rum med noggrant kontrollerad belysning. Ett färgkort med många färgrutor placerades intill barnets hud i varje bild för att standardisera färger mellan bilderna. Nära i tid togs också rutinmässiga blodprover för att mäta bilirubin; läkare använde dessa värden för att märka varje barn som gulsott eller inte, vilket skapade en pålitlig referens för träning och testning av algoritmerna.

Rengöring och fokusering av bilderna

Innan någon AI-modell fick se bilderna genomgick teamet en noggrann reningsprocess. Bilder av låg kvalitet med oskärpa eller dålig inramning ratades, och de återstående fotona sparades i högkvalitativt format för att bevara subtila färgskillnader. Datorrutiner justerade sedan bilderna med hjälp av färgkortet som referens, ökade lokal kontrast för att göra små förändringar i hudton mer synliga och omvandlade färger till former som hjälper till att separera hud från bakgrund. Ett semiautomatiskt steg isolerade släta, jämnt belysta hudpartier och beskärde dem till standardiserade små kvadrater. För att lära modellerna hantera naturlig variation skapade forskarna även modifierade versioner av vissa träningsbilder—lätt roterade, spegelvända eller ljusare—utan att ändra deras medicinska innebörd.

Hur den nya AI:n står sig mot äldre metoder

Studiens kärna är en modell kallad vision transformer, anpassad från verktyg som ursprungligen utformats för att förstå komplexa mönster i bilder. Till skillnad från traditionella konvolutionsneuronätverk, som mest undersöker små pixelgrannskap, lär sig transformern att uppmärksamma både små detaljer och bredare mönster i bilden. Författarna tränade denna modell, kallad T2T‑ViT, att avgöra om varje hudbeskärning kom från ett gulsott eller icke-gulsott barn. De jämförde dess prestanda direkt med tre etablerade metoder: ett populärt djupt nätverk känt som ResNet‑50 och två klassiska maskininlärningstekniker, support vector machines och k‑nearest neighbors, som förlitade sig på enkla färgstatistiker snarare än råa bilder. På en oberoende testuppsättning klassificerade transformern i stort sett varje fall korrekt och nådde ungefär 99 % för noggrannhet, sensitivitet och specificitet. Den överträffade tydligt de andra metoderna, som felklassificerade fler barn och särskilt hade svårt med gränsfall av gulsot.

Löften och verkliga utmaningar

Dessa resultat tyder på att under kontrollerade förhållanden kan en smartphone plus en vältränad transformermodell matcha eller överträffa betydligt dyrare verktyg för att identifiera nyfödda som kan behöva närmare övervakning eller behandling. Systemet är tillräckligt lättviktigt för att köras på konsumenthårdvara och använder bilder som vilken utbildad sjuksköterska eller tekniker som helst kan ta, vilket gör det attraktivt för upptagna kliniker eller regioner med begränsade resurser. Författarna betonar dock viktiga förbehåll: all data kom från ett enda sjukhus, en telefonmodell och till största delen iranska spädbarn, och experter förfinade manuellt vilka hudområden som skulle analyseras. För verklig användning krävs tester över många sjukhus, telefonmodeller, ljusförhållanden och hudtoner, samt automatisering av fler steg i bildvalet.

Vad detta kan innebära för vård av nyfödda

Enkelt uttryckt visar studien att en telefonkamera, styrd av en avancerad AI som är känslig för mycket små färgskiftningar, nästan alltid kan avgöra vilka nyfödda som har kliniskt betydelsefull gulsot. Om framtida arbete bekräftar dessa fynd i mer varierade miljöer kan detta tillvägagångssätt bli en snabb, smärtfri "förstagranskning" som hjälper till att avgöra vilka barn som behöver blodprov eller behandling och vilka som säkert kan åka hem. För familjer och vårdpersonal kan det innebära färre stick i huden, lägre kostnader och, viktigast av allt, tidigare skydd mot en förebyggbar form av hjärnskada.

Citering: Lotfi, M., Rabiee, M., Nazarpak, M.H. et al. Neonatal jaundice detection using a vision transformer-based deep learning model. Sci Rep 16, 9243 (2026). https://doi.org/10.1038/s41598-026-40515-5

Nyckelord: neonatal gulsot, screening med smartphone, medicinsk bildanalys AI, vision transformer, nyföddas hälsa