Clear Sky Science · sv

Kameraursprungssbestämning med en regelbaserad förklarbar konvolutionell neuronnätverksmetod

Varför dina foton kan säga mer än du tror

Varje bild du tar bär på dolda ledtrådar om kameran som fångade den. För digitala utredare kan dessa ledtrådar hjälpa till att bekräfta om en bild är äkta, spåra vilken enhet den kom från eller koppla ihop bilder från olika brottsplatser. Idag kan kraftfulla artificiella intelligensverktyg (AI) upptäcka sådana mönster bättre än människor — men de fungerar ofta som mystiska »svarta lådor«. Denna artikel presenterar ett sätt att öppna den lådan: en regelbaserad metod som förklarar hur en djupinlärningsmodell avgör vilken kamera som tog en bild, i en form som en mänsklig granskare kan förstå och lita på.

Problemet med att lita på smarta forensiska verktyg

Modern digital forensik måste sålla igenom stora datamängder — från smartphones, molnbackupper och sociala medier — långt mer än vad en mänsklig analytiker kan granska manuellt. Djupinlärningssystem kan snabbt markera bilder eller föreslå vilka som är viktiga, men deras inre funktioner är ökända för att vara ogenomskinliga. I känsliga sammanhang som domstolar räcker det inte att säga »nätverket tror så«. Befintliga förklaringsverktyg framhäver vanligtvis bildregioner som modellen fann viktiga, vilket är användbart för uppgifter som att känna igen ansikten eller objekt. För källkamerainidentifiering är dock den avgörande signalen inte en synlig egenskap utan ett svagt sensorfingeravtryck — subtila brusmönster som människor inte kan se. Därför visar dagens visuella förklaringsverktyg inte tydligt varför en modell anser att en bild kommer från en viss kamera, och de hjälper inte granskare att upptäcka när modellen har fel.

En ny metod för att följa ett neuronnäts resonemang

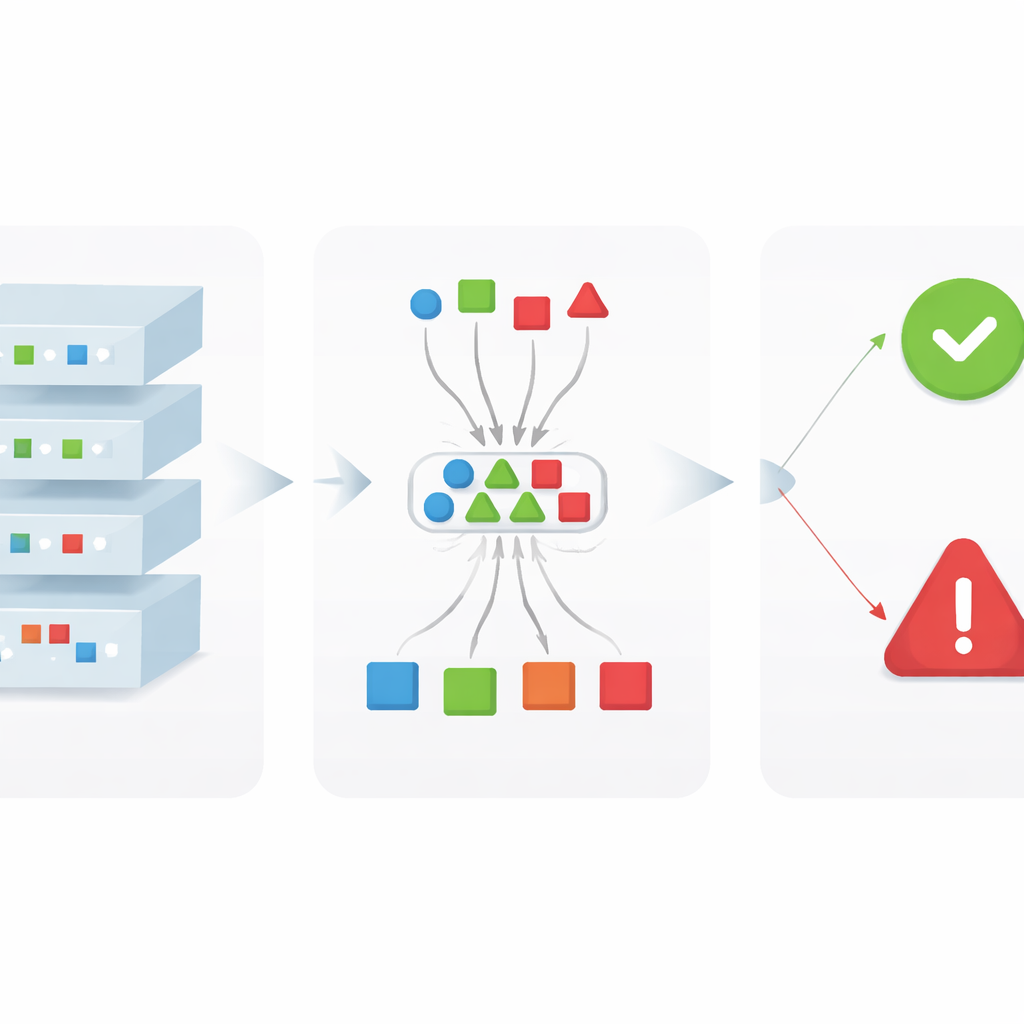

Författarna introducerar xDFAI, ett ramverk speciellt utformat för digital forensik som förklarar hur ett konvolutionellt neuronnät (CNN) når sina beslut utan att ändra den ursprungliga modellen. Istället för att behandla nätverket som en enda ogenomskinlig låda undersöker xDFAI det lager för lager. För varje lager och varje kameraklass identifierar det ett set återkommande interna mönster, kallade »spår«, som konsekvent aktiveras när modellen tror att en bild tillhör den kameran. Dessa spår extraheras från en tränad modell med hjälp av befintliga attribueringsmetoder och filtreras sedan för att bara behålla mönster som uppträder pålitligt över många träningsbilder. Tillsammans bildar dessa spår en strukturerad karta över hur ledtrådar om kameraidentitet utvecklas när bilden passerar genom nätverket.

Låta lagren rösta och omvandla röster till regler

När spåren är kända använder xDFAI dem för att granska nya, osedda bilder. För ett givet testfoto mäter ramverket hur lika dess interna aktiveringar är de lagrade spåren för varje kamera i varje lager. Varje lager avgörs därmed rösta på de kameramodeller vars spår det matchar mest. En tvär-lagers »majoritetsomröstning« summerar sedan hur starkt nätverket som helhet understöder varje kandidatkamera. Viktigt är att författarna inte använder denna omröstning för att ersätta modellens prediktion; istället används den som en kontroll. Enkla logiska regler jämför majoritetsrösten med den ursprungliga prediktionen: om den förutspådda kameran också får starkt stöd från många lager bekräftas beslutet; om rösterna är splittrade eller favoriserar en annan kamera flaggas beteendet som onormalt och visas för granskaren som ett potentiellt modelelleringsfel.

Sätta ramverket på prov

För att demonstrera xDFAI tillämpar författarna det på ett sjustegs-CNN tränat för att identifiera vilken av 27 kameramodeller som fångat en bild, med hjälp av en välkänd forensisk datamängd. Bas-CNN:en presterar redan mycket bra ensam och klassificerar korrekt ungefär 97 % av testbilderna. När xDFAI:s regler appliceras ovanpå flaggar systemet automatiskt 27 av de 37 felaktiga prediktionerna som misstänkta. De flaggade fallen räknas inte längre som säkra identifieringar, vilket höjer precisionen — andelen accepterade beslut som faktiskt är korrekta — från 97,33 % till 99,2 %, samtidigt som den totala noggrannheten bara minskar något. För forensiskt arbete, där en enstaka felaktig tillskrivning kan få allvarliga konsekvenser, är denna kompromiss mycket önskvärd: färre falska slutsatser bland de uttalanden som analytikerna väljer att lita på.

Vad detta betyder för verkliga utredningar

Denna studie visar att det är möjligt att behålla full kraft i en modern djupinlärningsmodell samtidigt som man lägger till människovänliga förklaringar som respekterar forensiska integritetsprinciper — ingen omträning, ingen manipulation av den ursprungliga modellen och inget ensidigt beroende av vaga värmekartor. Genom att exponera stabila interna spår, aggregera dem genom ett transparent röstningsschema och uttrycka resultatet som enkla regler ger xDFAI granskare ett sätt att bekräfta eller ifrågasätta AI-genererade kameratillskrivningar. Även om studien fokuserar på källkameraidentifiering kan samma idéer utvidgas till andra forensiska tillskrivningsuppgifter. På lång sikt kan sådana metoder bidra till att överbrygga klyftan mellan högprecisa AI-system och den nivå av transparens och tillförlitlighet som krävs i domstolar och i praktiskt utredningsarbete.

Citering: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Nyckelord: digital forensik, förklarbar AI, kameraidentifiering, konvolutionella neuronnätverk, bildforensik