Clear Sky Science · sv

En integrerad ram för proaktiv motverkning av deepfakes via uppmärksamhetsstyrd vattenmärkning och blockchain‑baserad äkthetsverifiering

Varför förfalskade videor är alla problem

Videor som ser och låter verkliga kan nu förfalskas med standardprogram, vilket suddar ut gränsen mellan sanning och fiktion online. Dessa så kallade deepfakes används redan för bedrägerier, trakasserier och politiska manipulationer. Istället för att försöka upptäcka förfalskningar efter att de spridits ställer denna studie en annan fråga: vad om vi tyst kunde skydda äkta videor i det ögonblick de skapas, så att senare manipulation blir uppenbar?

Från att jaga fejk till att skydda original

De flesta nuvarande studier försöker fånga deepfakes i efterhand, genom att träna algoritmer att upptäcka små fel spår som generativa modeller lämnar. Men när dessa modeller förbättras blir detta katt‑och‑råtta‑spel svårare att vinna. Författarna argumenterar för en proaktiv strategi: skydda autentiskt material när det spelas in, så att tittare och plattformar senare kan verifiera om det de ser är det orörda originalet. Deras ramverk kombinerar tre lager: en smart videoanalysator som avgör var skydd är viktigast, ett osynligt digitalt märke invävt i varje bildruta och en blockchain‑post som låser filens identitet som helhet.

Lära systemet vad som verkligen betyder något i en video

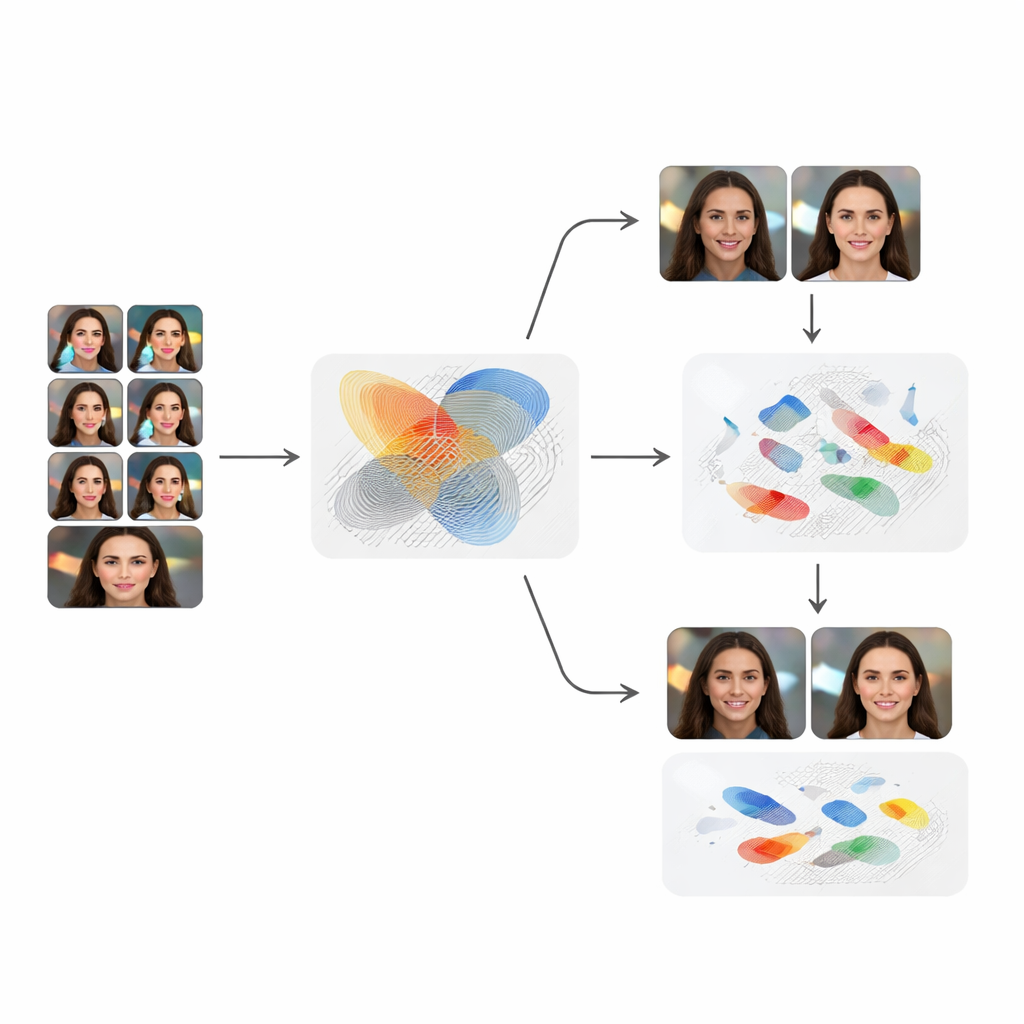

Det första lagret är en uppmärksamhetsmodell som lär sig vilka delar av en video som bär den mest betydelsefulla rörelsen och detaljen över tid. Teamet tränar ett kompakt men kraftfullt nätverk på tusentals vardagliga klipp med människor i handling. En del av nätverket betraktar varje bildruta som ett stillfoto, medan en annan del ser hur saker rör sig över 16‑rutessekvenser. Tillsammans når de över 97 % noggrannhet på ett standardtest för aktivitetsigenkänning, vilket visar att systemet lärt sig rika mönster för hur människor och scener förändras över tid. Dessa mönster omvandlas sedan till uppmärksamhetskartor som markerar regioner där manipulation mest skulle påverka den berättelse videon förmedlar.

Gömma ett hemligt märke där förfalskare gör mest skada

Nästa steg är att ett osynligt digitalt märke — en vattenstämpel — bäddas in i varje bildruta, men inte på ett enkelt, jämnt sätt. Ett generativt nätverk skapar ett subtilt, brusliknande mönster som blandas in starkare i regioner som uppmärksamhetsmodellen flaggar som viktiga, som ansikten eller rörliga händer, och svagare på andra ställen för att bevara visuell kvalitet. Tittare märker ingen skillnad, och kvalitetspoäng bekräftar att de märkta bildrutorna nästan är omöjliga att skilja från originalen. Ändå är mönstret tillräckligt starkt och komplext för att ett följeslagarnätverk, tränat som en slags avkodare, senare ska kunna återvinna den dolda signaturen från äkta material, ruta för ruta.

Sätta deepfakes och vardagliga förvrängningar på prov

För att se om detta skydd håller i verkliga världen genomför författarna en serie stresstester. De vattenmärker först ett varierat urval korta stockvideor och matar dem sedan in i DeepFaceLab, ett av de mest använda verktygen för ansiktsbyte, för att skapa trovärdiga deepfakes. I samtliga 50 manipulerade klipp förstörs eller kraftigt förvrängs det dolda märket, och systemet flaggar korrekt videon som manipulerad. Metoden står sig också väl mot vanliga bearbetningssteg som tung omkomprimering, omskalning och oskärpning som ofta uppstår när klipp delas online, även om mycket starkt slumpmässigt brus så småningom kan överväldiga den dolda signalen. Noggranna experiment visar att både uppmärksamhetsstyrningen och användningen av rörelse över tid är avgörande; att ta bort någon av komponenterna försvagar skyddet märkbart.

Låsa in förtroende med ett permanent fingeravtryck

Det sista lagret går bortom bildrutornas innehåll och säkrar själva videofilen. Efter vattenmärkning körs hela filen genom en kryptografisk funktion som producerar ett kort digitalt fingeravtryck. Det fingeravtrycket, tillsammans med grundläggande information om klippet, skrivs till en blockchain‑bokföring där det inte kan ändras utan att lämna spår. Senare kan vem som helst ladda upp en kopia av videon: systemet försöker återvinna vattenmärket och räknar även om fingeravtrycket. Om både det dolda märket och det kryptografiska fingeravtrycket matchar originalposterna kan videon behandlas som autentisk med hög tillförsikt; om någon av dem misslyckas vet tittarna att materialet ändrats.

Vad detta betyder för de videor du ser

Enkelt uttryckt visar detta arbete att vi kan skifta från att gissa om en video är falsk till att bevisa att en video är äkta. Genom att tyst väva in ett intelligent, svårt att förfalska märke i de mest meningsfulla delarna av varje bildruta och stödja det med en manipulationssäker bokföringspost fångar ramverket alla testade ansiktsbytesattacker och överlever många vardagliga förvrängningar. Även om det fortfarande kämpar under extremt visuellt brus och behöver bredare testning pekar det mot en framtid där kameror, plattformar och redaktioner kan leverera videor med inbyggd bevisning av äkthet — vilket gör det mycket svårare för deepfakes att passera som sanning.

Citering: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Nyckelord: skydd mot deepfakes, videons äkthet, digital vattenmärkning, blockchain‑verifiering, mediesäkerhet