Clear Sky Science · sv

Robust platsigenkänning vid ljusförändringar med pseudo-LiDAR från omnikomprimerade bilder

Robotar som aldrig går vilse i mörkret

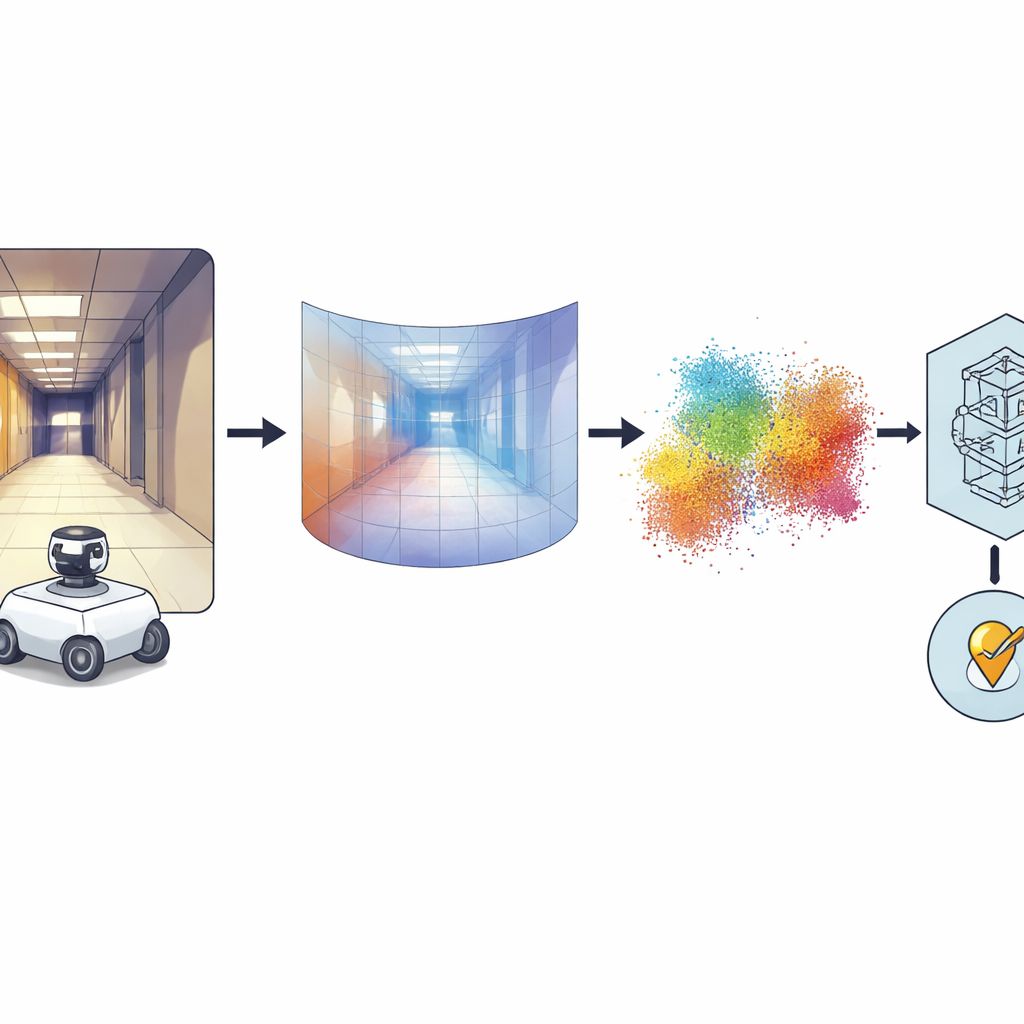

Tänk dig en robot som kan känna igen var den befinner sig i en byggnad, oavsett om det är mitt på dagen med solljus som strömmar genom fönstren eller sent på kvällen med bara några lampor tända. Denna artikel presenterar ett nytt sätt att ge robotar den typen av tillförlitlig platsuppfattning med en enda, relativt billig kamera. Genom att omvandla plana bilder till 3D-information blir robotnavigation mycket mindre känslig för skuggor, bländning och andra svåra ljusförändringar som vanligtvis ställer till problem för visionsbaserade system.

Varför det är svårt att känna igen samma plats två gånger

För en robot innebär ”platsigenkänning” att inse ”Jag har varit här förut”, så att den kan lokalisera sig på en karta och navigera säkert. Traditionella system förlitar sig antingen på vanliga kameror eller lasermätare kända som LiDAR. Kameror är billiga och fångar rik färg och struktur, men deras bild förändras drastiskt mellan molnigt, soligt och nattligt ljus. LiDAR är mycket mer stabilt eftersom det mäter avstånd direkt, men det är skrymmande och kostsamt. Vissa robotar kombinerar flera sensorer, men det höjer priset och komplexiteten. Författarna till detta arbete väljer en annan väg: de håller hårdvaran enkel och använder endast en omnidirektionell kamera som ser runt roboten, och förbättrar istället mjukvaran så att roboten resonerar om 3D-struktur i stället för rått utseende.

Från omgivande bilder till 3D-former

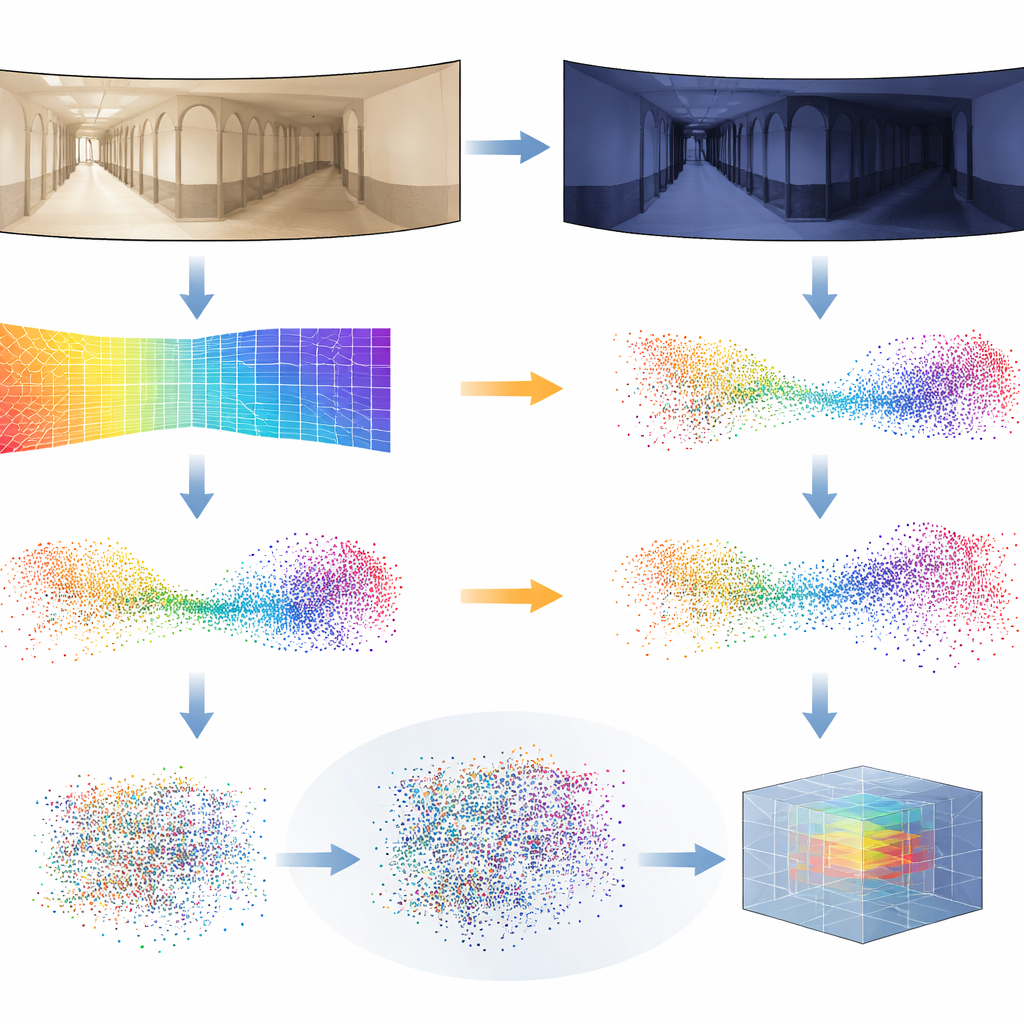

Huvudidén är att omvandla varje panoramabild till en tät djupbild där varje pixel kodar hur långt den delen av scenen ligger från kameran. För detta förlitar sig författarna på en kraftfull ”foundational” modell kallad Distill Any Depth, som har lärt sig att härleda djup från enorma bildsamlingar. Den resulterande djupkartan omvandlas sedan till ett moln av 3D-punkter—en slags virtuell LiDAR, eller pseudo-LiDAR—utan att behöva en riktig laserskanner. Ytterligare bearbetning rengör artefakter som introducerats av den speciella spegeln som används för 360-graderskameran, så att saknade eller ockluderade regioner fylls i. Slutligen komprimerar ett neuralt nätverk kallat MinkUNeXt, designat för att arbeta direkt på 3D-punktmoln, varje moln till ett kompakt fingeravtryck som fångar platsens övergripande layout.

Att lära systemet att ignorera ljustricks

Djupuppskattningar är inte perfekta, särskilt när ljuset förändras drastiskt mellan tillfällen. För att göra systemet robust introducerar forskarna ett nytt träningsknep som de kallar Distilled Depth Variations. I stället för att lita på en enda djupmodell blandar de medvetet in djupförutsägelser från flera mindre, mindre exakta versioner av djupestimatorsmodellen. Denna kontrollerade ”brusning” efterliknar de typer av förvrängningar som uppstår under olika ljusförhållanden och tvingar 3D-nätverket att lära sig vad som verkligen är viktigt för en plats geometri och vad som säkert kan ignoreras. De berikar också varje 3D-punkt med information om bildkanter och texturstyrka—egenskaper som tenderar att vara mer stabila över ljusförändringar än rå färg.

Bevis för att det fungerar i verkligheten

För att testa sin metod vände teamet sig till krävande offentliga dataset med inomhusrobotresor. I dessa samlingar rör sig en robot genom korridorer och rum flera gånger under molnigt dagsljus, starkt solsken och på natten, samtidigt som möbler och människor förflyttar sig. Författarna tränade sitt system med endast molniga bilder från en byggnad och utvärderade det sedan över alla byggnader och ljusförhållanden, inklusive scener det aldrig sett tidigare. Deras pseudo-LiDAR-metod matchade konsekvent eller överträffade ledande 2D-bildbaserade tekniker och andra 3D-system, särskilt i de tuffaste fallen som nattkörningar eller överföringar till helt nya miljöer. De visade också att samma pipeline fungerar med vanliga framåtriktade kameror, inte bara panoramiska, genom att byta in lämplig projektion från djup till 3D.

Vad detta betyder för framtidens robotar

I praktiska termer visar detta arbete att en robot kan få LiDAR-liknande medvetenhet om sin omgivning med endast en enda kamera och smart mjukvara. Genom att fokusera på 3D-struktur istället för de opålitliga detaljerna i ljus och färg kan systemet känna igen platser pålitligt över dag-, natt- och väderförändringar, samtidigt som hårdvaran hålls enkel och prisvärd. Detta kan göra robust inomhusnavigering mer tillgänglig för servicerobotar, lagerfordon och hjälpmedel, och öppnar dörren för framtida system som blandar djup med högre nivåers scenförståelse för ännu mer tillförlitlig autonomi.

Citering: Cabrera, J.J., Alfaro, M., Gil, A. et al. Robust place recognition under illumination changes using pseudo-LiDAR from omnidirectional images. Sci Rep 16, 8817 (2026). https://doi.org/10.1038/s41598-026-39848-y

Nyckelord: robotlokalisering, 3D-syn, platsigenkänning, djupuppskattning, omnidirektionella kameror