Clear Sky Science · sv

Kalibrering av djupa klassificerare med dynamisk konfidenspropagering och adaptiv normalisering

Varför det spelar roll att lita på AIs konfidens

Moderna artificiella intelligenssystem anger inte bara vad de tror att en bild eller en sensorsignal innehåller — de rapporterar också hur säkra de är. Denna självrapportrerade konfidens är avgörande i säkerhetskritiska tillämpningar som medicinsk bildanalys, självstyrande fordon eller industriell övervakning, där en felaktig känsla av säkerhet kan vara farlig. Dagens djupa neurala nätverk är dock ökända för att vara överdrivet självsäkra i sina fel, och befintliga korrigeringar fallerar ofta när data är obalanserade eller kommer från skiftande miljöer. Denna artikel introducerar en ny metod, kallad Dynamic Confidence Propagation with Alternating Normalization (DCP‑AN), utformad för att göra AIs konfidenspoäng mer ärliga, stabila och effektiva i realistiska, föränderliga förhållanden.

När smarta maskiner är för säkra på sig själva

De mest använda djupa inlärningsmodellerna tränas för att förutsäga korrekt etikett, inte för att bedöma hur pålitligt varje förutsägelse är. Som ett resultat kan ett nätverk vara 99 % ”säkert” på att en bild föreställer en katt när det i själva verket är en hund. Standardtekniker för kalibrering, såsom temperature scaling eller att dela upp förutsägelser i konfidensfack, försöker rätta till detta efter träning genom att använda globala justeringar. Dessa metoder behandlar dock alla kategorier och exempel på samma sätt. I verkligheten är data sällan balanserade: några vanliga ”huvud”-klasser har många exempel, medan sällsynta ”svans”-klasser kan förekomma bara ett fåtal gånger. Nätverk tenderar att vara överkonfidentiösa för vanliga klasser och underkonfidentiösa för sällsynta, en klyfta som statiska, enstorleks-för-alla-korrigeringar inte kan överbrygga — särskilt när datadistributionen förändras mellan domäner, till exempel från konstnärliga skisser till verkliga fotografier.

Ett nytt sätt att dela information mellan data och etiketter

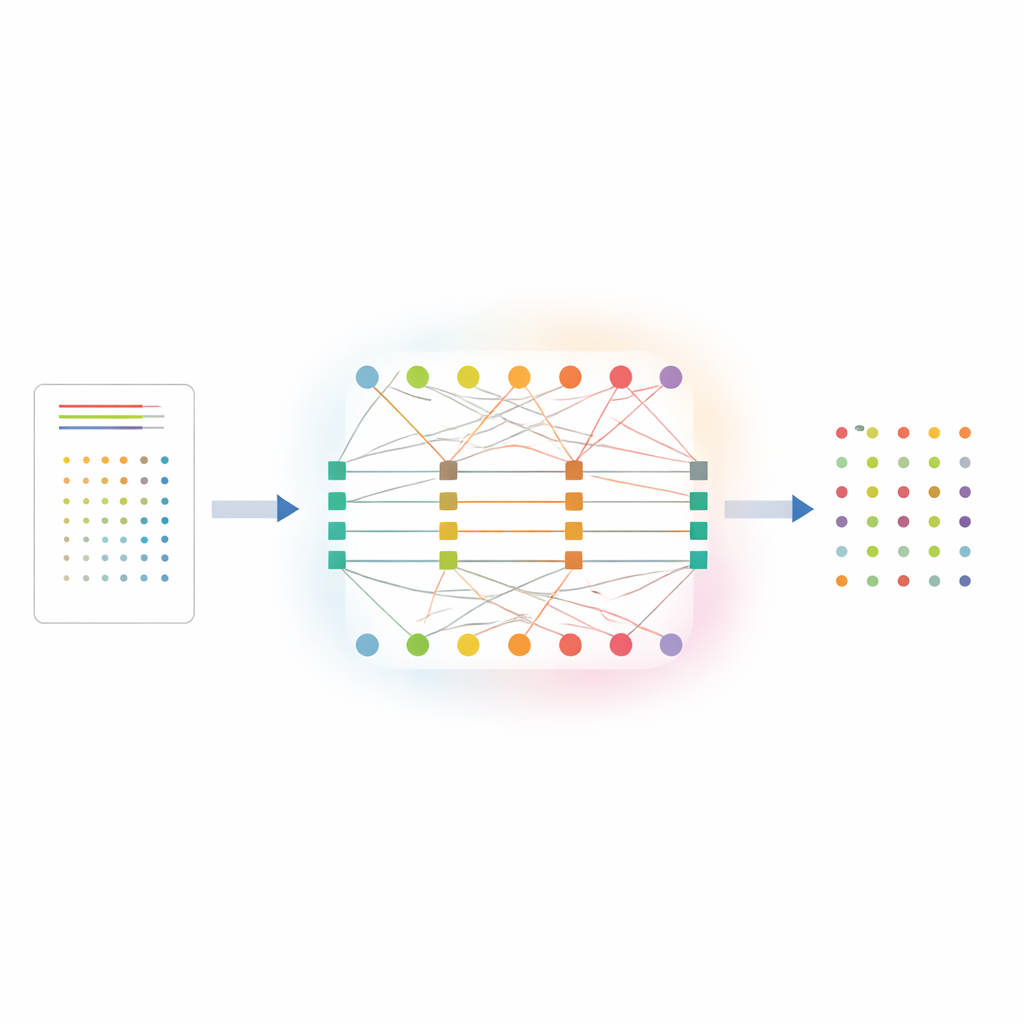

DCP‑AN angriper problemet genom att uttryckligen modellera hur konfidens bör flöda mellan individuella prov och de klasser de tillhör. Metoden representerar relationen mellan prover och klasser som ett tvåskiktat nätverk: ett skikt av noder för prover och ett annat för klasser, länkade med vikta förbindelser som kodar initiala förutsägelsestyrkor. Konfidensen förfinas sedan genom en tvåstegsprocess. I första steget flödar information från prover till klasser och justerar hur skarpt varje klass fördelar sina förutsägelser, styrt av hur osäker den klassen för närvarande verkar. I andra steget flödar information tillbaka från klasser till prover och puttar varje provs konfidensprofil baserat på hur förenlig den är med tidigare uppskattningar. Genom att upprepa denna fram- och tillbaka-process ett begränsat antal gånger uppmuntrar systemet bättre ”lagarbete” mellan exempel och etiketter, så att sällsynta klasser får tydligare signaler istället för att dränkas av vanliga.

Höja temperaturen där det behövs

En viktig innovation i DCP‑AN är ett adaptivt ”temperaturfält” som förändrar hur kraftfullt metoden omformar konfidens, beroende på hur osäkert det ser ut lokalt och globalt. Istället för att använda ett enda temperaturvärde för alla förutsägelser beräknar metoden separata justeringsstyrkor för klasser och för prover, baserat på mått av osäkerhet och mismatch över tid. För huvudklasser som nätverket redan hanterar med hög säkerhet svalnar den effektiva temperaturen försiktigt, vilket förhindrar överutjämning och bevarar skarpa distinktioner. För svansklasser och tvetydiga prover stiger temperaturen, vilket möjliggör kraftigare korrigeringar som ökar deras konfidens när det är motiverat och dämpar skenbara toppar. Detta dynamiska beteende följer en principbaserad uppdateringsregel och visar sig reagera snabbt när osäkerheten växer, samtidigt som det förblir stabilt när modellen redan är väl anpassad.

Pålitlig förbättring över uppgifter och hårdvara

Författarna utvärderar noggrant DCP‑AN på flera välanvända bilddatasätt. På en långsvansad version av ImageNet, där vissa kategorier har hundratals gånger fler bilder än andra, ökar metoden noggrannheten för sällsynta svansklasser med ungefär 10 absoluta procentenheter och halverar en standardiserad kalibreringsfelsmått jämfört med en okorrigerad baseline. I ett tvärdomänstest som överför en modell tränad på konstverk till verkliga fotografier ökar DCP‑AN både noggrannheten i den nya domänen och minskar ett statistiskt mått på glappet mellan källa och måldata. Viktigt är att dessa vinster inte kommer till priset av tung beräkning: vid körning på ett modernt grafikkort lägger metoden bara drygt en millisekund fördröjning och mindre än en halv megabyte extra minne, vilket håller den praktisk för realtids- och kant-enheter.

Vad detta innebär för vardaglig AI

Enkelt uttryckt visar detta arbete att vi kan göra AI-system inte bara smartare utan också mer självmedvetna om när de kan ha fel. Genom att låta konfidensinformation flöda fram och tillbaka mellan exempel och kategorier, och genom att anpassa hur aggressivt systemet korrigerar sig utifrån förändrad osäkerhet, levererar DCP‑AN sannolikhetsuppskattningar som bättre matchar verkligheten — även för sällsynta händelser och i skiftande miljöer. Eftersom metoden kommer med en matematisk garanti att dess iterativa uppdateringar konvergerar snabbt, och eftersom den körs med minimal overhead, kan denna ramverk kopplas in i befintliga neurala nätverk inom områden som sjukvård, robotik och övervakning. Resultatet är AI som fortfarande gör misstag, men som är mycket ärligare om hur säker den är — ett avgörande steg mot system som människor tryggt kan förlita sig på.

Citering: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Nyckelord: konfidenskalibrering, djupa neurala nätverk, långsvansad igenkänning, osäkerhetsuppskattning, domänanpassning