Clear Sky Science · sv

ACFM: adaptiv kanalviktad fusionsalgoritm för att förbättra upptäckt av små objekt i UAV‑trafik

Se mer från himlen

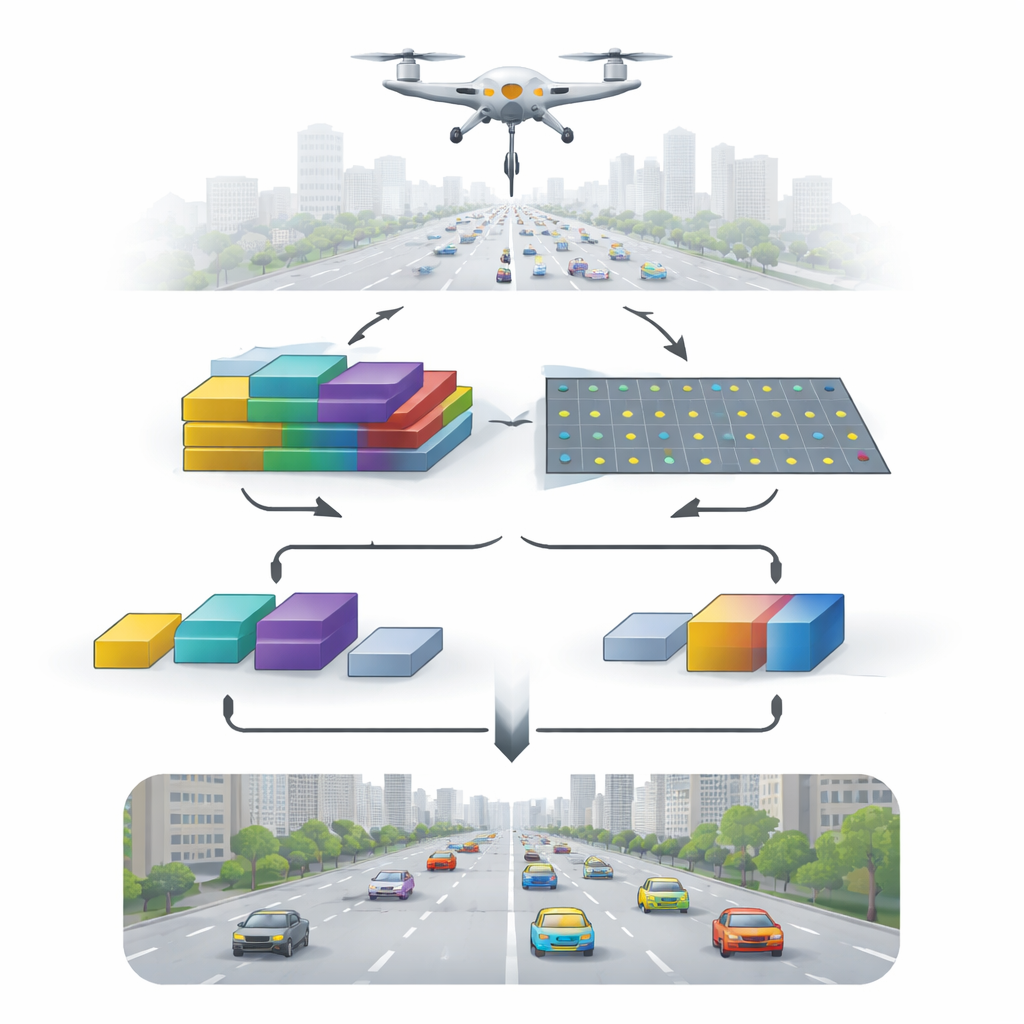

När drönare i allt högre grad används för att övervaka trafik, folkhälsa och katastrofområden möter de ett enkelt men seglivat problem: långt uppifrån upptar de saker vi bryr oss om — bilar, bussar, till och med människor — ofta bara några få pixlar. Dessa små prickar är lätta för algoritmer att missa, särskilt på trånga stadsgator fulla av skuggor, skyltar och rörelseoskärpa. Denna artikel presenterar ett nytt sätt att få datorer att ”se” sådana små objekt tydligare i drönarfilmer, utan att göra detektionernas hastighet orimligt långsam.

Varför små prickar spelar roll

Drönarkameror fångar vida scener från höga höjder, så en enda bild kan innehålla motorvägar, byggnader, träd och dussintals fordon. De flesta av dessa fordon framstår som mycket små och kan överlappa eller dölja varandra. Traditionella djupinlärningsdetektorer är utmärkta på att hitta stora, tydliga objekt, men de tenderar att tappa bort finare detaljer när informationen passerar genom nätverkets djupare lager. Resultatet blir att små fordon flyter ihop med bakgrunden, särskilt i trånga korsningar, vid svagt ljus eller i lätt suddig bild. Befintliga metoder för flera skalor hjälper till viss del genom att kombinera information från olika lager, men de förlitar sig ofta på fasta, förinställda regler och har svårt att anpassa sig när scenen blir särskilt rörig eller komplex.

En smartare metod för att blanda ledtrådar

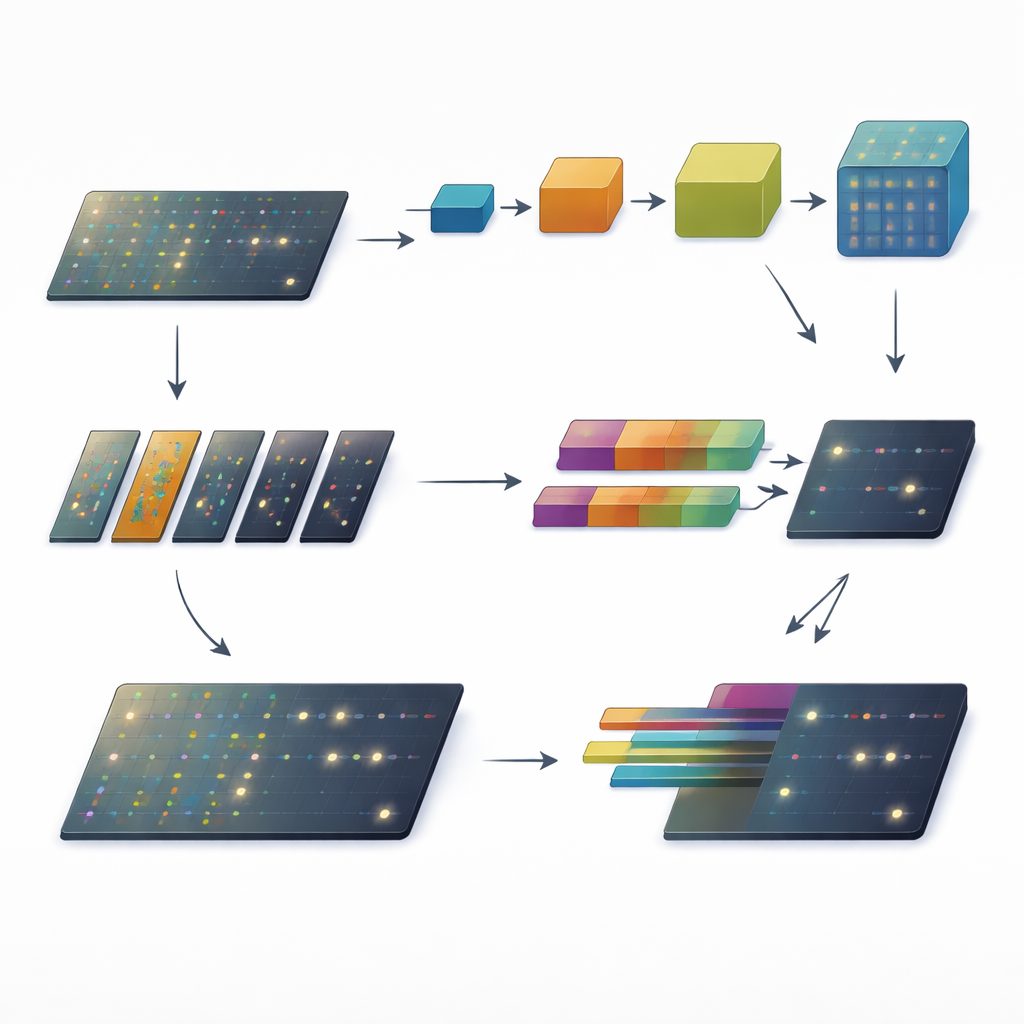

Författarna föreslår en adaptiv kanalviktad fusionsmodul, eller ACFM, utformad för att kopplas in i befintliga objektendetektorer och göra dem bättre på att hitta små mål i drönartrafikscener. I stället för att behandla all visuell information lika kör ACFM två specialiserade grenar parallellt och fusionerar sedan deras utdata på ett sätt som beror på scenen. Den ena grenen förfinar hur funktioner hanteras över skalor så att fina rumsliga detaljer inte slätas ut. Den andra grenen fungerar som en strålkastare som förstärker verkligt viktiga små‑objektsignaler samtidigt som störande bakgrundsmönster dämpas. Avgörande är att fusionen mellan dessa grenar inte är fast. ACFM justerar hur mycket den litar på varje gren beroende på den aktuella bilden, vilket gör att systemet kan reagera annorlunda på en lugn motorväg än på en tät korsning.

Bevara detaljer över skalor

I den första grenen, kallad multi‑scale refinement block, skickar nätverket funktioner genom ett par vägar. Den ena vägen bevarar helt enkelt den ursprungliga informationen och säkerställer att fina, högupplösta detaljer överlever. Den andra vägen komprimerar och expanderar sedan bildrepresentationen, vilket uppmuntrar modellen att förstå den bredare kontexten för var små fordon befinner sig i scenen. I slutet slås dessa vägar samman så att varje utgångspixel gagnas både av skarp lokal detalj och av en förståelse för omgivningen. Detta gör det lättare för detektorn att rita tajtare, mer konsekventa ramar runt små bilar och bussar i olika storlekar, även när bakgrunden är stökig eller delvis skymd.

Dämpa bakgrundsbruset

Den andra grenen fokuserar på uppmärksamhet. Den delar upp funktionskanalerna i grupper och lär för varje grupp en gles ”mask” som lyfter fram endast de mest lovande regionerna. Områden som ser ut som bakgrund — vägbanor, hustak, trädkronor — tonas ner, medan små men meningsfulla signaler, såsom reflektioner och kanter på fordon, förstärks. Genom att kombinera dessa skärpta detaljer tillbaka med de ursprungliga funktionerna på ett kontrollerat sätt ger denna grupperade glesa uppmärksamhetsgren en renare, mer diskriminerande bild av scenen. Det minskar risken för att detektorn förväxlar mönster i asfalt eller skuggor från byggnader med verkliga fordon.

Låt scenen välja blandningen

Den sista delen i ACFM är en kanalnivå adaptiv viktmekanism som avgör, kanal för kanal, hur mycket man ska förlita sig på varje gren. Den summerar först vad som händer i hela bilden och använder sedan en lättviktig operation för att härleda en uppsättning vikter mellan noll och ett. Om scenen är enkel och objekten är väl separerade kan nätverket luta mer mot multi‑scale refinement. Om scenen är tät, rörig eller brusig kan det flytta mer tyngd till uppmärksamhetsgrenen som undertrycker bakgrundsstörningar. Denna dynamiska avvägning ersätter stelbenta, handgjorda fusionsregler med en automatisk, datadriven strategi, vilket gör det möjligt för detektorn att reagera flexibelt när förhållandena ändras från en bildruta till en annan.

Skarpare ögon för drönartrafik

När den kopplades in i en populär detektor kallad GFL och testades på tre publika drönartrafikdataset förbättrade ACFM konsekvent detektionsresultaten, särskilt på utmanande uppsättningar med många små, överlappande fordon. Vinsterna i noggrannhet kom med liten extra beräkningskostnad, vilket innebär att det förbättrade systemet fortfarande kan köras nära realtid — ett kritiskt krav för praktisk trafikövervakning. För icke‑specialister är slutsatsen enkel: genom att bevara detaljer, dämpa brus och anpassa hur funktioner kombineras efter scenen hjälper ACFM drönare att agera mer som uppmärksamma mänskliga observatörer och mindre som stela mönstermatchare, vilket ger en mer pålitlig grund för framtida smarta stadslösningar och luftburna övervakningsapplikationer.

Citering: Liu, S., Zhu, H., Yuan, Z. et al. ACFM: adaptive channel weighted fusion algorithm for improving small object detection performance in UAV traffic. Sci Rep 16, 8366 (2026). https://doi.org/10.1038/s41598-026-39789-6

Nyckelord: övervakning av drönartrafik, detektion av små objekt, datorseende, uppmärksamhetsmekanismer, fusionsmetoder i flera skalor