Clear Sky Science · sv

En flexibel ram för hyperparametervariantering med homotopi och surrogatmodeller

Varför det spelar roll att ställa in AI:s rattar

Moderna artificiella intelligenssystem bygger inte bara på smarta algoritmer och enorma datamängder, utan också på ett oväntat kinkigt lager av inställningar kallade ”hyperparametrar.” Det är dessa rattar som avgör hur stort ett modell ska vara, hur snabbt den lär sig och hur den hanterar brus i data. Fel inställningar kan förvandla ett lovande system till en flopp. Denna artikel presenterar HomOpt, en ny metod för att ställa in de här rattarna mer effektivt och pålitligt, särskilt när sökutrymmet är stort och stökigt, vilket gör den intressant för alla som vill få AI att fungera bättre med mindre provande och felande.

Ett nytt sätt att styra sökningen

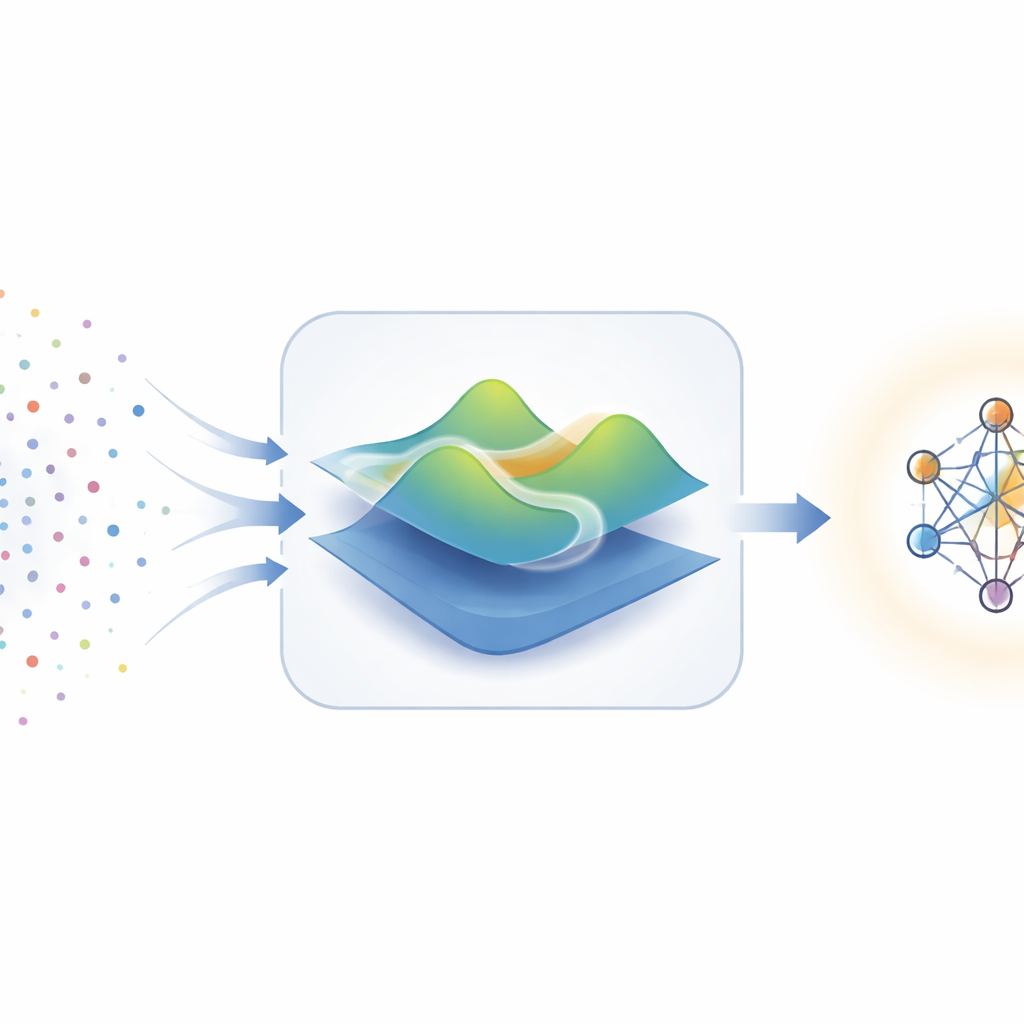

Traditionella metoder för hyperparameterinställning, som grid search eller random search, är lite som att prova recept genom att slänga ihop ingredienser och hoppas att det smakar bra. Mer raffinerade metoder, som bayesiansk optimering, försöker vara smartare genom att bygga en grov modell av hur inställningarna påverkar prestanda och sedan använda den modellen för att välja nästa kombination att pröva. Men dessa metoder förutsätter ofta att prestandalandskapet är jämnt och välbetett, vilket sällan stämmer i verkliga problem fulla av egenheter, brus och plötsliga hopp. HomOpt tar sig an den här utmaningen genom att upprepade gånger bygga approximativa ersättare för det verkliga landskapet—s.k. surrogatmodeller—och sedan smidigt omvandla en surrogat till nästa i takt med att mer data kommer in, samtidigt som metoden följer hur den bästa lösningen rör sig under den här omvandlingen.

Smidigt morphande modeller istället för att börja om

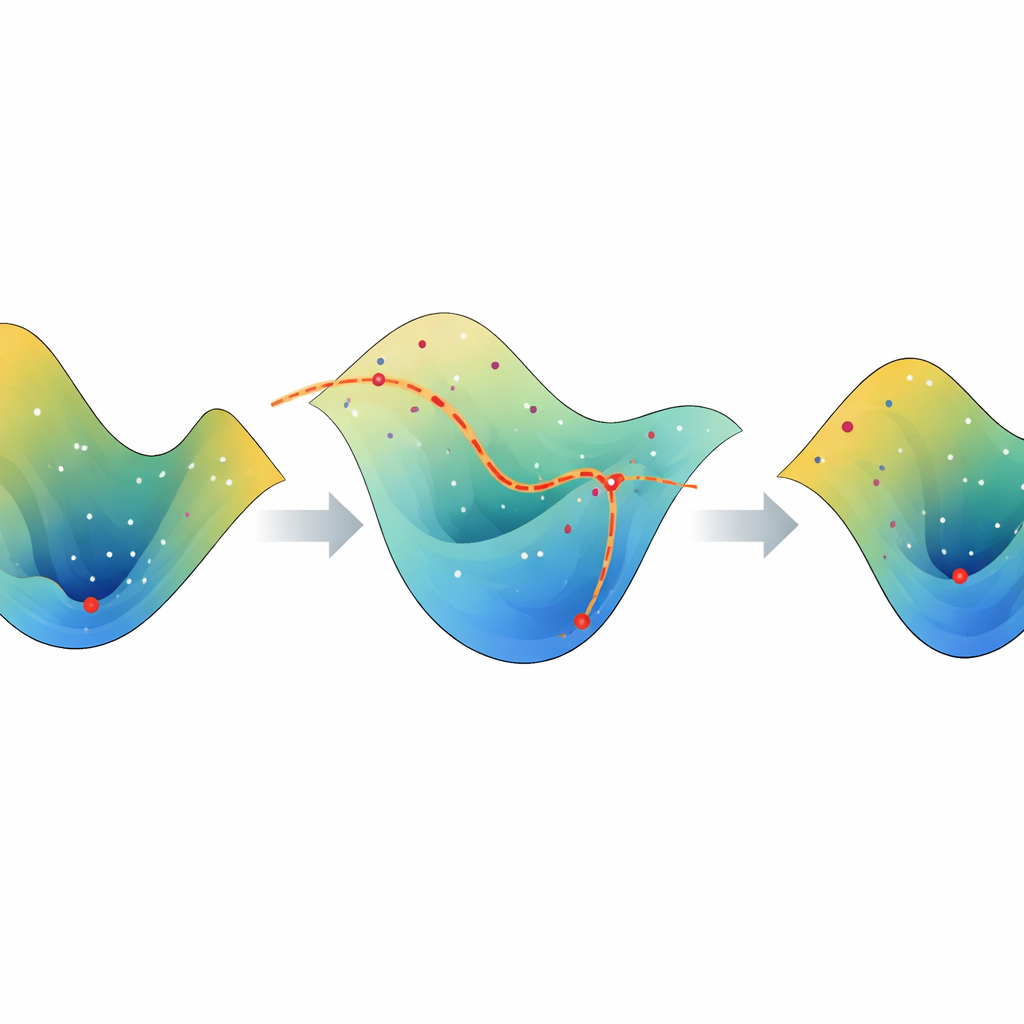

Huvudidén bakom HomOpt kommer från ett matematiskt begrepp kallat homotopi, vilket enkelt uttryckt handlar om att gradvis förvandla en form till en annan utan att riva eller hoppa. I denna ram är varje surrogatmodell en utjämnad bild av hur olika hyperparameterinställningar påverkar en modells prestanda. När nya experimentella resultat samlas in bygger HomOpt en uppdaterad surrogatmodell och definierar sedan en kontinuerlig transformation mellan den gamla och den nya versionen. Istället för att kassera tidigare arbete och starta om sökningen följer metoden hur bästa punkten på den gamla ytan glider över detta morphande landskap för att landa vid en bra punkt på den nya. Denna vägledda rörelse gör sökningen mer målinriktad och mindre slumpmässig, vilket ökar chansen att hitta bättre inställningar på färre steg.

Flexibla verktyg för olika typer av data

För att visa att idén fungerar i praktiken kopplar författarna in två mycket olika typer av surrogatmodeller i HomOpt. Först använder de Generalized Additive Models, som är släta och relativt lätta att tolka, vilket gör dem användbara när sambanden mellan inställningar och prestanda förändras mjukt. Därefter använder de CatBoost, en kraftfull ensemblemetod väl lämpad för komplicerade, högdimensionella problem som bildigenkänning. HomOpt låser sig inte vid ett enda surrogat; istället behandlas valet av surrogat som en plug-in-komponent som kan matcha uppgifternas svårighetsgrad och struktur. Ramverket kan hantera kontinuerliga, diskreta och kategoriska inställningar och kan ligga ovanpå vanliga sökstrategier såsom random search, bayesiansk optimering eller träd-baserade metoder, och fungera som ett förfiningslager snarare än en ersättning.

Sätta metoden på prov

Forskarna utvärderar HomOpt på en mångfald av benchmarks. På klassiska maskininlärningsuppgifter hämtade från publika tabulära datamängder fininställer de modeller som supportvektormaskiner, random forests, logistisk regression, multilayer perceptrons och gradientboostade träd. De undersöker också krävande open-set recognition-problem, där ett system måste hantera tidigare osedda kategorier, med en specialiserad klassificerare kallad Extreme Value Machine. Slutligen testar de HomOpt på neurala arkitektursök-tabeller för välkända bilddatamängder såsom CIFAR-10 och ImageNet-liknande samlingar, där utrymmet av möjliga designer är särskilt stort och ojämnt. I många av dessa scenarier accelererar HomOpt antingen nedstigningen mot bra lösningar eller förbättrar slutprestandan jämfört med de underliggande metoderna ensamma, ofta med färre dyra modelevalueringar.

Vad detta betyder för vardagligt AI-arbete

För praktiker är huvudbudskapet att HomOpt erbjuder ett strukturerat sätt att göra hyperparameterinställning smartare snarare än bara mer uttömmande. Genom att kontinuerligt förfina en approximativ bild av prestandalandskapet och smidigt följa hur dess bästa punkt skiftar i takt med att bilden förbättras, minskar metoden onödigt sökande och utnyttjar varje modellenkörning bättre. Eftersom den fungerar med ett brett spektrum av förlustmått, modelltyper och sökstrategier kan HomOpt betraktas som ett allmänt tillägg för befintliga optimeringsverktyg. Enkelt uttryckt lovar den att frambringa mer noggranna, robusta AI-system med samma beräkningsbudget—och att göra det på ett sätt som skalar från små tabulära problem till stora, komplexa visuella uppgifter.

Citering: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Nyckelord: hyperparameteroptimering, surrogatmodeller, homotopimetoder, automatiserad maskininlärning, sökning av neurala arkitekturer