Clear Sky Science · sv

AsynDBT: asynkron distribuerad bilevel-justering för effektiv in-context-inlärning med stora språkmodeller

Varför smartare prompts spelar roll för vardagens AI

Stora språkmodeller driver nu chattbotar, sökmotorer och skrivassistenter som många använder dagligen. Ändå beror användbara svar i hög grad på hur vi formulerar våra frågor och vilka exempel vi visar modellen. Denna artikel presenterar ett nytt sätt att automatiskt förfina sådana prompts och exempel över många enheter, samtidigt som varje användares data hålls privat. Resultatet är ett AI-system som lär sig att svara mer korrekt och effektivt, särskilt för specialiserade uppgifter som underhåll av telekomnätverk.

Lära AI genom att visa istället för att omskola

I stället för att ständigt omskola gigantiska AI-modeller är en växande trend att lära dem ”i stunden” genom att tillhandahålla ett fåtal noggrant utvalda exempel i prompten — en process som kallas in-context-inlärning. Till exempel, för att klassificera filmrecensioner som positiva eller negativa, kan du visa modellen en liten uppsättning märkta exempel och sedan be den märka en ny recension. Problemet är att valet av exempel och den exakta ordalydelsen i instruktionerna dramatiskt kan förändra modellens prestanda. Att hitta bra kombinationer manuellt är långsamt och dyrt, och att dela rådata mellan organisationer är ofta omöjligt på grund av sekretessregler.

Samarbeta utan att dela privat data

För att kringgå hinder för datadelning bygger författarna vidare på federated learning, en uppsättning där många separata enheter eller organisationer behåller sin data lokalt men samarbetar via en central server. Varje arbetare — till exempel en telekombasstation eller en företagsserver — kommunicerar med samma molnbaserade språkmodell men laddar aldrig upp sin råtext. I stället skickar den tillbaka endast återkopplingssignaler om hur väl olika prompts och exempelval verkar fungera. En ny algoritm som kallas AsynDBT (asynkron distribuerad bilevel-justering) koordinerar dessa arbetare så att de gemensamt förbättrar en delad prompting-strategi samtidigt som sekretess respekteras och långsamma eller opålitliga nätverkskopplingar hanteras.

Optimera både frågan och exemplen

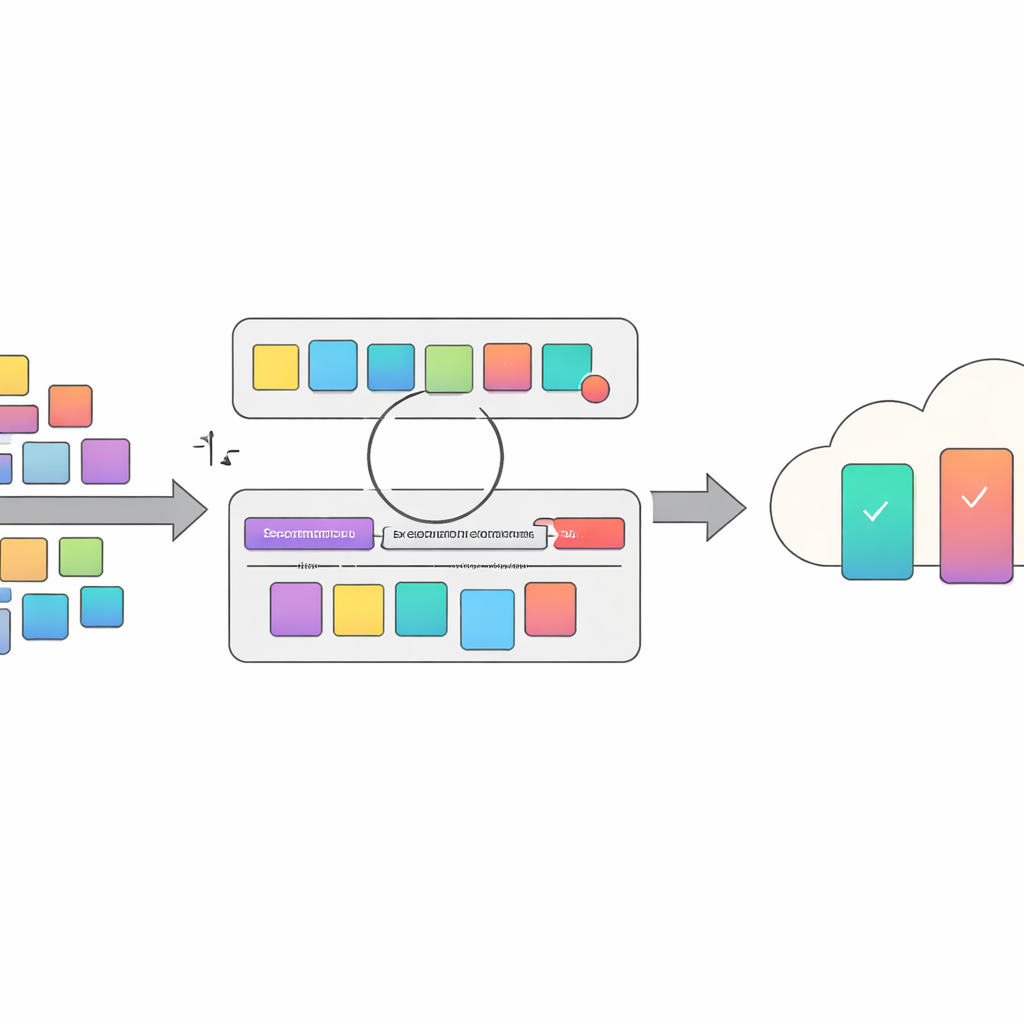

En central idé i artikeln är att behandla promptdesign som ett tvåskiktat optimeringsproblem. På det lägre skiktet finjusterar systemet korta fragment som läggs till uppgiftsinstruktionen — små formuleringar som kan styra modellen mot bättre resonemang. På det övre skiktet avgörs vilka märkta exempel som ska inkluderas som demonstrationer. Dessa två skikt samverkar: olika exempeluppsättningar kräver olika promptjusteringar och vice versa. AsynDBT formaliserar denna relation matematiskt och använder en effektiv approximationsmetod så att varje arbetare gradvis kan uppdatera sina lokala val medan en central server håller en konsekvent global bild av besluten på det lägre skiktet.

Hantera långsamma enheter och illvilliga deltagare

I verkliga nätverk svarar vissa enheter sent eller faller bort, vilket skapar ”stragglers” som kan stanna upp standardiserad synkron träning. AsynDBT arbetar istället asynkront: servern uppdaterar sina variabler när en delmängd av arbetarna rapporterar in, utan att vänta på alla. Metoden skyddar också mot arbetare som kan skicka missvisande uppdateringar, avsiktligt eller av misstag. Genom att kombinera regulariseringstekniker med robusta aggregeringsregler minskar algoritmen effekten av förgiftade eller lågkvalitativa exempelval på den globala strategin, vilket hjälper det övergripande systemet att förbli stabilt och tillförlitligt även under attack.

Visade förbättringar på språk- och telekomuppgifter

Forskarna testade AsynDBT på sex textklassificeringsproblem, inklusive en krävande 5G-nätverksdatamängd där modellen behövde bedöma om specialiserade tekniska termer var relaterade, med endast fragment av telekomstandarder som kontext. Jämfört med en rad befintliga prompt- och exempelvalsmetoder nådde den nya metoden bästa eller näst bästa noggrannhet på nästan alla uppgifter. På 5G-uppgiften i synnerhet förbättrade den noggrannheten med cirka tio procentenheter över den starkaste baslinjen. Samtidigt minskade den asynkrona utformningen träningstiden med ungefär 40 procent jämfört med en liknande centraliserad metod som inte distribuerar arbetet.

Vad detta betyder för framtida AI-verktyg

För icke-experter är slutsatsen att bättre prompts och smartare val av exempel märkbart kan förbättra hur AI-system beter sig — utan att ändra den underliggande modellen. AsynDBT erbjuder ett automatiserat, sekretessbevarande sätt att göra detta över många samarbetande enheter, vilket ger mer precisa och effektiva språkverktyg för områden som telekomdrift, kundsupport och andra specialiserade fält. Framöver planerar författarna att kombinera sitt ramverk med grafbaserad kunskapsåtervinning så att prompts också kan hämta aktuell faktainformation, vilket ytterligare minskar hallucinationer och gör AI-assistenter mer trovärdiga i höginsatsmiljöer.

Citering: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Nyckelord: in-context-inlärning, promptoptimering, federated learning, stora språkmodeller, sekretessbevarande AI