Clear Sky Science · sv

Integritetsmedveten analys av samband mellan talarens egenskaper och multimodala funktioner i anställningsintervjuer

Varför din röst i anställningsintervjuer väcker nya frågor

Allt fler företag använder automatiserade videointervjuer där algoritmer lyssnar på hur du talar och drar slutsatser om egenskaper som självsäkerhet, pålitlighet eller social förmåga. Men din röst bär på mer än ett första intryck—den kan antyda din identitet, din hälsa och din bakgrund. Denna artikel undersöker om det är möjligt att dölja vem du är i en inspelning samtidigt som datorer fortfarande kan bedöma hur du framstår som arbetssökande. Med andra ord: kan vi behålla fördelarna med AI-stödd rekrytering utan att tyst ge upp vår integritet?

Från första intryck till automatiska bedömningar

Rekryteringspsykologer har länge känt till att breda personlighetsmönster—ofta beskrivna som de fem stora dragen: öppenhet, samvetsgrannhet, extraversion, medmänsklighet och emotionell stabilitet—påverkar arbetsprestation. Nyare framsteg inom artificiell intelligens gör det möjligt för datorer att uppskatta dessa egenskaper utifrån hur människor talar i anställningsintervjuer, och fånga inte bara vad kandidater säger utan också hur de säger det: röstläge, ljudstyrka, rytm och talstil. Dessa system lovar snabbare och mer konsekvent sortering av sökande. Men de väcker också en oroande fråga: om ett företag lagrar din röst, kan samma data senare användas för att känna igen dig, profilera dig eller dra slutsatser om känsliga uppgifter som du inte samtyckt till att dela?

Hur dölja en röst utan att tappa dess karaktär

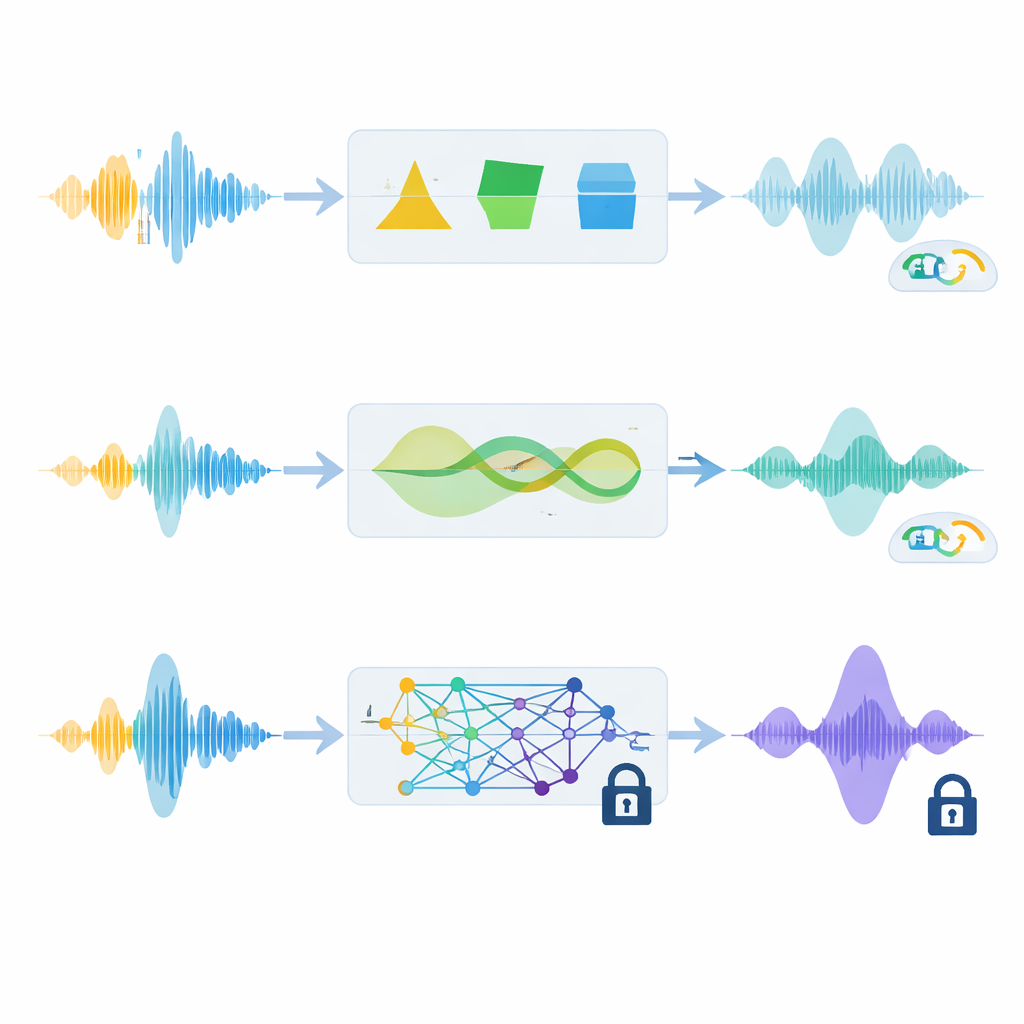

För att ta sig an detta dilemma studerade forskarna tekniker som ändrar en persons röst så att den inte längre låter som personen, samtidigt som de bevarar de ledtrådar som behövs för personlighets- och rekryteringsbedömningar. De fokuserade på tre anonymiseringsmetoder. Två av dem använder traditionella ljudknep, såsom att diskret omforma ljudfrekvenser och sträcka eller skifta tonhöjd över tid. Den tredje förlitar sig på en modern neural ljudkodek, som komprimerar rösten till en serie digitala koder för att sedan återskapa den som en ny, högkvalitativ men annorlunda klingande röst. Viktigt är att teamet justerade alla metoder så att talarens uppfattade kön förblev detsamma och så att den omvandlade rösten var konsekvent över flera svar i en lång onlineintervju.

Att testa integritet och användbarhet

Med nästan 1 900 verkliga videoinspelade onlineintervjuer från personer i USA ställde författarna två huvudfrågor. För det första, hur svårt skulle det vara för en angripare att matcha anonymiserade röster tillbaka till de ursprungliga talarna med ett avancerat röstigenkänningssystem? För det andra, efter anonymisering, kunde algoritmer fortfarande förutsäga viktiga personlighetsbetyg och rekryteringsrekommendationer med liknande noggrannhet? De utvärderade integriteten med en felprocent från automatisk talarverifiering—högre fel innebär bättre skydd—och mätte användbarhet via taligenkänningsnoggrannhet, uppfattad ljudkvalitet och hur väl maskininlärningsmodeller kunde dra slutsatser om egenskaper och anställningsbeslut från akustiska och språkliga egenskaper.

Hur kompromissen faktiskt ser ut

Resultaten visar en nyanserad balans mellan säkerhet och prestanda. Den enklaste metoden, som lätt omformar röstfrekvenser, gav endast måttlig integritet och kunde nästan helt misslyckas när angriparens system anpassades till de anonymiserade rösterna. En mer avancerad signalbaserad teknik som ändrar timing och tonhöjd presterade mycket bättre: den minskade avsevärt chanserna för framgångsrik återidentifiering samtidigt som talets rytm och uttrycksfullhet bevarades. Som en följd förblev bedömningar av anställning och personlighet nära de som gjordes från originalinspelningarna. Den neurala ljudkodeken gav det starkaste skyddet, vilket gjorde det mycket svårare att länka anonymiserade röster till verkliga talare, och rengjorde ofta även bakgrundsbrus. Men i de brusiga, verkliga intervjuinspelningarna störde denna metod också subtila prosodiska signaler som påverkar hur lyssnare uppfattar egenskaper, vilket ledde till en märkbar nedgång i prestanda för egenskapsuppskattning och högre fel i automatisk transkription.

Vad detta betyder för rättvis och privat rekrytering

Studien visar att det inte finns en universallösning: starkare integritet kommer ofta med en kostnad för hur väl AI kan läsa personlighet och rekommendera kandidater. För vanliga rekryteringssituationer där egenskapsuppskattningar och rättvisa beslut är prioritet kan förfinade signalbehandlingsmetoder—särskilt den fasbaserade metod som testades här—erbjudas som den bästa kompromissen, genom att skydda identitet samtidigt som rösten behåller sin "känsla". I situationer med högre integritetskrav, såsom bred delning av taldata eller skydd mot kraftfulla angripare, kan nyare neurala kodekmetoder ge större skydd, men utformare måste acceptera viss förlust i hur noggrant personlighet och lämplighet bedöms. Slutligen argumenterar arbetet för att skydd av kandidaters röster bör behandlas som ett etiskt krav, inte som en eftertanke, och att framtida verktyg noggrant måste rikta in sig på vilka aspekter av tal som ska döljas och vilka som bör bevaras.

Citering: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Nyckelord: röstanonymisering, AI vid anställning, talarens egenskaper, integritet i taldata, anställningsintervjuer