Clear Sky Science · sv

Videodominerad känsloigenkänning för bärbara EEG-enheter

Varför dina videor kanske vet hur du mår

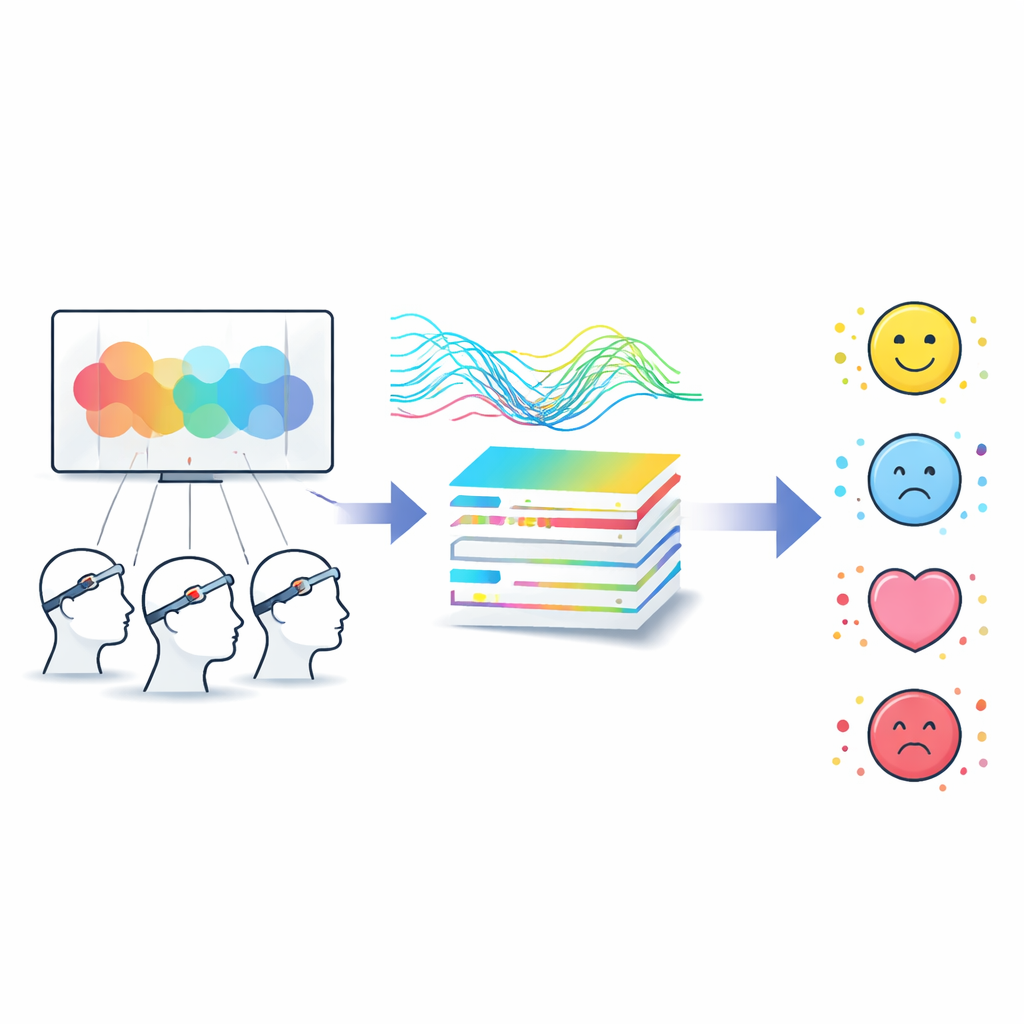

Föreställ dig att du ser en filmt trailer medan ett lätt pannband tyst lyssnar på din hjärnaktivitet och gissar om du känner dig glad, avspänd, ledsen eller rädd. Denna studie undersöker hur man kan göra det scenariot verkligt med en liten, bärbar hjärnvågsenhet (EEG) i stället för klumpig laboratorieutrustning. Arbetet är relevant för alla som intresserar sig för smartare media: från annonsörer som vill förstå publikens reaktioner till strömningstjänster som skulle kunna rekommendera program baserat på hur tittarna faktiskt känner, inte bara vad de klickar på.

Läsa känslor ur hjärnvågor

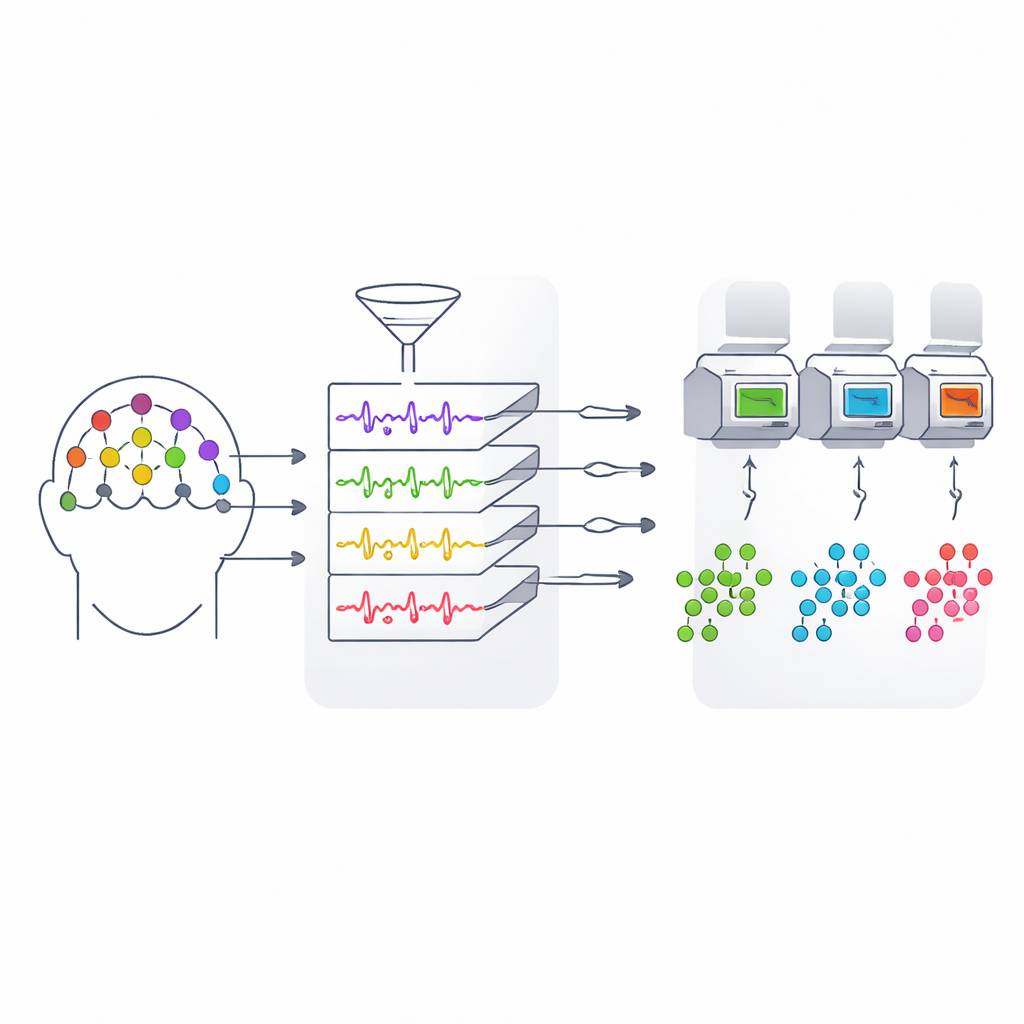

Våra hjärnor producerar svaga elektriska signaler som kan fångas vid hårbotten med elektroencefalografi, eller EEG. Dessa signaler förändras subtilt när vi upplever olika känslor. En välanvänd forskningsdatabas, kallad DEAP, spelade in människors EEG medan de tittade på musikvideor och bad dem därefter att bedöma hur behaglig, intensiv, kontrollerad och gillbar varje video kändes. De flesta tidigare studier försökte maximera noggrannheten genom att använda många elektroder och kraftfulla datorer, men under idealiska laboratorieförhållanden som inte motsvarar verkliga situationer. Denna artikel ställer istället en mer praktisk fråga: med en lågkostnads, bärbar enhet och färre elektroder, kan vi fortfarande fånga huvudkänslan en video tenderar att framkalla hos många människor?

Hitta en gemensam emotionell berättelse

Ett hinder är att människor inte beskriver sina känslor på samma sätt. Två tittare kan se samma klipp där den ena kallar det "spännande" och den andra "bara okej." Forskarna hanterar detta genom att bygga ett steg-för-steg-system för kalibrering av etiketter som söker mönster över tittare snarare än att lita på enskilda bedömningar. Först sätts alla betyg på en gemensam skala och komprimeras till ett fåtal nyckeldimensioner. Därefter grupperar osupervisad klustring liknande emotionella responser, med målet att dela in videorna i fyra breda hörn i det emotionella rummet: glad (behaglig och intensiv), avspänd (behaglig och lugn), rädd (obehaglig och intensiv) och ledsen (obehaglig och lugn). Ett slutligt förfiningssteg justerar osäkra fall baserat på ytterligare betygsinformation, vilket ger en dominant känsloetikett för varje video som bättre återspeglar gruppens övergripande intryck.

Få mer av mindre hårdvara

Ett annat problem är hårdvaran: fulla EEG-mössor med 32 eller fler elektroder är otympliga och dyra. Teamet utformar ett sätt att slimma ner detta till bara 11 noggrant valda platser över pannan, mitten, sidorna och baksidan av huvudet — områden kopplade till känslokontroll, upphetsning, hörsel, syn och uppmärksamhet. De utför sedan en detaljerad analys av hur signalenergi sprids över klassiska hjärnvågsband (från långsamma till snabba rytmer) under olika känslotillstånd. Genom att jämföra dessa mönster visar de att vissa kombinationer av frekvenser och skalplocationer bär särskilt starka ledtrådar om huruvida en tittare till exempel är mycket upphetsad eller djupt avslappnad. Detta flervågsbandsförhållande för energi gör att de kan behålla de mest informativa signalerna samtidigt som mycket av redundansen slängs bort.

Låt data lyfta fram vad som är viktigt

Även med färre elektroder innehåller varje sekund av inspelning en ström av siffror. För att undvika att överväldiga modellerna kombinerar författarna flera typer av funktioner — såsom vågformsbaserade energimått, hur starkt olika hjärnregioner fluktuerar tillsammans, och hur effekten i olika frekvenser förändras över tid — till en rik men strukturerad beskrivning av varje visning. Ett saliency-styrt urvalssteg rankar sedan dessa funktioner efter hur hjälpsamma de är för att särskilja känslor och behåller endast ett kompakt delmängd. Med denna nedtrimmade representation tränas tre standardmaskininlärningsmodeller för att känna igen vilken av de fyra dominerande känslorna som passar en given video bäst. I krävande tester där systemet måste generalisera till helt nya människor uppnår den bästa modellen omkring 45 % noggrannhet, ett stabilt resultat för ett fyrvägsval med bullriga hjärndata och endast 11 kanaler.

Vad detta betyder för vardagsteknik

För icke-specialister är huvudbudskapet att vi kan börja uppskatta hur grupper av människor känner inför videor med hjälp av små, bärbara hjärnvågsenheter snarare än fulla laboratorieuppsättningar. Genom att rensa upp känsloetiketterna, fokusera på de mest informativa delarna av EEG-signalen och välja endast ett fåtal välplacerade sensorer visar författarna att det är möjligt att upptäcka en videos dominerande känsloton — glad, avspänd, rädd eller ledsen — över tittare. Systemet är inte perfekt, men det pekar mot praktiska verktyg för publikmätning, innehållstestning och känsloanpassade rekommendationer som förlitar sig på objektiva hjärnreaktioner snarare än enbart enkäter eller klick.

Citering: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Nyckelord: EEG-känsloigenkänning, hjärna–dator-gränssnitt, videoaffektanalys, bärbar neurovetenskap, affektiv databehandling