Clear Sky Science · sv

Använd stora språkmodeller för att förbättra resonemanget hos en annan stor språkmodell genom belöningsuppdaterad GRPO

Lära maskiner att tänka igenom saker

Många av dagens språkmodeller kan föra samtal, översätta och svara på frågor, men de har fortfarande svårt att visa sitt arbetssätt på det sätt en duktig matte-elev eller en noggrann analytiker skulle göra. Denna artikel undersöker hur ett AI-system kan användas för att förbättra resonemangsförmågan hos ett annat och hur man gör detta utan att handbygga enorma, specialiserade dataset. För läsare som intresserar sig för hur AI kan bli mer tillförlitligt inom områden som finans, medicin eller vetenskaplig forskning erbjuder arbetet ett praktiskt recept för att få modeller att förklara sina svar tydligare och mer konsekvent.

Från råa dokument till undervisningsbara exempel

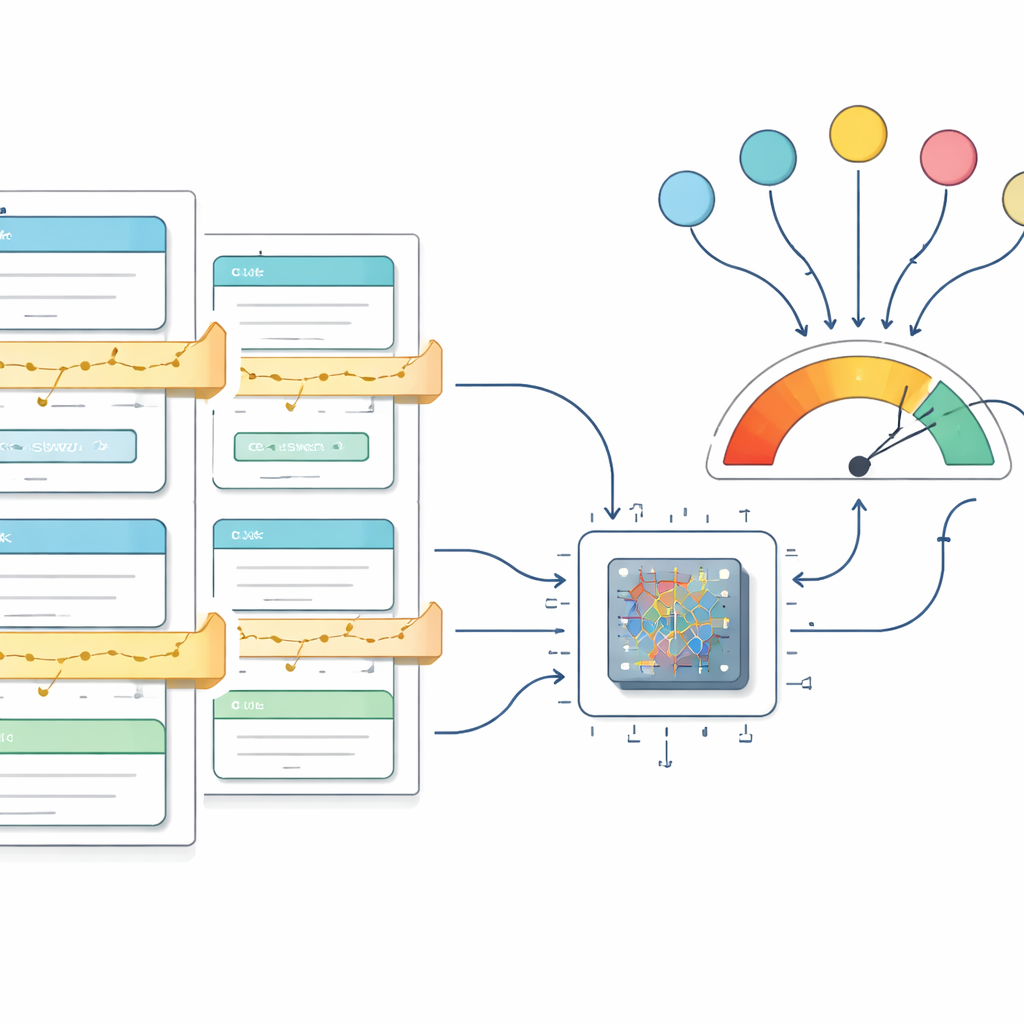

Författarna utgår från en enkel iakttagelse: det mesta av verklig information finns i röriga former som rapporter, brev till aktieägare eller webbsidor, inte i prydliga fråga–svar-format. För att överbrygga detta gap introducerar de två mjukvaruverktyg, Huggify-Data och CoT Data Generator. Dessa verktyg tar ostrukturerad text och styckar automatiskt upp den i par av frågor och svar, för att sedan be en kraftfull språkmodell fylla i de saknade resonemangs-stegen emellan. Resultatet är en strukturerad trippel för varje exempel: en fråga, en resonemangskedja och ett svar. Avgörande är att denna pipeline kan riktas mot nästan vilken domän som helst, från skolmatematik till företagsfinans, vilket gör det möjligt att bygga träningsdata fokuserad på resonemang utan arméer av mänskliga annotatörer.

Hur en modell tränar en annan

När dessa fråga–resonemang–svar-triader skapats används de för att träna en mindre ”student”-modell att tänka på samma strukturerade sätt. Studentmodellen ombeds inte bara att ge ett slutligt svar, utan att producera en tydligt avgränsad förklaring följd av slutsatsen. Träningen styrs av en metod kallad Group Relative Policy Optimization, som jämför flera kandidatrespons på samma fråga och styr modellen mot bättre alternativ. Artikeln uppdaterar denna metod med en extra belöningskomponent som kontrollerar om modellens utskrift följer önskat format, ända ner till hur väl den överensstämmer med ett väldefinierat referensexempel. Denna belöning straffar milt hoprörda eller ofullständiga förklaringar och driver modellen mot prydliga, tolkbara svar.

Sätta tillvägagångssättet på prov

För att se om ramverket fungerar i praktiken applicerar författarna det på två mycket olika datasets. Det första, GSM8K, består av grundskoleordproblem som kräver flerstegs aritmetiskt resonemang. Det andra bygger på Warren Buffetts årliga brev till aktieägarna, där målet är att fånga långformigt resonemang om investeringar och företagsbeslut. I båda fallen förvandlar pipelinen rå text till strukturerad träningsdata och finjusterar en mellanstor modell kallad Qwen 2.5. Under träningen belönas korrekta, välformaterade svar av en enkel scoringsregel; när inlärningen fortskrider stiger den genomsnittliga belöningen stadigt och stabiliseras vid sitt teoretiska maximum, vilket visar att modellen till stor del bemästrat det önskade beteendet på träningsdatan.

Hur väl presterar den förbättrade modellen

Prestanda mäts med ”medel-token-precision”, vilket grovt frågar vilken andel av de små textbitarna (tokens) i modellens utskrifter som matchar de förväntade. Även om detta skiljer sig från det vanliga allt-eller-inget-betyget för testfrågor är det väl lämpat för att bedöma om förklaringar och svar produceras i rätt struktur. På GSM8K når den bästa modellen 98,2 procent token-precision, och på Buffetts brev uppnår den 98,5 procent. Dessa poäng är högre än de som rapporterats för välkända system som GPT‑4 och Claude 3.5 Sonnet enligt samma mått, samtidigt som man använder endast en 3-miljarder-parametersmodell som kan tränas på under två dagar på hyrd hårdvara. Författarna delar också detaljer om beräkningskostnader och hårdvaruuppsättningar, och släpper all kod, modeller och dataset för andra att granska och bygga vidare på.

Vad detta betyder för vardaglig AI-användning

För icke-specialister är huvudsaklig slutsats att AI-system kan läras inte bara att svara, utan att svara på ett disciplineradt, lättföljt sätt med hjälp av data som automatiskt extraherats ur vanliga dokument. Genom att kombinera en resonemangsrik lärarmodell, en flexibel datapipeline och ett belöningsschema som värderar både korrekthet och tydlighet visar författarna hur man formar mindre modeller till mer pålitliga problemlösare. Även om de noterar begränsningar — såsom behovet av starkare tester för verklig förståelse och säkerhet — pekar ramverket mot en framtid där organisationer kan förvandla sina egna textarkiv till skräddarsydda, transparenta AI-assistenter för utbildning, finans och vidare.

Citering: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Nyckelord: stora språkmodeller, kedja-av-tankar-resonemang, belöningsoptimering, datakurering, domänspecifik AI