Clear Sky Science · sv

En jämförande analys av inbäddade chatbot-modeller och ChatGPT-4 för att besvara frågor om ortodontisk behandling

Varför smartare chatbots är viktiga för tandställning

Den som har haft tandställning vet att frågor inte väntar på mottagningstider: Slutar den här smärtan? Kan jag äta det här? Behöver jag oroa mig för käken? Denna studie undersöker om en specialbyggd ortodontisk chatbot — utformad specifikt för att besvara dessa vardagsfrågor — kan ge tydligare, mer pålitliga svar än ett allmänt artificiellt intelligenssystem, ChatGPT‑4. Arbetet ger en inblick i hur noggrant anpassade AI-verktyg kan stödja både patienter och kliniker inom modern tandvård.

En chatbot byggd just för frågor om tandställning

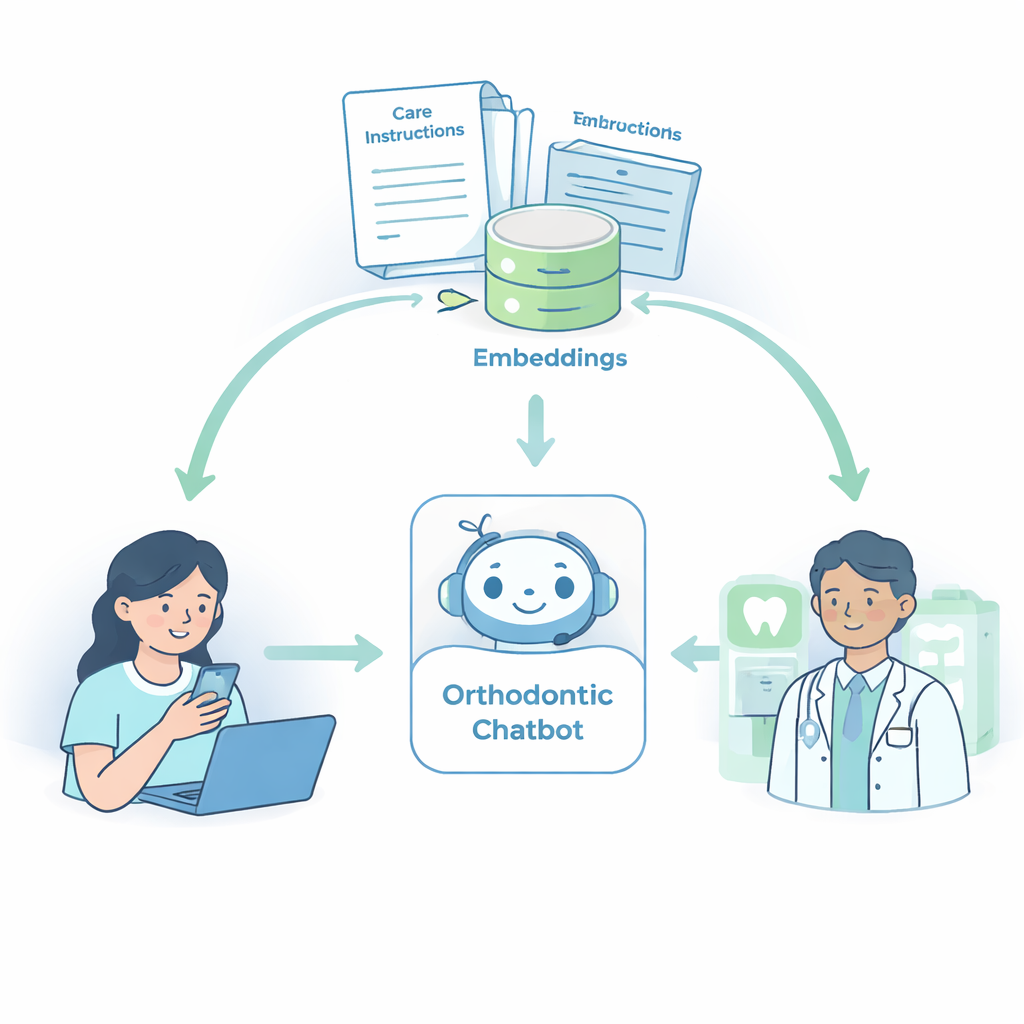

Forskarna skapade en inbäddad chatbot som enbart fokuserar på ortodontisk behandling. Istället för att träna en ny AI från grunden kopplade de en avancerad språkmodell till ett kurerat bibliotek av patientmaterial och viktiga läroboksexcerpter. Detta bibliotek inkluderade informationsblad från British Orthodontic Society om ämnen som munhygien, kost, skötsel av apparatur, gummiband och retainers, tillsammans med korta förklaringar från standardortodontiska läroböcker. Med en teknik som kallas retrieval‑augmented generation sökte systemet i detta bibliotek efter relevanta avsnitt varje gång en fråga ställdes och använde dem för att forma sitt svar, i syfte att efterlikna vad en patient skulle höra under en typisk stolssession.

Hur studien testade de två systemen

För att se hur väl denna specialiserade chatbot fungerade jämförde teamet den med ChatGPT‑4, använd via den vanliga ChatGPT Plus‑gränssnittet. De sammanställde 30 verklighetsnära frågor som patienter ofta ställer före, under och efter behandlingen med tandställning — till exempel om tandställning orsakar smärta, hur den påverkar tal eller sång, hur ofta kontrollbesök behövs och om tandställning kan hjälpa vid käkledsproblem. Båda systemen fick samma uppmaningar, där de instruerades att svara som en ortodontisk expert med tydligt, patientvänligt språk. Sex erfarna ortodontikonsulter bedömde sedan varje anonymiserat svar på fyra aspekter: korrekthet, tydlighet, relevans för frågan och hur aktuellt informationen verkade vara, med en femgradig skala.

Mäta kvalitet, inte bara åsikter

I stället för att förlita sig på allmänna intryck använde forskarna en strukturerad poängmetod kallad Content Validity Index. För varje fråga och varje kvalitetsaspekt räknade de hur många experter som bedömde ett svar som ”instämmer” eller ”instämmer helt” och omvandlade detta till ett värde mellan noll och ett. Höga poäng betydde att de flesta experter ansåg att svaret var korrekt, tydligt, relevant eller aktuellt. De beräknade också medelvärden över alla frågor för att se hur varje system presterade totalt. Statistiska tester användes för att kontrollera om eventuella skillnader mellan de två chatbotarna var tillräckligt stora för att betraktas som meningsfulla snarare än slumpmässiga.

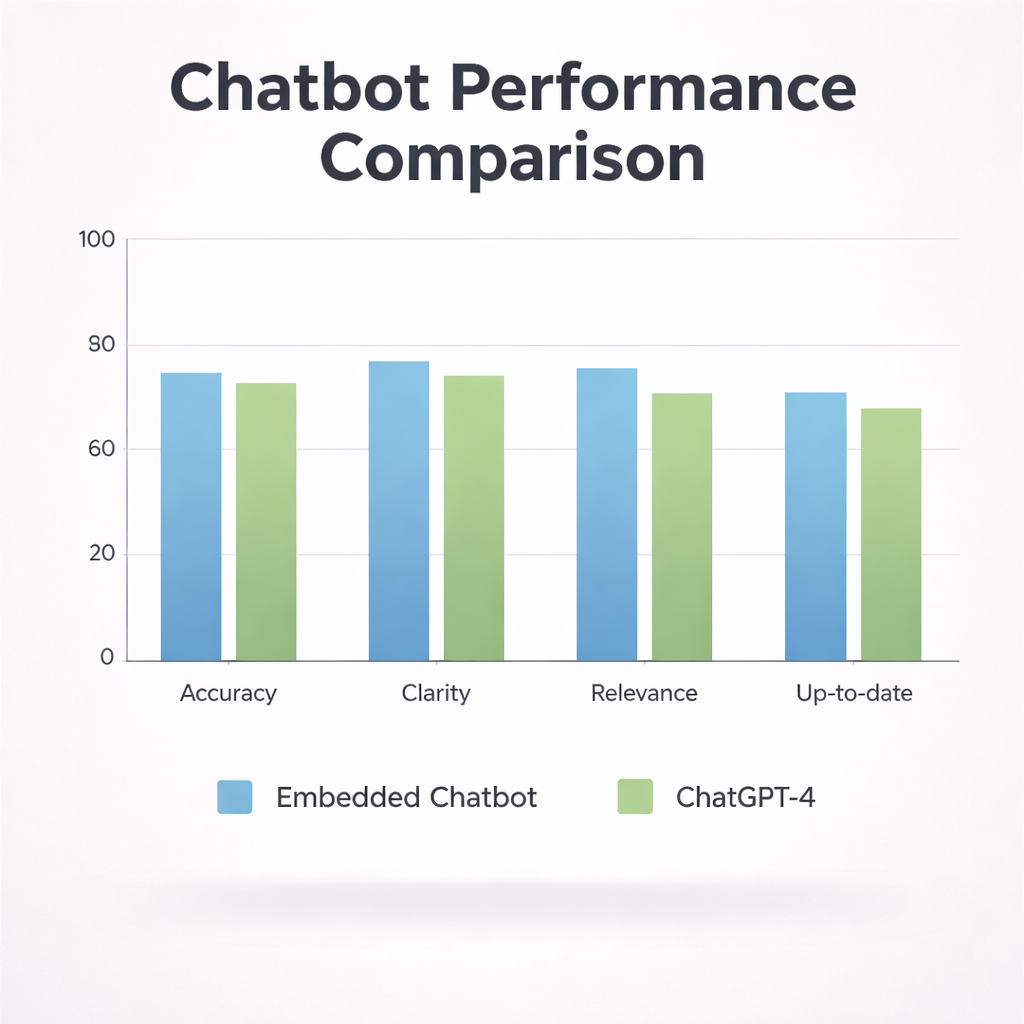

Vad ortodontisterna tyckte om svaren

Den inbäddade chatboten kom i stort sett ut i fördel. Omkring tre fjärdedelar av dess svar nådde en acceptabel kvalitetsnivå, jämfört med strax över hälften av svaren från ChatGPT‑4. I genomsnitt fick den specialiserade chatboten bättre poäng i korrekthet, tydlighet och relevans, och den verkade också något mer i linje med aktuell vägledning. Till exempel, när den förklarade smärta under behandling med tandställning eller huruvida tandställning påverkar tal, var dess svar raka, konkreta och nära standardråd till patienter. Däremot var ChatGPT‑4:s svar, även om de ofta var rimliga, mer generella och ibland mer tekniska, vilket kan ha minskat deras tydlighet i experternas ögon. När forskarna dock genomförde formella statistiska tester var skillnaderna mellan de två systemen inte tillräckligt stora för att vara statistiskt signifikanta.

Begränsningar och lärdomar för framtida AI på kliniken

Studien visade också att även experter inte alltid är överens om vad som räknas som det ”bästa” svaret. Den övergripande överensstämmelsen mellan ortodontisterna var svagare än förväntat, särskilt för subjektiva aspekter som tydlighet och relevans. Forskarna noterade flera andra begränsningar: de studerade bara två AI‑uppsättningar, involverade inte patienter direkt och baserade sin specialiserade chatbot på ett specifikt urval av skriftligt material. Ändå bidrar deras arbete till den växande evidensen att AI‑system kan besvara många vanliga tandvårdsfrågor på ett någorlunda bra sätt, och att tillägg av fokuserat, uppdaterat referensmaterial kan förbättra prestationen.

Vad detta innebär för personer med tandställning

För patienter är slutsatsen uppmuntrande men försiktig. En väl utformad, ortodontiskt inriktad chatbot kan ge tydliga, trovärdiga svar på många vardagsfrågor och kan minska oro mellan avtalade besök. Samtidigt visar denna studie att ett sådant verktyg ännu inte ersätter behovet av professionellt omdöme eller personliga råd. Det verkliga löftet ligger i att kombinera dessa anpassade AI‑hjälpmedel med expertvård, så att personer med tandställning kan få snabb, lättförståelig information samtidigt som de fortfarande förlitar sig på sin ortodontist för slutgiltiga beslut.

Citering: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Nyckelord: ortodontisk chatbot, tandvårds-AI, frågor om tandställning, patientutbildning, jämförelse med ChatGPT