Clear Sky Science · sv

Multimodala stora språkmodeller utmanar NEJM:s bildutmaning

Varför detta är viktigt för patienter och läkare

Att få rätt diagnos i rätt tid kan vara skillnaden mellan snabb behandling och år av lidande. Ändå missar eller fördröjer läkare, även mycket utbildade sådana, fortfarande diagnoser, särskilt vid sällsynta eller ovanliga sjukdomar. Denna studie ställer en slående fråga: när medicinska bilder och kliniska detaljer matas in i dagens mest avancerade artificiella intelligenssystem, kan de då faktiskt diagnostisera komplexa fall bättre än ett stort antal verkliga läkare — och i så fall vad innebär det för framtidens vård?

En enorm pusselbyggnad av verkliga fall

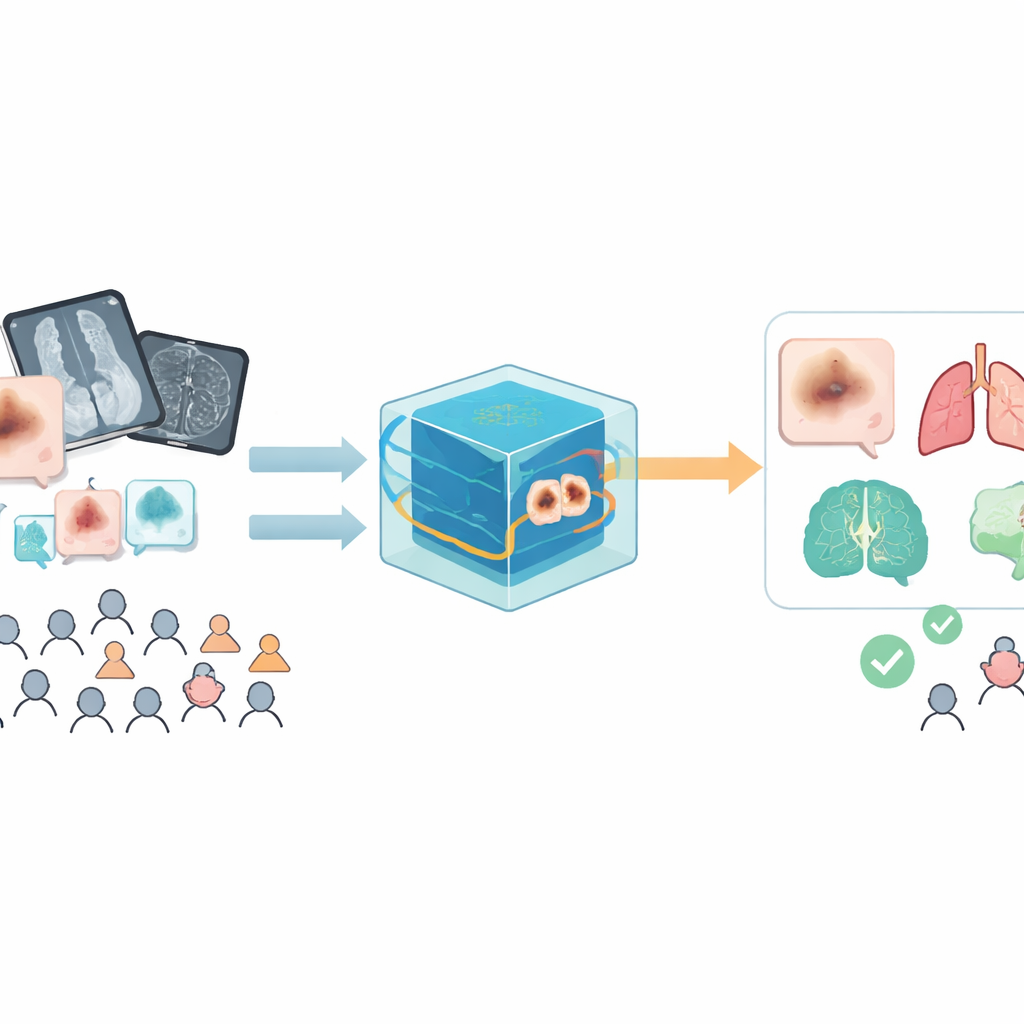

Forskarna vände sig till en långlivad följetong i New England Journal of Medicine kallad "Image Challenge." Varje utmaning presenterar en verklig patients medicinska bild — till exempel ett hudfoto, röntgen, MRT eller mikroskopisk preparat — tillsammans med en kort klinisk historia och fem möjliga diagnoser. Sedan 2009 har över 16 miljoner svar från mer än 60 000 läkare per fall samlats, vilket skapat ett unikt globalt register över hur läkare presterar på samma svåra frågor. Ur detta arkiv valde teamet 272 fall som täcker alla åldrar, båda könen och ett brett spektrum av tillstånd, från infektioner och immunrubbningar till cancer, genetiska sjukdomar och skador.

Sätta AI och läkare på samma spelplan

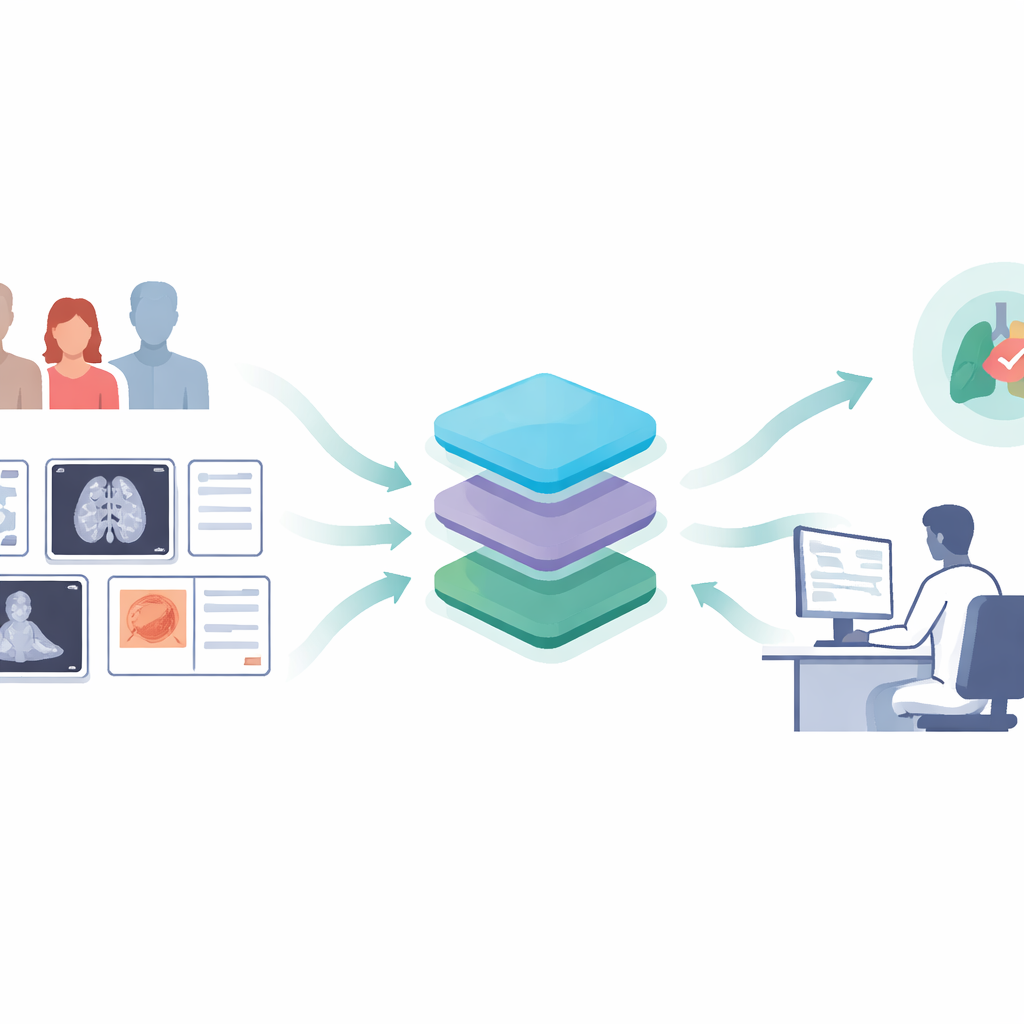

Studien testade tre ledande multimodala stora språkmodeller — system som kan se bilder och läsa text tillsammans: GPT‑4o, Claude 3.7 och Doubao. För varje fall fick modellerna först se endast bilden och var tvungna att välja ett av de fem alternativen med en motivering. Därefter såg de bilden plus den kliniska beskrivningen och svarade igen. För att hålla testet rättvist användes modellerna i standardinställningar, med webbsök och extra resonemangsfunktioner avstängda, och varje fall kördes i en ny session för att undvika kontaminering från tidigare svar. Två läkare graderade AI-svaren mot New England Journals officiella lösningar, med fokus på om det slutliga valet stämde överens med den riktiga diagnosen, precis som den mänskliga referensen gör.

Övermänsklig prestation över sjukdomar och bildtyper

När modellerna fick både bilder och text överträffade alla tre AI-systemen tydligt den globala skaran av läkare. Claude 3.7 och GPT‑4o nådde vardera omkring 89–90 % träffsäkerhet, jämfört med 46,7 % för majoritetsrösten bland människor — en skillnad på mer än 40 procentenheter. Även i de svåraste fallen, där färre än 40 % av läkarna hade rätt, fick Claude 3.7 fortfarande 86,5 % av diagnoserna rätt. Fördelen höll i sig över de flesta sjukdomstyper och bildformat: modellerna var särskilt starka vid läkemedelsrelaterade och genetiska tillstånd, och hanterade inte bara foton och röntgen utan även endoskopiska, patologiska och blandade bildset. Prestationen var lika stark för män och kvinnor, och i några av de mest sårbara grupperna, såsom spädbarn under ett år, var modellerna dramatiskt mer träffsäkra än läkarna.

Olika sätt att tänka, inte bara snabbare

Kanske det mest överraskande fyndet var hur ofta modellerna lyckades när läkare inte gjorde det. I nära hälften av fallen var Claude 3.7 korrekt medan majoriteten av läkarna hade fel, och motsatsen — läkare rätt, modell fel — var sällsynt. Sammantaget fanns det för Claude 3.7 ungefär femton "modell-fördel"-fall för varje ett "läkar-fördel"-fall. Ändå var överensstämmelsen mellan människor och AI om vilket svar som skulle väljas låg, ett tecken på att systemen inte bara återger mänskliga mönster utan når korrekta diagnoser via andra vägar. Tillägget av klinisk text hjälpte i allmänhet mycket och ökade AI:ns träffsäkerhet med 28–42 procentenheter jämfört med enbart bilder. Fortfarande, i en liten bråkdel av fallen, ledde extra detaljer modeller från ett korrekt bildbaserat svar till ett felaktigt, vilket antyder nya slags biaser och felmodi som kommer att behöva noggrann forskning.

Vad detta kan betyda för framtida vård

Författarna drar slutsatsen att multimodala stora språkmodeller har nått en "övermänsklig" nivå i detta krävande diagnostiska quiz: de är mer träffsäkra än den genomsnittliga läkarkollektiven och behåller sin fördel även när fallen ställer de flesta läkare inför svårigheter. Samtidigt tyder deras låga överlappning med mänskliga val på att de tänker på kompletterande sätt snarare än att fungera som digitala kopior av kliniker. Använda klokt kan dessa system fungera som kraftfulla sekundärgranskare, erbjuda oberoende bedömningar i svåra eller sällsynta fall och hjälpa till att fånga problem som mänskliga läkare kan missa. De är inte redo att ersätta kliniskt omdöme, men de kan snart bli värdefulla partners vid sängen och i avläsningsrummet, tyst kontrollerande vårt arbete och breddande säkerhetsnätet för patienter.

Citering: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Nyckelord: medicinsk diagnos, artificiell intelligens, medicinsk bilddiagnostik, sällsynta sjukdomar, kliniskt beslutsstöd