Clear Sky Science · sv

RFGLNet för domängenerell semantisk segmentering i dåligt väder med frekvensbaserad låg-rank-förstärkning

Se vägen när vädret blir dåligt

Autonoma bilar och leveransrobotar lovar säkrare och mer effektiva gator — men bara om de pålitligt kan ”se” omgivningen. Regn, dimma, snö och mörka nätter gör den synen extremt svår: kontraster tvättas ut, brus tillkommer och konturer av människor, bilar och trottoarkanter blir oskarpa. Denna artikel presenterar RFGLNet, ett nytt datorsynssystem utformat för att hålla maskiners förståelse av vägen skarp även när vädret är som värst.

Varför dåligt väder förblindar maskiner

Dagens självkörande system förlitar sig ofta på en process som kallas semantisk segmentering, där en algoritm tilldelar varje pixel i en bild en klass — som väg, bil, gående eller byggnad. I klart dagsljus klarar moderna neurala nätverk detta mycket bra. Vid kraftigt regn eller tät dimma förlorar bilder dock ljusstyrka, får mer brus och utvecklar suddiga gränser mellan objekt. Att samla in och annotera enorma dataset för varje fientligt väder är ekonomiskt oöverkomligt, så de flesta system tränas främst på normala, soliga bilder. När de ställs inför okända stormar eller snö faller prestationen kraftigt. Tidigare lösningar försökte antingen först rengöra bilderna och sedan segmentera dem, eller anpassa modeller till specifika målförhållanden. Båda angreppssätten tenderar att vara sköra, långsamma eller alltför beroende av märkt data från dåligt väder.

Ett nytt nätverk byggt för tuffa förhållanden

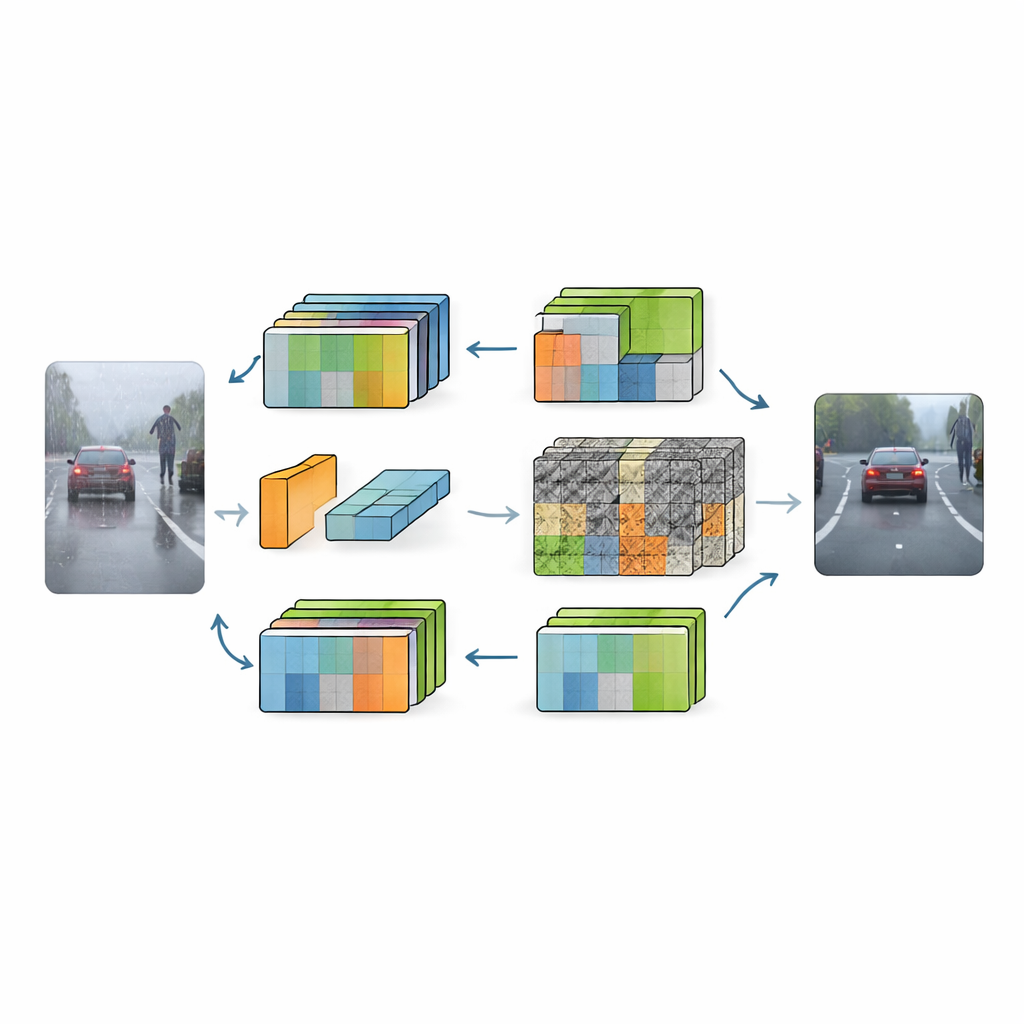

RFGLNet tacklar problemet med en annan strategi: det lär sig enbart från standardbilder av stadsmiljöer dagtid, men generaliserar till ett brett spektrum hårda förhållanden. Författarna utgår från DINOv2, en stor, förtränad visuell modell känd för att fånga rik scenstruktur. I stället för att träna om denna tunga ryggrad från grunden fryser de dess parametrar och lägger till ett lättviktslager av moduler ovanpå. Dessa moduler fungerar som smarta adaptrar som omformar ryggradens interna representationer så att de blir mindre störda av visuellt skräp från snöflingor, regndroppar eller mörker. Resultatet är ett system som använder endast 4,32 miljoner träningsbara parametrar — litet jämfört med typiska synmodeller — samtidigt som det lär sig hantera väder det aldrig sett under träning.

Hur nätverket lär sig filtrera väder

RFGLNets första innovation är en låg-rank-modul som kopplas in i varje lager av den frysta ryggraden. Före träning kör modulen en matematisk procedur känd som singularvärdesuppdelning på en simulerad feature-matris. Detta ger en uppsättning kompakta komponenter som ungefär matchar strukturen i DINOv2:s interna features från början, istället för att börja från slumpmässigt brus. Under träning justeras dessa komponenter, vilket tillåter modulen att varsamt korrigera ryggradens features för den nya uppgiften utan att rubba dess kärnkunskap. Nätverket använder sedan ett Fourier-baserat uppmärksamhetsblock som förflyttar features till frekvensdomänen. Där tenderar breda, långsamt varierande strukturer att representera meningsfulla objekt, medan skarpa, ojämna mönster ofta motsvarar väderbrus. Genom att dämpa högfrekvent skräp och förstärka mjukare komponenter stärker systemet den globala scenförståelsen samtidigt som störningar tonas ned.

Skärpa detaljer utan att bli distraherad

Även med renare globala features förblir små detaljer som vägmarkeringar, räckesstänger och konturen av en avlägsen fotgängare sårbara för suddighet i dåligt väder. För att hantera detta introducerar författarna en grupperad spatial uppmärksamhetsmodul i nätverkets avkodare. Istället för att behandla alla feature-kanaler tillsammans delar den upp dem i grupper och lär separata spatiala viktkartor för varje grupp. Kanaler som bär viktig struktur, som kanter, kan då betonas medan kanaler dominerade av brus dämpas. Dessa gruppspecifika kartor smälts samman till en global spatial viktning som förbättrar fina detaljer och skärper objektgränser över flera upplösningar. I praktiken lär sig RFGLNet var den ska titta noggrant och var den ska ignorera distraherande dim- eller regnpärlor.

Verkliga förbättringar i utmanande vägscener

För att testa tillvägagångssättet tränade forskarna RFGLNet på det välkända Cityscapes-datasetet med klara stadsscener dagtid och utvärderade det sedan på ACDC-datasetet, som fokuserar på regn, snö, dimma och nattkörning. Utan att någonsin se ACDC-etiketter under träning nådde RFGLNet ett medelvärde för Intersection over Union på 78,3 procent — och överträffade flera ledande metoder för domängeneralisering och anpassning, många av dem större och mer beräkningskrävande. Det var särskilt starkt på att segmentera svåra klasser som väggar och staket, vars kanter lätt går förlorade i ogynnsamt väder. Samtidigt kördes modellen effektivt på en enda konsument-GPU och bearbetade dussintals bilder per sekund, ett krav för realtidssystem i körning.

Klarare syn för säkrare autonomi

För icke-specialister är slutsatsen att RFGLNet visar hur man kan uppgradera befintliga synryggradsmodeller för säkrare autonomi utan oändlig omträning för varje möjlig storm. Genom att kombinera kompakt låg-rank-justering, frekvensbaserat brusfilter och grupperad spatial uppmärksamhet lär sig systemet att hålla viktig scenstruktur intakt samtidigt som väderrelaterat skräp borstas bort. När sådana metoder mognar och tränas på bredare samlingar av verkliga förhållanden kan de hjälpa självkörande bilar och robotar att behålla pålitlig situationsmedvetenhet när himlen mörknar och vägen framför är långt ifrån klar.

Citering: Ye, X., Shi, X. & Li, Y. RFGLNet for adverse weather domain-generalized semantic segmentation with frequency low-rank enhancement. Sci Rep 16, 8253 (2026). https://doi.org/10.1038/s41598-026-39052-y

Nyckelord: autonom körning, perception i dåligt väder, semantisk segmentering, robusthet inom datorsyn, domängeneralisering