Clear Sky Science · sv

Finjusterade stora språkmodeller med strukturerade prompts möjliggör effektiv konstruktion av kunskapsgrafer för lungcancer

Varför det spelar roll att göra medicinsk text till kartor

Lungcancer är en av världens dödligaste cancerformer, och information om hur den diagnostiseras och behandlas är utspridd i forskningsartiklar, journalanteckningar, onlinerådgivning och traditionella medicinska fallböcker. Läkare och forskare har svårt att hinna med denna textström. Denna studie undersöker ett nytt sätt att automatiskt förvandla den spridda kunskapen till en enda, navigerbar "karta"—en kunskapsgraf för lungcancer—genom att använda en finjusterad stor språkmodell och noggrant strukturerade prompts. Målet är att göra komplex medicinsk kunskap enklare för datorer att söka i och för experter att använda i beslutsstödsverktyg.

Från utspridda berättelser till sammanknytna fakta

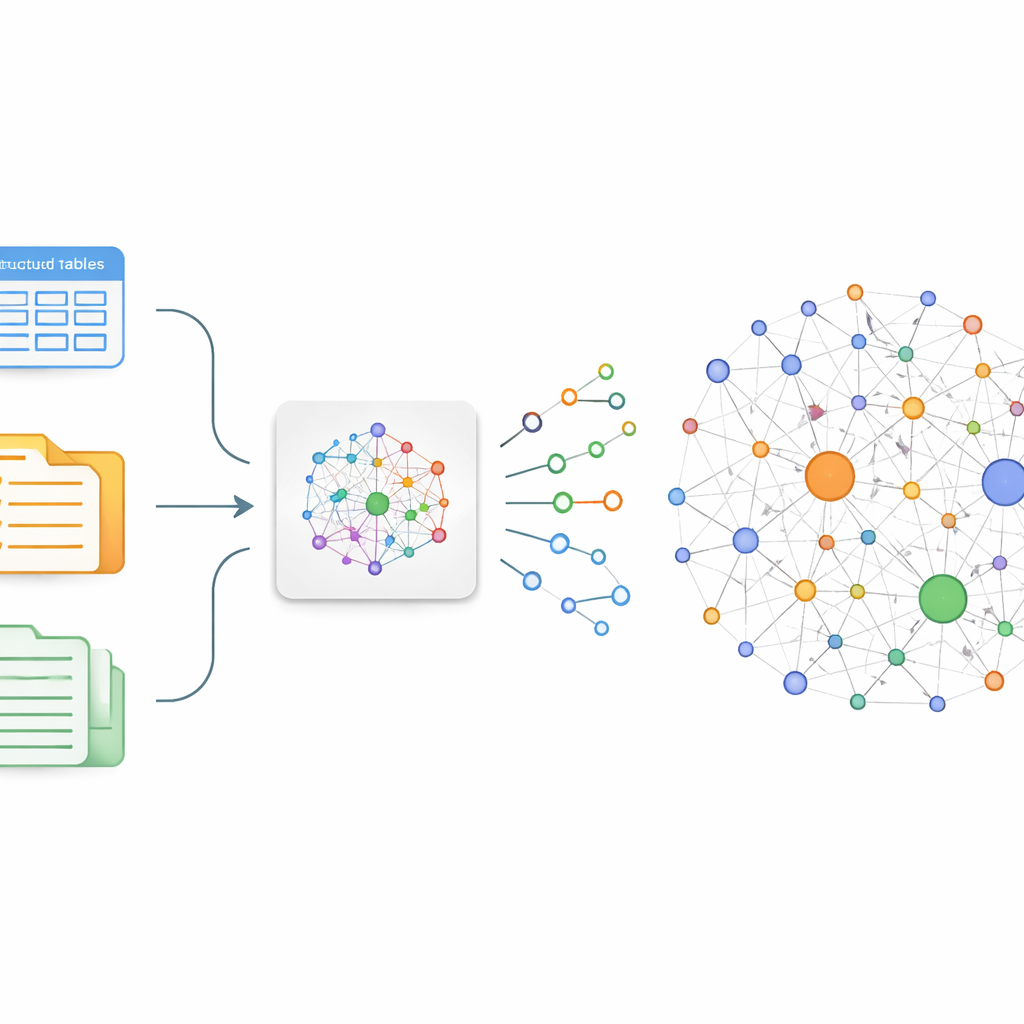

Författarna fokuserar på en enkel idé: om man på ett tillförlitligt sätt kan plocka ut vem-gör-vad-med-vad från medicinsk text, kan man sy ihop dessa fakta till en graf. I praktiken innebär det att omvandla friformssatser till små byggstenar kallade tripplar—par av entiteter kopplade genom en relation, till exempel "lungcancer – behandlas med – kemoterapi." Traditionella metoder för att bygga sådana grafer kräver antingen arméer av annotatörer eller sköra regler som missar nyanser och nya upptäckter. För att övervinna detta finjusterar teamet en befintlig kinesisk stor språkmodell, ChatGLM-6B, så att den specialiserar sig på att upptäcka medicinskt meningsfulla tripplar om lungcancer i en mängd källor, från onlinedialoger mellan patienter och läkare till strukturerade databaser och traditionell kinesisk medicin.

Att lära en AI att tänka i ordnade enheter

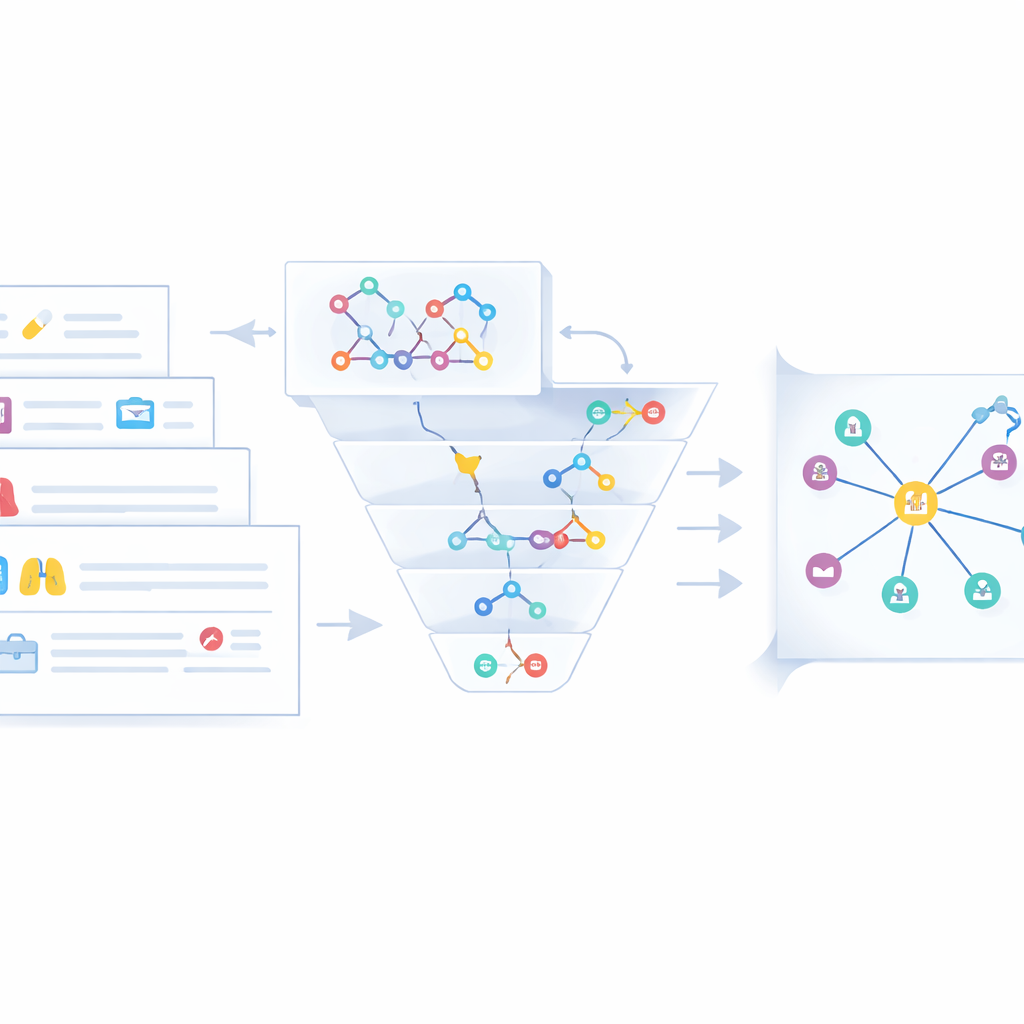

Att bara be en allmän språkmodell att "extrahera information" ger ofta röriga, pratiga svar. Forskarna utformar därför ett strikt prompting-upplägg och finjusterar modellen på nästan 50 000 exempel på önskat beteende. Varje exempel visar en instruktion och det exakta tripplutfallet som förväntas. Prompten instruerar modellen att agera som en professionell textminingexpert, att endast producera strukturerade tripplar i ett datorläsbart format och att "tänka steg för steg" när satser innehåller inbäddade detaljer—till exempel en behandling, läkemedlet som används och dess dosering. Denna kombination av rollbeskrivning, formatregler och stegvis resonemang förvandlar modellen—nu kallad KGLM—från en konversationell assistent till en disciplinerad extraherare av maskinläsbara fakta.

Att slå samman många röster till en tydlig graf

Råa tripplar från text är bara en del av bilden. Samma sjukdom eller läkemedel förekommer ofta under olika namn—"kroniskt obstruktiv lungsjukdom" jämfört med "KOL", till exempel. För att undvika oreda och förvirring utformar författarna en fusionsfas som slår ihop ekvivalenta entiteter över tre datakanaler: ostrukturerad webbtext, semistrukturerade kliniska fall och befintliga medicinska kunskapsgrafer. Först flaggar en snabb strängbaserad likhetskontroll uppenbara matchningar. När det inte räcker används en djupare semantisk likhetsmodell (Sentence-BERT) för att jämföra betydelser i kontext. Entiteter som bedöms vara dubbletter slås ihop till en enda kanonisk nod, där kortare namn föredras och andra former sparas som alias. Experter granskar sedan kantfall och tar bort missvisande eller lågkvalitativa uttalanden, vilket ger en renare och mer koherent kunskapsgraf för lungcancer som lagras i en Neo4j-databas.

Hur väl fungerar denna kunskapskarta?

För att mäta prestanda jämför teamet KGLM med standardmetoder inom djupinlärning baserade på BERT och konvolutionsnätverk, samt med den ursprungliga, ofinjusterade ChatGLM-modellen. I uppgiften relationsutvinning—att avgöra vilka entiteter som är kopplade och hur—uppnår den finjusterade, promptstyrda KGLM ett F1-värde på cirka 0,82, vilket överträffar alla testade referensmetoder och förbättrar resultatet med ungefär 25 procent jämfört med startmodellen. Ablationsstudier visar att varje promptkomponent har betydelse: att ta bort expertrollen, det strikta tripplformatet eller vägledningen att "tänka steg för steg" försämrar alla noggrannheten, särskilt för komplexa satser med inbäddade attribut eller terminologi från traditionell kinesisk medicin. En panel av kliniska och informatikexperter bedömer också att den resulterande grafen är mer korrekt, användbar och kliniskt relevant än grafer byggda utan finjustering eller strukturerade prompts.

Vad detta betyder för framtida medicinska verktyg

Enkelt uttryckt visar studien att med rätt träning och instruktioner kan en stor språkmodell effektivt förvandla rörig, verklighetsnära text om lungcancer till ett strukturerat, sökbart nätverk av fakta. Denna kunskapsgraf för lungcancer, även om den fortfarande är en forskningsprototyp och begränsad till kineskspråkiga källor och ett enda sjukdomsområde, pekar mot en framtid där ständigt uppdaterade "kunskapskartor" kan stödja beslutsstödsystem, utbildningsverktyg och forskningsutforskning. Författarna betonar att sådana grafer måste valideras noggrant och uppdateras regelbundet, och att de inte är redo att styra vård utan expertöversyn. Trots detta tyder deras resultat på att finjusterade språkmodeller tillsammans med smart prompting kan göra den svåra uppgiften att organisera medicinsk kunskap mer skalbar och aktuell.

Citering: Zhou, C., Gong, Q., Luan, H. et al. Fine-tuned large language models with structured prompts enable efficient construction of lung cancer knowledge graphs. Sci Rep 16, 9505 (2026). https://doi.org/10.1038/s41598-026-38959-w

Nyckelord: lungcancer, kunskapsgraf, stor språkmodell, relationsutvinning, medicinsk AI