Clear Sky Science · sv

Ansiktsuttrycksigenkänning via variationell inferens

Att läsa känslor i ansikten

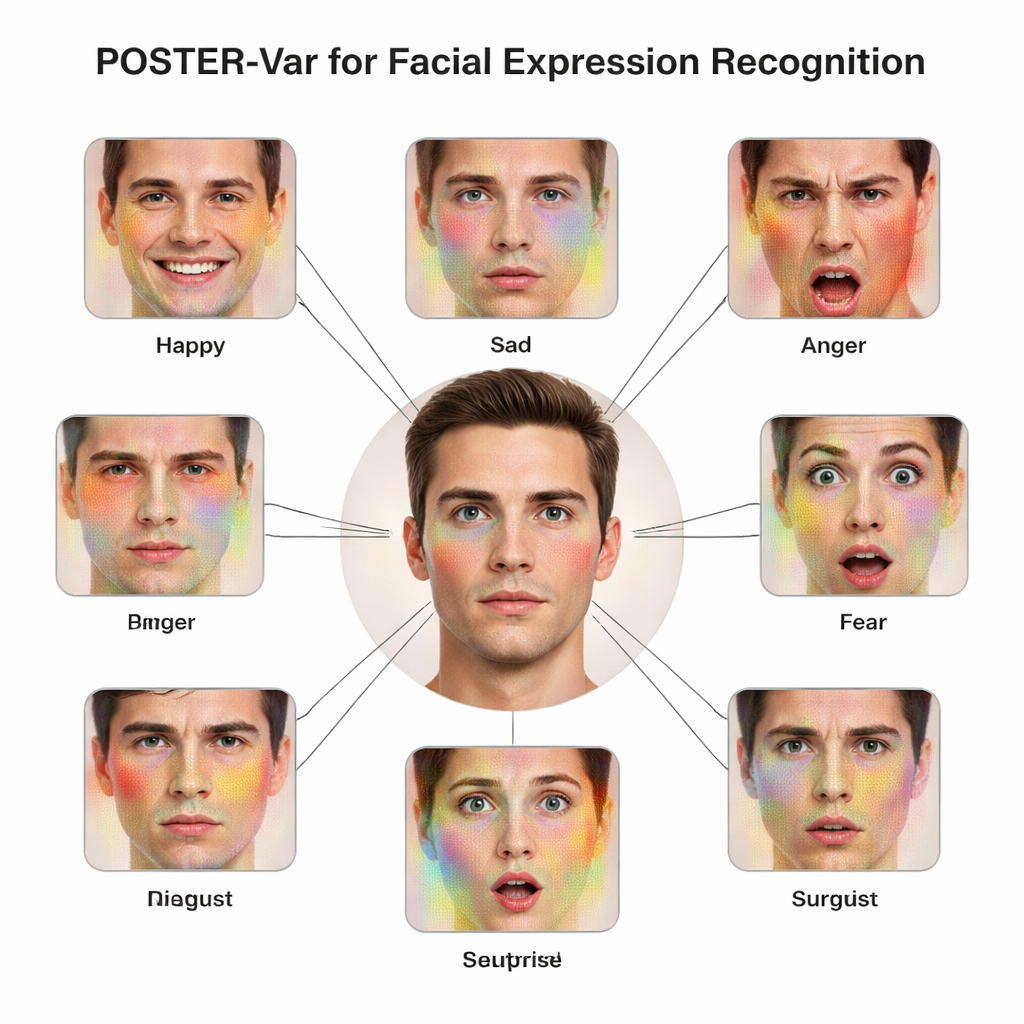

Våra ansikten signalerar ständigt hur vi mår, men de signalerna är sällan enkla. Ett leende kan dölja nervositet, och ett ”neutralt” uttryck kan blanda tristess med irritation. Denna studie presenterar POSTER-Var, ett nytt artificiellt intelligenssystem (AI) som syftar till att läsa sådana subtila, blandade känslor mer noggrant än dagens verktyg för ansiktsuttryck, vilket potentiellt kan förbättra allt från människa–datorinteraktion till övervakning av mental hälsa.

Varför känslor inte bara är på eller av

De flesta befintliga system för ansiktsuttrycksigenkänning behandlar känslor som separata, tydliga fack: glad, ledsen, arg och så vidare. I verkligheten visar psykologin att uttryck är blandningar av grundläggande känslor, där olika styrkor kan synas samtidigt i ett enda ansikte. Traditionella AI-modeller tvingar vanligtvis varje bild in i en hård etikett och ignorerar osäkerhet och känslors kontinuerliga, graderade natur. Det gör dem sköra i röriga verkliga miljöer, där belysning, pose och även inkonsekventa mänskliga etiketter tillför brus. Författarna menar att framtida system måste erkänna att ett ansikte kan antyda flera känslor i olika intensitet, och att datorer bör resonera i sannolikheter snarare än ja-eller-nej‑beslut.

Att låta modellen omfamna osäkerhet

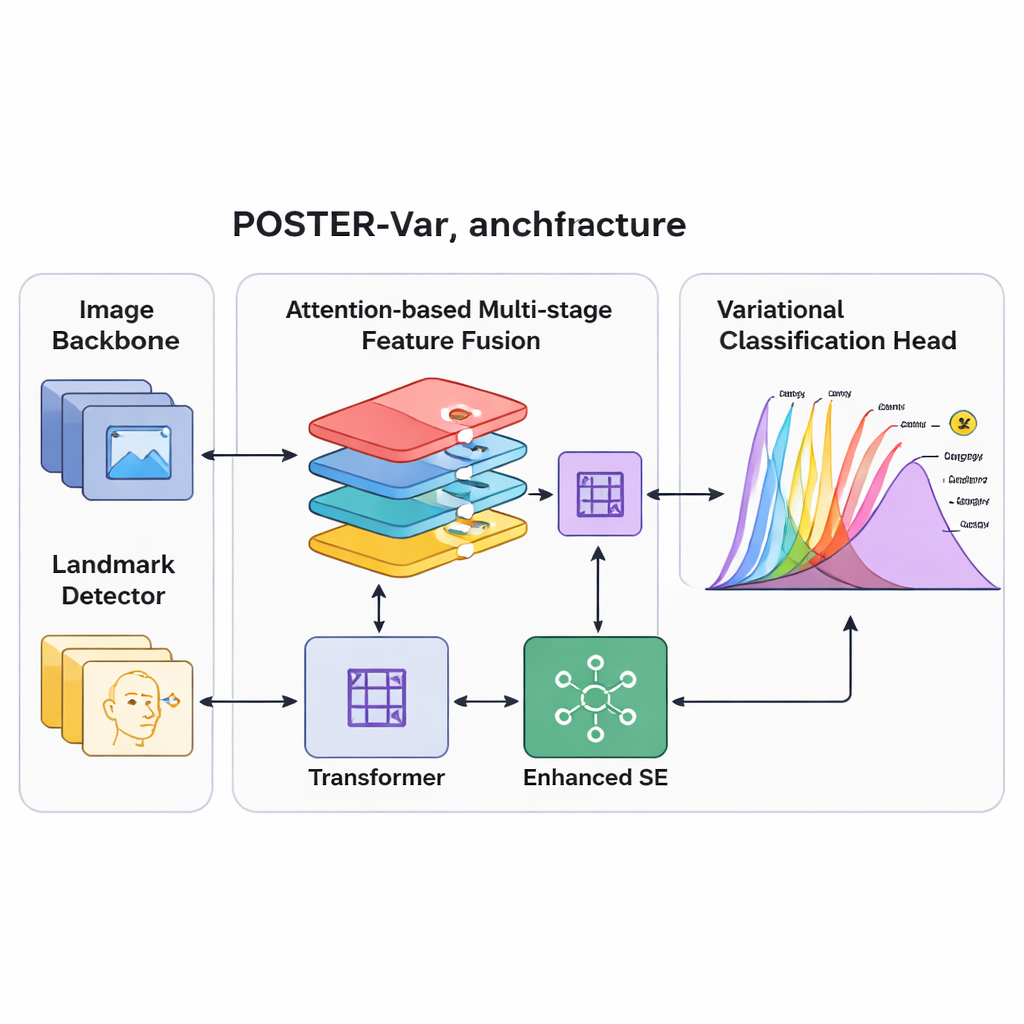

För att bättre stämma överens med denna röriga verklighet bygger teamet vidare på en teknik från modern probabilistisk modellering kallad variationell inferens. Istället för att producera ett enda fast poäng för varje känsla kartlägger deras POSTER-Var-system ansiktsdrag till ett ”latensutrymme” där varje känsla representeras av en sannolikhetsfördelning, vanligen formad som en klockkurva. Under träningen drar systemet prover från dessa inlärda fördelningar, vilket uppmuntrar det att utforska en rad möjliga tolkningar av varje ansikte. Vid testtid använder det dock enkelt fördelningarnas centrumpunkter för att göra stabila förutsägelser. Avgörande är att POSTER-Var tar bort extra avkodnings- och fullt anslutna lager som användes i tidigare variationella konstruktioner, och behandlar den probabilistiska representationen själv som det slutgiltiga beslutsignalet. Detta strömlinjeformade ”Variational Inference-based Classification Head”, eller VICH, låter modellen kvantifiera osäkerhet samtidigt som den förblir effektiv och noggrann.

Se ansiktet i flera skalaor

Att känna igen uttryck kräver också att man tittar på olika delar av ansiktet och på olika detaljnivåer: munens kurva, ögats form och den övergripande konfigurationen spelar alla roll. POSTER-Var bygger vidare på ett starkt föregångarsystem (POSTER++) genom att förbättra hur dessa flerskaliga funktioner kombineras. Det använder flera uppmärksamhetsmekanismer för att förena information från en standardbildryggrad och en detektor för ansiktslandmärken, som spårar nyckelpunkter som ögonhörn och mungipor. En ”layer embedding” markerar varje funktionskarta med dess position och semantiska nivå i bearbetningspyramiden, vilket hjälper nätverket att förstå vilka detaljer som kommer varifrån. Icke-linjära transformationer och ett förbättrat kanaluppmärksamhetsblock återbalanserar sedan dessa funktioner, förstärker de som är mest informativa för uttryck samtidigt som störningar som bakgrundsbrus eller identitetsspecifika egenheter dämpas.

Sätta systemet på prov

Forskarlaget utvärderade POSTER-Var på tre välanvända verkliga datasets: RAF-DB, AffectNet och FER+. Dessa samlingar inkluderar hundratusentals ansikten fångade under okontrollerade förhållanden, var och en etiketterad med en av flera grundläggande känslor. Över alla benchmarks matchade eller överträffade POSTER-Var de nuvarande toppmetoderna. Till exempel nådde det cirka 93 % noggrannhet på RAF-DB och ungefär 92 % på FER+, och gav något förbättrade resultat på både 7-klass och 8-klassversioner av AffectNet. Ablationsstudier, där enskilda komponenter togs bort, visade att både layer embedding och den variationella headen bidrog märkbart till prestandan, där den variationella komponenten var särskilt hjälpsam på svårare, mer obalanserade datasätt. Visualiseringar av uppmärksamhetskartor avslöjade att POSTER-Var fokuserar på bredare, mer meningsfulla ansiktsregioner än baslinjen, och plottar av dess inlärda känslefördelningar illustrerade hur det bättre separerar till exempel ”ledsen” från ”neutral” i tvetydiga fall.

Vad detta betyder för tillämpningar i verkliga världen

Enkelt uttryckt lär POSTER-Var maskiner att behandla ansiktsuttryck mindre som trafikljus och mer som väderprognoser: det kan finnas ett huvudtema av ”soligt” med spridda ”molniga” inslag, och prognosen bör erkänna osäkerhet. Genom att modellera hela fördelningar över känslor snarare än en enda gissning blir systemet mer robust mot brusiga etiketter och subtila, blandade uttryck. Studien antyder att sådana probabilistiska tillvägagångssätt kan ligga till grund för nästa generation av affektmedvetna teknologier, vilket gör virtuella assistenter, sociala robotar och verktyg för beteendeforskning bättre anpassade till det komplexa känsloliv som våra ansikten bara ofullkomligt avslöjar.

Citering: Lv, G., Zhang, J. & Tsoi, C. Facial expression recognition via variational inference. Sci Rep 16, 7323 (2026). https://doi.org/10.1038/s41598-026-38734-x

Nyckelord: ansiktsuttrycksigenkänning, emotionell AI, probabilistisk modellering, variationell inferens, datorseende