Clear Sky Science · sv

Uppmärksamhetsbaserad arbetsbelastningsprognos och dynamisk resursallokering för heterogena datormiljöer

Varför smartare datorer spelar roll för alla

Bakom varje film du strömmar, karta du öppnar eller AI-assistent du talar med arbetar enorma lager av datorer diskret dygnet runt. I takt med att artificiell intelligens blir allt kraftfullare pressas dessa datacenter mot sina gränser: de måste jonglera många typer av jobb på många typer av maskiner samtidigt som kostnader, hastighet och energianvändning hålls under kontroll. Denna artikel presenterar ett nytt sätt att förutse vad dessa datorer behöver inom en nära framtid och att fördela arbete över olika hårdvarutyper så att tjänsterna förblir snabba och tillförlitliga samtidigt som onödig elförbrukning minskas.

Många jobb, många maskiner

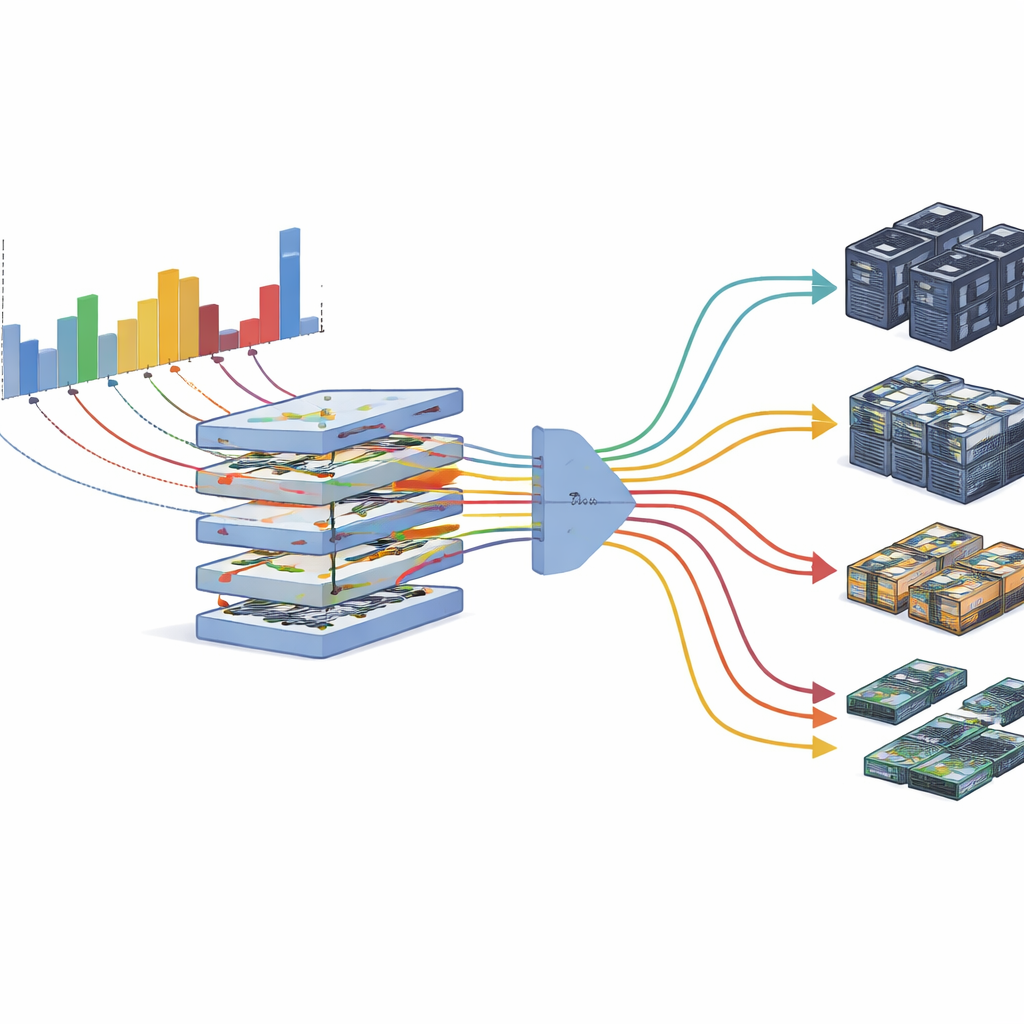

Moderna datacenter förlitar sig inte längre på en enda typ av server. Istället kombinerar de traditionella processorer med kraftfulla grafikchip, specialbyggda AI-kort och omprogrammerbara kretsar. Olika AI-uppgifter — såsom träning av stora språkmodeller, realtidstjänster för rekommendationer eller bildanalys — passar dessa maskiner på mycket olika sätt. Idag tilldelar operatörer ofta resurser med fasta regler eller enkla prognoser baserade på gårdagens användning. När efterfrågan plötsligt skjuter i höjden kan detta orsaka fördröjningar eller brutna serviceavtal; när efterfrågan sjunker kan dyrbar hårdvara stå oanvänd och förbruka ström utan att uträtta mycket.

Lära sig att titta där det spelar roll

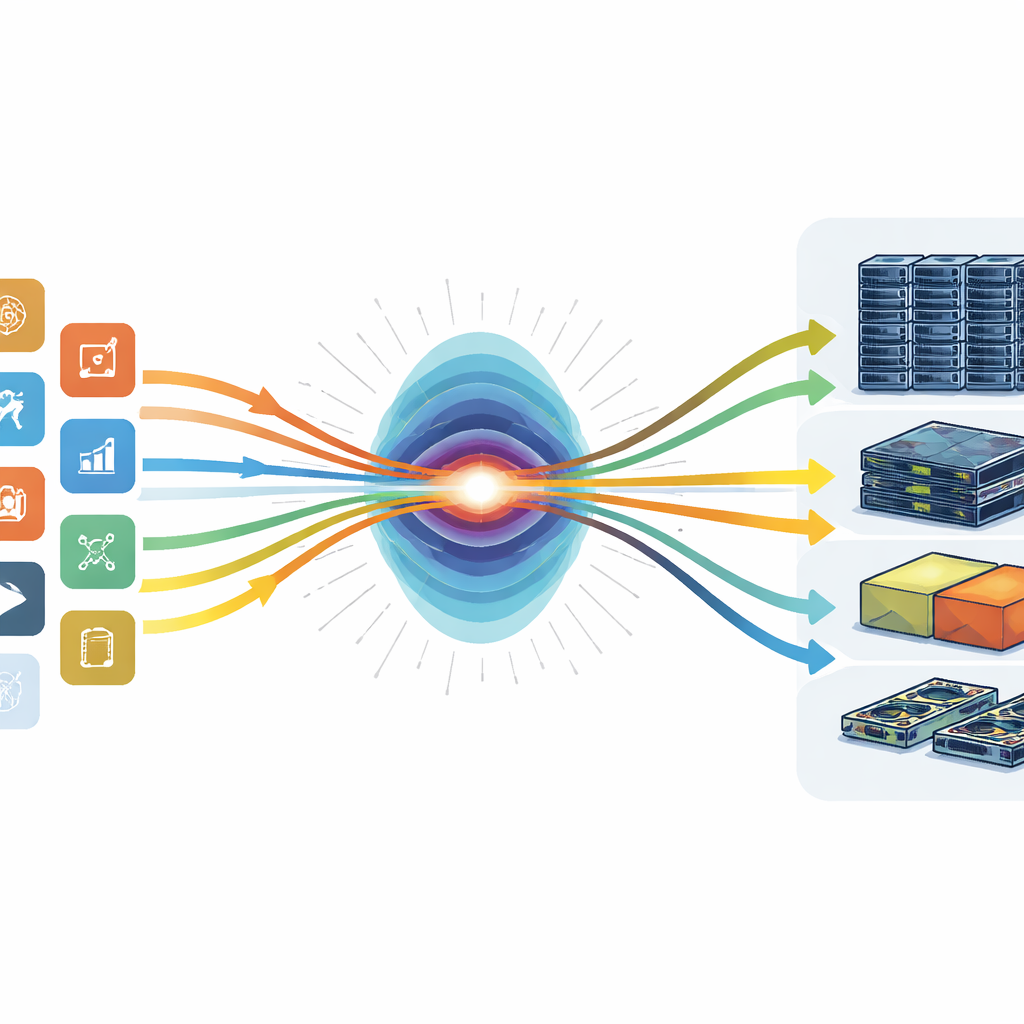

Författarna lånar ett begrepp från avancerade AI-modeller kallat ”attention” (uppmärksamhet) och tillämpar det på datacenterstyrning. Istället för att behandla all historisk användningsdata likvärdigt lär sig deras system vilka tidpunkter och vilka typer av jobb som är mest användbara för att gissa vad som kommer att hända härnäst. En del av modellen fokuserar på hur varje arbetsbelastning — exempelvis ett träningsjobb eller en onlinetjänst — förändras över tid. En annan del ser tvärs över olika arbetsbelastningar som körs samtidigt för att avslöja dolda samband, till exempel ett mönster där avslutade träningsbatcher ofta följs av en våg av relaterade onlineförfrågningar. Genom att lägga dessa två perspektiv ovanpå varandra kan systemet mer exakt prognostisera framtida behov av processorer, minne och acceleratorer än tidigare metoder.

Att omvandla prognoser till bättre beslut

Prognoser i sig räcker inte; datacentret måste agera på dem. Den andra halvan av ramverket omvandlar dessa förutsägelser till konkreta beslut om var varje jobb ska köras. Författarna behandlar detta som en balansakt mellan tre mål: att avsluta jobb snabbt, att använda så lite energi som möjligt och att hålla maskiner sysselsatta snarare än stående. Deras schemaläggare representerar datacentret som ett nätverk av olika enheter och använder en optimeringsprocedur för att välja placeringar som väger dessa mål mot varandra enligt operatörens prioriteringar. Eftersom prognoser aldrig är perfekta uppskattar systemet också sin egen osäkerhet och lämnar säkerhetsmarginaler vid behov, och övervakar sedan verkligheten i realtid för att justera genom att pausa lågprioriterat arbete eller flytta jobb när användningen avviker från förväntningarna.

Sätta systemet på prov

För att se hur detta tillvägagångssätt fungerar i praktiken byggde forskarna ett testkluster med en realistisk blandning av processorer, GPU:er och specialiserad AI-hårdvara och matade det med detaljerade aktivitetsregister från verkliga datacenter hos Google, Alibaba och ett universitetslabb. De jämförde sin metod med populära prognosverktyg och schemaläggningsstrategier, inklusive tekniker som används i produktionssystem och förstärkningsinlärningsbaserade kontrollörer. Den uppmärksamhetsbaserade prediktorn gav konsekvent mer precisa gissningar, särskilt för de kraftiga topparna som ofta förekommer i AI-arbetsbelastningar. I kombination med deras dynamiska allokerare ökade systemet den totala hårdvaruanvändningen till omkring fyra femtedelar av kapaciteten, minskade genomsnittlig jobbsluttid med ungefär en fjärdedel och sänkte energiförbrukningen med cirka 15 procent — allt samtidigt som serviceavvikelser hölls på mycket låg nivå.

Vad detta betyder för vardagsanvändare

För icke-specialister är huvudslutsatsen att smartare samordning inom datacenter kan göra AI-tjänster snabbare, billigare och grönare utan att kräva nya chip eller byggnader. Genom att lära sig var man ska ”uppmärksamma” i flödet av användningsdata hjälper detta ramverk befintlig hårdvara att utföra mer nyttigt arbete och stå ledig mindre ofta. Det betyder att företag kan leverera rappare appar och kraftfullare AI-verktyg samtidigt som elräkningar och koldioxidavtryck hålls nere. När liknande prognos- och allokeringssystem sprids och mognar kan internetets osynliga maskineri bli inte bara mer kapabelt utan också mer hållbart.

Citering: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Nyckelord: schemaläggning i datacenter, AI-arbetsbelastningsprognos, heterogen databehandling, energieffektiv databehandling, resursallokering