Clear Sky Science · sv

Stramare integritetsauditering av differentiellt privat stokastisk gradientnedstigning i hotmodellen med dold tillstånd

Varför detta betyder något för vardagsteknik

Moderna appar lär sig ständigt av våra data, från foton och meddelanden till journaler. Ett ledande sätt att göra denna träning säker kallas differentiell integritet, vilket tillför noggrant avvägt brus så att ingen enskild persons data sticker ut. Men hur vet vi att dessa skydd fungerar i praktiken, särskilt för de djupa neurala nätverk som används i dag? Denna artikel undersöker den frågan och visar när det hjälper integriteten att dölja modellens ”träningsfilm” — och när det inte gör det.

Hur privat lärande är tänkt att fungera

Differentiellt privat stokastisk gradientnedstigning (DP-SGD) är arbetsstallets algoritm för integritetsskyddad maskininlärning. Den tränar modeller stegvis på små datapartier, beskär varje stegs gradient (förbättringsriktningen) och lägger till slumpmässigt brus innan modellen uppdateras. Teori ger övre gränser för hur mycket någon persons data kan påverka den slutliga modellen, sammanfattat i ett integritetsmått ofta kallat epsilon. Parallellt försöker ”integritetsauditering” angripa den tränade modellen för att se hur mycket information som faktiskt kan extraheras i praktiken. Om teori och auditering överensstämmer kan vi lita på vår integritetsräkning; om de inte gör det saknas något viktigt.

Vad som förändras när bara den slutliga modellen offentliggörs

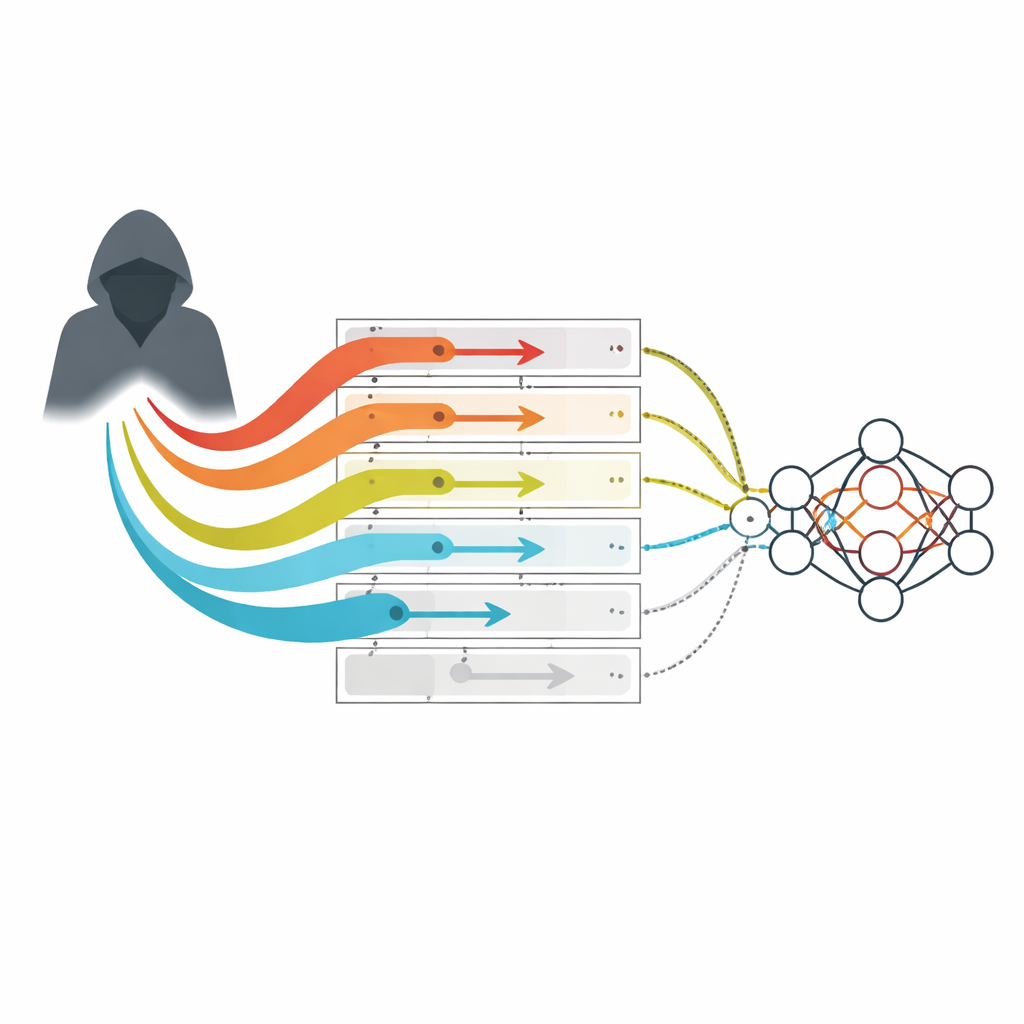

De flesta tidigare auditeringar antog en kraftfull angripare som kan se varje mellansteg i modellens träningshistorik. I verkligheten släpper många organisationer bara den slutliga modellen, inte hela träningshistoriken. Denna mer realistiska inställning kallas hotmodellen med dolt tillstånd. Nyare teoretiskt arbete föreslog att åtminstone för enkla konvexa problem kan det att dölja mellansteg förstärka integriteten över tid: data som användes tidigt i träningen blir ”utspädd” av senare brusiga uppdateringar. Moderna djupa inlärningsmodeller är dock starkt icke-konvexa, med ett förlustlandskap som är knöligt och komplext. Det var oklart om samma förstärkning verkligen sker där — eller om befintliga attacker helt enkelt var för svaga för att exponera den fulla integritetsförlusten.

Ett nytt sätt för angripare att påverka modellen

Författaren introducerar en ny familj av ”gradient-skapande” angripare anpassade till modellen med dolt tillstånd. Istället för att försöka utforma en särskild datapunkt och sedan observera hur dess förlust förändras under träningen (som i traditionella förlustbaserade attacker), föreskriver dessa angripare direkt sekvensen av gradienter som skulle tillämpas om en värsta-fall-datapunkt fanns närvarande. De väljer gradienter som alltid träffar beskärningströskeln och som är inriktade längs sällan uppdaterade parameterriktningar, vilket gör deras påverkan lättare att upptäcka även utan att se mellanstegen. Två enkla varianter studeras: en som slumpmässigt väljer en parameterriktning, och en annan som simulerar träningsprocessen för att hitta den minst uppdaterade riktningen innan den injicerar starka, upprepade gradienter längs den.

Vad experimenten avslöjar om verklig integritetsrisk

Med det här ramverket auditerar artikeln DP-SGD på bild- och tabulära datamängder med vanliga arkitekturer såsom konvolutionella och residuala nätverk, samt en liten fullständigt kopplad modell. När den skapade gradienten används vid varje träningssteg matchar de nya angriparna de strikta teoretiska integritetsbegränsningarna — trots att de bara ser den slutliga modellen. Det betyder att i detta extrema fall ger det inget extra integritetsskydd att dölja mellansteg. När den skapade gradienten införs mer sällan förändras bilden: för stora batcher i förhållande till brusnivån ligger auditeringarna nära teorin (vilket åter antyder liten verklig förstärkning), men för mindre batcher och högre brus uppstår en klyfta som pekar på en genuin, om än måttlig, integritetsförstärkning i icke-konvexa miljöer.

En titt in i värsta-fallgränsen

För att förstå integritetens absoluta gränser i modellen med dolt tillstånd studerar artikeln också en mer extrem teoretisk angripare som inte bara skapar gradienter utan även utformar ett helt förlustlandskap för att hålla påverkan av en särskild datapunkt vid liv över iterationer. I denna kontrollerade miljö separerar resultaten tydligt två regimer: med stora batchstorlekar är integritetsberäkningen enligt standardteori i huvudsak tight, men med små batcher och betydande brus glöms tidig information om en datapunkt delvis bort över tid. Viktigt är att denna förstärkning är svagare än vad som är känt för enkla konvexa problem och aldrig helt utplånar integritetsrisken.

Vad detta betyder för användare och praktiker

För icke-experter är slutsatsen att det inte räcker att bara dölja träningshistoriken för en djupinlärningsmodell för att automatiskt garantera mycket starkare integritet. När en persons data används mycket ofta under träningen är risken nära det som dagens konservativa teori redan förutsäger. Viss extra skyddseffekt uppstår i mer gynnsamma regime — små batcher med betydande brus — men den är måttlig och driver inte risken till noll. Dessa fynd både bekräftar delar av befintlig integritetsräkning och belyser dess begränsningar, och ger en klarare, mer realistisk bild av hur mycket skydd DP-SGD kan ge när endast den slutliga modellen delas.

Citering: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Nyckelord: differentiell integritet, DP-SGD, integritetsauditering, säkerhet för maskininlärning, modell med dolt tillstånd