Clear Sky Science · sv

Flernivå-uppmärksamhets DeepLab V3+ med EfficientNetB0 för segmentering av GI-organ i MRI-skanningar

Skarpare sikte mot tumörer

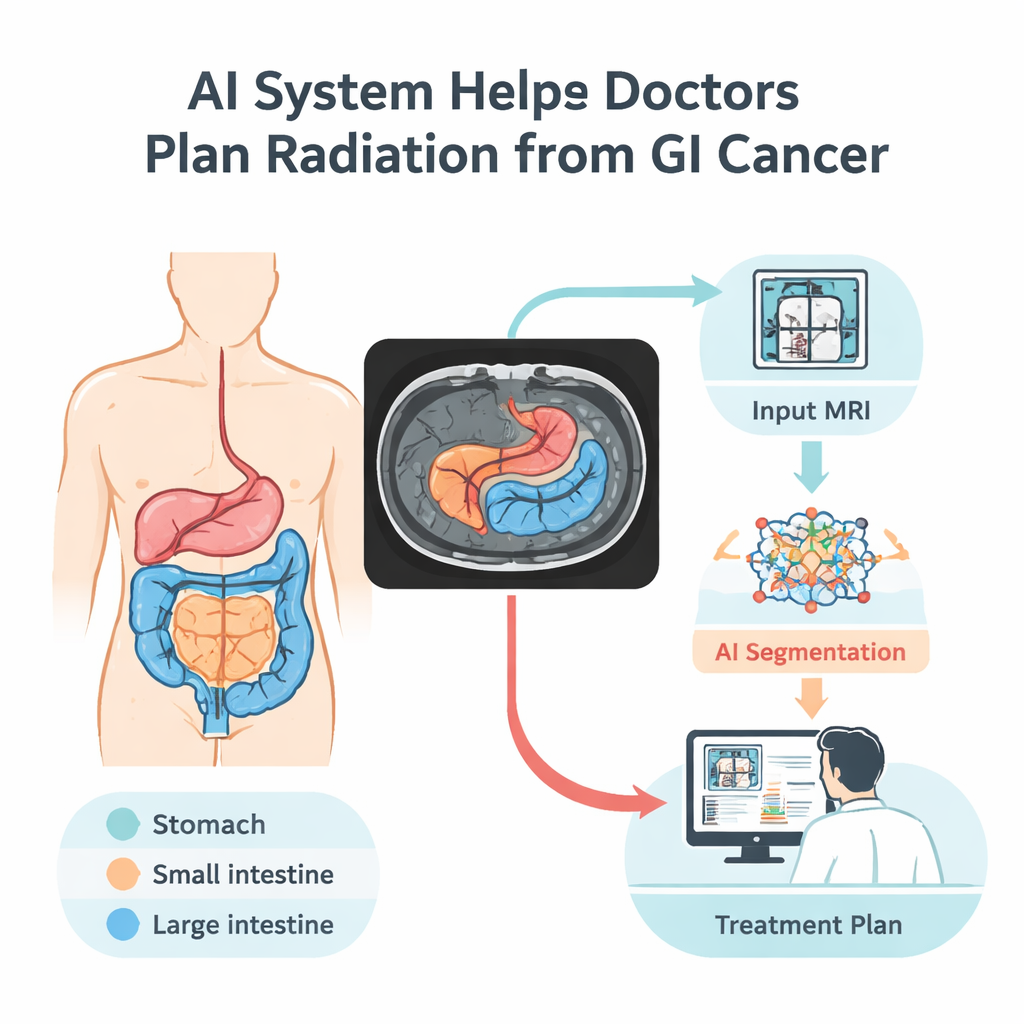

När läkare behandlar cancer i matsmältningssystemet med strålning står de inför en känslig balansgång: träffa tumören hårt samtidigt som närliggande friska organ som magsäcken och tarmarna skonas. Idag kan det ta upp till en timme per patient och dag att rita upp dessa organ för hand på varje magnetresonansbild (MRI). Denna studie presenterar ett datorvisionssystem som automatiskt spårar dessa organ i MRI-bilder, med löfte om snabbare, mer precis behandlingsplanering och färre biverkningar för patienterna.

Varför det är viktigt att kartlägga tarmen

Gastrointestinal cancer är vanlig och ofta dödlig, med en total överlevnad som ligger kring 30 procent. Strålbehandling är en central del av behandlingen, men matsmältningskanalen ligger tätt packad i buken och friska organ kan förskjutas något från dag till dag. För att undvika att skada magsäck, tunntarm och tjocktarm måste specialisterna veta exakt var de befinner sig innan varje behandlingssession. Manuell avritning är långsam och kan variera mellan experter. Ett automatiserat, pålitligt sätt att rita dessa gränser skulle kunna förkorta besök, låta läkare behandla fler patienter och förbättra säkerheten och noggrannheten i stråldoserna.

Lära datorer att läsa MRI-bilder

Forskarna byggde en artificiell intelligensmodell som lär sig känna igen tre viktiga matsmältningsorgan på MRI: magsäcken, tunntarmen och tjocktarmen. De tränade den på UW–Madison GI Tract-datasetet, den enda publika samlingen med detaljerade organkonturer på buk-MRI. Detta dataset innehåller 38 496 bilder från 85 patienter, tillsammans med noggrant förberedda etiketter som markerar var varje organ förekommer — eller där inget organ finns. För att få ut mesta möjliga av detta relativt lilla material delade teamet upp data per patient (så att modellen aldrig ser samma person både i träning och test) och utökade datasetet genom att spegla, rotera, ljusa upp och försiktigt deformera bilderna. Dessa kontrollerade förändringar hjälper systemet att hantera verkliga variationer i patientposition, bildljusstyrka och subtila formskillnader.

Hur den nya AI-modellen ser mönster

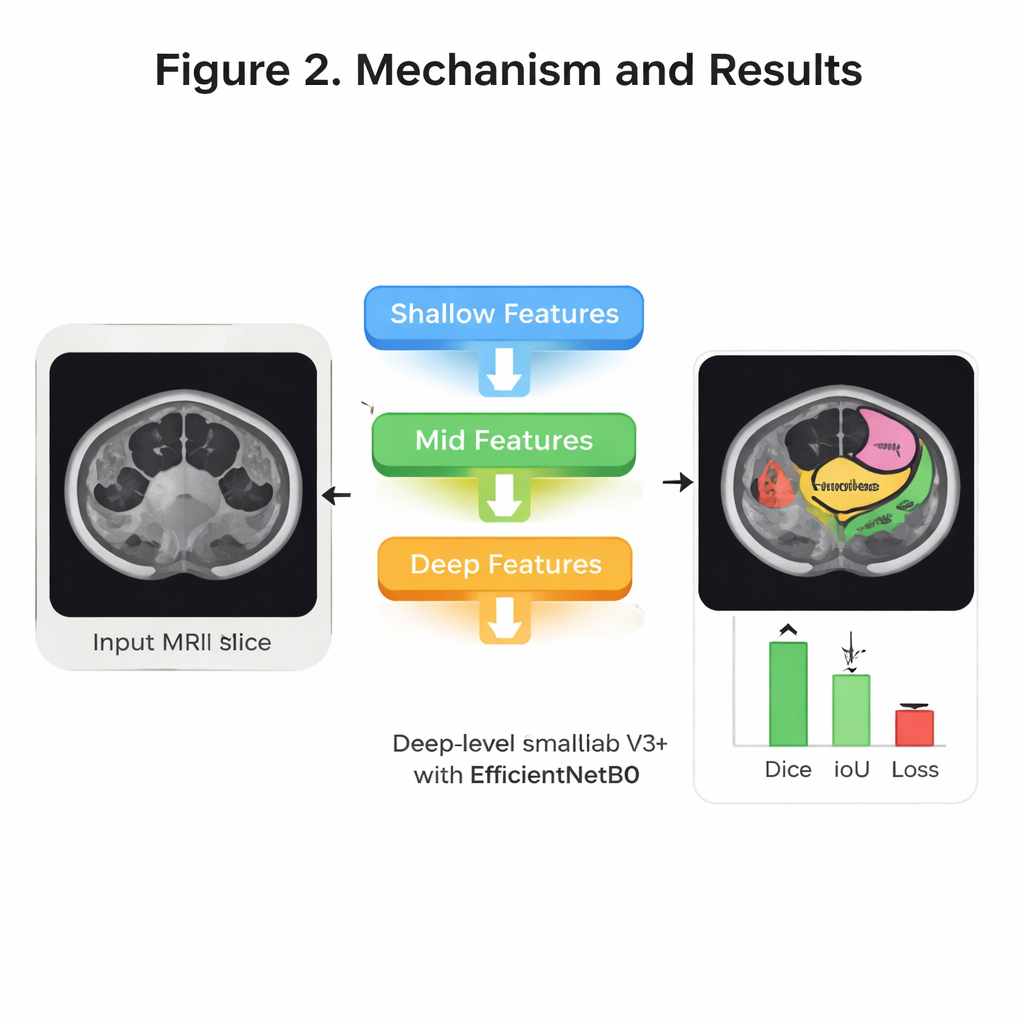

Inuti modellen kombineras flera idéer från modern bildigenkänning för att skärpa dess “ögon” för anatomi. Först skannar ett kompakt nätverk kallat EfficientNet B0 varje bild och bygger upp lager av visuella kännetecken — från enkla kanter till komplexa organsformer — samtidigt som beräkningskraven hålls måttliga. Därefter ser en struktur som kallas DeepLab V3+ på bilden i flera skalor, ungefär som att zooma in och ut för att förstå både fin detalj och övergripande sammanhang. Ovanpå detta lägger författarna till en "uppmärksamhets"-mekanism på flera detaljnivåer. Enkelt uttryckt hjälper uppmärksamhetssystemet modellen att avgöra vilka delar av bilden och vilka interna signaler som förtjänar mer vikt, så att den kan fokusera på subtila men viktiga ledtrådar som skiljer till exempel magsäcken från slingor av tunntarmen. Slutligen syr en avkodarfas ihop dessa ledtrådar till en ren, fullstor mask som visar de tre organen.

Test av noggrannhet och effektivitet

Teamet finjusterade systematiskt hur de tränade systemet — de provade olika optimeringsmetoder, antal träningscykler och sätt att dela data för validering. Deras bästa konfiguration använde en optimerare kallad RMSprop, fyrfaldig korsvalidering och 30 träningsomgångar. På de hållna testpatienterna klassificerade modellen korrekt mer än 99 procent av pixlarna totalt och visade mycket stark överlappning med expertrita konturer. Ett allmänt använt överlappningsmått, Dice-poängen, nådde i genomsnitt omkring 94 procent för de tre organen, medan ett relaterat mått, Intersection over Union, låg runt 92 procent. Lika viktigt för klinisk användning är att systemet är relativt lättviktigt: det har cirka 8,3 miljoner träningsbara parametrar och kan bearbeta ett typiskt 224×224 MRI-snitt på ungefär 31 millisekunder, tillräckligt snabbt för nära realtidsstöd vid daglig behandlingsplanering.

Vad detta kan betyda för patienter

I praktiska termer visar denna studie att en omsorgsfullt utformad AI kan spåra magsäck och tarmar på MRI-bilder på ett tillförlitligt sätt, motsvarande expertnivå samtidigt som den arbetar mycket snabbare och mer konsekvent. Denna förmåga kan hjälpa strålbehandlare att justera strålfälten mer precist runt känslig vävnad, vilket minskar oönskad skada och biverkningar under behandlingen. Även om den aktuella modellen tränades på skanningar från ett enda center och mestadels friska anatomi, ger den en stark grund för framtida system som inkluderar sjuka organ och data från flera sjukhus. Med ytterligare testning och förfining skulle verktyg som detta kunna bli rutinmässiga assistenter i rummet för strålbehandlingsplanering, tyst säkerställande att livräddande strålar hamnar exakt där de behövs mest.

Citering: Sharma, N., Gupta, S., Al-Yarimi, F.A.M. et al. Multi-level attention DeepLab V3+ with EfficientNetB0 for GI tract organ segmentation in MRI scans. Sci Rep 16, 7546 (2026). https://doi.org/10.1038/s41598-026-38247-7

Nyckelord: gastrointestinal cancer, MRI-segmentering, planering av strålbehandling, djupinlärning inom medicin, medicinsk bildanalys