Clear Sky Science · sv

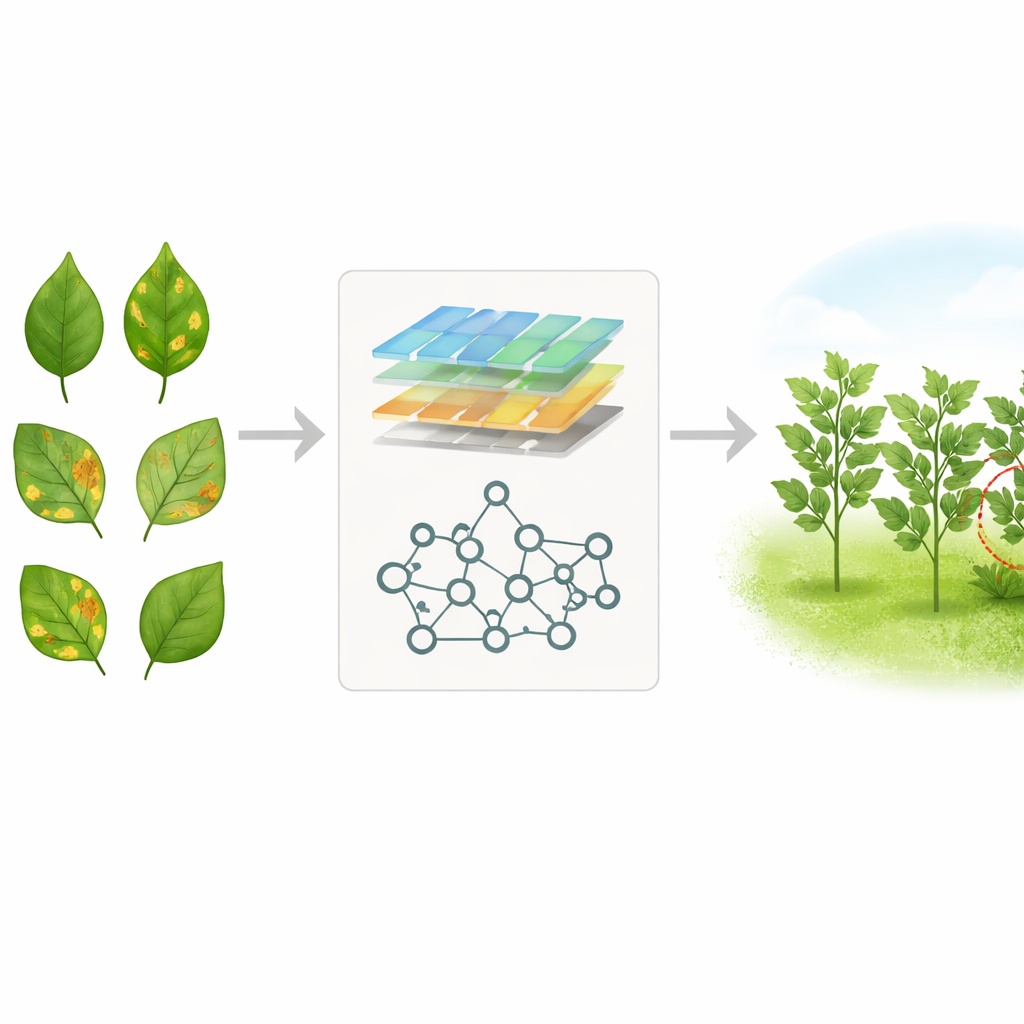

En hybrid djupinlärningsramverk som använder konvolutionella och transformer-modeller för robust klassificering av växtsjukdomar

Varför det är viktigt att upptäcka sjuka växter

Växtsjukdomar förstör tyst en stor andel av världens mat varje år, minskar skördar, påverkar jordbrukares inkomster negativt och hotar livsmedelssäkerheten. Att upptäcka dessa sjukdomar tidigt är svårt: fälten är stora, experter på växtsjukdomar är få, och många symtom är subtila. Denna studie undersöker hur en ny typ av artificiell intelligens kan lära sig att känna igen dussintals bladsjukdomar från enkla foton, och erbjuder en väg mot verktyg för smartphone eller fältkameror som hjälper bönder att agera innan problemen sprider sig.

Från människors gissningar till digitala ögon

Traditionell diagnostik bygger på att människor visuellt inspekterar blad och ibland skickar prover till ett laboratorium. Den processen är långsam, subjektiv och ofta otillgänglig i landsbygdsområden. Under det senaste decenniet har forskare tränat datorprogram att läsa bladbilder istället. Tidigare system krävde antingen att ingenjörer handdesignade visuella kännetecken eller använde djupinlärningsmodeller kallade konvolutionella neurala nätverk som är utmärkta på att fånga texturer, färger och kanter. Dessa metoder förbättrade noggrannheten men hade fortfarande problem när sjukdomstecken var svaga, spridda över bladet eller liknade varandra mellan olika åkommor. Den nya studien frågar om en kombination av två moderna AI‑metoder kan ge mer tillförlitliga svar i dessa svåra fall.

Att blanda två sätt att se

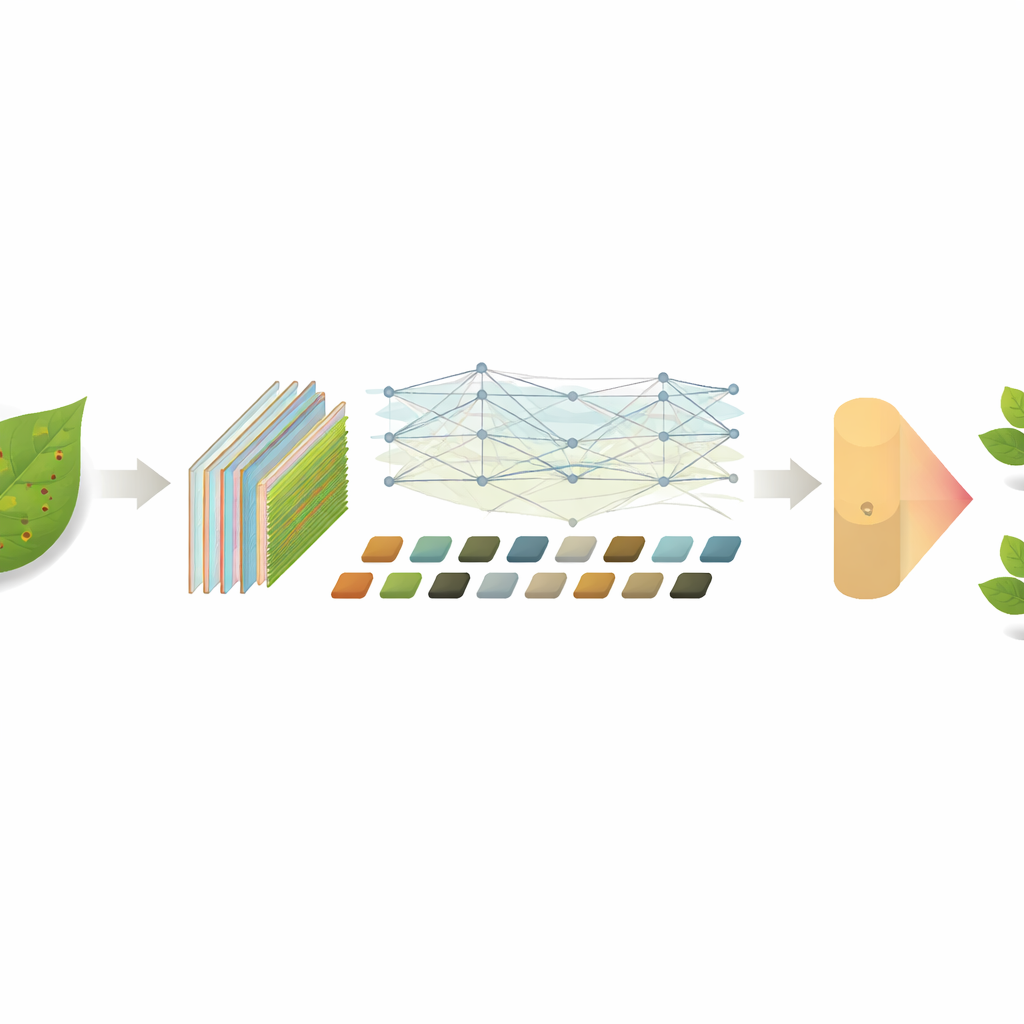

Författarna bygger ett hybridssystem som sammanfogar ett konvolutionellt nätverk med en nyare bildmodell känd som vision transformer. Den första delen, EfficientNet-B7, fungerar som ett förstoringsglas och skannar bladfoton efter fina detaljer såsom små fläckar, nerver och färgskiftningar. Dess output omformas sedan och skickas vidare till en transformer (ViT-B16), som är konstruerad för att uppmärksamma hur olika regioner i bilden förhåller sig till varandra över långa avstånd. Genom att omvandla de detaljerade dragen till en serie små patchar och låta transformern väga hur varje patch interagerar med alla andra kan systemet förstå både lokala skador och det övergripande mönstret på bladyta. Denna kombination syftar till att efterlikna hur en skicklig agronom både tittar noga på en lesion och samtidigt beaktar dess placering och omgivning.

Att lära systemet med tusentals blad

För att träna och testa sin modell använde forskarna en stor offentlig samling på 21 534 bilder som visar 38 olika tillstånd, inklusive många sjukdomar och friska blad från grödor som äpple, tomat, druva och majs. De standardiserade fotona till en gemensam storlek och använde digitala trick — såsom rotationer, speglingar och zoomningar — för att simulera de röriga förhållanden som råder ute på fälten. Modellen lär sig först allmänna visuella mönster från existerande bilddata och finjusteras sedan på denna växtsamling. Under träningsprocessen följer teamet inte bara den övergripande noggrannheten utan också hur ofta systemet korrekt identifierar varje sjukdom och hur väl det undviker falska larm, för att säkerställa att prestandan håller över både vanliga och mer sällsynta klasser.

Hur väl den hybrida metoden presterar

När den utvärderades på tidigare osedda bilder klassificerade hybridmodellen korrekt växthälsa och sjukdom i 98,13 procent av fallen och upprätthöll höga poäng över strikta mått för precision, återkallning och balans däremellan. Den hanterar både friska blad och svåra sjukdomar, även om mycket tidiga symtom fortfarande är mer utmanande. Författarna jämför sitt system med en rad populära alternativ, inklusive fristående konvolutionella nätverk, rena transformermodeller, lättviktiga mobilnät, snabba detektorer som YOLO och klassiska verktyg såsom supportvektormaskiner och random forests. I dessa huvud‑till‑huvud‑test kommer hybriden konsekvent ut i topp, och överträffar till och med starka konkurrenter som endast använder EfficientNet eller ensemblemetoder med flera nätverk.

Vad detta betyder för gårdar och mat

I praktiska termer visar studien att kombinationen av två kompletterande AI‑”ögon” på en bild — skarp lokal detalj och bred kontext — kan förbättra automatisk detektion av växtsjukdomar avsevärt. Medan det nuvarande systemet fortfarande förväntar sig relativt klara foton och fungerar bäst på maskiner med grafikkort, kan samma designidéer anpassas till lättare versioner för smartphones, drönare eller lågkostnads fältenheter. När dessa verktyg mognar kan de ge bönder snabb, platsbaserad vägledning om vad som angriper deras grödor och var, vilket stödjer tidigare behandling, minskad kemikalieanvändning och mer stabila skördar. För den breda läsaren är huvudbudskapet att smartare kameror och algoritmer blir kraftfulla allierade i arbetet med att skydda världens livsmedelsförsörjning.

Citering: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Nyckelord: detektion av växtsjukdomar, djupinlärning, vision transformer, precisionsjordbruk, bildklassificering