Clear Sky Science · sv

Stabilt tillvägagångssätt baserat diagonal återkopplande kvantneuronätverk för identifiering av olinjära system

Lära maskiner att förstå röriga system

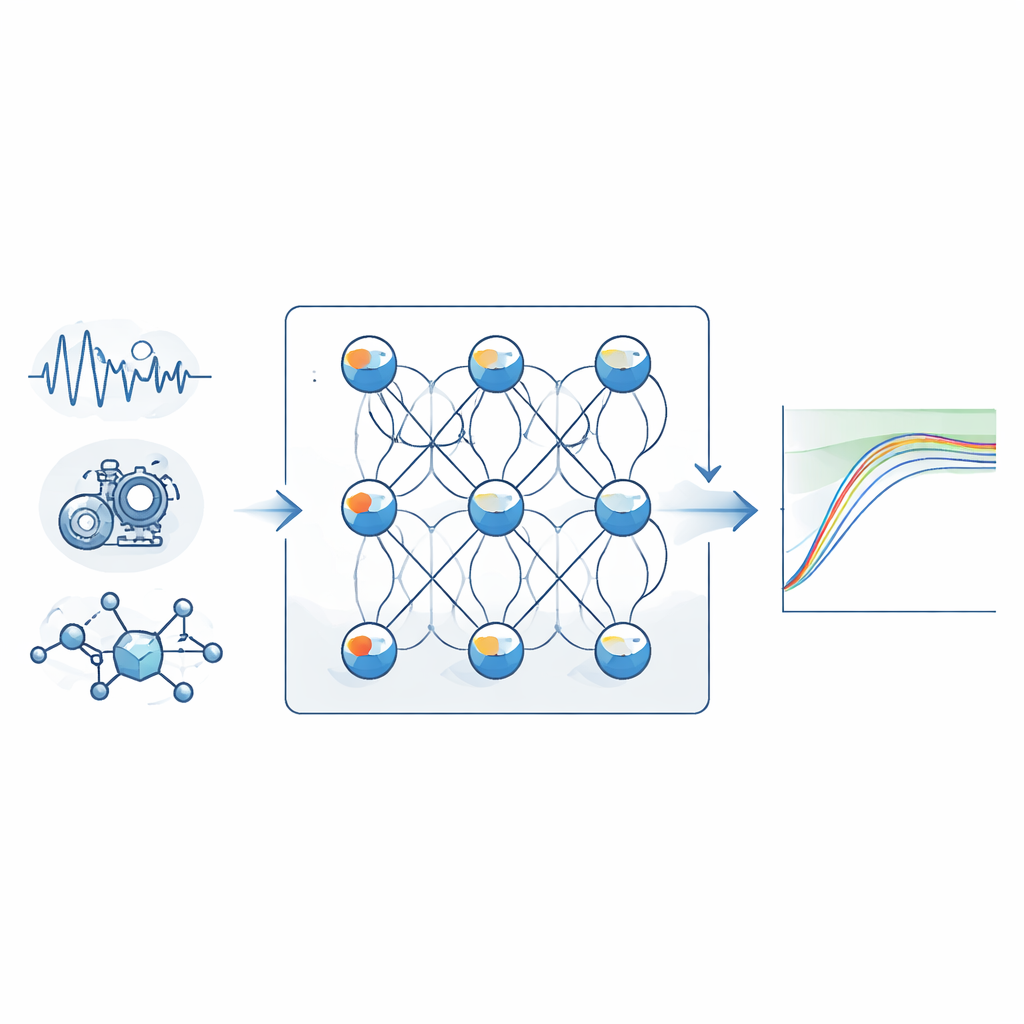

Många av de system som formar våra liv — från elmotorer i apparater till turbulent luftflöde och även vissa medicinska processer — beter sig på komplicerade, olinjära sätt. Det innebär att små förändringar i ingångar kan ge oväntat stora eller kaotiska reaktioner. Att förutsäga och kontrollera sådana system är svårt, men avgörande för effektivitet, säkerhet och energibesparing. Denna artikel introducerar en ny typ av lärmaskin som blandar idéer från kvantdatorer, neurala nätverk och stabilitetsteori för att modellera dessa svårfångade beteenden mer exakt och pålitligt.

Varför vanliga modeller inte räcker

Traditionella modelleringsverktyg antar ofta att orsak och verkan är ordnade och proportionella, vilket fungerar väl för enkla eller nära linjära system. Men många verkliga system har minne, återkoppling och trösklar som gör deras beteende starkt olinjära. Klassiska neurala nätverk har bidragit, men de har också sina problem. Feed-forward-nätverk, där informationen bara går åt ett håll, är bra för statiska uppgifter men har svårt när tidigare signaler spelar roll. Återkopplande nätverk, som matar tillbaka information till sig själva för att skapa minne, kan fånga tidsvarierande beteenden men är ofta svåra att träna, benägna att bli instabila och beräkningsmässigt tunga när varje neuron kommunicerar med alla andra.

Att blanda kvantidéer med enkla slingar

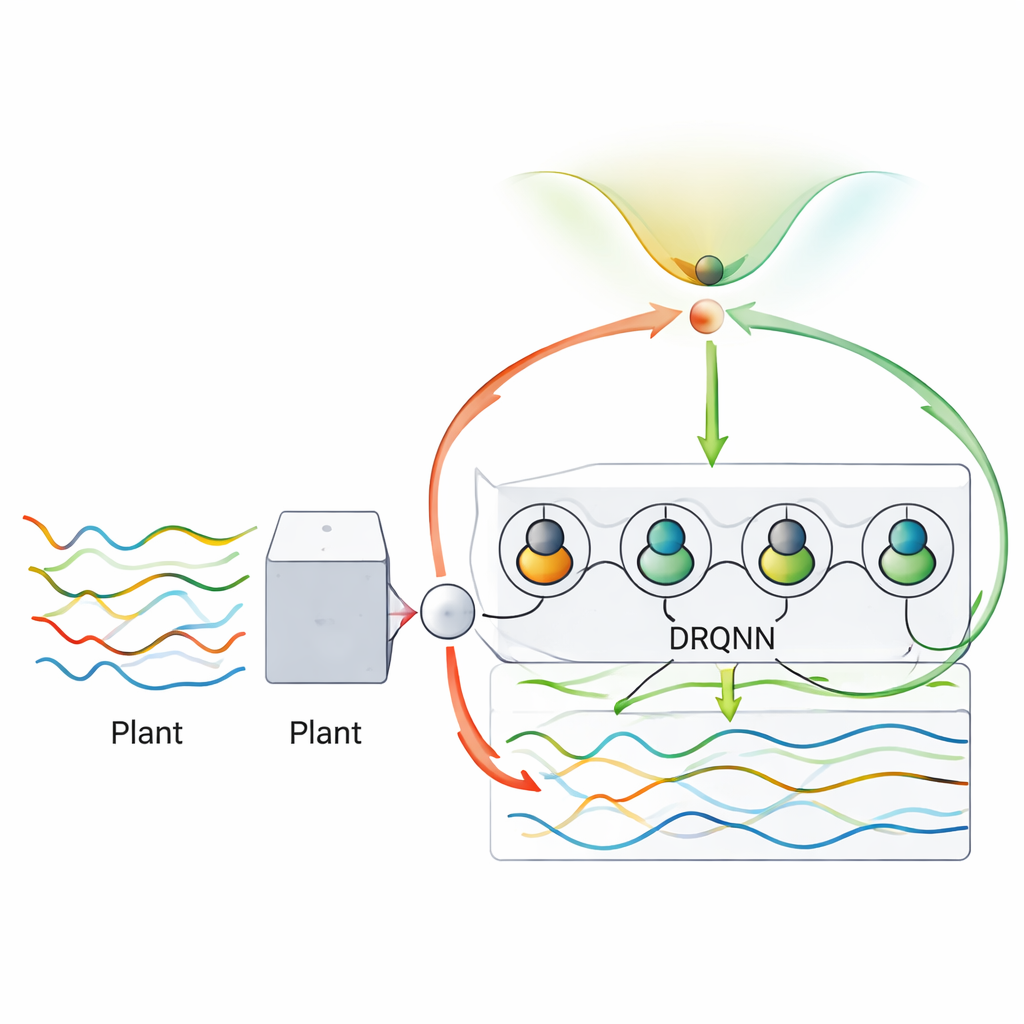

Författarna föreslår ett diagonalt återkopplande kvantneuronätverk med Lyapunov-stabilitet, förkortat DRQNN-LS. I grunden liknar detta nätverk fortfarande ett välbekant trelagers neuralt nät: ingångar, ett dolt lager och en utgång. Men två förändringar gör det särskilt. För det första beter sig de dolda enheterna som förenklade kvantbitar, vars interna tillstånd beskrivs med fasliknande storheter snarare än vanliga tal. Denna kvantinspirerade representation låter varje enhet koda rikare information på ett kompakt sätt, vilket förbättrar nätverkets förmåga att approximera komplexa samband. För det andra, istället för ett trassel av återkopplingslänkar, matar varje dolt neuron bara tillbaka till sig självt. Denna "diagonala" återkoppling bevarar det minne som behövs för att följa tidsvarierande mönster samtidigt som antalet kopplingar som måste finjusteras minskar drastiskt.

Hålla inlärningen stabil och under kontroll

En stor utmaning vid träning av återkopplande nätverk är att hålla inlärningen stabil: om vikterna förändras för aggressivt kan modellens utgång explodera eller oscillera; om de ändras för långsamt tar träningen evigheter och kan fastna. Här förlitar sig författarna på Lyapunov-stabilitetsteori, en matematisk ram ursprungligen utvecklad för att analysera säkerheten hos fysiska system. De konstruerar en särskild energiliknande funktion som kombinerar modelleringsfelet och storleken på nätverksparametrarna. Genom att noggrant härleda hur denna funktion förändras över tid får de automatiska regler för uppdatering av nätverkets vikter och interna parametrar så att den övergripande "energien" endast kan minska. Detta ger adaptiva inlärningshastigheter som själva ökar eller minskar, vilket garanterar konvergens utan handjustering.

Att testa det nya nätverket

För att visa att DRQNN-LS är mer än en snygg idé på papper testar författarna det på tre mycket olika uppgifter. Först modellerar de ett matematisk olinjärt system med känt beteende och kontrollerar hur väl nätverket kan följa dess utgång. För det andra tar de sig an den kaotiska Henon-kartan, en klassisk referens där små förändringar i begynnelsevillkor kan ge helt olika banor. För det tredje applicerar de metoden på verkliga data från en liten likströmsmotor, en brusig, praktisk enhet vars interna funktioner inte är fullt kända. I varje fall jämför de det nya tillvägagångssättet med flera befintliga neurala modeller, inklusive klassiska diagonala återkopplande nätverk och tidigare kvantinspirerade versioner tränade med enklare gradientbaserade regler.

Bättre noggrannhet, robusthet och brusmotstånd

I samtliga tre exempel ger DRQNN-LS konsekvent lägre prognosfel och bättre anpassning till de sanna signalerna än konkurrerande metoder, även när data avsiktligt förorenats med betydande brus. Medan den nya modellen kräver något mer beräkning per steg — eftersom den följer återkopplande kvantinspirerade tillstånd och utvärderar Lyapunov-baserade uppdateringar — förblir körtiderna tillräckligt små för användning i realtid på moderna processorer. Resultaten tyder på att en kombination av en strömlinjeformad återkopplande struktur, kvantliknande neuronstillstånd och matematiskt garanterad stabil inlärning ger ett kraftfullt och praktiskt verktyg för att förstå och förutsäga olinjära dynamiska system i verkliga tillämpningar.

Vad det innebär framåt

För icke-specialister är slutsatsen att vi lär oss bygga smartare, mer pålitliga digitala tvillingar av röriga fysiska system. DRQNN-LS erbjuder ett sätt för en maskin att lära sig beteendet hos en komplex process direkt från data samtidigt som man säkerställer att inlärningen inte "exploderar" eller vandrar oförutsägbart. Denna kombination av flexibilitet och stabilitet kan bli värdefull inom områden som industriell styrning och robotik, kraftsystem och kanske även biologisk eller medicinsk modellering, där olinjära beteenden och brusiga mätningar är regel snarare än undantag.

Citering: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Nyckelord: identifiering av olinjära system, kvantneuronätverk, återkopplande neuralt nätverk, Lyapunov-stabilitet, modellering av kaotisk dynamik