Clear Sky Science · sv

En djupinlärningsram för bröstcancerdiagnostik med Swin Transformer och Dual‑Attention Multi‑scale Fusion Network

Varför detta är viktigt för patienter och läkare

Bröstcancer är en av de vanligaste cancerformerna bland kvinnor och mammografi är huvudverktyget för att upptäcka den tidigt. Att läsa dessa röntgenbilder är dock svårt, även för experter, och små varningssignaler kan förbises. Denna studie presenterar ett nytt system för artificiell intelligens (AI) utformat för att hjälpa radiologer att upptäcka bröstcancer mer tillförlitligt genom att kombinera två kraftfulla sätt att ”se” på mammogram: ett som fångar helheten och ett som zoomar in på mycket små detaljer.

Utmaningen att se både skogen och träden

Moderna AI‑system hjälper redan till vid tolkning av medicinska bilder, men de flesta förlitar sig på en enda typ av modell. Konvolutionella neurala nätverk är bra på att upptäcka lokala mönster, såsom skarpa kanter eller små ljusa fläckar. Vision‑transformers, en nyare familj av modeller, utmärker sig i att förstå relationer över hela bilden. Mammogram kräver dock båda förmågorna samtidigt: cancer kan visa sig som små kalciumfläckar eller subtila distortioner, men betydelsen beror på hur dessa tecken passar in i bröstets övergripande struktur. Samtidigt är verkliga mammografidatamängder relativt små och ofta obalanserade, med långt färre cancerfall än normala undersökningar, vilket gör det lätt för AI att överanpassa sig eller bli partiskt.

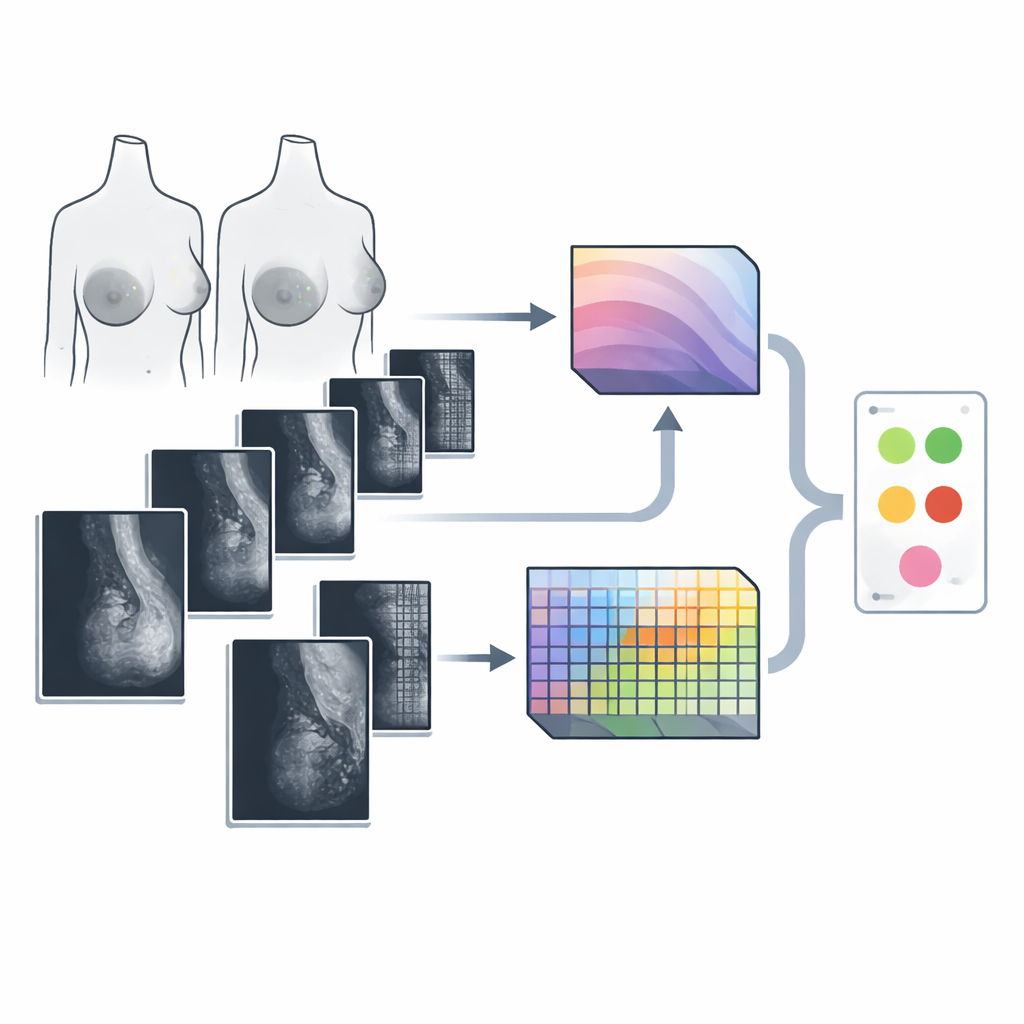

Ett tvåspårigt AI som ser brett och zoomar djupt

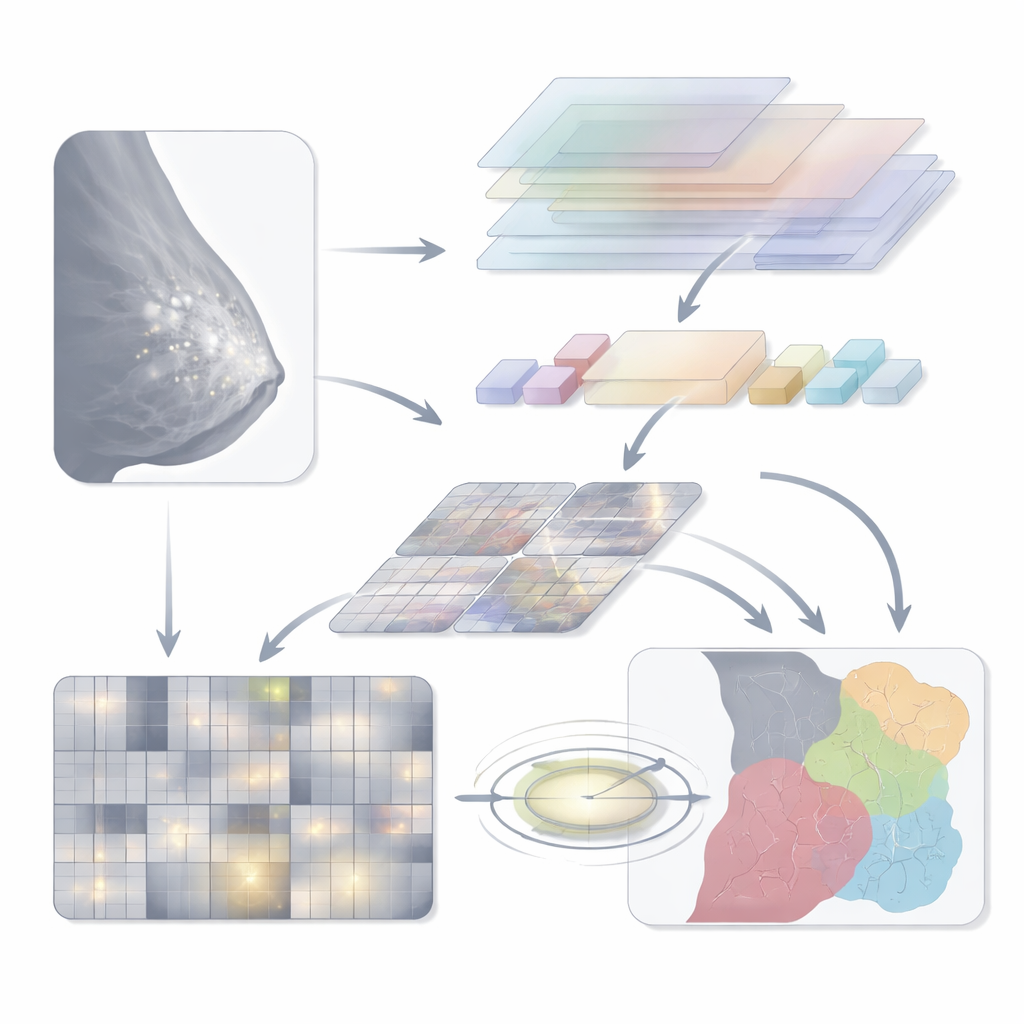

Författarna introducerar en hybridmodell de kallar Swin‑DAMFN, speciellt byggd för att slå ihop globalt och lokalt seende. Ett spår bygger på Swin Transformer, som delar upp mammogrammet i fönster och använder en attention‑mekanism för att fånga långräckviddskontext—hur olika delar av bröstet relaterar till varandra. Det andra spåret är ett specialbyggt konvolutionellt nätverk, Dual‑Attention Multi‑scale Fusion Network (DAMFN). Detta spår är finjusterat för att plocka upp extremt fina detaljer såsom mikro‑kalkavlagringar och små vävnadsdeformiteter. Inom det analyserar specialiserade block bilden i flera skalor och riktningar, och använder sedan attention‑moduler för att framhäva regioner som ser mest kliniskt informativa ut samtidigt som bakgrundsvävnad tonas ner.

Att lära systemet med fler och rikare bilder

Eftersom verkliga mammografidatamängder är begränsade och snedfördelade mot icke‑cancerfall, förstärkte forskarna träningsdatan på två kompletterande sätt. För det första använde de en typ av generativ modell kallad conditional GAN för att syntetisera realistiska mammogram‑patchar, särskilt för underrepresenterade maligna kategorier. Dessa genererade bilder hjälper till att balansera klasserna och utsätter modellen för fler varianter av sjukdomsutseende. För det andra applicerade de fotometriska förändringar—små, slumpmässiga justeringar i ljusstyrka, kontrast och skärpa—på både verkliga och syntetiska bilder. Detta tvingar AI att fokusera på verkliga anatomiska mönster snarare än ytliga ljusförhållanden eller brus, vilket förbättrar dess förmåga att generalisera till nya skanningar.

Hur delarna samverkar under diagnostik

Under analys matas ett förbehandlat mammogram samtidigt in i båda spåren. Swin Transformer producerar en kompakt sammanfattning av den globala strukturen, medan DAMFN ger en rik karta av lokala funktioner. Dessa justeras sedan i storlek och fusioneras till en enda representation. Ett lättviktigt ”triplet attention”‑block förfinar ytterligare denna fusion genom att korsgranska kanaler och rumsliga dimensioner, vilket styr modellens fokus mot områden som troligen innehåller sjukdom. Slutligen summerar ett enkelt klassificeringshuvud informationen och ger en prediktion över flera klasser, såsom normal vävnad, benigna fynd eller olika typer av maligna lesioner.

Vad resultaten innebär i praktiken

Teamet testade Swin‑DAMFN på två allmänt använda publika datamängder, CBIS‑DDSM och MIAS, och jämförde den med många populära djupinlärningsmodeller. Deras system nådde ungefär 99 % noggrannhet på CBIS‑DDSM och nästan 99 % på MIAS, med liknande hög känslighet (förmåga att upptäcka cancer) och specificitet (att undvika falska larm). Noga utförda ablationsstudier visade att varje komponent—de dubbla spåren, attention‑baserad fusion och dataaugmenteringsstrategin—bidrog till dessa förbättringar. Medan författarna noterar att bredare tester på mångsidiga sjukhusdata fortfarande behövs, tyder resultaten på att hybrida AI‑system som Swin‑DAMFN skulle kunna bli värdefulla assistenter vid bröstcancerscreening, hjälpa radiologer att upptäcka farliga lesioner tidigare och mer konsekvent samtidigt som arbetsbörda och osäkerhet minskas.

Citering: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Nyckelord: bröstcancer, mammografi, djupinlärning, transformermodeller, AI för medicinsk bildanalys