Clear Sky Science · sv

Objektdetektering i realtid för obemannade luftfarkoster baserat på vision transformer och edge‑datorer

Smartare ögon i skyn

Obemannade luftfarkoster—droner—blir snabbt vardagsverktyg för uppgifter som att inspektera broar, övervaka trafik och söka efter saknade personer. Men för att en drönare verkligen ska vara till hjälp i dessa tidskritiska uppdrag måste den göra mer än att bara filma världen; den måste känna igen små objekt i realtid samtidigt som den flyger på begränsat batteri och med en liten dator ombord. Denna artikel presenterar ett nytt sätt att ge droner skarpare, snabbare ”ögon” genom att kombinera en avancerad AI‑metod kallad vision transformer med smart användning av närliggande edge‑datorer, så att små objekt som fotgängare, cyklar och bilar snabbt och pålitligt kan upptäckas från luften.

Varför drönare har svårt att se små detaljer

Högt över marken kan människor och fordon krympa till bara några tiotals pixlar i en videobildruta. Traditionella neurala nätverk som används på drönare är designade för att köras snabbt på låg‑effekt‑chip, men de missar ofta dessa små objekt eller fallerar när ljusförhållanden eller synvinkel förändras. Nyare vision transformer‑modeller, lånade från språkbehandlingsvärlden, är mycket bättre på att förstå hela scenen samtidigt och skilja ut små detaljer i röriga bakgrunder. Problemet är att de vanligtvis kräver enorm beräkningskraft, långt bortom vad en flygplattform kan bära. Författarna gav sig i kast med att överbrygga detta gap: behålla transformerns skarpa blick, men trimma den så att den kan köras i realtid på en drönare och avlasta extra arbete till en närliggande edge‑server när förhållandena tillåter.

Delat system: drönare och edge som samarbetar

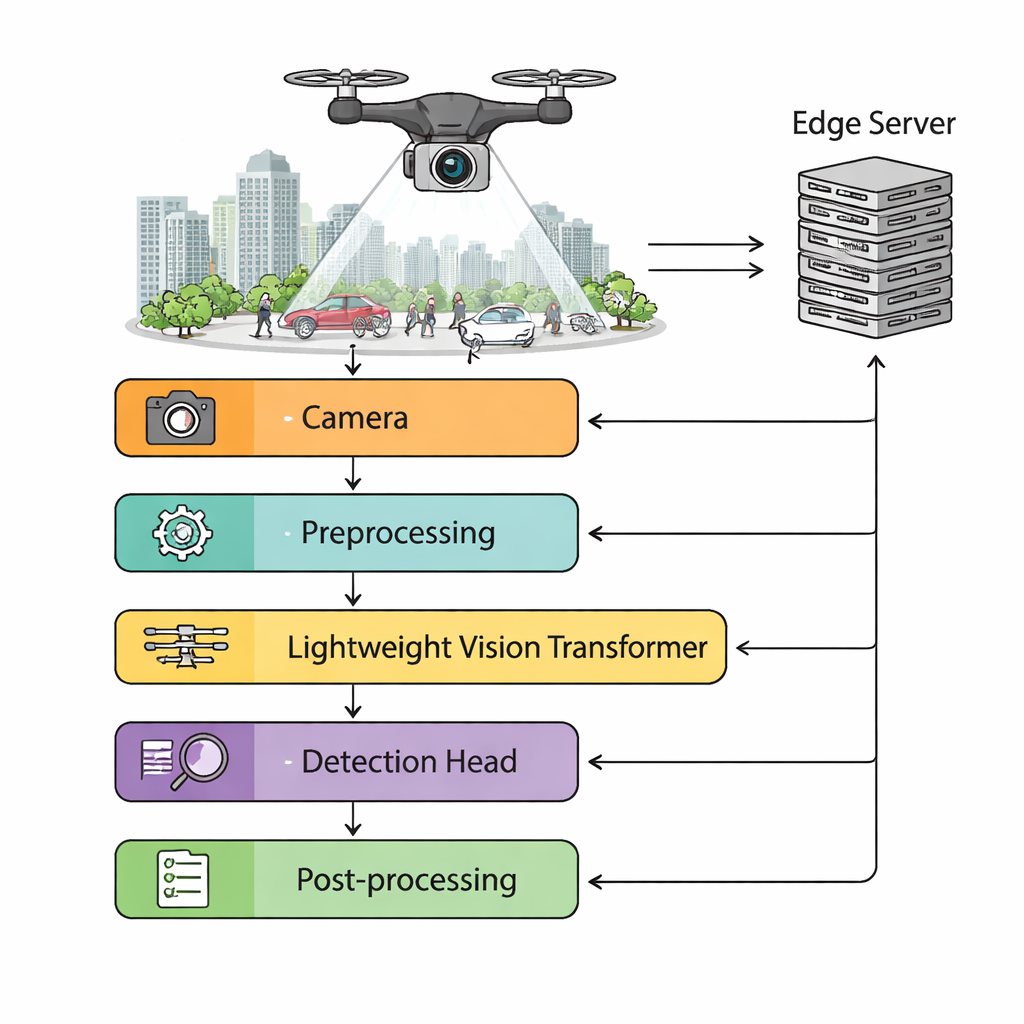

Det föreslagna ramverket fördelar arbetet mellan drönaren och en markbaserad edge‑dator. Drönarens kamera strömmar högupplöst video till en ombordföreberedande modul som stabiliserar skakig film, justerar ljusstyrka och dynamiskt ändrar bildstorlek beroende på tillgänglig beräkningskapacitet. En lättvikts‑vision transformer extraherar rika funktioner från varje ruta och matar en detektionsmodul som förutser var objekt finns och vad de är. En schemaläggare övervakar trådlös nätverksfördröjning, batterinivå och belastning. När länken till marken är snabb och stabil kan tyngre uppgifter—såsom att bearbeta batcher av rutor eller köra extra modeller för bättre noggrannhet—skjutas ut till edge‑servern. När anslutningen försämras växlar systemet automatiskt till helt autonom ombordbearbetning så att drönaren aldrig behöver ”flyga blind”.

Trimmning av modellen utan att tappa blicken

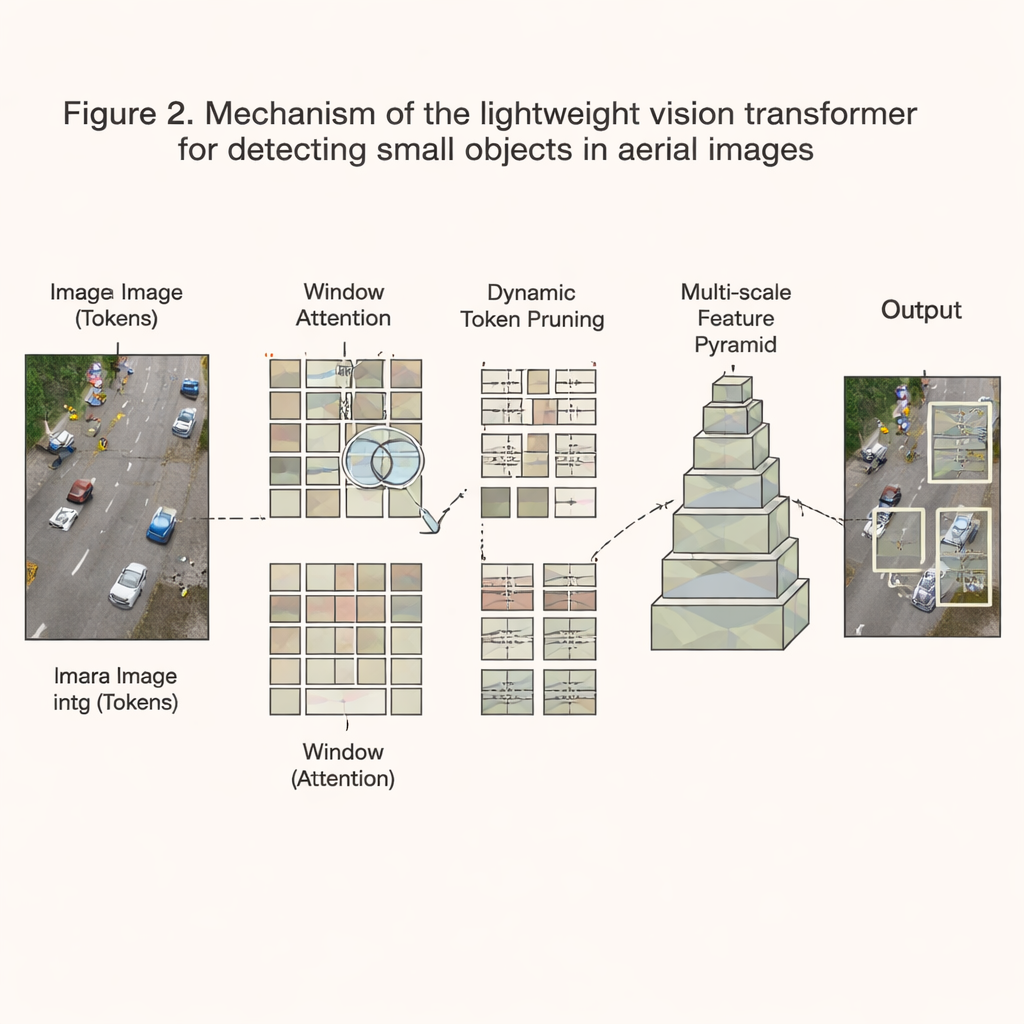

För att göra transformern tillräckligt liten och snabb omarbetar författarna dess interna funktioner. Istället för att låta varje del av bilden jämföra sig med varje annan del—en process som växer explosionsartat med upplösningen—begränsar de uppmärksamheten till lokala fönster som skiftar över bilden, vilket sänker beräkningskostnaden till mer hanterbara nivåer. Utöver detta utvärderar ett dynamiskt pruning‑schema ständigt vilka regioner av bilden som innehåller användbar information och vilka som mest består av tom bakgrund. Tokens som bedöms oinformativa slängs tidigt, vilket sparar tid och minne, medan komplexa, röriga scener behåller fler detaljer. Modellen bygger också en flerskalenlig pyramid av funktioner så att både små fotgängare och större fordon kan upptäckas i samma ruta. Tillsammans med noggrann kvantisering (användning av färre bitar per tal), kanalpruning och lågnivå‑programvaruoptimeringar minskar dessa förändringar de nödvändiga beräkningarna med cirka två tredjedelar samtidigt som över 94 % av ursprunglig noggrannhet bevaras.

Sätta systemet på prov

Teamet utvärderar sin design på en stor flygdatamängd sammansatt av publika drönar‑benchmarkar och tusentals nyinsamlade bilder över städer, förorter och landsbygd i olika årstider och ljusförhållanden. På en populär inbyggd dator som används i drönare, NVIDIA Jetson Xavier NX, körs deras system i ungefär 39 bilder per sekund—tillräckligt snabbt för realtidsdrift—samtidigt som det uppnår högre noggrannhet än vida använda lättviktsdetektorer som YOLO‑varianter. Särskilt är det väsentligt bättre på att upptäcka små objekt, med ungefär sju procentenheter högre medelprecision än konventionella konvolutionsnätverk. Veckolånga fälttester på en kommersiell drönarplattform visar att systemet bibehåller prestanda trots kameravibrationer, förändrat ljus och varierande trådlös konnektivitet, samt att det smidigt kan växla mellan edge‑assisterade och helt ombordlägen under verkliga flygningar.

Vad detta innebär för drönaruppdrag i verkligheten

Enkelt uttryckt visar detta arbete att det är möjligt att ge drönare skarpare och mer tillförlitlig syn utan att fästa en datacenterklassad dator på dem. Genom att omdesigna vision transformern för att vara strömlinjeformad, selektivt fokusera på de mest informativa delarna av varje bild och samarbeta med en närliggande edge‑server när så är möjligt levererar författarna en detektor som ser mer, missar mindre och ändå körs i realtid inom snäva ström‑ och minnesbudgetar. Detta gör uppgifter som sök‑ och räddningsinsatser, skadebedömning och inspektion av infrastruktur säkrare och mer effektiva, eftersom drönare bättre kan plocka ut små, kritiska detaljer—som en strandsatt person eller en skadad kabel—precis när varje sekund räknas.

Citering: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Nyckelord: droner, objektdetektering, edge‑computing, vision transformer, bildbehandling i realtid