Clear Sky Science · sv

Algoritm för fusion av infraröda och synliga bilder baserad på NSCT och förbättrad FT-saliensteknik

Se i mörkret och genom röran

Moderna kameror ger oss skarpa, färgrika vyer av världen, men de har svårt i dimma, mörker eller bländning — precis när vi oftast behöver tillförlitlig syn för körning, övervakning, sök‑ och räddningsinsatser eller drönare. Infraröda sensorer, som fångar värme istället för färg, är överlägsna under dessa svåra förhållanden men producerar ofta suddiga bilder med låg detaljgrad. Den här artikeln presenterar ett sätt att intelligent kombinera infraröda och synliga bilder så att slutbilden visar både skarpa detaljer och tydligt framhävda människor eller objekt, även i svåra scener.

Därför är två ögon bättre än ett

Synliga kameror fångar fina texturer och rika bakgrunder, men deras prestanda kollapsar på natten eller i djupa skuggor, och mål kan smälta ihop med likfärgade omgivningar. Infraröda kameror gör tvärtom: de plockar upp varma kroppar och värmeavgivande objekt mot mörka bakgrunder, dag som natt, men förlorar mycket av de subtila strukturerna i byggnader, träd och vägar. Att slå samman dessa två bildtyper till en kan i princip ge det bästa av båda världar. Många befintliga fusionsmetoder tonar dock ner kontrasten, suddar ut objektkanter eller låter brusiga infraröda mönster övermanna de användbara detaljerna från den synliga bilden.

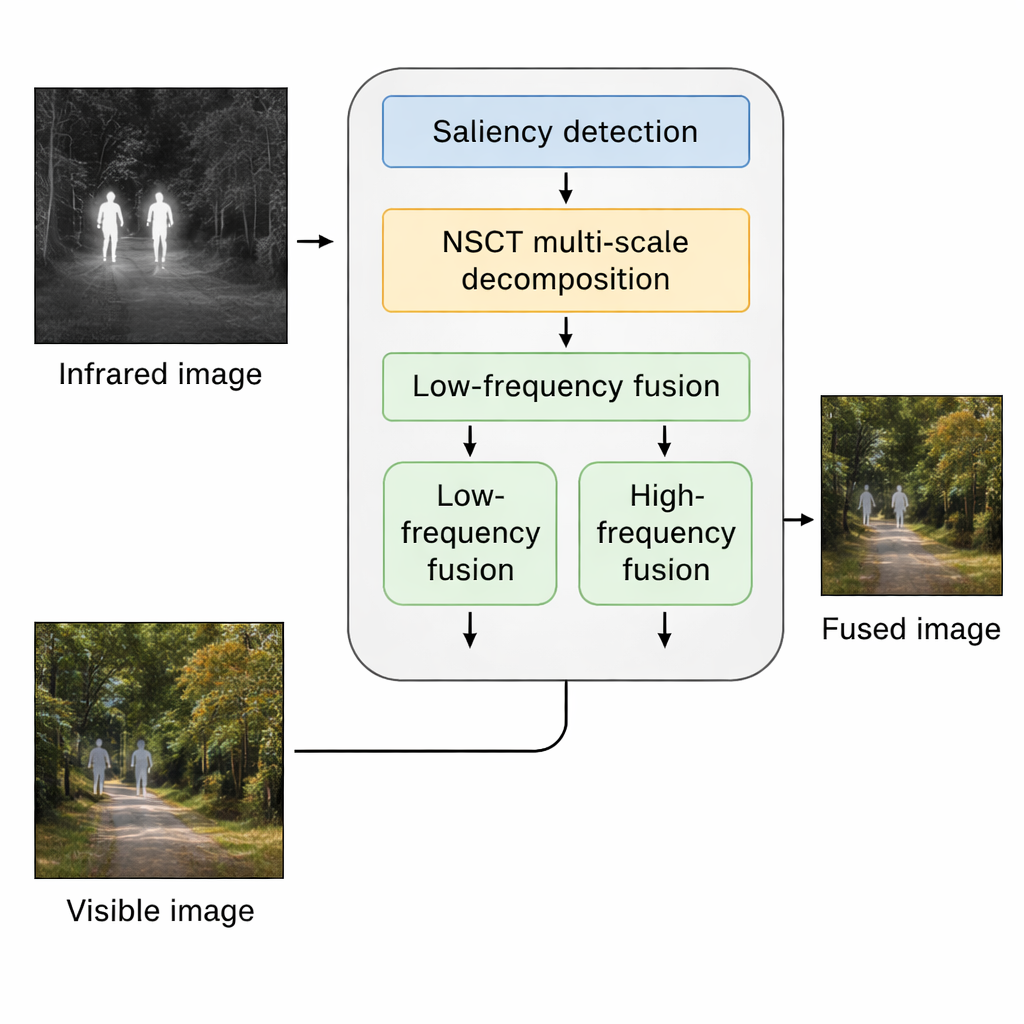

Huvudidén: låt de viktiga delarna framträda

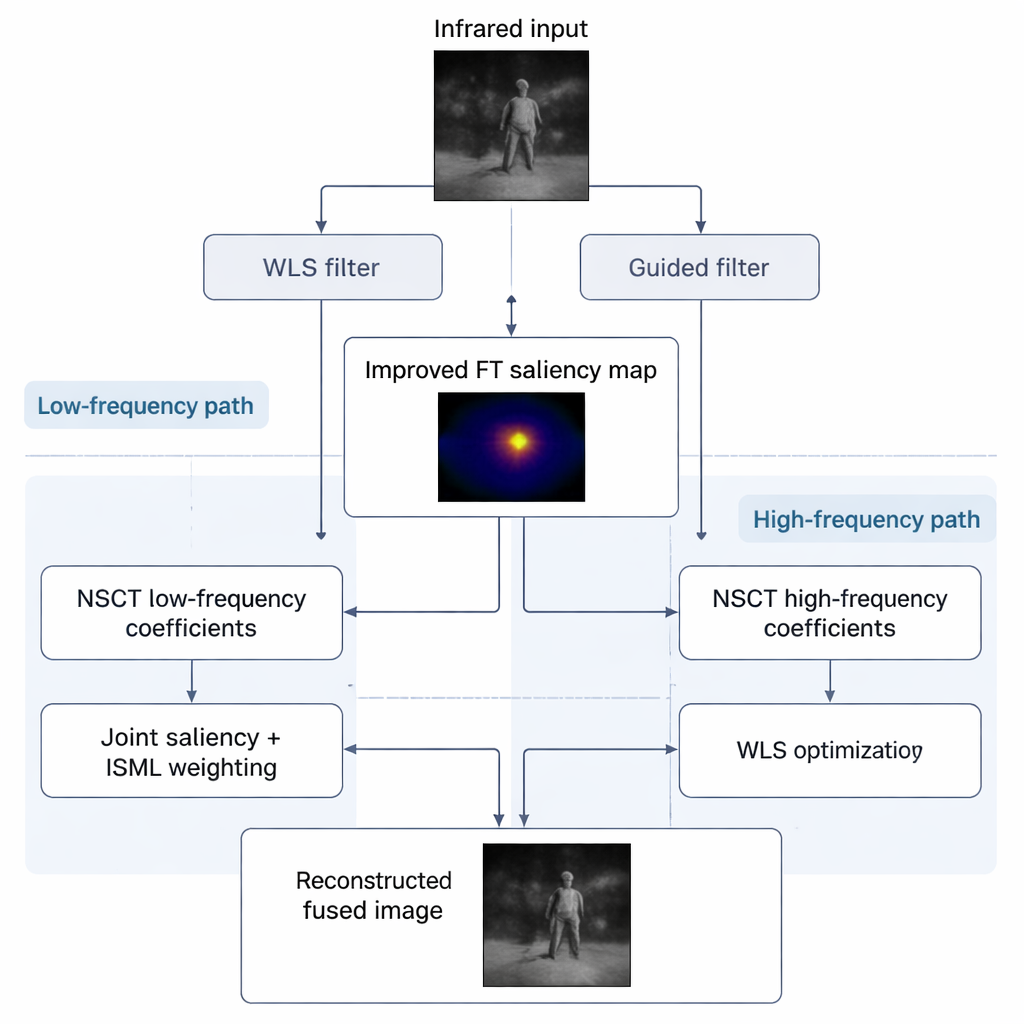

Författarna ser fusion som ett problem i konfliktlösning mellan de två bildtyperna. De fokuserar på tre återkommande problem: att avgöra vilka regioner som verkligen är viktiga ("salienta"), att balansera total ljusstyrka mellan varma infraröda mål och ljusa synliga bakgrunder, och att bevara känsliga texturer samtidigt som infrarött brus dämpas. För att hantera detta förfinar de en populär teknik kallad frequency‑tuned saliency detection, som försöker efterlikna det mänskliga visuella systemet genom att framhäva regioner som naturligt fångar vår uppmärksamhet. Istället för att förlita sig på en enkel oskärpa använder de ett par smartare filter — ett som jämnar ut samtidigt som kanter bevaras, och ett annat som förstärker kontrast — för att karva fram en renare, skarpare karta över var de intressanta infraröda målen finns.

Skala isär grova former och fina detaljer

När algoritmen vet var de viktigaste infraröda målen ligger, delar den både de infraröda och synliga bilderna i lager som skiljer ut grova strukturer från fina detaljer med hjälp av ett matematiskt verktyg kallat Non‑Subsampled Contourlet Transform (NSCT). Lågfrevenslagren innehåller breda ljusmönster, som himmel, vägar eller väggar, medan högfrevenslagren fångar kanter, texturer och små detaljer. För de grova lagren blandar metoden information med hjälp av både den förbättrade infraröda saliensmappen och ett Laplacian‑baserat mått på hur skarpa lokala strukturer är. Detta hjälper till att undvika utspädda bilder där antingen de varma objekten dominerar scenen eller där den synliga bakgrunden dränker viktiga mål.

Behåll texturer skarpa, håll brus under kontroll

Högfrevenslagren kräver en annan strategi, eftersom det är där både användbar textur och störande brus finns. Här väljer metoden först, region för region, vilken sensor som erbjuder starkare lokal detalj. Sedan förfinar den detta initiala val med en viktad minsta kvadraters‑procedur som lutar mot de renare, mer informativa synliga texturerna samtidigt som meningsfulla infraröda mönster fortfarande släpps igenom. Resultatet är en fusionerad bild där trädgrenar, byggnadskanter och vägmarkeringar ser skarpa ut, men där prickigt infrarött brus är reducerat.

Bättre bilder, bättre maskinbeslut

Teamet testade sitt tillvägagångssätt på flera publika datamängder och sina egna bilder i svagt ljus, och jämförde det med traditionella tekniker och moderna djupinlärningsmetoder. Mänsklig granskning visade att deras fusionerade bilder hade klarare bakgrunder, högre kontrast och mer tydliga mål, särskilt i dunkla korridorer, gator på natten och röriga utomhusscener. Objektiva mått på informationsinnehåll, skärpa och kontrast föredrog oftast den nya metoden eller visade att den var väl avvägd över metrikerna. Viktigt är att när dessa fusionerade bilder matades in i ett populärt objektdetekteringssystem (YOLOv5s) förbättrades träffsäkerhet, precision och återkallning märkbart. I klartext gör algoritmen inte bara snyggare bilder; den hjälper också automatiserade system att hitta människor och objekt mer tillförlitligt. Detta tyder på att smartare fusion av infraröd och synlig avbildning kan spela en nyckelroll i säkrare autonom körning, effektivare övervakning och mer pålitliga robotar som arbetar i mörker eller i visuellt komplexa miljöer.

Citering: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Nyckelord: infraröd-synlig fusion, bildsalien, fler sensors avbildning, mörkerseende, datorseende