Clear Sky Science · sv

RiemannInfer: förbättrad transformer‑inferens genom Riemannsk geometri

Varför detta är viktigt för vardagliga AI‑användare

Moderna chattbotar och AI‑assistenter kan lösa matteproblem, skriva uppsatser och till och med förklara medicinska ämnen, men vi vet fortfarande inte riktigt hur de når sina slutsatser — eller hur man får dem att resonera mer tillförlitligt. Den här artikeln introducerar “RiemannInfer”, ett nytt sätt att undersöka stora språkmodeller (LLM:er) genom att betrakta deras interna aktivitet som rörelse på en böjd geometrisk yta. Det perspektivet ger inte bara en mer intuitiv bild av hur dessa system tänker, utan gör också deras slutledningar snabbare och mer precisa.

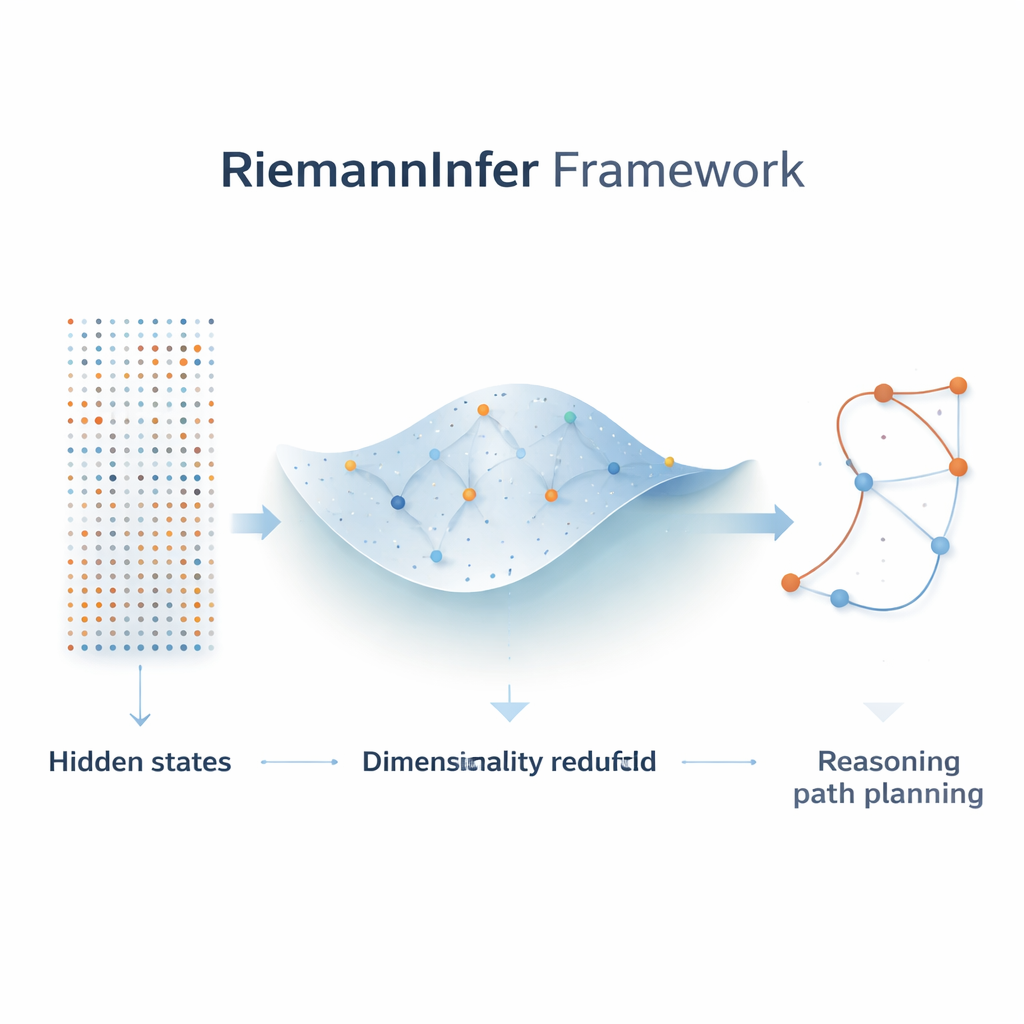

Att omvandla AI‑tänkande till en geometrisk resa

Inuti en LLM som GPT‑4 eller Llama representeras varje ord i en mening av en vektor i hög dimension, och lager av “attention” avgör hur starkt ord påverkar varandra. Författarna observerar att dessa dolda tillstånd kan ses som punkter i ett vidsträckt rum vars övergripande form kodar modellens språkförståelse. Istället för att behandla slutledning som en serie sannolikhetsberäkningar över text tolkar de det som ett problem att hitta vägar: modellen färdas från ett initialt tillstånd (frågan) till ett slutligt tillstånd (svaret) längs en bana i detta rum. Med verktyg från Riemannsk geometri — matematiken för böjda ytor — konstruerar de en böjd mångfald som fångar hur attention‑mönster böjer och sträcker ut detta interna landskap.

Komprimering av komplexitet utan att tappa helhetsbilden

Eftersom det råa interna rummet i en LLM är enormt är första steget i RiemannInfer att krympa det samtidigt som dess väsentliga struktur bevaras. Författarna kombinerar tekniker från topologi, som studerar hur punkter hänger ihop, med en populär algoritm för dimensionsreduktion kallad UMAP. Före dimensionsreduktion analyserar de ”formen” hos molnet av dolda tillstånd för att säkerställa att viktiga kopplingsmönster överlever kompressionen. Resultatet är ett lägre‑dimensionellt rum där viktiga relationer mellan token — till exempel vilka ord som ger stark uppmärksamhet åt varandra — i stort sett bevaras. Denna kompakta geometriska karta gör det möjligt att utföra precisa beräkningar av avstånd, kortaste vägar och krökning.

Bygga en böjd karta från attention

Kärninnovationen är att översätta attention‑vikter till ett geometriskt avståndsmått. När modellen ger stark attention mellan två token behandlar RiemannInfer dem som nära varandra på mångfalden; svag attention placerar dem längre ifrån varandra. Utifrån dessa relationer definierar författarna ett metriskt fält — en matematisk regel som bestämmer längder och vinklar — och använder det för att beräkna geodetiska banor, den böjda motsvarigheten till räta linjer, samt krökning, som mäter hur skarpt rummet böjer sig. Multi‑head attention blir naturligt en blandning av flera metriska komponenter, var och en fångande olika aspekter av språklig struktur, såsom grammatik eller betydelse. Med denna konstruktion kan modellens beslut tolkas som val av särskilda banor genom ett landskap vars toppar och dalar speglar var information är tät eller gles.

Planera lågansträngda resonemangsleder

När mångfalden väl är konstruerad omformulerar författarna slutledning som att hitta en ”lätt” väg från fråga till svar — en som minimerar det totala arbete som utförs längs vägen. De lånar en analogi från bergsklättring: att klättra en brant, taggig rutt kräver mer energi än att följa en jämnare ås till samma topp. I LLM‑sammanhang spelar krökning rollen av branthet, och modellens resonemangsarbete motsvarar hur mycket dess interna osäkerhet minskar längs en bana. Med approximativa formler för geodeter och krökning, kombinerat med en effektiv graf‑sökalgoritm (Dijkstras algoritm), identifierar RiemannInfer snabbt rutter som minimerar detta arbete och vägleder därigenom modellen mot mer effektiva tankekedjor.

Vad experimenten visar för verkliga modeller

Författarna testar RiemannInfer på flera samtida LLM:er, inklusive GPT‑4o, Llama‑3‑405B och DeepSeek‑V2‑400B, över krävande matematik‑ och resonemangsbenchmarks såsom GSM8K, MATH500, StrategyQA och AGIEval. I samtliga fall förbättrar integreringen av RiemannInfer dessa modellers noggrannhet med några procentenheter — små tal som ändå är betydelsefulla i prestandans framkant — samtidigt som hastigheten bibehålls eller förbättras något. En jämförelse med en enklare, rent linjär metod visar att ignorera den böjda geometrin hos de dolda tillstånden dramatiskt försämrar prestanda, vilket understryker vikten av mångfaldsperspektivet.

Större bild: att ge AI‑resonemang en fysisk känsla

För en lekman är huvudpoängen att författarna har omvandlat de ogenomskinliga inre mekanismerna hos stora språkmodeller till något mer gripbart: en resa över ett böjt landskap där gott resonemang motsvarar att följa mjuka, lågansträngda stigar. Genom att förankra attention‑mönster och resonemangssteg i geometriska och fysikaliska begrepp — avstånd, krökning och arbete — erbjuder RiemannInfer både ett praktiskt sätt att förbättra resultat och en konceptuell brygga mellan AI och fysiken för kontinuerliga rum. Även om de nuvarande metoderna är approximativa och många detaljer återstår att förfina, pekar detta ramverk mot framtida AI‑system vars tankeprocesser kan analyseras, optimeras och kanske till och med utformas med geometrins och fysikens språk.

Citering: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Nyckelord: stora språkmodeller, geometrisk djupinlärning, Riemannsk mångfald, attention‑mekanismer, resoneffektivitet