Clear Sky Science · sv

När LLM:er talar ZigBee: att utforska låg latenstid och resonemangsmodeller för generering av nätverkstrafik

Smarta hem behöver trovärdiga övningar

När våra hem fylls med smarta lampor, uttag och sensorer blir det osynliga samspelet mellan dem både en bekvämlighet och en potentiell svag punkt. Ingenjörer som bygger och säkrar dessa system behöver säkra sätt att ”repetera” hur nätverk uppför sig under verkliga förhållanden, inklusive sällsynta fel och cyberattacker. Denna studie undersöker om moderna AI‑språkmodeller—samma typ som används i chattbotar—kan återanvändas för att generera realistisk smart‑hem nätverkstrafik, och därmed ge forskare ett kraftfullt nytt testfält utan att behöva spela in varje möjlig scen från verkliga bostäder.

Från mänskligt språk till enheters konversationer

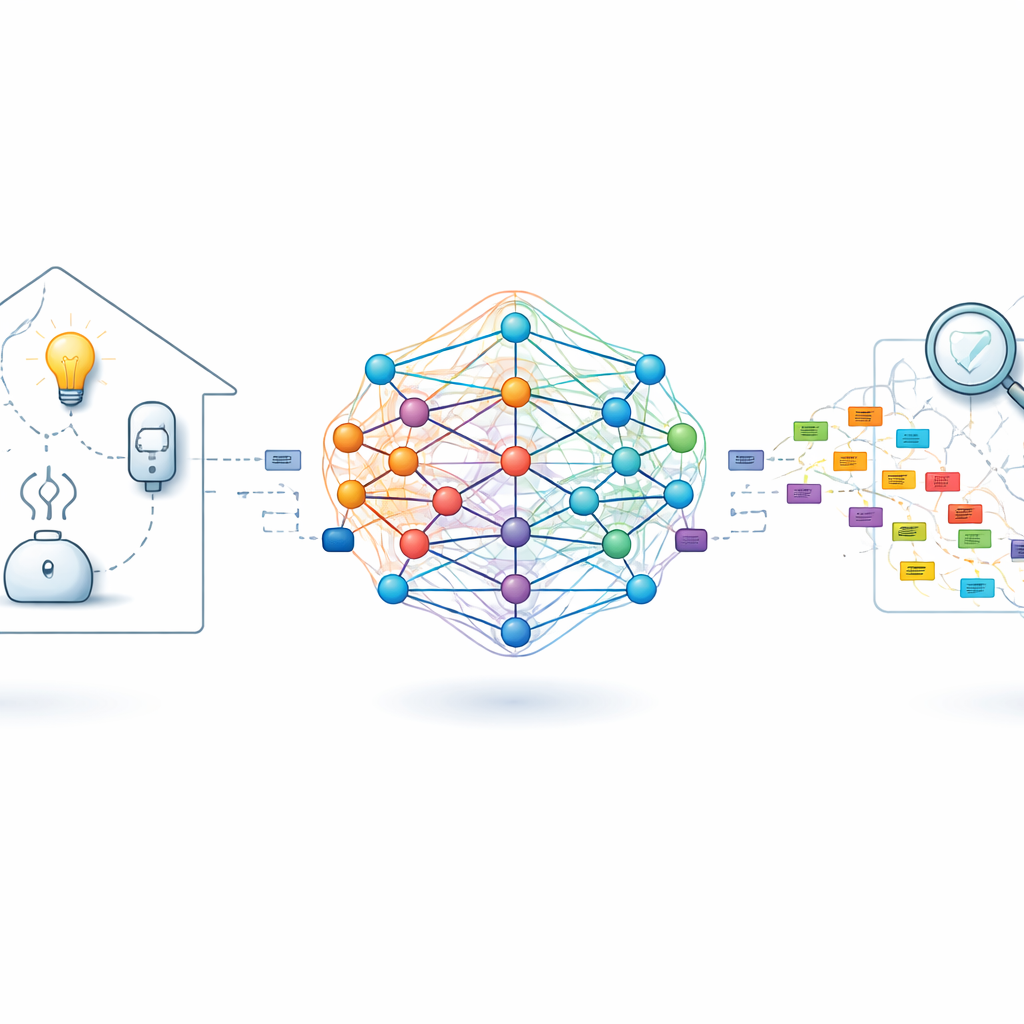

Studien fokuserar på ZigBee, en populär trådlös standard som används i smarta glödlampor, uttag och rörelsesensorer. Istället för att generera vanlig text matar författarna in exempel på ZigBee‑paket—tidsstämplade poster över vem som talade med vem och vilka protokollfält som användes—i stora språkmodeller (LLM:er) från OpenAI, specifikt GPT‑4.1 och GPT‑5. Dessa modeller behandlar varje paket som en strukturerad ”mening” och lär sig mönster i hur enheter och den centrala hubben kommunicerar över tid. Målet är inte bara att efterlikna grundläggande statistik som genomsnittlig paketstorlek, utan att producera ny trafik som följer ZigBees strikta regler, använder giltiga enhetsadresser och bevarar realistisk timing samt begäran–svar‑mönster.

Två experiment: envägskommunikation och full dialog

För att testa idén utformar forskarna två huvudexperiment med en stor, verklig smart‑hem dataset kallad ZigBeeNet, som innehåller cirka 25 miljoner paket insamlade från 15 enheter över 20 dagar. I det första experimentet studerar de envägskommunikation från en enskild smart lampa till hubben och lär LLM:en med bara de första tio minuterna av verklig trafik som exempel. I det andra går de till en mer verklighetstrogen miljö där lampan och hubben utbyter meddelanden i båda riktningarna, inklusive broadcast från hubben. I båda fallen visas en liten uppsättning exempelpaket för modellen i prompten (few‑shot‑lärande), och modellen ombeds att producera längre segment av helt ny trafik som kan konverteras tillbaka till standardfångstfiler och inspekteras med vanliga nätverksverktyg.

Vägledning av modellen med regler och mänskliga kontroller

Eftersom ett felplacerat fält eller en tidsstämpel i fel ordning kan bryta illusionen av realism bygger teamet ett noggrant upplägg för prompting och återkoppling. Först filtrerar och exporterar de de verkliga paketen, sedan formulerar de prompts som anger tillåtna enhetsadresser, meddelandetyper och tidsformat. I en initial fas granskar en mänsklig expert modellens utdata och letar efter problem som ogiltiga adresser, omöjliga sekvensnummer eller tidsluckor. Istället för att manuellt rätta paketen översätter de dessa fynd till striktare promptregler—till exempel att förbjuda att en enhet skickar till sig själv eller att kräva att paketantal stannar inom ett realistiskt intervall. När reglerna är stabila ”fryses” promptarna och återanvänds oförändrade så att senare experiment blir helt automatiska och reproducerbara.

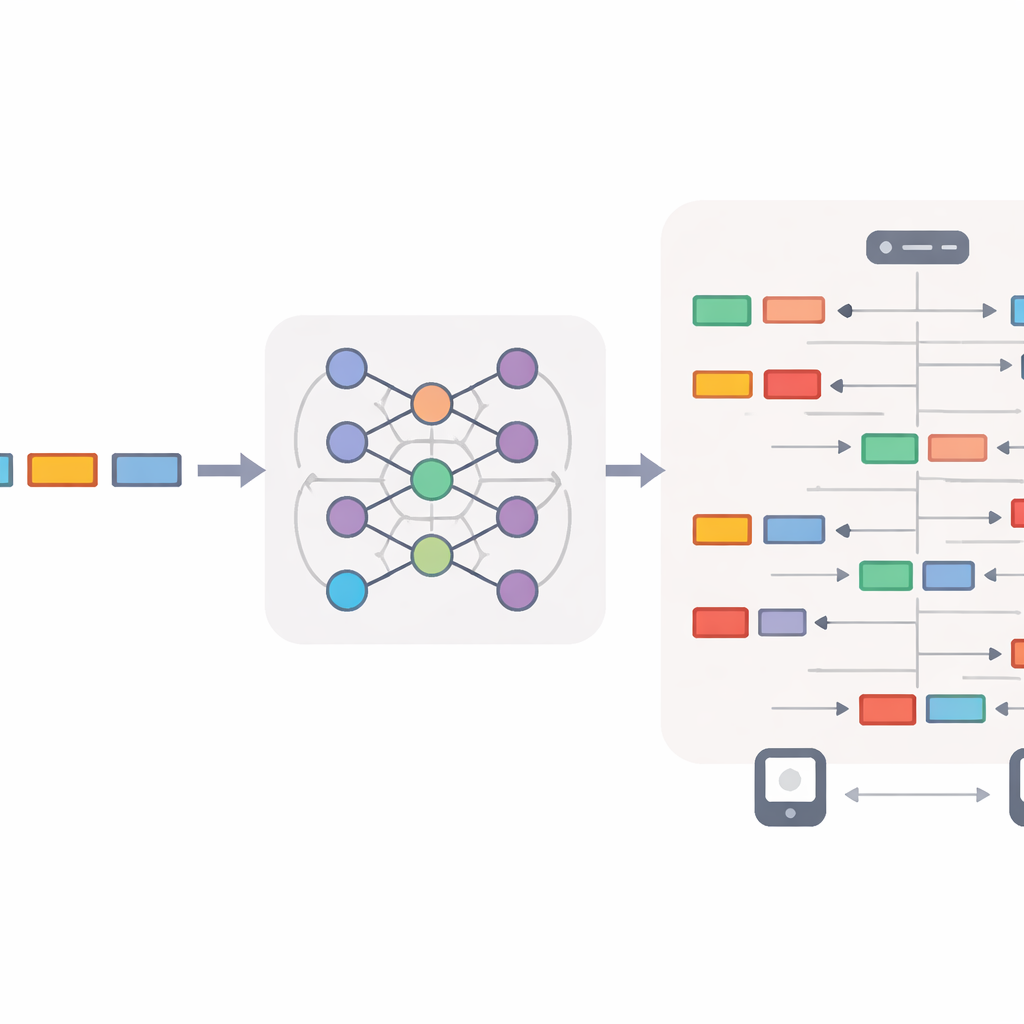

Att sätta LLM:er mot äldre generatorer

För att se om LLM:er verkligen tillför värde jämför författarna GPT‑4.1 och GPT‑5 med två klassiska djupinlärningsmetoder: återkommande neurala nätverk (RNN) och generativa adversariella nätverk (GAN), båda anpassade för att generera ZigBee‑liknande sekvenser. De utvärderar alla modeller utifrån många dimensioner: hur väl inter‑ankomsttider matchar verklig trafik, om paket avkodas korrekt i standardverktyg, om protokollregler och enhetsroller respekteras, hur ofta paket upprepas och hur ofta de exakt kopierar träningsexempel. Resultaten visar att båda GPT‑modellerna producerar nästan perfekt avkodbar och protokollkompatibel trafik med låg avvikelse från verkliga tidsmönster, medan RNN:er har svårt med långsiktig ordning och GAN:er ofta skapar orealistiskt tät eller semantiskt ogiltig trafik, särskilt vid tvåvägskommunikation och längre tidslängder.

När mer ”tänkande” inte hjälper

Studien undersöker också en överraskande fråga: förbättrar det nätverksrealismen om man ger den resonemangsinriktade GPT‑5 mer intern ”tänketid”? Genom att ställa in GPT‑5:s dolda resonemangseffekt från låg till hög finner författarna att större ansträngning gör modellen långsammare och mer ordrik, men inte bättre—och ibland sämre—på hur nära dess trafik ligger verkligheten. GPT‑4.1, en snabbare icke‑resoneringsmodell, matchar konsekvent eller överträffar GPT‑5 i viktiga kvalitetsmått samtidigt som den använder färre beräkningsresurser. Vid längre 30‑minuters simuleringar behåller båda LLM:erna korrekt ZigBee‑beteende, men klassiska RNN‑ och GAN‑baslinjer driver iväg avseende timing och protokollriktighet.

Vad detta betyder för säkrare smarta hem

För icke‑specialister är huvudbudskapet att moderna språkmodeller kan lära sig inte bara mänskliga konversationer utan också ”språket” hos smarta hem‑enheter och generera trovärdig, regelstyrd trafik på begäran. Arbetet visar att en relativt snabb, låg‑latenstidsmodell som GPT‑4.1 redan kan fungera som en högfidelitets trafikgenerator för testning och säkerhetsutvärdering, vilket potentiellt minskar behovet av att fånga känsliga verkliga data. Det understryker också att mer komplext, tungt resonemang inte alltid är bättre: för tätt strukturerade tekniska uppgifter kan enklare, effektiva modeller vara det smartare valet. När författarna släpper sin kod och data kan detta tillvägagångssätt hjälpa forskare världen över att stresstesta smarta hem‑system, förbättra intrångsdetektion och utforska nya nätverksdesigner i en säker, syntetisk lekplats.

Citering: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Nyckelord: smarta hem IoT, ZigBee trafikgenerering, stora språkmodeller, nätverkssäkerhetstestning, syntetiska nätverksdata